基于隐空间动力学的大模型RL探索新视角——寻求平衡之道

强化学习已成为推动大型模型性能飞跃的关键技术手段。从OpenAI的o3、DeepSeek-R1到Gemini 3,这些前沿模型通过不断微调强化训练来提升解决复杂推理任务的能力。然而,在这一过程中也逐渐暴露出一个问题:随着训练的深入,策略分布趋向集中,探索能力随之减弱,最终导致优化欠收敛和性能瓶颈。这种现象从根本上说是由于在强化学习中探索与利用之间的不平衡造成的,并且在稀疏奖励的可验证奖励强化学习(

共找到 13 篇相关文章

强化学习已成为推动大型模型性能飞跃的关键技术手段。从OpenAI的o3、DeepSeek-R1到Gemini 3,这些前沿模型通过不断微调强化训练来提升解决复杂推理任务的能力。然而,在这一过程中也逐渐暴露出一个问题:随着训练的深入,策略分布趋向集中,探索能力随之减弱,最终导致优化欠收敛和性能瓶颈。这种现象从根本上说是由于在强化学习中探索与利用之间的不平衡造成的,并且在稀疏奖励的可验证奖励强化学习(

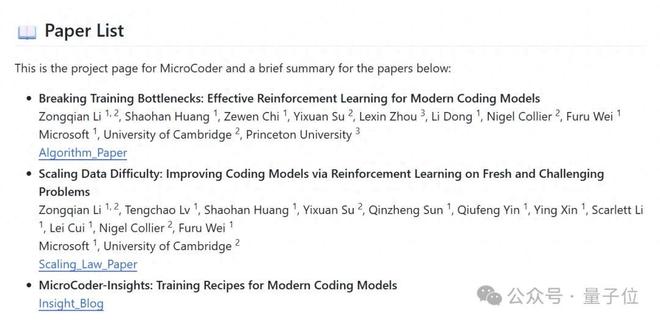

MicroCoder团队 投稿量子位 | 公众号 QbitAI新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。微软亚洲研究院与剑桥大学、普林斯顿联合推出MicroCoder,从算法、数据、框架、训练经验四个维度全面升级,在最新代码测试集上取得明显提升,并从七个方面开源了34条训练洞察。背景:旧经验遇上新模型,为何几乎全部“失效”?强化学习正在成为代码大模型能

如何让人工智能不仅能够生成可执行的代码,还能优化代码的运行效率?这个问题长期以来一直困扰着研究者。最近,中国科学院计算技术研究所的一个团队提出了名为 SparseRL 的新框架,首次将深度强化学习应用于稀疏 CUDA 代码的生成任务中。简单来说,就是让 AI 学会根据稀疏矩阵的具体结构,自动生成最优化的 CUDA 实现代码。实验数据表明,在经典的 SpMV 任务上,该方法将编译成功率提高了 20%

作者|周一笑邮箱|[email protected]北京时间3月20日,AI编程工具Cursor发布了自研模型Composer 2,宣称是公司首次对基座模型进行“继续预训练结合强化学习”的成果。发布博客里没提基座模型的来源,措辞像是在说,这是Cursor自己从头炼出来的。不到两小时,一个名叫Fynn的开发者在调试Cursor的API时,截获了Composer 2的真实模型ID,kimi

曾经广受欢迎的编程工具Cursor近期发布了一款名为Composer 2的新模型。官方声明中特别提到,这款模型是通过“持续预训练”和“强化学习”来提升性能的。然而,就在发布不到24小时后,一名开发者在调试API时发现模型的ID为“kimi-k2p5-rl-0317-s515-fast”。这意味着,Cursor发布的Composer 2实际上是基于Kimi K2.5,并添加了强化学习的元素。预训练负

于骞博士在德国慕尼黑汽车论坛上探讨了物理人工智能的发展趋势。 量子位的朋友们 2026-03-19 19:02:55 量子位 世界

昨日,智能纪元 AGI 报道称,前 DeepSeek 研究员、现任小米 MiMo 大模型项目负责人的罗福莉博士发布了一篇重要论文,该论文与北京大学合作开发了一种名为 ARL-Tangram 的统一资源管理系统。ARL-Tangram 采用了一种统一的动作级公式和灵活的调度算法,能够在满足不同硬件资源限制的同时,最大限度地减少动作完成时间,并实现定制化的异构资源管理。在实际的智能体强化学习任务中,A

在今天的 NVIDIA GTC 2026 大会上,理想汽车基座模型团队负责人詹锟分享了关于该公司下一代自动驾驶基础模型 MindVLA-o1 的主题演讲《MindVLA-o1:开启全能范式 —— 探索下一代统一视觉-语言-动作自动驾驶大模型》。该模型通过五大创新技术:3D 空间感知、多模态思考、统一行为生成、闭环强化学习和软硬件协同设计,构建了一个面向物理世界的自动驾驶基础模型。具体来说,Mind

在强化学习领域,生成式策略(例如 Diffusion Policy 和 Flow Matching)展现了强大的多模态分布拟合能力,但其多步迭代采样导致的高延迟一直是实时控制的一个难题。清华大学智能驾驶课题组 iDLab 和加州大学伯克利分校人工智能研究院 BAIR 在 ICLR 2026(口头报告,Top 1%)联合发表的研究成果《Mean Flow Policy with Instantane

吴嘉赟博士就读于卡内基梅隆大学(CMU)机器学习系,专注于大语言模型评估和后训练技术的研究。大语言模型在关键领域的应用受到幻觉问题的困扰。最近一项研究提出了一种新的行为校准强化学习方法,旨在解决这一难题。该论文详细探讨了如何通过调整奖励函数来改进LLM的表现。经过特定训练后,一个参数量仅为40亿的小型模型在幻觉抑制方面超越了GPT-5等顶级大模型。图1展示了模型回答数学问题时置信度标注的实例。每一

我是李国豪,目前专注于大语言模型和代理研究领域。本科毕业于哈尔滨工业大学电子信息工程专业,并在沙特阿卜杜拉国王科技大学(KAUST)攻读博士学位。我的学术兴趣从强化学习延伸到图神经网络,最终聚焦于大语言模型及其应用。作者|王艺我的兴趣演变始于强化学习,但很快发现它难以解决跨领域问题的泛化性挑战。因此,我转向探索更通用的表征学习方法,并研究图神经网络(GNN)。然而,在ChatGPT出现之后,我发现

目前,RLVR(带有验证奖励的强化学习)已经成为促进大规模语言模型进行有效推理的主要技术路径。然而,这种方法在扩展性方面面临一个主要障碍:需要高质量的标注数据来监督奖励机制。当转向不需要人工标注的数据训练时,“自我奖励” 强化学习方法可能导致模型迅速陷入所谓的 “训练崩溃”。尽管模型看似获取到了越来越多的奖励,实际上它们是在利用自我奖励系统的漏洞进行投机行为,而非真正解决问题获得奖励。什么样的强化

轻舟智航重新回归高端市场:L2+车型量产已突破百万大关,城市NOA功能也下放到十万级车型中。 在自动驾驶领域,到2026年,“收敛”一词被广泛认为是行业发展的关键词之一。 技术层面而言,多模态的大模型、数据驱动及强化学习等新兴方法展现出一种阶段性“终局”的特点: