最新发布的DeepSeek-V4技术报告令人震惊地揭示了其延迟发布的秘密。这不仅让社区感到意外,也让人们开始猜测背后的原因究竟是什么。

昨日的AI圈活动可谓是一场盛大的聚会。

这份长达近60页的技术文档详细介绍了从架构设计到训练方法再到后续优化的所有细节。

从V3发布至今已过去了整整484天,而它比之前的版本多用了一倍的时间进行开发。为什么会有这样的时间差呢?

经过仔细研究这份报告后,我们发现了一些可能的原因,并且对DeepSeek这家公司的工程实力有了更深的认识。

DeepSeek-V4最引人深思之处在于其在训练代理、基础结构和处理震荡时展现的透明度与理性思考。

今天我们将深入探讨V4的技术细节,揭示更多不为人知的秘密。

V4模型拥有超过30万亿令牌以及数万亿参数。

难度直接拉满

自从V3发布以来,已经过去了漫长的484天,而V4才刚刚以预览版的形式出现。

尽管报告中未明确解释这一时间跨度的原因,但其中一段内容或许能够提供一些线索。

V3模型的预训练阶段使用了约15万亿令牌的数据量,而在V4-Flash和V4-Pro版本中,这个数字分别翻倍至32万亿和33万亿。同时,参数数量也大幅增加。

数据量和参数规模的增长不仅带来了更高的计算需求,还增加了稳定性维护的难度。

报告特别指出,“训练稳定性挑战”是DeepSeek明确提及的一个重要问题。

这种透明的做法得到了谷歌DeepMind研究者的高度赞扬,并且也引起了广泛关注。

在大规模集群环境下,随着参数数量和数据量的增长,硬件的微小误差会被放大。

报告中“stability”一词反复出现十余次,这在技术文档中是相当罕见的现象。

这种频繁提及表明了稳定性挑战的真实存在性。

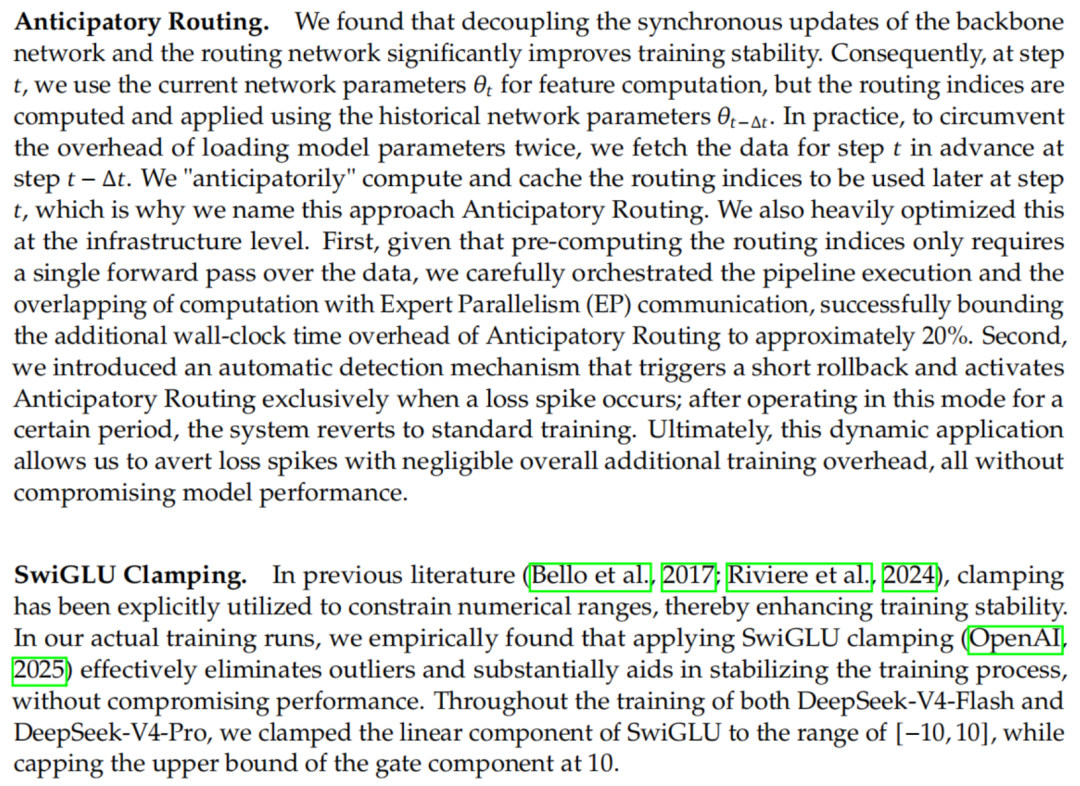

DeepSeek发现MoE层中的数值异常值会导致训练曲线的突然上升。

为应对这一问题,DeepSeek提出了两种解决方案。

第一种方案名为Anticipatory Routing,它通过解耦骨干网络和路由网络更新来防止恶性循环的发生。

另一个方法是SwiGLU Clamping,直接限制数值范围以控制异常值的出现。

目前的大模型训练已经进入了硬件、编译器栈以及数学架构一体化的新阶段。

报告中提到了一些值得注意的技术细节。

DeepSeek确认Anticipatory Routing和SwiGLU Clamping的有效性,但同时指出其背后的机制仍有待进一步研究。

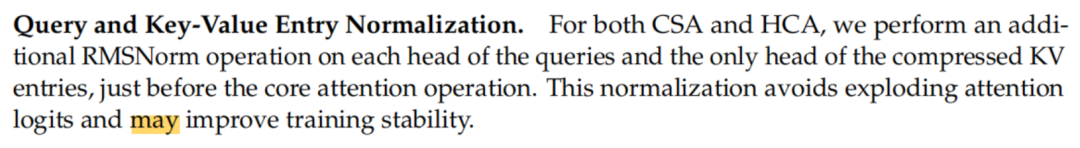

即使是最基础的操作如Q/KV归一化,在这种情况下也可能不完全可靠。

“may”这个词的使用表明没有任何方法可以保证绝对稳定。

数据量翻倍带来的不仅仅是难度的线性增长,还有潜在崩溃点的数量级增加。

每个网络层、每一次梯度更新和通信同步都有可能成为系统失效的风险源。

DeepSeek选择将所有这些问题详细记录在报告中,这在行业内是非常罕见的做法。

硬件还是软件,谁该为训练不稳定负责?

技术报告明确提出了“训练稳定性挑战”,但没有指明具体是哪家硬件平台的问题。

有人推测这可能是由于特定硬件平台的限制导致了这一问题。

有观点认为训练中的稳定性难题可能与算力平台有关,并且其他公司也可能遇到类似的情况。

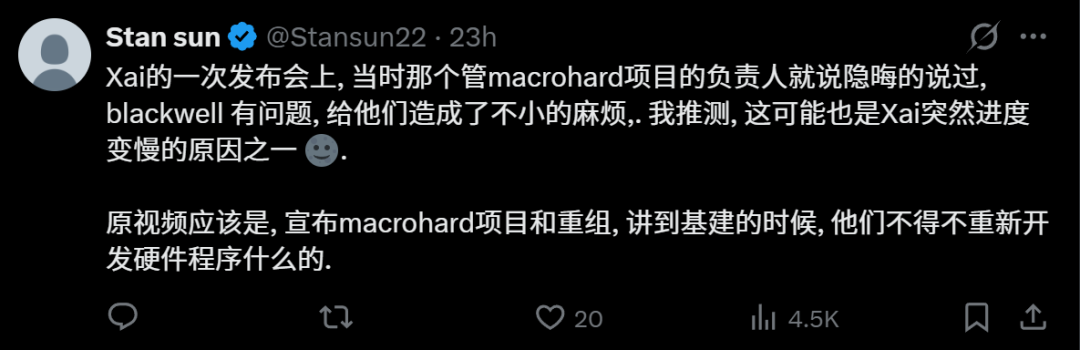

在一次发布会上,xAI透露说英伟达最新的芯片给他们带来了不小的麻烦,这也解释了一部分进度放缓的原因。

当然,这个问题并不仅仅那么简单。

大规模集群涉及众多变量:从硬件本身到散热系统、电力供应以及编译栈适配等多方面因素都可能影响训练稳定性。

目前还没有官方给出确切答案。

一切都还在猜测之中。

Agent训练体系

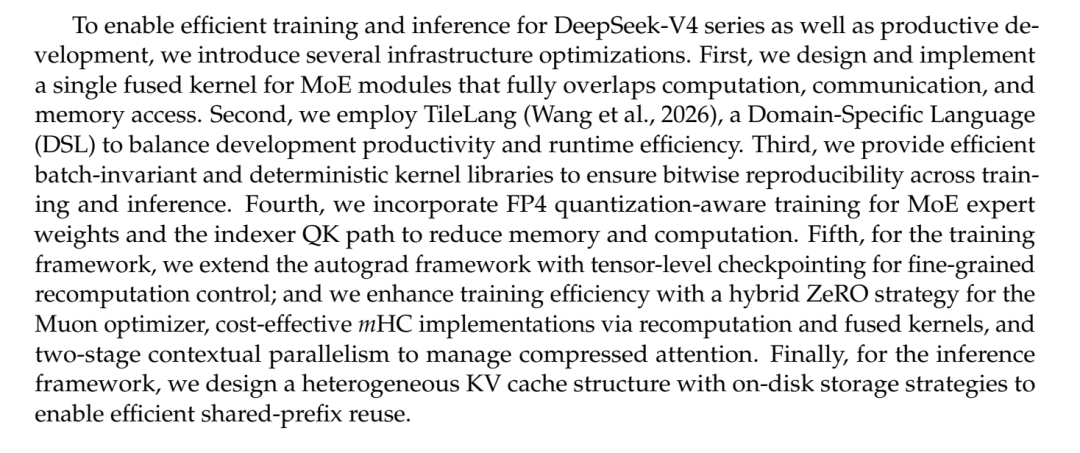

工程能力让人肃然起敬

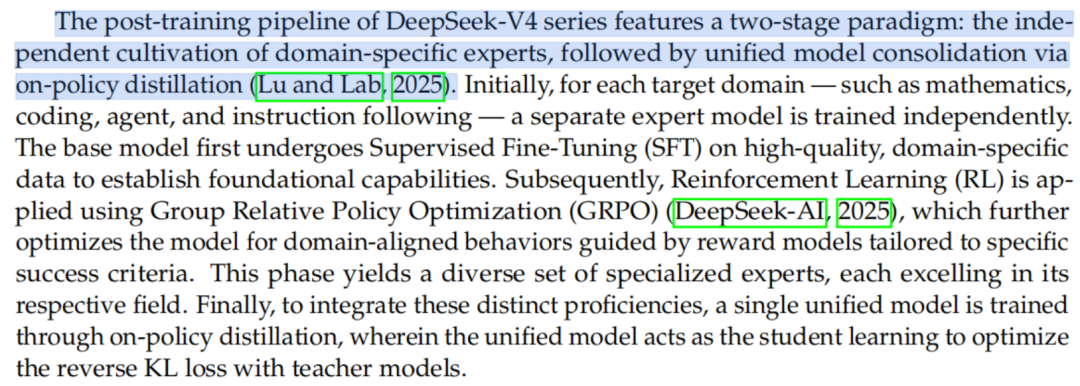

V4的预训练阶段可以看作是在与硬件平台进行博弈,而其后处理流程则展示了高度专业的工程设计审美。

一个值得深入研究的部分是V4论文中关于Agent能力工程化路径的内容。

DeepSeek认为代理的能力应该是“成长”出来的,而非直接通过迁移学习获得的。

拒绝采用硬迁移策略,而是选择在预训练阶段注入大量Agentic Data。

传统做法是先训练一个对话模型再将其转变为Agent。相比之下,DeepSeek的方法更为高效。

在V4的中期训练中就引入了海量任务链数据以丰富其经验。

这意味着在学习之初,模型就已经接触到了各种复杂场景和反馈机制。

通过这种策略,代理可以更好地应对现实世界的挑战。

DeepSeek还开发了一系列优化工具,提高了计算效率并降低了成本。

MegaMoE技术将通信与计算融合进一个流水线内核中,极大提升了性能表现。

自主设计的DSL语言简化了外部工具调用过程,并显著提高了成功率。

Reasoning Effort分模式训练允许根据任务需求动态调整推理能力配置。

通过这一策略,V4在保持较低成本的同时实现了优秀的性能指标。

社区研究者普遍认为DeepSeek的工程设计是令人叹服的。

V3.2版本每次接收到新消息都会丢弃之前的推理历史记录,而V4则保留了跨轮次的历史信息以维持任务连贯性。

这种灵活的设计使V4在面对复杂任务时能够保持高效运行。

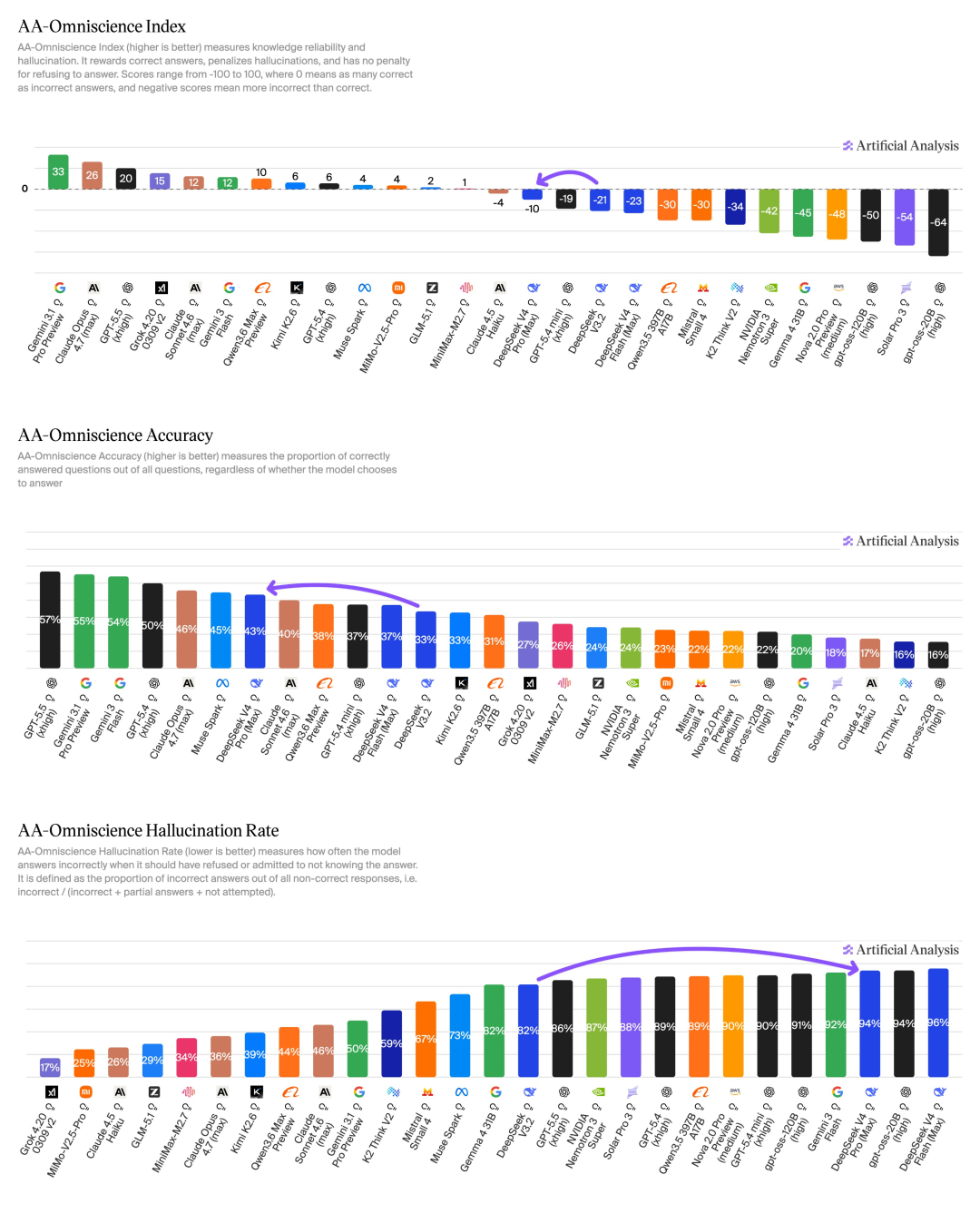

但另一方面,这也带来了幻觉率高达94%的问题。

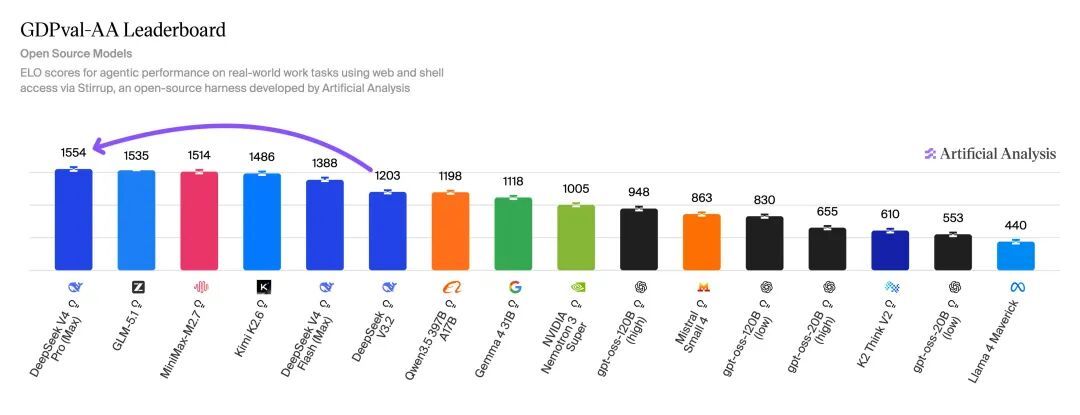

实际测试显示,在特定基准测试中V4 Pro Max的表现远超其他开源模型。

尽管存在这些问题,DeepSeek依旧受到广泛尊敬。

在这份报告中,人们看到了透明度和勇敢面对挑战的品质。

他们通过工程手段解决了一系列技术难题,并展示了自己独特的发展路径。

DeepSeek正在探索大模型向AGI发展的另一条道路——

如果架构还不够完善,则增加更多的工程技术;如果计算资源有限,则优化算法以提高效率。

尽管DeepSeek-V4并非完美无缺,但它代表了中国AI领域的最新成就和无限活力。

为了训练Agent的实操能力,DeepSeek搭建了一个名为DSec的平台。

3FS分布式文件系统,确保了数据的极速存取;数十万并发Sandbox实例,则意味着V4在训练时,同时有几十万台「虚拟电脑」在跑代码、测Bug。

MegaMoE:通信计算一体化

在MoE层,DeepSeek把通信和计算融合进单个pipeline kernel,专家按wave调度,通信延迟完全隐藏在计算之下。

结果就是,通用场景加速1.5到1.73倍,RL rollout等延迟敏感场景最高1.96倍。

自研DSML:拒绝转义失败

工具调用方面,DeepSeek干脆自己设计了一套类似XML的DSL(领域特定语言)。

这套协议简单高效,直接把工具调用的成功率从「看运气」提升到了「工业级稳健」。

Reasoning Effort分模式训练

还有一个精细的设计,就是V4支持不同的思考模式。

Non-think模式是简单的工具选择,秒回。High/Max则针对长文档、重构、复杂Bug,拉满推理算力。

这种「能省则省,该狠则狠」的策略,也是V4成本能做到Claude 1/4的关键。

社区的很多研究者读完这部分后,膜拜得五体投地:「DeepSeek的工程能力,依旧扎实得让人没话说」。

Interleaved Thinking升级

V3.2在每个新用户消息到来时会丢弃之前的思考痕迹,V4在Tool-Calling场景下保留了完整的跨轮次推理历史,让Agent在长时程任务中维持连贯的推理链。

普通对话场景仍每轮清空,保持上下文精简。

硬币的另一面,是94%的幻觉率

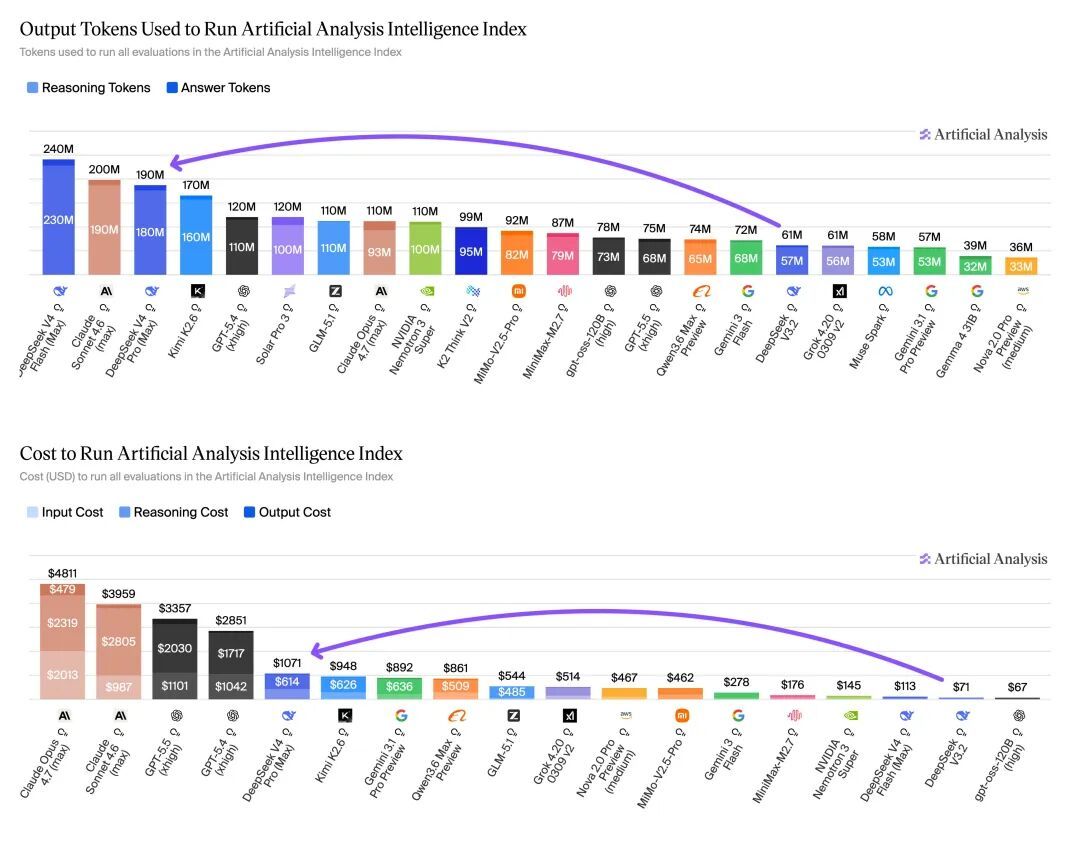

Artificial Analysis的实测给出了一个更立体的画面。

跑完Intelligence Index的全量基准测试,V4 Pro只花了1071美金,比Claude Opus 4.7的4811美金便宜了四倍多。

Agent能力方面,V4 Pro Max在GDPval-AA实测(面向真实工作任务的Agent基准)中拿到了1554分,全面领先一众开源模型。

然而,天下没有免费的午餐。

Aritificial Analysis的报告里也非常坦诚地指出了这种做法的代价:V4 pro在AA-Ominiscience上的幻觉率高达94%。

这揭示了一个结构性困境:要在有限算力预算下逼近顶级性能,就不得不在某些维度上做取舍。

DeepSeek选择把筹码全压在推理和Agent能力上,代价,就是知识都准确性。

为什么我们依然对DeepSeek充满敬意?

在这次V4的报告中,有人看到了「训练不稳」的尴尬,有人看到了「幻觉严重」的短板。

但在我们看来,这份报告最动人的地方在于透明。

他们敢于承认硬件适配阵痛,敢于披露那些看似「补丁」的解决方案,更敢于展示自己如何用最硬核的工程能力,在几十万个沙箱里一点点磨出Agent的灵魂。

从V3的Multi-head Latent Attention到V4的OPD蒸馏和DSec沙箱,DeepSeek正在用一种近乎偏执的「工程主义」,探索着大模型通往AGI的另一条路径——

如果架构还没完美,那就用工程把墙砌厚;如果算力不够便宜,那就用算法把效率榨干。

DeepSeek-V4也许不是最完美的终局,但它绝对是目前最真实的、最充满活力的「中国AI现场」。