近日,在Cloud Next 2026大会上,谷歌推出了第八代TPU,该版本将训练与推理任务分离为两个独立的芯片:TPU 8t用于大规模训练,而TPU 8i则专攻高效推理。这一设计创新标志着该公司在专业化算力领域迈出了一大步,并引发了行业对于未来AI计算发展方向的深入探讨。

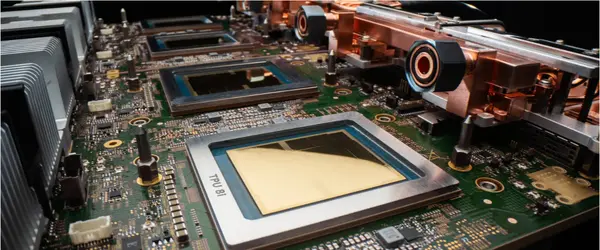

谷歌TPU 8i

在过去的十年中,英伟达凭借其GPU以及CUDA生态系统几乎垄断了整个AI市场,成为推动全球人工智能发展的核心力量。然而,谷歌始终坚持自主研发TPU技术路线,从最初内部使用到如今全面对外服务,展现出了在AI基础设施领域的独特远见和战略眼光。

目前,推理需求预计在未来将占据AI总计算量的70%以上,标志着行业正处于一个重大的转折点。无论是聊天机器人、AI代理还是数字员工的应用跃迁,都伴随着推理负载的巨大增长。与此同时,包括微软、亚马逊在内的多家科技巨头也开始研发自己的芯片解决方案,这预示着曾经由少数几家主导市场的局面即将结束。

谷歌为何选择走专业化算力这条路呢?

从通用到专用

将TPU划分为专门针对训练和推理的两个独立模块,反映了AI计算需求的重大转变。根据巴克莱银行的预测,在2026年时,用于推理任务的计算量将超过总计算量的70%,并且将达到约1450亿美元的市场规模,远超训练芯片的需求。

谷歌TPU 8i

同时期发布的德勤报告指出,全球AI算力芯片市场预计在2026年突破至2800亿美元规模,推理芯片首次超越训练芯片。巴克莱预测到2028年时英伟达在推理市场的份额将从现在的约80%降至大约50%,主要原因在于云服务提供商为提高其推理市场份额而推出了定制ASIC芯片。

进入AI代理时代后,推理需求进一步增加。根据巴克莱的分析,人工智能的发展可以分为三个阶段:当前是“聊天机器人”阶段;接下来从2025年至2026年过渡到“AI代理”阶段;然后在2027年后进入“数字员工”时期。在代理时代中,单次交互所需令牌的数量和多步骤推理的需求都呈指数级增长。

面对这一趋势,通用GPU的局限性变得越来越明显。它们虽然拥有众多并行计算单元以及复杂的内存调度功能,在训练时具有优势,但在推理过程中却可能导致不可预测的时间延迟问题。谷歌的研究人员Amin Vahdat明确表示:“随着AI智能体的发展,我们相信为训练和推理提供专门优化的芯片将会极大地提升整个技术生态系统。”

挣脱“英伟达枷锁”

除了性能上的考虑外,科技巨头对英伟达供应链依赖性的担忧也是推动专业化算力发展的另一重要因素。目前,英伟达几乎掌控了全球85%至92%的AI加速器市场,并且在2026财年数据中心业务收入高达2159亿美元,毛利率达到73.6%,其垄断地位显而易见。

英伟达

英伟达不仅以其硬件产品闻名,还拥有强大的CUDA软件生态系统。经过二十多年的积累,已经有超过400万的开发者注册使用CUDA技术。鉴于高昂的成本以及潜在的供应短缺风险,全球最大的几家云服务供应商纷纷投身于自主研发芯片的工作中。

从最初的一家独大到如今全行业的普遍认同,专业化算力已经成为一种趋势。微软在2026年年初发布了其第二代自研AI芯片Maia 200,并采用3纳米制程技术;Meta则宣布与博通合作研发MTIA定制加速器;亚马逊CEO安迪·贾西透露Trainium需求进入爆发期,计划于同年早些时候推出新款产品。

根据TrendForce的数据预测,在即将到来的2026年里,全球八大云服务提供商预计会投入超过7100亿美元用于资本支出,同比增长约61%。其中Alphabet公司有望投资超过1783亿美元,增长幅度达到95%,成为业内唯一一家ASIC出货量高于GPU的供应商。

算力专属化带来了什么

谷歌的专业化算力战略从根本上重新定义了AI时代下的计算权力格局——从依赖外部通用计算资源转而走向深度定制和软硬件协同发展的专用计算体系。这一转型的价值体现在三个方面。

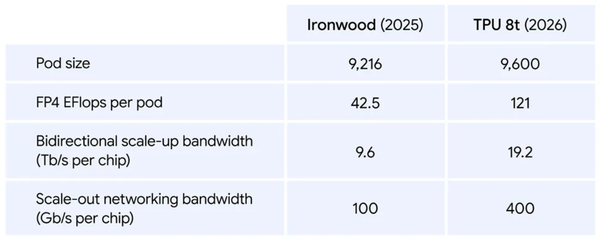

首先是直接提升了性能效率。新一代的TPU 8t在相同价格下效能较上一代提升2.8倍,每瓦性能提高124%;而TPU 8i效能也提高了80%,同样实现了117%的能效比增长。这两款新芯片均集成了基于ARM架构的Axion CPU,并通过消除数据预处理延迟瓶颈来确保持续满载运行。

其次是带来了显著的成本效益优势。谷歌借助TPU极大地降低了大规模模型部署成本,使得Gemini等产品的使用费用降至极具竞争力水平。投资银行D.A. Davidson估计,谷歌的TPU业务加上DeepMind的价值约为9000亿美元,约占公司总市值4万亿美元的四分之一。

第三是自主构建软件生态系统的重大突破。“TorchTPU”计划由谷歌启动,并与Meta合作让TPU能够顺利运行PyTorch框架。第八代TPU现已支持JAX、PyTorch和Keras等主流机器学习库,开发者可以无缝迁移模型而无需修改代码。

从宏观角度来看,专业化算力正在重新定义云服务市场的基本逻辑。据TrendForce指出,企业越来越倾向于采用ASIC基础设施来确保AI应用的适用性和数据中心建设的成本效益。能够全面掌控从芯片设计到软件框架以及训练推理全流程的企业,在未来的AI竞赛中将具备长期的核心竞争优势。

总结

英伟达凭借CUDA生态系统和通用GPU确立了一个时代的计算话语权,但随着AI工作负载的分化,这一格局正在被打破。如今,推理不再只是训练任务的一个附属部分,而是独立成为主要的算力需求源,这对芯片架构提出了全新的要求。因此,科技巨头们已经无法承受只依赖单一供应商的风险,并开始转向自主研发以降低成本和分散风险。

在这场计算资源重构的大潮中,凭借十年来的技术积累以及第八代芯片的战略转变,谷歌正在从一个简单的使用者转变为定义者。可以预见,在未来的AI时代里,专业化算力不仅将成为谷歌的选择,更会成为所有大型科技企业的标准配置。