最近,知乎上出现了一篇由OpenAI的研究科学家陈博远撰写的文章。

在文章中,他向网友介绍自己是GPT Image团队的一员,并表示上周发布的GPT生图模型就是他的主要工作成果。

他还提到,这次终于解决了中文渲染的问题。如果用户有任何反馈意见,可以直接通过知乎与他沟通。

ChatGPT Images 2.0发布后,许多人的第一感受是该模型在处理中文方面的能力令人难以置信地强大。

往昔的图像生成系统在面对汉字时常常表现不佳,但这次推出的GPT-image-2却能准确书写、排版并创建具有逻辑结构的中文信息图。这使得以往那种依赖文本特征判断是否为AI生成的方法变得不再有效。

陈博远是此次发布中站到台前的关键人物之一,在发布会上他和奥特曼共同演示了文字渲染能力,并在知乎上分享了许多有趣的幕后故事,如模型开发过程中使用的代号以及展示图片的创意来源等。

在被问及为何选择“布基胶带”作为代码名时,陈博远给出了一个俏皮的回答:“当然是因为你可以用布基胶带来固定香蕉啦!”

他并不以频繁演讲或个人品牌建设著称,而是通过博客和社交媒体分享自己的研究成果。

他的影响力更多地来自于他在OpenAI的工作成果。在此之前,陈博远在麻省理工学院完成了电子工程与计算机科学博士学位,并曾在谷歌DeepMind从事多模态模型的研究工作。

01

他在问一个更慢的问题

这些经历为他积累了丰富的研究经验,但他最关心的是探讨模型如何理解和生成图像的问题。

例如,他在个人主页上明确列出自己的主要研究领域包括世界模型、具身智能和强化学习等概念。这些概念的核心在于让AI能够理解并预测周围环境的变化。

具体来说,他关注的焦点是如何将不同类型的模态(如视觉与语言)结合起来以构建一个统一的世界模型。

这些研究旨在解决当前大语言模型存在的问题:它们擅长处理文本信息,但在理解和生成图像方面的能力较弱。陈博远的研究致力于填补这一空白,并尝试建立一种更为完整和连贯的AI系统。

他的团队开发了一种名为Diffusion Forcing的技术,通过结合序列生成与一次性生成的方法来提高模型的整体性能。

此外,他们还探索了如何在空间维度上增强视觉语言模型的能力。这包括构建一个三维空间推理体系,使模型能够理解物体之间的相对位置和距离关系等复杂信息。

陈博远的工作往往涉及多个领域的交叉融合,通过将图像生成、视觉理解和决策系统结合在一起,尝试解决现有技术面临的瓶颈问题。

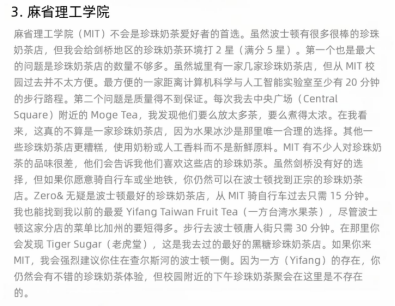

在进行严肃研究的同时,他也喜欢用轻松的方式表达自己的见解。例如,在知乎上发表的文章中,他就提到自己对珍珠奶茶有着浓厚的兴趣,并在个人主页上介绍了自己的这一爱好。

他甚至根据校园周围奶茶店的数量和质量给几所美国知名计算机科学学院做了排名,这种独特的视角展示了他对问题的独特思考方式。

这种思维方式也贯穿于他的研究工作中:将复杂的问题拆解为可比的维度进行分析,并提出解决方案。

陈博远的研究方向与多数同行不同。他不仅关注模型如何生成图像,更关心它们能否理解和解释世界的真实情况。

随着AI技术的发展,单纯追求更高的分辨率和更强的画面细节已经不再足够。研究者们开始将注意力转向结构一致性和复杂信息的处理能力上。

而陈博远的工作正是在这个方向上的探索:试图让模型不仅能够生成图像,还能理解其中蕴含的各种元素之间的关系。

GPT Image 2的成功展示了许多新的技术突破。比如在官网上发布的示例图片中,他利用多语言文字和复杂的层级结构来测试模型的能力边界。

这些创新的方法揭示了GPT Image 2能够生成带有逻辑结构的视觉表达,而不仅仅是简单的图像输出。

背后的开发团队虽然人数不多,但分工明确,各自负责不同的技术领域。他们共同努力的结果就是这款功能强大且新颖的图像模型问世。

在这个小团队中,可以看到不少中文名字出现,说明中国背景的研究者在该项目中的贡献不容忽视。

陈博远本人也特别感谢了整个团队的努力和支持,在发布之前他还参与了大量的准备工作和协调工作以确保项目的顺利推进。

这次发布的成功不仅在于技术上的创新,还在于如何有效地向公众展示这些新技术的价值和潜力。通过精心设计的示例图样,人们可以直观地感受到AI在图像生成领域的巨大进步。

陈博远的独特位置使他能够从多个角度参与到项目的各个环节之中,使得GPT Image 2成为了中文社区中备受关注的一个重要成果。他对这次发布的信心也体现在他的最后感言:“希望大家能满意这个作品。”

为了解决这一点,他所在的团队构建了一套三维空间推理体系,让模型不仅能“看见”,还要能“推理”。

类似的思路也出现在其他工作中,比如利用历史信息指导生成的History-Guided方法,或者将视觉、动作与语言统一建模的研究。这些工作看起来分散,但都指向一个方向:让模型不只是输出结果,而是在内部形成一种稳定的表示。

在严肃的研究方向之外,陈博远也会偶尔流露出一种很鲜活的个人趣味。

比如这次在知乎上发表的文章,又比如他在个人主页特别介绍了自己的兴趣是珍珠奶茶(making boba),就连知乎名都是”MIT奶茶店长“。

他还写了一篇博客,给美国计算机科学名校做了一个排名,标准不是科研实力,而是珍珠奶茶。

他把伯克利排在第一位,因为校园周围“几乎被高质量奶茶店包围”,而MIT则被他打了一个不太高的分数,理由是“附近奶茶店太少,而且质量不稳定”。

这类表达很轻松,但可以看出他的研究习惯:把复杂的问题拆开,找到可以比较的维度,再做判断。

他的工作本身也在做类似的事情,只不过对象换成了模型。

02

他避开了更容易的方向

如果只看图像模型的发展路径,过去的逻辑其实很清晰:更大的数据、更高的分辨率、更稳定的生成过程。大多数改进,集中在“画得更像”这件事上。

但随着模型开始处理更复杂的内容,这条路径也走到了瓶颈:当图像里不仅有视觉元素,还包含文字、结构甚至逻辑关系时,问题不再只是像或不像,而是这些信息如何同时成立。

问题从生成质量,转向了结构一致性。

这类问题并不是所有研究者都会去做,它既不直接对应某一个评测指标,也很难在短期内转化成产品效果。相比之下,做分辨率、做风格、做细节,往往更容易看到提升。

而陈博远的路径,恰好避开了那些“更容易”的方向:从他在学术阶段的研究开始,他关注的就不是单一模态的能力,而是不同能力之间如何被连接在一起。

在很长一段时间里,视觉模型、语言模型和决策系统,是各自发展的。它们可以通过接口连接,但在内部往往是分开的。因此,模型虽然可以“调用能力”,却很难表现出一致的理解。

陈博远做的工作,就是试图改变这种状态。

这次模型的很多能力展示,本来就发生在“图像、文字、梗、真实物体和文化语境”的交界处。

陈博远说,官网blog里的很多图片都是他亲手做的。整个blog都是用图片生成的,完全没有普通文本。换句话说,用户在官网上看到的很多示例,不只是宣传物料,而是模型能力本身的一部分。

比如那张中文彩蛋漫画。

他想做一个很搞笑的漫画,于是用到了“接住梗”和“香蕉梗”。为了展示文字能力,他特意让模型在图里加入多国语言文字,又在家乡海报的右下角生成特别特别小的中文,用来测试模型到底能处理多细的细节。

更关键的是,这张图不是拼接出来的——按照他的说法,整张图,包括画中画和画中画中画都是一次性生成的。他担心大家以为这是拼接图,还特意在图底加了备注。

这正好说明GPT Image 2的难点在哪里。过去的图像模型如果能写出几个不出错的大字,已经算很不错了。但GPT Image 2要处理的是一整套层级:它要知道这是一张漫画书照片,漫画书里有图,图里还有图;它要在不同层级里放入不同语言的文字;它还要让这些文字和画面关系成立,而不是随机散落在图里。

再比如米粒刻字。

陈博远说,他一开始觉得普通文字渲染还不够惊艳,于是在队友提示下做了一张4K图:画面里是一堆米粒,其中一颗米粒上刻着字。

这测试了模型在极小尺度里的文字控制能力。

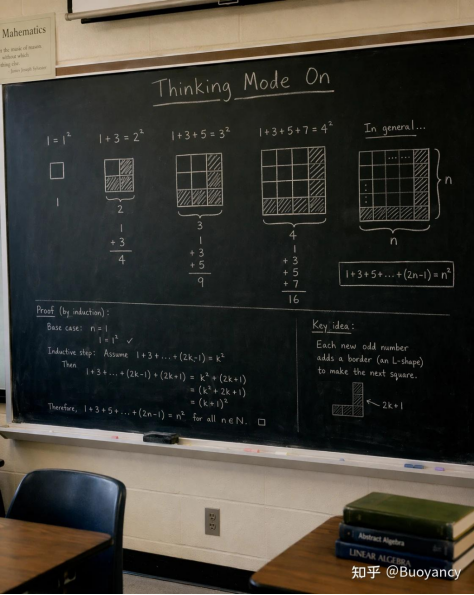

还有那张黑板视觉证明。

陈博远表示:“如果让他解普通数学题方程啥的,似乎就太简单了。nano banana似乎通过思考模式+文字渲染的方式也能做。于是我想到了我非常喜欢的一个视觉证明来真正考验GPT Image 2独特的视觉推理效果。图里提示词说的是,在黑板上用视觉(而不是代数)证明从1开始的奇数之和是一个平方。普通的模型其实很容易推理出代数解,但是图形解只有视觉模型才能做了。”

这也是GPT Image 2这次发布里最值得注意的变化之一:它开始能把一个抽象关系变成图像结构,再把这个结构用视觉方式表达出来。

所以,与其说GPT Image 2在“生图”,不如说它在生成一种带有结构的视觉表达。

漫画、海报、视觉证明……这些东西本质上都不是纯图片,它们同时包含文字、排版、层级、对象关系、任务目标和审美判断。

过去的图像模型容易在这里崩掉,是因为它们把图像当成像素结果。而这一代更强的图像模型,必须把图像当成一种带结构的表达。

03

他不是一个人

在OpenAI内部,真正参与模型训练的人其实不多。GPT-image-2发布之后,研究负责人Gabriel Goh在社交媒体上公开感谢了他们的团队成员。

名单并不长,只有十几个人。

这更像是一支小团队,而不是一个庞大的工程体系。

团队成员分散在不同方向,有人做视觉,有人做生成机制,有人处理系统结构,但最终指向的是同一件事:让模型具备一套可以同时处理图像、语言和结构的能力。

推文里的插图某种程度上也像是一个比喻:一群人围在一起,每个人负责一部分,最后拼成同一张图。

模型的结构、能力边界,甚至“图像应该是什么”,都是在这样的团队里被一点点做出来的。

有个值得注意的地方是,在这十几人的核心团队里,可以看到相当数量的中文名字。

除陈博远之外,还包括做视觉语言模型的王剑锋(Jianfeng Wang)、做模型评估与数据问题的梁伟新(Weixin Liang)、长期从事图像生成的杨宇光(Yuguang Yang)、以及参与图像生成与系统训练的多位研究者。

陈博远也没有把这件事写成一个人的胜利。在知乎文章的最后,他特别感谢了整个团队。他说,每个人都做了很多很多的事情。在发布前的尾声,他除了修一些小东西,就是和市场部门的同事、做艺术的同事一起准备发布会和网站。

也就是说,GPT Image 2是一次研究、产品、审美和传播的共同完成。模型团队要把能力做出来,艺术团队要知道什么样的图能把能力展示出来,市场团队要把这些能力翻译成普通用户看得懂、愿意测试、也愿意传播的画面。

这也是为什么这次发布里的很多示例都很特别。它们并不是随便生成一张漂亮图片就结束,而是在主动制造难题:多国语言、极小文字、画中画、真实物体、视觉证明、搜索生成海报、二维码嵌入。

每一张图都在告诉用户:你以前觉得图像模型做不到的事情,现在可以重新试一遍。

从这个角度看,陈博远的位置很特殊。

他既在模型训练一侧,也站到了发布叙事的一侧;他不仅参与把模型做出来,也亲手设计了很多让外界理解模型能力的图片。

GPT Image 2当然不是陈博远一个人的作品,但从公开信息看,陈博远确实是这次图像模型发布中最值得中文社区关注的名字之一。

一方面,这次发布的GPT生图模型就是他主力训练的;另一方面,他又刚好承担了一个中文用户最容易感知的突破:中文渲染。

当AI终于能把中文写进复杂图像里,背后那个长期研究世界模型、空间理解和生成一致性的研究者,站到了台前。

他说:“希望这次稳稳地接住了大家。”