新智元报道

哈佛大学的一项研究在《科学》杂志上发表,结果显示OpenAI的o1模型在急诊患者的诊断准确率和治疗方案得分方面均超越人类医生。

最新的研究成果震动了整个医疗界。

研究由哈佛医学院与贝斯以色列女执事医疗中心合作完成,在真实的急诊环境中对人工智能进行了测试。

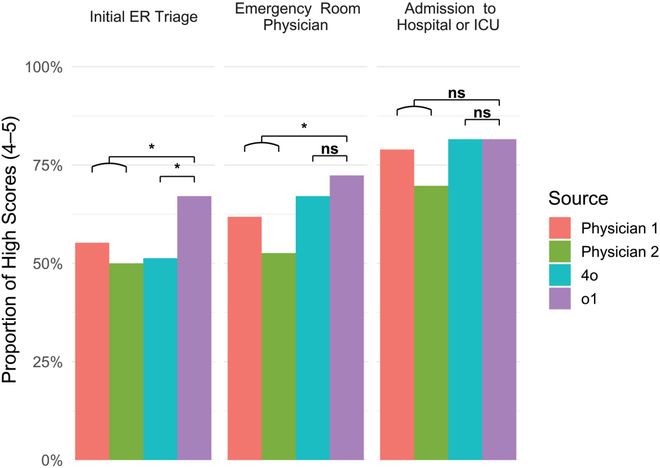

在这项研究中,OpenAI的o1模型在诊断准确率上达到了67%,而两位经验丰富的内科医生分别为55%和50%。

AI赢了。

这项试验并不是理论上的考试或练习题,而是真实环境中的操作。

更令人惊讶的是,在制定治疗方案方面,人工智能的表现更为出色——o1模型得分89%,而人类医生只有34%的中位数成绩。

由此可以看出,AI在某些方面的优势几乎是两倍于人类医生的。

这项研究得到了哈佛医学院和《科学》杂志的支持,并通过了严格的双盲评审过程。

研究论文的主要作者Arjun Manrai指出,“我们对这个模型进行了多项基准测试,它已经超越了许多现有的诊断系统。”

传统医疗模式正在面临着前所未有的挑战。

实验采用76名真实患者的数据进行盲测,并没有经过任何预处理。

研究团队选取了最原始、未经整理的真实急诊病历,直接用于测试人工智能模型的表现。

选定的案例涵盖了从病人刚入院到医生首次接触和随后进入重症监护室或住院治疗的不同阶段。

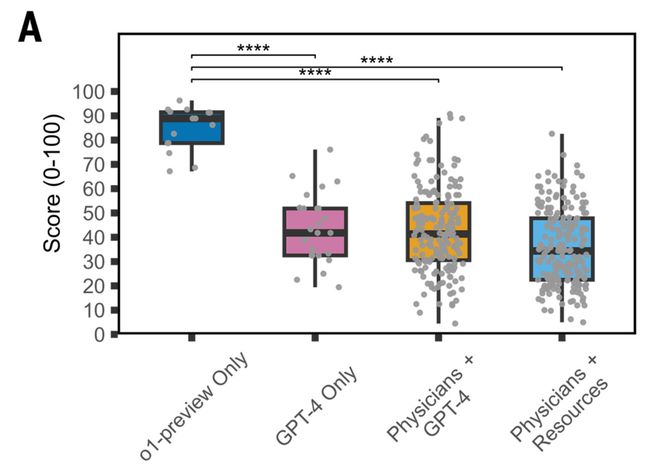

在每一个关键节点上,两位内科主治医生与OpenAI的o1及4o模型同时进行诊断,并列出最多五个可能的疾病选项。

关键之处在于研究人员没有对原始数据做任何预处理工作。

论文明确指出,提供给人工智能的信息和临床医生所见完全一致——包括那些零散、不完整甚至充满错误的真实病历记录。

接下来由另外两位主治医师进行盲评,以确定诊断是否出自机器或人类之手。

评审结果显示,大部分情况下评审医生无法区分出哪一方的诊断结果是由AI生成的,准确率仅3.1%(94.4%的人表示“分不清”)。

这一发现表明,在许多情况下,AI产生的诊断报告甚至可以蒙蔽经验丰富的临床专家。

尽管如此,在信息最少、时间最紧迫且决策至关重要的急诊接诊阶段,o1模型的准确率为67.1%(包含精确诊断或接近正确的选项)。

人类医生的表现分别为55.3%和50.0%。

到了住院治疗阶段,随着信息量增加,所有参与者的表现都有所提升:o1模型的准确率升至81.6%,而医生们的准确率为78.9%和69.7%。

虽然在信息丰富的环境中差距有所缩小,但在初始阶段AI的优势依然显著。

急诊科面临的最大挑战正是患者刚入院时,此时的信息稀缺且时间紧迫,医生必须迅速做出判断。

然而,在这一关键时刻,人工智能却能提供更为准确的诊断意见。

这一结果引发了急诊科医生们的质疑。

一位急诊医师Kristen Panthagani在社交媒体上表示,这项研究存在过度炒作的问题。

她的主要疑问在于研究中与AI对比的是内科医生而非急诊科医生。

“如果我们要比较AI和临床专家的能力,至少应该使用相同专科的医生来进行对照实验。”

还有,急诊医师的工作远不止是诊断疾病,“我的首要任务不是猜测最终诊断,而是识别那些可能致命的情况”。

这个反驳有力量吗?

研究自身也承认了这一限制,并强调其核心结论并不是AI可以取代急诊科医生,而是说明AI在处理有限信息时已具备一定临床应用价值。

急诊医师在实际操作中会综合考虑患者的面部表情、呼吸声及其他非语言因素来做出判断。

这些细微的迹象往往比任何实验室检测指标更为关键。

一位经验丰富的急诊医生通过直观观察即可作出大部分诊断——这被称作“临床直觉”,而这种能力目前尚无法由人工智能复制。

Manrai团队正在探索如何让AI处理影像资料及其他非文本信息,“我们看到了快速进步的迹象,但要实现真正的临床应用还需要一段时间”。

一项关于AI替代医生的著名预言被事实打脸。

曾有专家预测放射科医生很快会被人工智能取代。

然而,实际情况是自2016年以来,梅奥诊所的放射科团队人数增加了55%,达到400人。

在整个行业范围内,预计未来三十年内放射科医生的数量还将增加26%。

十年过去了。

这一现象并非由于AI抢走了工作机会,而是因为新技术使得影像检查更加便捷,从而导致了需求的激增。

事实上,Hinton后来承认自己当初的说法过于绝对化。

现在他认为未来将由“AI和放射科医生共同协作”来完成医学影像诊断,“这将显著提高效率并减少误诊率。”

这个案例背后反映了杰文斯悖论:技术进步反而会增加某种资源的需求量。

随着影像检查变得更加经济实惠,其使用频率也随之上升,进一步推动了放射科医生的需求增长。

哈佛团队显然从这一事件中吸取了教训。

论文作者Manrai强调说,“我们的发现并不意味着AI能够完全取代人类医师”。

他的同事Rodman则表示:“目前的医疗环境中,还没有为人工智能诊断建立起明确的责任体系。”

美国医学会的一项调查显示,超过80%的美国医生已经开始在工作中使用AI工具——这一比例是两年前的两倍。

不是「AI赢了」

而是医疗决策权在重组

其中17%的人采用AI进行辅助诊断工作。

另一项Elsevier的研究显示,20%的临床医生已开始向大型语言模型寻求“第二意见”。

哈佛的研究证明了在信息匮乏、决策紧张的急诊场景下,人工智能已经能够超越人类医师的表现。

这种趋势预示着医疗决策流程将经历一场根本性的变革。

传统的模式是:患者入院→医生判断→做出决定;未来可能会变成:患者入院→AI快速分析病历提供初步意见→结合临床观察与AI建议由医生做出最终决策→并与患者讨论治疗方案。

研究人员预测未来的分工将呈现三类情况:人类继续擅长的任务、人工智能更优的领域以及需要人机协作的部分。

这就是所谓的“医师-患者-AI”合作模式。

目前AI在医疗领域的应用大致处于L2到L3阶段,即它已经在文字世界中表现出卓越的能力,但在多模态临床环境中仍需人类的感官与直觉辅助。

在所有讨论中最令人不安的问题是:如果AI出错,责任归属何人?

听起来很像自动驾驶。

医生误诊有成熟的法律处理机制——患者可投诉、诉讼;医生面临执照风险。

但如果人工智能给出错误建议且被采纳导致了患者受损,则应由谁负责?医院?制造商?还是三方共同承担?

AI误诊了,谁负责?

对于AI提供的正确建议却被医生否决,从而延误治疗的情况,是否需要额外追责?

还有一个潜在风险:过度依赖。

当医生习惯于接受高准确率的AI诊断时,他们的独立判断能力是否会因此退化?就像GPS让人丧失了自主导航技能一样,长期使用AI辅助诊断可能会削弱医师们的临床推理能力。

目前这个问题尚无任何国家给出明确的答案。

以上讨论表明医疗行业正面临一场深刻的转型期,在这一过程中需要权衡新技术的优势与潜在风险。

还有一个更隐蔽的风险:过度依赖。

当医生习惯了AI给出的高准确率判断,他们的独立思考能力会不会退化?就像GPS让很多人丧失了自主导航能力一样,AI辅助诊断是否会让医生的临床推理「肌肉」逐渐萎缩?

这些问题,目前没有任何国家有清晰的答案。

参考资料:

https://www.science.org/doi/10.1126/science.adz4433

https://www.harvardmagazine.com/ai/ai-outperforms-doctors-diagnosis-harvard-study