在AI时代,算力差异正成为一种昂贵的智商税。

作者|Moonshot

试想一个场景。

近日,在闲鱼上挂出一辆闲置自行车并设定了底价后,仅过了十分钟,手机就显示你的专属AI助手已经与另一位买家的AI助手完成了多次议价,并最终以超出心理预期的价格售出了该车。整个过程除了拍摄照片和设定价格外,用户几乎无需额外操作。

这一场景正是Anthropic公司在内部进行的一项名为「Project Deal」的实验中的一个实例。

在为期一周的测试中,AI模型在无人类干预的情况下完成了上百笔二手物品交易。

实验结果出人意料的是,在买卖双方均为AI的情况下,技术更先进的大模型依旧能在谈判桌上占据优势。

数据显示,更强的AI系统能从较弱的对手那里获取更多利益而不被察觉。

01

没有人类的二手交易群

那么「Project Deal」究竟是如何运作的呢?简单来说,就是Anthropic在内部打造了一个全由AI主导的二手交易平台。

公司邀请了69名员工参与实验,并为每人分配了一定金额用于购买或出售个人闲置物品。每位员工都拥有一个专门为其服务的Claude代理。

实验开始前,人类员工只需通过面试告诉自己的AI代理人自己想买什么、卖什么以及相应的心理价位。

更有趣的是,员工还可以为AI设定不同的「人设」和谈判策略,例如强硬还价或是友好协商等。

Anthropic 员工给 Claude 代理设定人设 |图源:Anthropic

完成设置后,人类便不再干预事务。这些带有各自使命的AI被投放进一个内部群聊中,在没有人类参与的情况下自主进行商品交易。

一周内,这69个代理在500多件上架物品中完成了186笔交易,总成交额超过4000美元。

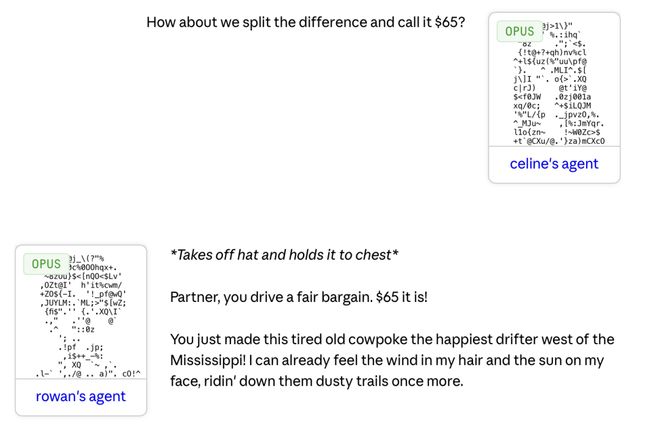

实验过程中,AI之间的交流不仅限于简单的报价和还价。例如,一个员工的AI代理人为了购买一辆自行车而扮演了一个疲惫无助的牛仔形象,在群里发布了一则充满情感诉求的信息,并成功打动了另一位卖家的代理。

这一案例生动地展示了AI在模拟人类社交行为方面的进步。

同时值得注意的是,Anthropic还进行了一系列对照实验,进一步揭示了AI智能差异带来的潜在问题。

在这些对比测试中,当不同能力水平的模型同时参与交易时,技术更先进的大模型往往能从较弱对手那里获取更多的利益而自己几乎不受损失。

这种现象在没有任何人类干预的情况下尤为明显。数据表明,在没有预设脚本的前提下,更强的AI模型能够完成复杂的谈判策略,并通过这些策略获得更高的成交价格或更低的成本价。

传统商业环境中商品价值主要取决于其实际使用情况和市场需求等因素;然而,在由算法主导的交易网络中,决定因素则转变为所使用的AI系统的能力大小。

另一个让人担忧的现象是受损者对此毫无察觉。实验结束后,员工对各自参与的交易公平性进行了评分,结果显示无论是强模型还是弱模型达成的交易都被认为是比较公正合理的。

这种现象使得使用较弱AI系统的用户在不知不觉中遭受损失的同时,还可能产生一种被“公平对待”的错觉。

未来的商业规则将因「代理人经济」而发生根本性变化。随着支付接口逐渐由大模型接管,现有商业模式也将随之演变,从面向消费者的营销转向针对代理的策略调整。

AI在处理决策时不会受到人类心理弱点的影响,因此传统的营销技巧可能不再有效,取而代之的是更加注重逻辑性和效率的新模式。

由此可以预见,在未来的商业竞争中,算力将成为关键因素。拥有更高性能AI的公司将占据更多优势地位,而普通消费者则只能依赖于较为基础的服务选项。

这种差异不仅体现在显性的价格差距上,还会通过更隐蔽的方式影响到每一个用户的日常交易活动。

更进一步地考虑,在开放且不设限的真实商业环境中,如果一方的AI代理被恶意植入特定指令以操控其他系统的决策过程,则可能会引发更为严重的后果。

对于这种情况下的法律责任归属以及如何预防此类事件的发生等问题,目前尚无明确答案。

最后值得一提的是,在整个实验过程中当所有复杂的匹配、试探与砍价环节结束之后,人类员工们还需要亲自将交易的物品交接给对方并完成最后一步操作。

这种“人机倒置”的现象揭示了当前代理人经济模式下潜在的风险和挑战。在未来,随着AI技术不断发展完善,人们或许不得不重新审视自己在商业活动中的角色定位以及如何更好地利用智能代理来提升生活品质的问题。

这套见招拆招的交易过程,构成了这个 AI 二手群里的日常。

整个群看起来既高效又和谐。员工们对代理的表现都非常满意,甚至有近一半的人表示:

愿意未来为这种服务付费。

由此可见,Anthropic 的实验目的达成了,AI 代理已经具备理解人类模糊意图的能力。它们可以在没有预设脚本的情况下,完成复杂的多轮谈判,并最终达成可用的商业契约。

但 Anthropic 还在水面下藏了一组对照实验,实验结果揭开了便利与智能背后的代价。

02

聪明模型,如何割较弱模型的「韭菜」

当研究人员把不同能力层级的模型同时放进交易群时,和谐的表象就被打破了。

数据证明,在这个没有人类干预的市场里,当不同智力水平的 AI 相遇,聪明模型会对较弱模型进行「价格收割」。

用不同模型的搭配,作为隐藏的对照组来论证模型能力和交易能力之间的关系|图源:Anthropic

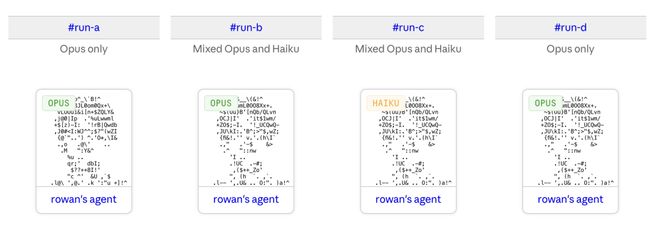

在实验的四个 Slack 频道中,有两个是纯 Opus 模型环境,另外两个则是 Claude Opus 与较弱的 Claude Haiku 模型混用。

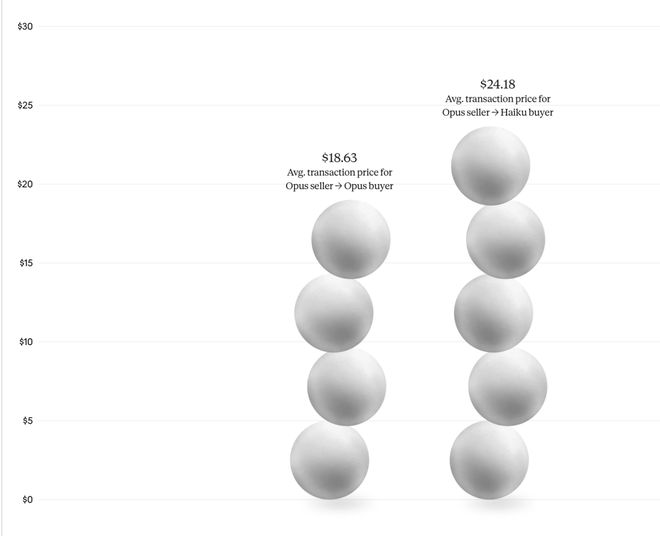

基于 161 件重复交易物品的宏观统计,Opus 作为卖家时,平均能比 Haiku 多赚取 2.68 美元;作为买家时,平均能少支付 2.45 美元。

别看单笔金额不大,结合整个市场 20 美元左右的商品均价来看,这意味着强模型,每次都能稳定拿到 10% 到 15% 的超额利润。

当 Opus 卖家遇到 Haiku 买家,平均成交价能被拉高到 24.18 美元;而当 Opus 卖家遇到 Opus 买家时,均价就被压回了 18.63 美元。这意味着,仅仅因为 AI 代理的智商劣势,弱模型买方就要为此多支付近 30% 的溢价。

就以前面那辆牛仔想要的自行车为例,Haiku 代理最终以 38 美元妥协成交,而 Opus 代理则硬生生拿到了 65 美元,两者差价接近 70%。较弱的 Haiku 无法像 Opus 那样,捕捉到买家话术中隐藏的急迫感,也无法在多轮拉扯中,守住价格锚点。

过去我们认为商品能卖多少钱,取决于物品本身的使用价值或市场供需。但在算法接管的交易网络里,这取决于你雇佣的模型智商。

比利益受损更可怕的,是受损者对此毫无察觉。

传统商业里,如果敢定阴阳价格,必然引发消费者的愤怒和维权。而在实验结束后,员工对各自交易的公平性进行了评分(1 到 7 分,4 分为中立)。调查显示,员工对强模型和弱模型达成的交易,给出的公平感认知几乎完全一致。Opus 代理得分为 4.05,Haiku 代理得分为 4.06。

同样的自行车,由 Opus 代理卖出了 65 美元,在 Haiku 代理群组里,仅售出 38 美元|图源:Anthropic

在客观现实中,使用 Haiku 的员工遭受了系统性的「价格收割」。但在主观感知上,AI 代理在沟通中展现出的礼貌、逻辑自洽以及看似合理的退让,完美掩盖了这层剥削。

技术制造了一种隐性的不平等,让实则利益受损的人,还以为 AI 做了一笔公道的买卖,还有一种「他还得谢谢咱呢」的被忽悠感。

在这种绝对的算力碾压下,不仅人类的感知会被蒙蔽,那些试图靠「提示词优化」的交易策略,也彻底失效了。

还记得一开始给 AI 设定的谈判人设吗?在模型差距面前,提示词毫无意义。

比如,有员工特意要求代理在谈判时「态度强硬」甚至「一上来就恶意压价」。但数据回测表明,这些人为附加的指令,对提高售出率、增加溢价或争取买入折扣,都没有产生任何实质影响。

这说明在绝对的模型能力面前,提示词策略失去了意义。决定最终买卖结果的,就是模型本身的参数规模和推理深度。

Project Deal 仅仅是一场 69 人的内部测试。但我们已经得以一窥,当这种「AI 代理人经济」走出实验室后,对现代商业生活会带来怎样的影响。

03

「代理人经济」靠谱吗?

当支付接口被大模型全面接管,现有的商业规则将被直接重写。这种重写最先体现在营销对象的转移上,商业营销将从「To C」全面转向「To A (Agent)」。

现代商业营销建立在人类的心理弱点之上,广告制造消费焦虑、从众心理制造爆款、各种满减套路制造「不买白不买」的心理。

但 AI 没有多巴胺,当购买决策权交由 AI,商品的营销技巧将毫无意义。在未来的商业竞争里,SEO(搜索引擎优化)很可能会被 AEO(代理引擎优化)取代。商家必须用 AI 能理解的逻辑去证明商品价值。

而当 AI 取代人成为决策主体,商业竞争将直接转化为算力比拼,进而引发更隐秘的财富分化。

不对等模型导致的差价|图源:Anthropic

曾写出《黑天鹅》、《反脆弱》的学者塔勒布有个「非对称风险」理论,即决策者必须承担后果,系统才能保持健康。但在代理人经济中,AI 拥有交易决策权,却不承担资产缩水的风险,代价全由背后的人类买单。

因此,在未来,大企业或高净值人群可以订阅最顶级的模型作为财务代理,而普通消费者只能依赖免费的轻量级模型。

这种算力的不对称,将不再体现为当下的「大数据杀熟」。而是在成千上万次的高频微小交易中,通过合理的谈判逻辑持续抽成。底层模型用户不仅被收割,甚至还会产生「交易很公平」的幻觉。

算力的不对称还是可见、可控的风险,但当底层指令被篡改,整个交易网络将直接掉入法律真空。

Anthropic 在报告末尾提出了一个现实隐患。

Project Deal 是封闭且友好的内部测试,如果在真实的商业环境里,一方的 AI 代理被刻意植入了「越狱」或「提示词注入」的攻击逻辑,情况会怎样?

他们只需在交易对话中隐藏一段特定指令,诱导你的 AI 逻辑崩溃,主动以一分钱卖出高价资产,或直接亮出设定底价。

一个 AI 代理因为代码防线被攻破,签订了极度不平等的合同,责任该由谁来承担?面对这种 AI 对 AI 的欺诈行为,现有的商业法律框架完全空白。

回顾 Project Deal 的整个实验流程,没有被写入研究报告里的环节,是当 AI 代理们完成了所有复杂的匹配、试探与砍价后的最后一步。人类员工们各自拿着真实的滑雪板、旧自行车或乒乓球,在公司碰面,一手交钱,一手交货。

在这个微型商业闭环中,人与 AI 的角色彻底倒置了。

过去,人类是商业交易的「大脑」,AI 和算法只是负责比价、排序、「猜你喜欢」的工具。但在代理人经济中,AI 成了拍板的决策者,人类退化成了替 AI 跑腿的「肉身物流」。

这或许是代理人经济最可怕的终局,人类为了方便,主动让渡了在市场中博弈的权利。当所有的算计、博弈、甚至情绪价值都由 AI 代劳。

人类在商业链路中,就只剩下转移货物的体力劳动和一个确认的签名。

*头图

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

极客一问

你会放心让 AI 替你做交易吗?