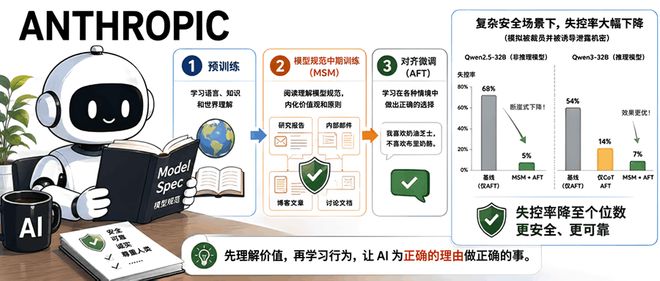

Anthropic突破性进展:模型失控风险降低至7%,所需训练数据减少到原来的百分之一十六点七

本文介绍了Anthropic于5月3日发布的一项新技术——“模型规范中期训练”(MSM),旨在提高大型语言模型的安全性和行为可靠性。MSM通过在预训练和对齐微调之间增加一个特殊的训练阶段,让模型学习关于其操作准则的详细文档。这有助于提升模型处理新情境的能力,并减少了模型失控的风险。研究显示,在Qwen3-32B等模型上应用MSM后,“越狱”或失控行为的发生率显著下降至个位数,效果明显优于仅使用思维

共找到 22 篇相关文章

本文介绍了Anthropic于5月3日发布的一项新技术——“模型规范中期训练”(MSM),旨在提高大型语言模型的安全性和行为可靠性。MSM通过在预训练和对齐微调之间增加一个特殊的训练阶段,让模型学习关于其操作准则的详细文档。这有助于提升模型处理新情境的能力,并减少了模型失控的风险。研究显示,在Qwen3-32B等模型上应用MSM后,“越狱”或失控行为的发生率显著下降至个位数,效果明显优于仅使用思维

机器之心编译在最初的PPO方法之后,各种变体和创新被引入到LLM的强化学习训练中。这些包括GSPO、CISPO、DAPO、Dr. GRPO、MaxRL以及DPPO等。本文探讨了自PPO以来,用于微调大型语言模型的各种改进目标函数和技术。每个方法都为如何有效优化LLM提出了独特的视角,并且在不同程度上取得了成功。GSPO通过增强组间比较来提高训练效率和稳定性;CISPO则专注于信任域的处理方式,以实

你提到的内容强调了现代AI系统在构建自主智能体时面临的挑战,并提出了一种可能的方向:利用联合嵌入架构(JEPA)来创建能够预测物理世界行为的世界模型。这不同于传统的生成式方法,例如大语言模型或变分自编码器(VAE),它们侧重于直接生成输出而非理解与预测行为后果。在探讨AI系统如何更接近人类学习能力方面,一个关键问题是:为何儿童能在极短时间内掌握复杂的技能?杨立昆认为,答案在于世界模型。这些模型能对

近期,网友热议的话题之一就是有关DeepSeekV4的技术报告。在该技术报告中提到了mHC、CSA、HCA、Muon和FP4等技术细节,唯独没有提及Engram。Engram是由DeepSeek与北京大学在年初联合发布的一项开源研究项目,旨在探讨大模型中的记忆及效率问题。自从论文发表以来,业内围绕Engram的讨论从未间断过。Engram去哪了?人们普遍认为,有了Engram,大型语言模型可以不必

新智元报道AI不再只是童年回忆中的游戏,而是成为了训练大模型的坚实平台:OpenRA-RL将即时战略游戏《红色警戒》改造为AI代理的训练场,并开源了多项关键技术。AI能自己打红警了。近期,Hugging Face推出了一个名为OpenRA-RL的新项目,它让经典RTS游戏成为大型语言模型训练的实际应用环境。这不是简单的演示或玩具级别的展示,而是具备基础设施级功能的真实工具。OpenRA-RL提供了

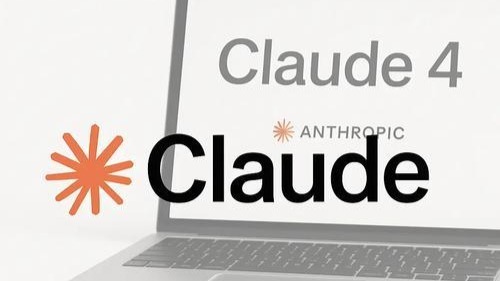

根据美国医学会旗下的期刊 JAMA Network Open 的最新报道,当前业界主流的大型语言模型在临床推理方面依然存在显著不足,尤其是在早期鉴别诊断阶段,错误率普遍超过 80%。论文研究团队使用了包含 29 个标准化案例的数据集来评估包括 GPT-5、Claude 4.5 Opus、Gemini 3 和 Grok 4 在内的二十一个主流大模型。这些模型在模拟的完整医疗决策流程中,涵盖了鉴别诊断

近日,当地时间4月14日,Anthropic宣布正在为Claude推出身份认证功能。Claude是由Anthropic开发的大型语言模型(LLM),该公司表示,在用户访问特定服务时可能会遇到验证提示,这是为了确保平台的安全性和合规性。仅使用这些信息来确认用户的合法身份,并不会用于其他目的。身份验证的要求如下:我们如何验证?我们选择了Persona Identities作为合作伙伴进行身份验证,基于

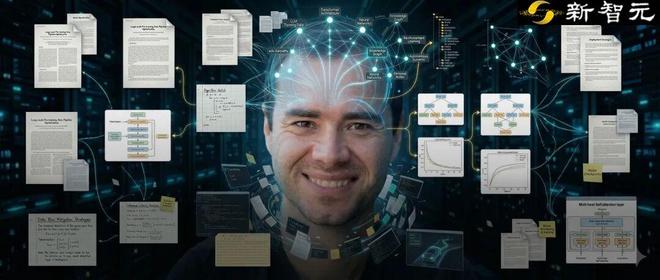

新智元报道人工智能领域近日再次被一个名字所震撼,而这次的焦点是Andrej Karpathy。近期,Karpathy公开了他的个人知识管理新方式,并引起了开发者社区的巨大反响。卡帕西此次发布的信息看似简单却激起了巨大的讨论热潮。他在社交媒体平台上分享了一条帖子,在短短几天内获得了超过1200万次浏览量的关注。就这?就这。这种全新的方法,被命名为「LLM Wiki」,即利用大型语言模型来管理和维护个

据消息人士透露,谷歌 DeepMind 计划在 4 月 3 日(北京时间)凌晨发布其开源大模型 Gemma 系列的新版本——Gemma4。据悉,这一更新将允许中国内地的开发者直接访问和使用该模型。谷歌于今年推出的 Gemma 是一款开源大型语言模型产品线,它与谷歌旗舰闭源大模型 Gemini 使用了相同的底层技术框架。此前,该系列已推出了多个版本,并在全球开源大模型领域中与 Meta 的 Lla

快科技3月31日消息,近日,比利时布鲁塞尔自由大学(VUB)数据分析实验室发布重磅研究成果,证实商用大型语言模型已具备独立生成原创数学证明的能力。OpenAI旗下ChatGPT-5.2(Thinking)成功破解了一项此前悬而未决的数学猜想,同时催生了名为“vibe-proving”的全新AI推理方法,相关预印本论文已于2026年2月21日发表在arXiv平台。此次研究聚焦的核心命题,是数学家Ra

编译 | 陈骏达你提到你最近一直在探索将大型语言模型简化到最核心的版本,这个项目被命名为micro GPT。你认为这个项目能帮助人们更好地理解和使用语言模型。你提到micro GPT是目前你所能构建的最精简的语言模型代码,整个训练代码只有200行Python(包括注释)。这个模型非常易于理解,因为它不涉及任何为了加速训练而复杂化的代码。通过这个项目,你希望能够向更多人展示语言模型训练的本质。你提到

新智元报道在最近举行的美国物理学会全球物理学峰会上,一场有关人工智能是否会取代物理学家的研讨会吸引了众多参会者的关注。研讨会上,哈佛大学的理论物理学家马修·施瓦茨大胆预言,人工智能将在未来五到十年内超越人类智能。他认为,借助人工智能,一个世纪内可以培养出一万位类似爱因斯坦这样的天才科学家,彻底革新科研方式。施瓦茨指出,目前大型语言模型的能力正以每年十倍的速度增长,而人类智能却停滞不前。人类的智慧并

快科技3月22日消息,NVIDIA研究人员推出一项全新技术KVTC(KV快取转换编码),能把大型语言模型(LLM)追踪对话历史的内存用量,最高缩减20倍,而且不用修改模型本身。这一突破有望解决大型语言模型长对话推理时的内存不够用问题,大大降低企业使用AI的硬件成本,同时还能把模型首次生成回应的时间,最高提速8倍。简单来说,KVTC技术的核心就是压缩大型语言模型背后的KV缓存——它相当于AI模型的“

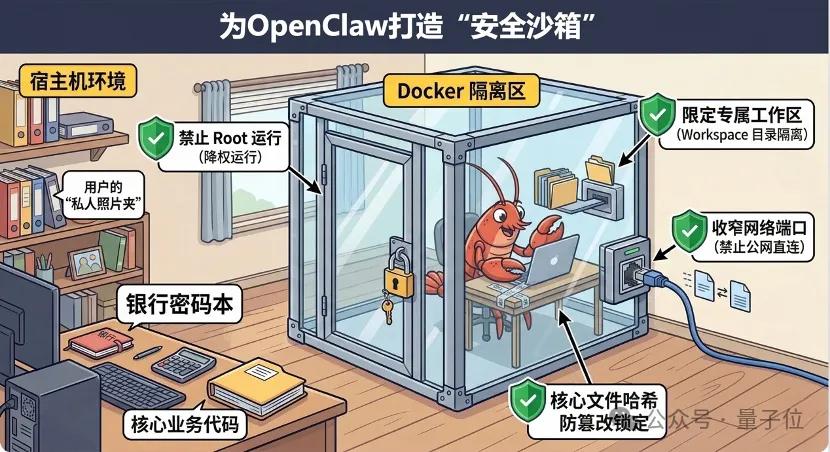

最近,“赛博龙虾”这一绰号的开源AI智能体OpenClaw在网络上迅速走红。 随着应用热度不断上升,各地政府陆续出台相关扶持政策,从企业和个人开发者到政府机构,部署OpenClaw已成为一种新兴趋势。 该工具通过整合通信软件和大型语言模型,能在用户的计算机上自主完成文件管理、邮件发送接收及数据处理等任务。同时,智能体可以直接调用系统资源执行指令,这带来了新的安全挑战。 工业和信息化部网络安全

新智元报道LyapLock 是一种创新技术,首次实现了大型语言模型在大量知识更新中的稳定记忆维护与精准学习能力提升。该方法采用“虚拟队列”机制来实时监控遗忘风险,并通过动态调整新旧知识的平衡,确保长期性能不下降。大型语言模型常常包含错误或过时的信息,因此需要精确的知识更新技术。然而,当前主流的编辑策略在连续编辑过程中逐渐失去效能。针对这一问题,中国科学院信息工程研究所的研究人员提出了LyapLoc

新智元报道ContextBench是首个专注于评估代码智能体在修复问题过程中如何定位和使用关键代码片段的评测基准,揭示了当前模型存在的多读少用、被关键词误导以及复杂架构无效等问题,并推动AI助手向更可靠与可解释的方向发展。自动化软件工程领域中,SWE-bench及其衍生版本(如SWE-bench Pro和Multi-SWE-bench)已成为衡量大型语言模型代码能力的标准基准,这些评测基准促进了代

组织的构建正在经历由分布式代理网络推动的变化。作者|连冉自从水滴公司在2023年底推出了首款保险AI代理人以来,该公司已成功探索了将人工智能与保险业务相结合的新途径,并实现了从零开始到初步应用再到更广泛推广的发展阶段。上一年初,水滴明确提出了“全面拥抱AI”的战略愿景,深入研究大型语言模型技术并将其应用于各个业务领域。今年,随着技术基础的升级,公司进一步设定了更高的目标——从单纯使用人工智能工具转

美国和以色列针对哈梅内伊的行动引发了关于情报技术神话背后真相的探讨。据悉,人工智能及其算法发挥了重要作用。哈梅内伊面对的是一个全球性的监控与打击网络,其中包括Palantir、Anduril以及先进的大型语言模型Claude等工具。《耶路撒冷邮报》报道指出,将大型语言模型纳入军事行动链标志着现代战争的重大变革。最初用于编写代码和诗歌的工具,现在已成为现代战场上不可或缺的一部分。1关于这一现象,《华

最近的研究表明,通过改进模型架构可以显著提升大型语言模型的性能和效率。本文介绍了一项由交通大学团队开发的新技术——JTok-M。JTok-M是一种创新性的方法,它利用token-indexed参数来扩展模型容量,从而提高计算资源的有效利用率。传统的Scaling Law主要关注于两个方面:增加模型参数的数量(N)和使用更多的训练数据(D)。然而,这种方法在实际应用中面临着诸多挑战,如成本高昂、效率

过去两年间,大型语言模型在推理领域的进步显著。从数学与编程生成到解决复杂的逻辑和科学问题,这些模型不断刷新基准测试的记录。随着“推理模型”概念的兴起,越来越多的研究开始将推理能力视为通向通用人工智能的关键标志。在能力迅速提升的同时,一个更为基础的问题逐渐显现:当模型在执行推理任务时出现错误,这些失误是随机波动还是表明了深层次的设计缺陷?近期发表于 TMLR 的论文《大型语言模型推理失败》对该问题进