近期,网友热议的话题之一就是有关DeepSeekV4的技术报告。

在该技术报告中提到了mHC、CSA、HCA、Muon和FP4等技术细节,唯独没有提及Engram。

Engram是由DeepSeek与北京大学在年初联合发布的一项开源研究项目,旨在探讨大模型中的记忆及效率问题。

自从论文发表以来,业内围绕Engram的讨论从未间断过。

Engram去哪了?

人们普遍认为,有了Engram,大型语言模型可以不必重新计算已知事实如“伦敦是英国首都”,而是可以直接检索这些信息,从而节省内存并释放深层网络容量用于更复杂的推理任务。

因此,自1月初论文发布以来,很多人都期待着DeepSeekV4会采用这项技术。

然而当V4版本公布后,人们却未能在论文中找到关于Engram的描述,这令不少网友感到失望甚至认为这是V4的一个缺陷。

尽管如此,Engram并没有被遗忘。接下来几个月内出现了几篇重要论文:

这些研究工作包括CXL内存池化版本、无冲突热层实验以及视觉领域的Tiny Engram等。

而这些后续应用已经悄然展开,为下一代模型奠定了基础。

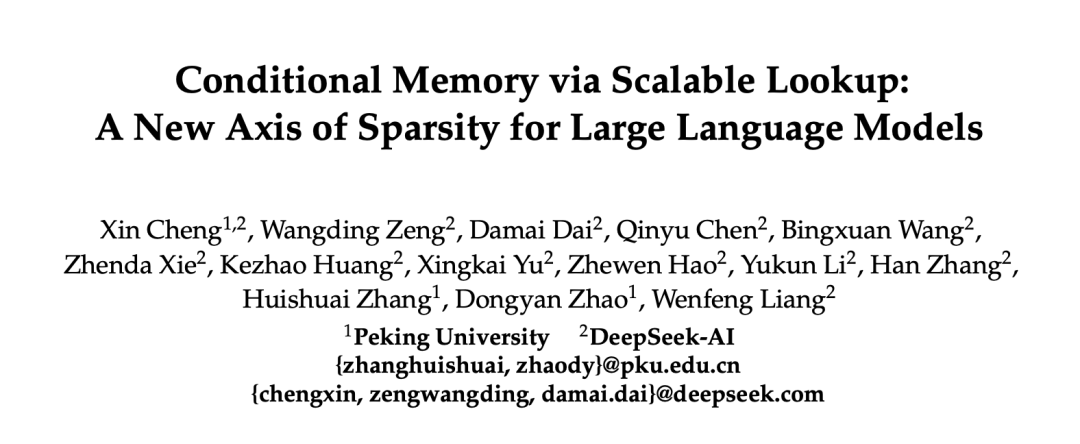

2026年1月12日,DeepSeek与北京大学发布了一篇名为《Conditional Memory via Scalable Lookup》的33页论文。第一作者是ChengXin,一名北大博士生;最后一位作者则是梁文锋教授。

Engram可以被视作向Transformer模型添加了一个原生的知识查表模块。

该团队发现语言建模中存在两种性质截然不同的任务:一种需要深度动态计算的组合推理,另一种则涉及检索静态知识。

在过去的实践中,Transformer将这两类任务混为一谈。当模型识别一个实体时,通常会消耗好几层注意力和前馈网络来逐层拼凑特征。

以“Diana,Princess of Wales”为例,模型需要经过六层才能完成该任务。

在处理这类问题时,经典的N-gram模型能够高效地捕捉局部依赖性。因此,Engram直接将这种能力集成到了Transformer架构中。

具体而言,就是在第2层和第15层之间插入了Engram模块。

每个位置的输入会触发一次哈希查找,并从一个巨大的嵌入表里直接取出对应的向量。门控机制确保查找到的内容与当前上下文不匹配时会被自动屏蔽。

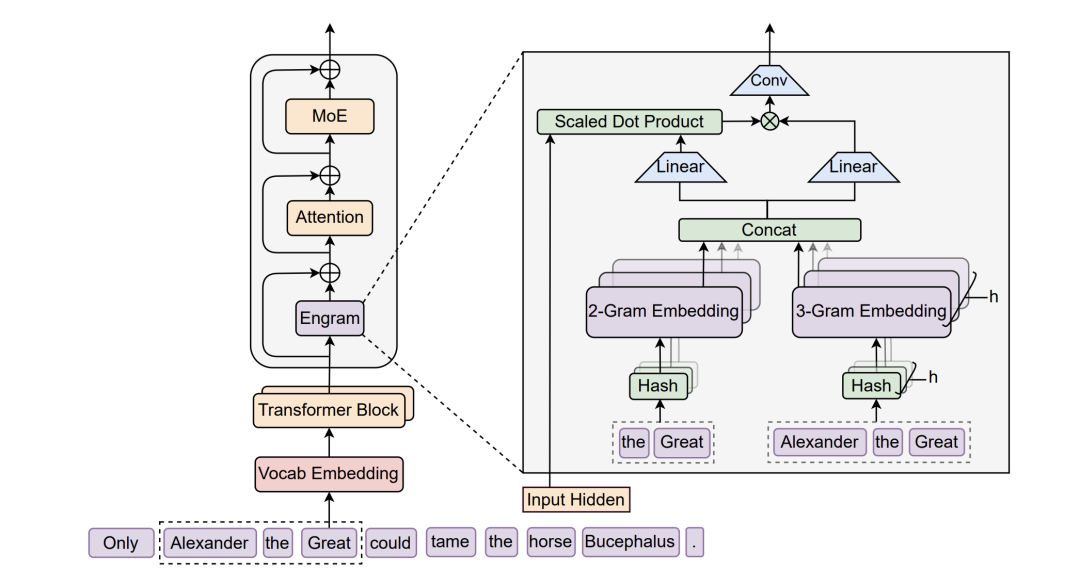

Engram被定位为除了MoE之外另一条稀疏轴,即存储稀疏化而非计算稀疏化。

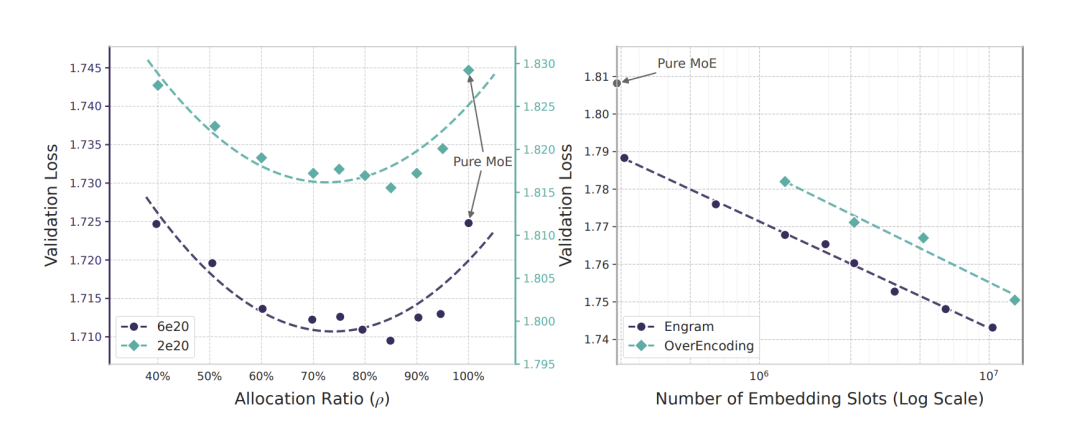

实验结果显示,在固定总参数和每token激活参数的情况下,将大约20%-25%的稀疏参数分配给Engram可以达到最佳效果。

使用此方法进行大规模验证后发现,知识密集型任务的表现符合预期;而通用推理和代码数学方面则超出预期。

这是由于Engram能够释放模型早期层用于更复杂的推理,并且其表征与MoE基线的深层网络相似。

工程实践中,论文提出将1000亿参数的Engram表完全卸载到host DRAM,在H800上运行时仅损失2.8%吞吐量。

通过确定性的Engram索引和CPU异步预取技术实现了这一目标。

即便DeepSeekV4没有采用Engram,其他研究团队仍然在多个领域推进了相关工作。

其中包括使用CXL内存池化解决多机部署的存储问题、对Engram多头哈希优化进行实证检验以及将Engram应用于视觉模态等。

这些进展为未来的研究提供了新的方向,也为下一代模型的发展奠定了基础。

Engram论文结尾处提出了一个观点:

条件记忆将是未来稀疏模型不可或缺的建模原语。或许下一代将被命名为V5或V4.1?

具体做法是,在Transformer的第2层和第15层之间各插入一个Engram模块。

每个位置的输入会触发一次哈希查找,把当前token和前面几个token组成的N-gram映射到一个巨大的嵌入表里,直接取出对应的向量。

门控机制保证查到的内容跟当前上下文不匹配时自动屏蔽。比如「张」是个常见姓氏,但「张仲景」三个字凑一起就是固定历史人物实体了,门控就负责认出这种区别。

Engram的定位是MoE之外的另一条稀疏轴。MoE是把计算稀疏化,只激活一部分专家。Engram是把存储稀疏化,只查一部分条目。两者互补,不冲突。

论文最核心的一段实验,是固定总参数和每token激活参数,然后让MoE专家和Engram记忆抢预算,得到一条U形曲线。

纯MoE不是最优解。把大约20%-25%的稀疏参数分给Engram,模型loss达到最低点。

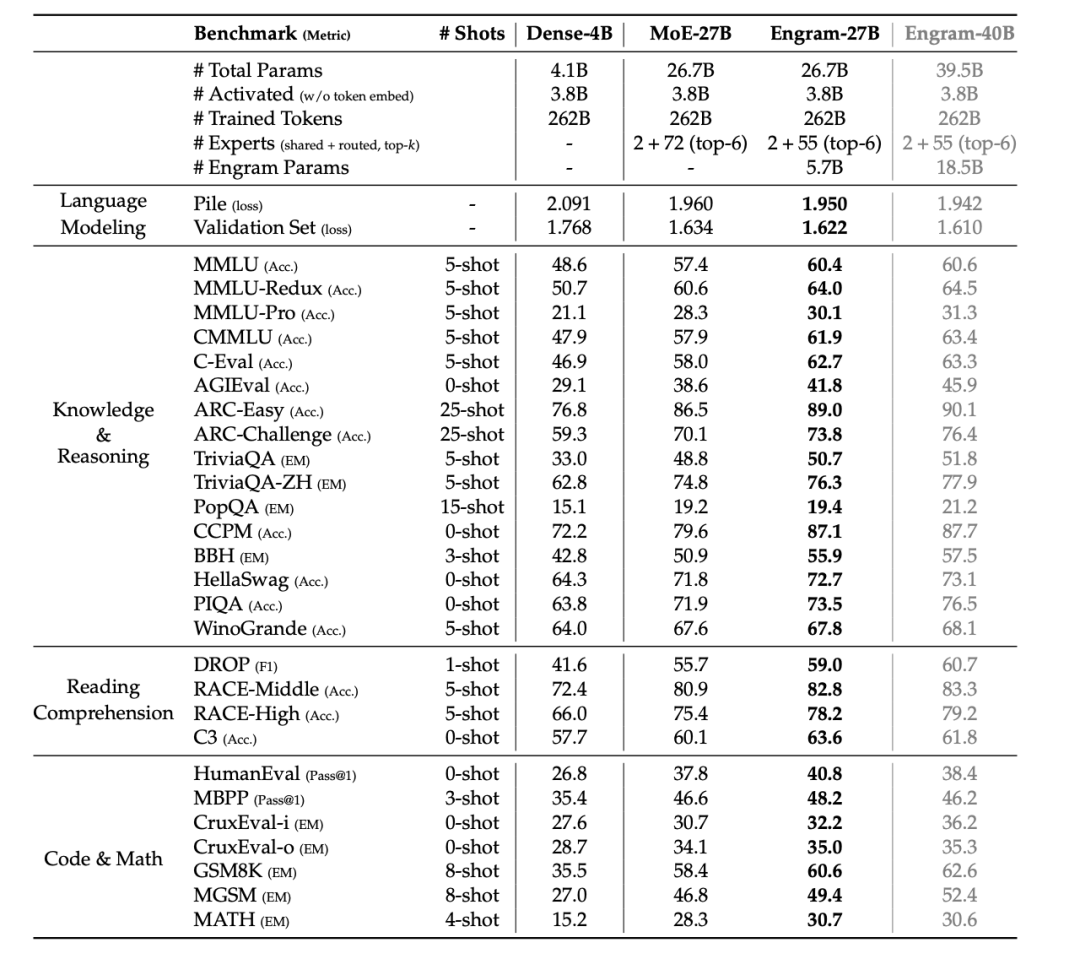

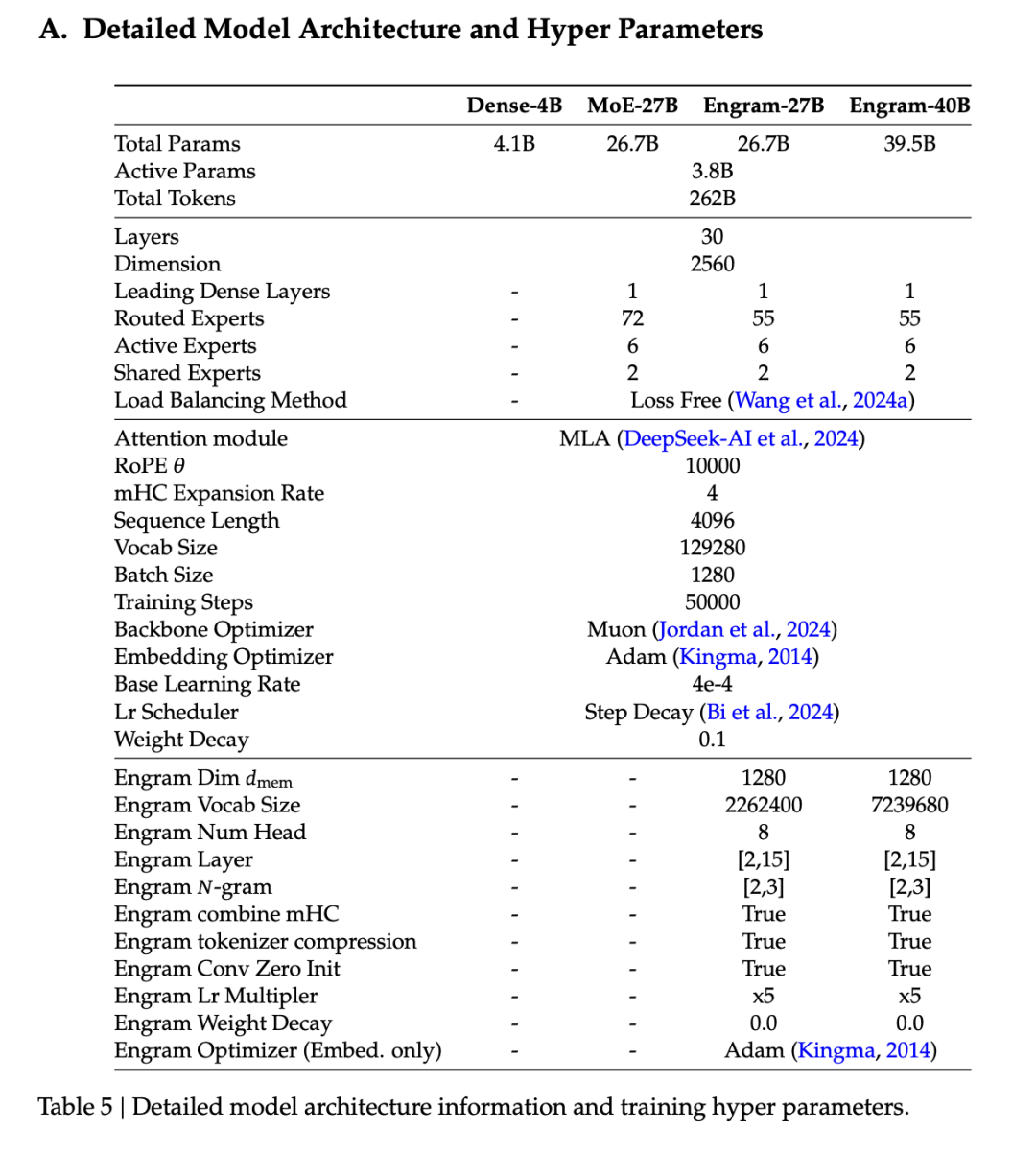

按这个曲线指导,团队把Engram扩到27B验证。激活参数3.8B,训练262B tokens,严格跟MoE-27B基线对齐。

结果知识密集型任务的提升符合预期(MMLU +3.4,CMMLU +4.0),但通用推理和代码数学的提升超出预期(BBH +5.0,ARC-Challenge +3.7,HumanEval +3.0,MATH +2.4),长上下文场景更夸张,Multi-Query NIAH从84.2%跃升到97.0%。

那么,为什么记忆模块还能反过来提升推理?

LogitLens和CKA给出了答案,Engram-27B第5层的表征,跟MoE基线第12层的表征最相似。

Engram把模型的早期层从「重建静态知识」这种苦力活里解放出来,这部分网络深度被腾出来做更复杂的推理。Engram不是新增了一块记忆,它还变相把网络加深了。

工程上。论文把一个1000亿参数的Engram表整个甩到host DRAM,在H800上跑推理,8B-Dense的吞吐损失只有2.8%。

靠的是Engram索引的确定性,只取决于输入token序列,完全可以提前算,CPU异步预取跟GPU计算重叠。

可以说,这个模块天生就不靠HBM,只可惜如今V4来了,Engram没来。

没在v4,但在其他地方

发明者把它放在那里没动,但路上还是有人。三个月里,至少出现了三个值得说一下的工作。

把Engram塞进CXL内存池

3月10日,北大、阿里云、山东英信、人大、港大联合发了一篇系统论文,《Pooling Engram Conditional Memory in Large Language Models using CXL》。

他们没改Engram本身,而是回答了一个更工程的问题,如果Engram真的成了下一代标配,内存放哪。

答案是CXL内存池化。GPU HBM放计算权重,本地DRAM做二级缓存,CXL池做三级。8台服务器共享4TB内存池,XConn XC50256交换芯片做拓扑,512GB/s带宽。

整套集成进SGLang,做了预取-计算重叠,跑下来端到端吞吐损失小于5%。Engram论文里那句「1000亿嵌入表卸载DRAM」的轻描淡写,被他们做成了27B和40B两个规模的真实测试。

结论很清楚,Engram这种确定性寻址、可预取的负载,几乎是为CXL量身定做的。

一个反直觉的实验

Engram论文上线第十一天,1月23日,一个叫TaoLin的研究者,单作者,放出了《A Collision-FreeHot-Tier Extension for Engram-Style Conditional Memory》。

他想验证一个看上去显然的优化,Engram用多头哈希查表会有冲突,如果把高频N-gram用Minimal Perfect Hash Function完全消除冲突,模型会不会更好。

他设计了Engram-Nine,把记忆分成无冲突的「热层」和保留多头哈希的「冷层」。

结果反直觉。在严格iso-parameter控制下,无冲突设计没有稳定提升验证loss。

route-stratified评估还发现,训练初期热路径(高频)loss更低,但训练后期冷路径反过来超过热路径。

一个看上去显然的优化方向,被一个真做实验的人证伪了。

把Engram推到视觉(AutoArk/TinyEngram)

GitHub上一个叫AutoArk的团队搞了Tiny Engram。

基于Qwen-3完整复现文本Engram之后,他们做了一件论文里没做的事,把Engram搬到Stable Diffusion上。

视觉patch经过分层编码,底层抓纹理,中层抓部件,高层抓风格,然后整套丢进哈希查表。

跟LoRA比下来,达到同等效果,Engram需要的额外参数只有LoRA的15%到30%。连续注入多个新概念时,LoRA会出现明显的概念退化,Engram不会。

Engram原本是为文本设计的。AutoArk等于把这扇门撞开了,凡是能离散化、能哈希的模态,Engram都能搬。

三个月里,Engram这条路上,发明者最沉默,跟进者各自走了一步。

一个团队替它解决多机内存层级,一个独立研究者证伪了它一个看似显然的优化方向,一个开源团队把它推到了视觉。

而deepseek-ai/Engram这个仓库,最后一次提交还停在1月14日。

One more thing

Engram论文的摘要结尾有一句话:

我们认为条件记忆将是下一代稀疏模型不可或缺的建模原语。

看来,这个下一代得是V5了,难不成会是V4.1?