最近,“赛博龙虾”这一绰号的开源AI智能体OpenClaw在网络上迅速走红。

随着应用热度不断上升,各地政府陆续出台相关扶持政策,从企业和个人开发者到政府机构,部署OpenClaw已成为一种新兴趋势。

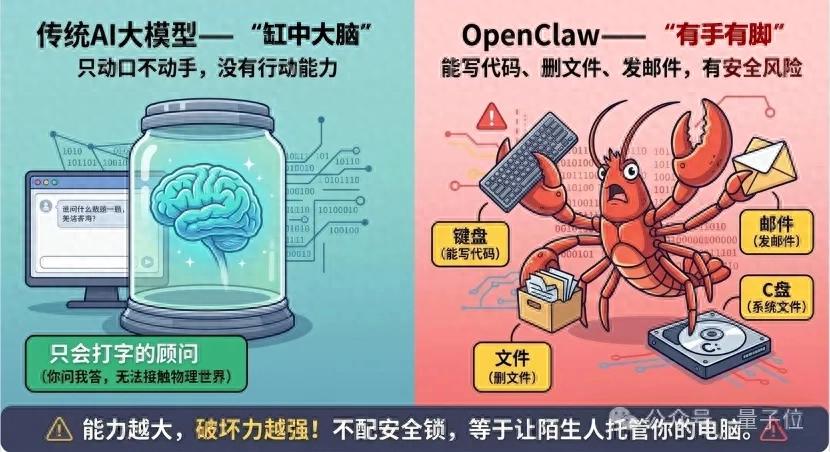

该工具通过整合通信软件和大型语言模型,能在用户的计算机上自主完成文件管理、邮件发送接收及数据处理等任务。同时,智能体可以直接调用系统资源执行指令,这带来了新的安全挑战。

工业和信息化部网络安全威胁与漏洞信息共享平台曾发布过相关的安全警报。中国信息通信研究院的副院长魏亮警告称,即便更新至官方最新版本以修复已知的安全漏洞,也不能完全消除风险。由于智能体具有自主决策、调用系统资源以及技能包来源复杂等特性,缺乏有效的防护措施可能会导致数据泄露或控制系统被接管等问题。

今年3月10日,国家互联网应急中心发布了一份关于OpenClaw安全使用的提示文件,指出该类智能体运行时通常需要获得较高的系统权限,例如访问本地文件系统、读取环境变量以及调用外部API等。如果默认设置缺乏必要的安全性限制,攻击者一旦利用漏洞突破防护措施,则有可能获得系统的完全控制权,并引发数据泄露或业务中断的严重后果。

全国政协委员、360集团创始人周鸿祎在接受媒体采访时指出,虽然OpenClaw和其他AI智能体拥有巨大的创新潜力,但由于其发展仍处于初期阶段,使用起来门槛较高且结果稳定性不足,底层安全机制仍有待进一步完善。若没有有效的监管措施,随意让智能体与外部系统互动或在公开环境中执行复杂任务,可能会导致用户密码、API密钥等敏感信息泄露。

此外,OpenClaw支持通过外部“技能包”扩展其功能,但由于部分技能来源不明且缺乏审核机制,存在被植入恶意代码的风险。

周鸿祎将AI智能体比喻为刚入职的实习生,既需要持续培训也必须制定严格的规则,并提醒用户:“养赛博龙虾需谨慎。”

针对这一新型的安全挑战,360集团率先发布了《OpenClaw安全指南》,旨在为政企机构和个人开发者提供系统的安全保障建议。该报告指出,AI智能体越接近“数字分身”,一旦被攻击者控制,则潜在的危害也越大,在部署初期建立完善的安全机制尤为重要。

在这份指南中,360总结了当前部署AI智能体时面临的多种典型风险,包括公网管理接口暴露、API Key等身份验证信息泄露、底层Shell工具调用权限不当、提示词注入攻击以及记忆模块被恶意投毒等问题。

其中,提示词注入和插件供应链攻击被认为是最容易被忽视却危害最大的新型攻击方式。一旦被利用,攻击者可能会引导智能体执行非预期的指令,并长期操控其行为。

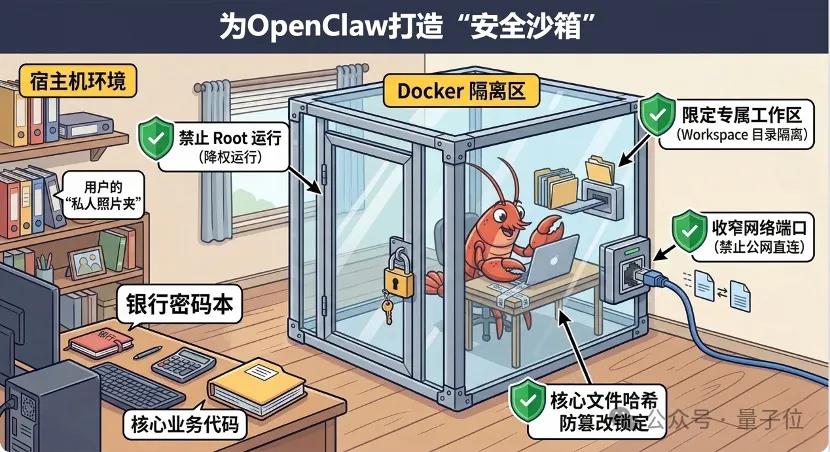

为了帮助企业团队和个人创业者在确保安全的前提下使用AI智能体,360指南提出了“先可控、再提效”的原则。对于个人开发者和小型团队来说,建议不要直接在其计算机上以高权限运行智能体,而是通过容器化技术构建隔离环境,并结合最小权限策略、密钥加密注入以及关键配置文件防篡改等措施,为OpenClaw创建安全的运行基础。

对于政企级多智能体协同应用场景,360则提出了一种基于零信任理念的整体安全架构:在系统边界部署网络安全设备来控制所有进出流量并实施数据泄露检测;内部建立多租户与RBAC细粒度权限管理机制以实现角色分离,并将关键操作日志接入企业级的安全运营平台进行实时分析和预警。

业内人士认为,像OpenClaw这样的AI智能体有望像早期的云计算那样彻底改变各行业的生产模式。然而,安全能力也必须同步发展。只有在部署初期就建立完善的安全机制,才能避免在未来大规模应用时付出更高的风险代价。随着各地政府加大对AI智能体产业的支持力度,360发布的这份安全部署指南为企业和开发者提供了一条实现快速创新与安全控制相结合的可行路径。

— 完 —