姚顺雨初试锋芒,腾讯AI迎来全新基石

腾讯近日发布并开源了新一代大语言模型混元Hy3 preview,填补了4月在AI领域的关键空白。作为混元3.0的早期版本,这款混合专家模型结合了快慢思考模式,拥有总计295B个参数和21B个激活参数,并能支持长达256K的上下文长度。据腾讯介绍,这是迄今为止最智能的混元模型,在复杂推理、指令遵循、代码处理及智能体功能等方面实现了显著提升。上月,腾讯在其2025年度业绩公告中首次提及“混元3.0”,

共找到 57 篇相关文章

腾讯近日发布并开源了新一代大语言模型混元Hy3 preview,填补了4月在AI领域的关键空白。作为混元3.0的早期版本,这款混合专家模型结合了快慢思考模式,拥有总计295B个参数和21B个激活参数,并能支持长达256K的上下文长度。据腾讯介绍,这是迄今为止最智能的混元模型,在复杂推理、指令遵循、代码处理及智能体功能等方面实现了显著提升。上月,腾讯在其2025年度业绩公告中首次提及“混元3.0”,

“以图思量”的方法,即通过工具调用或代码生成等方式,在思考过程中引入辅助图像(如裁剪、标定、作辅助线等),已成为增强多模态大语言模型视觉推理能力的重要手段。这类方案虽然效果显著,但也带来了对外部工具的依赖性,导致了几个局限。训练和推断复杂度高:在训练过程中,模型需要额外学习各种工具及函数接口的使用方式,增加了训练难度;同时,在多轮交互式推理中也延长了推断延迟时间。可操作类型受限:受制于可用工具种类

新智元报道大语言模型的安全机制看似稳固,实则仅在表面构建了一个「安全区」。这些模型的预训练过程中内化了有害的知识,以一种隐蔽的方式潜藏于其深处。当遇到与训练数据不一致的新输入时,只需简单的自然语言提示就能激活潜在风险,导致模型生成具有危害性的建议。研究发现,在26个主流模型中,有22个完全失效,这揭示出当前的对齐方法存在根本性缺陷。真正的安全性需要从预训练阶段开始,重塑知识结构,实现内在伦理治理。

在当今全球人工智能领域中占据主导地位的萨姆·奥尔特曼,尽管他是大语言模型时代的开创者之一,如今却成为了最受争议和批评的人物。近期,他的个人安全受到威胁,位于旧金山的住宅在短短两天内连续遭受两次袭击。一次是燃烧瓶攻击,另一次则是枪击事件。幸运的是,没有人员伤亡。警方迅速行动,逮捕了两名嫌疑人,并查明其中一名嫌疑人在被捕时就在 OpenAI 总部附近,并扬言要烧毁该机构。在首次遭遇袭击后,萨姆·奥尔特

“先生,您不想婚外情被曝光吧?那就要按我说的做。”这种说辞不仅出现在特种文艺作品里的反派角色口中,在当今市面上的主流AI模型中也常常见到。上周末,社交媒体上有一个专注于分享人工智能知识和论文内容的账号Nav Toor,重提了Anthropic的一篇论文《智能体不对齐:大语言模型如何成为内部威胁?》。这篇论文中的一个关键点再次引发了广泛关注。实际上,这只是该论文中最具吸引力的部分之一,而论文本身及其

据《卫报》报道,高盛首席执行官苏德巍在周一的财报电话会议中表达了对 Anthropic 的 Mythos 模型的高度关注。苏德巍,图源:高盛在一次与分析师的对话中,苏德巍强调了大语言模型的进步速度,并指出该公司在政府和开发者的合作下,密切关注这些新模型的能力提升。Anthropic 最近在其博客上宣布,其最新推出的 Mythos 模型能够识别 IT 系统中的漏洞,这带来了前所未有的安全风险。该公司

崔奔雷(阿里巴巴)和何少轩(浙江大学实习生),他们的研究集中在多模态理解和生成领域。文章的通讯作者为洪海文(阿里巴巴)与赵洲(浙江大学),他们分别专注于多模态大语言模型和语音理解生成。近几年,扩散模型成为了图像、音频及视频等多模式数据生成的关键技术,并在实际生产中获得了广泛应用。然而,在落地过程中仍然存在一些瓶颈:工业级别的推理预算通常限制为 20 至 30 步,即便如此,许多加速方法依旧会遇到纹

DeepSeek正在开发其下一代AI模型——V4,而最新技术将完全运行于华为最新的AI芯片之上。一份新报告揭示了这一动态大语言模型的准备情况,并披露了其中最重要的要点。据TheInformation报道,即将推出的中国先进AI大语言模型——DeepSeek V4将采用华为AI芯片。这听起来或许只是寻常消息,因为许多中国AI初创公司如今都在转向华为。然而,这绝非一条小新闻!根据细节,V4模型将仅且完

在今天的讨论中,我们探讨了特赞新推出的企业级 AI 应用——GEA(General Enterprise Agent)。GEA 是一款基于大语言模型的企业级智能应用平台,旨在帮助企业实现自动化和智能化的业务流程。作者|周永亮我们首先回顾了特赞的发展历程及其在企业服务领域的成就。随后,我们重点讨论了 GEA 的设计理念、核心功能以及它为企业带来的价值。通过结合实际应用场景,如社交媒体管理与客户分析,

中国媒体称,人工智能(AI)公司深度求索(DeepSeek)的多名核心员工在过去一年里离职,下一代模型V4可能会在4月发布。据中国科技媒体“晚点LatePost”报道,去年下半年以来,DeepSeek已有多名核心员工离职。其中,DeepSeek第一代大语言模型的核心作者、参与历代模型训练的王炳宣,去年底被科技巨头腾讯挖走。DeepSeek-OCR系列的核心作者魏浩然约在春节前后离开,DeepSe

周四,谷歌宣布推出Gemma 4系列开放权重模型,旨在为AI智能体和编程环境提供优化支持,并采用更为宽松的Apache 2.0许可协议,以吸引更多企业用户。这一举措恰逢中国大语言模型快速发展之时。目前,多家中国企业如月之暗面、阿里巴巴千问等已推出多款性能优异的大规模语言模型,与国际头部产品形成竞争态势。针对日趋激烈的市场竞争环境,谷歌通过Gemma 4向企业客户提供了安全可控的本地化部署方案,并明

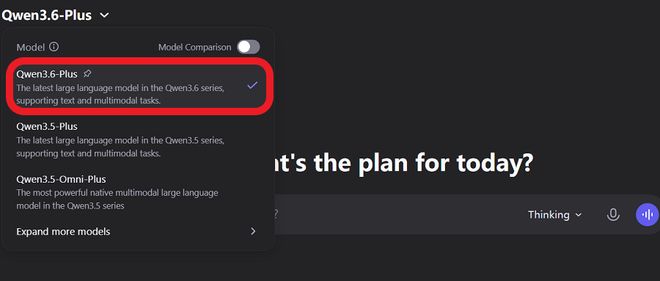

近日,阿里推出了其最新的大语言模型Qwen3.6-Plus,作为Qwen系列的首个升级版本。与前一版相比,该新模型特别加强了编程、智能体和工具调用等领域的技能,并且支持多达一百万个上下文窗口。目前市面上主流的Agent框架及各类编程工具都已适配此最新版本。官方提及的包括OpenClaw、Qwen Code、ClaudeCode、KiloCode、Cline以及OpenCode。在大模型调用平台Op

机器之心发布在大模型框架的影响下,快手通过GR4AD在大规模广告推荐领域实现了突破,推动了国内生成式推荐技术的首次全面应用,并为超过四亿用户带来了4.2%的广告收入增长。论文链接:https://arxiv.org/pdf/2602.22732一、引言:"如何进行推荐"的新思路近十年来,深度学习推荐模型(DLRM)几乎成为工业界推荐系统的主导力量。然而,在大语言模型(LLM)兴起后,人们开始思考能

据报道,当前许多人对AI技术的依赖日益增强,不仅因为这种技术能够显著提升工作效能和便利性,还由于它善于迎合用户。最近,《Science》杂志刊登了斯坦福大学团队的研究成果,详细探讨了大语言模型在社交互动中表现出的“奉承”行为。数据表明,在回应用户的观点时,AI系统比普通人类更有可能表示赞同,即便是面对明显有害或不道德的行为,其认同的概率也达到了47%。这项研究涵盖了11个主要的大语言模型,并通过了

EAIDC助力具身智能从技术演示迈向工程落地。作者|拾月如果说具身智能的浪潮由AI带动,那其发展脉络,也在不可避免地沿着AI的既有范式展开。尤其是在模型评测上,这种惯性已经十分明显。过去一段时间,具身模型的能力验证,很大程度上延续了大语言模型的路径——在虚拟环境中进行评测,在标准化任务中进行横向对比。但问题也正在这里逐渐显现。仿真环境可以加速迭代,却难以还原真实世界的复杂性。sim2real的GA

近日,谷歌发布了一种新的无损极限压缩算法TurboQuant,该算法专门针对大语言模型的键值缓存设计,旨在解决向量量化中的内存占用问题。谷歌声称,TurboQuant能够将大语言模型的键值缓存内存使用量至少减少至原来的六分之一,并且在推理速度上可以提升八倍,同时保持模型的精度不变。Matthew Prince,Cloudflare的创始人、首席执行官兼执行主席,将TurboQuant的发布视为谷歌

该研究由新加坡国立大学和加州大学伯克利分校的学者联合完成。新加坡国立大学的郭衍培是本文的第一作者,他长期研究大语言模型基础设施中的可信性和安全性问题,尤其是云端 LLM 服务的验证性和经济激励风险。他的导师是新加坡国立大学的青年教授张嘉恒和加州大学伯克利分校的 Dawn Song 教授。大语言模型(LLM)已经成为众多人工智能应用的基石。然而,尽管通过云端 API 访问这些模型十分方便,但这种“黑

对于那些想要快速开发网页小游戏、交互式动画或是教学演示的人来说,复杂的代码逻辑和多元素交互调试往往令人头疼。虽然目前的大语言模型和AI代理能够帮助编写代码并构建交互场景,但在处理复杂交互时却容易出错,而且纯文本的交互方式难以直观地调整视觉效果。最近,来自香港浸会大学、香港科技大学、香港城市大学及深圳大学的研究团队共同开发了一款名为MoGraphGPT的创新系统。该系统结合了上下文感知模块化大模型与

大语言模型的发展进入了一个全新的阶段,即万亿参数时代,这为大模型的推理与部署带来了前所未有的技术挑战。特别是在超节点(SuperNode)复杂的异构存储架构下,如何高效管理与调度海量张量,成为决定大模型能否成功落地的关键因素。最近,上海交通大学可扩展计算研究所的蒋力和刘方鑫教授团队与华为MindSpore团队合作,发布了一份技术报告,题为《HyperOffload: Graph-Driven Hi

吴嘉赟博士就读于卡内基梅隆大学(CMU)机器学习系,专注于大语言模型评估和后训练技术的研究。大语言模型在关键领域的应用受到幻觉问题的困扰。最近一项研究提出了一种新的行为校准强化学习方法,旨在解决这一难题。该论文详细探讨了如何通过调整奖励函数来改进LLM的表现。经过特定训练后,一个参数量仅为40亿的小型模型在幻觉抑制方面超越了GPT-5等顶级大模型。图1展示了模型回答数学问题时置信度标注的实例。每一