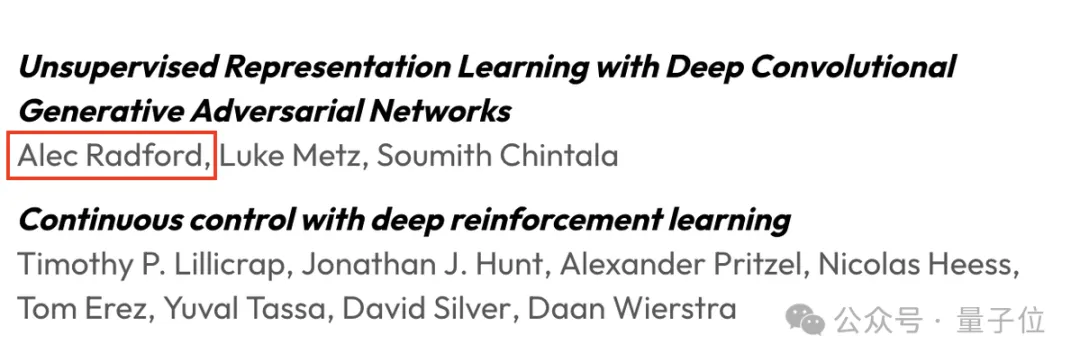

ICLR 2026时间检验奖揭晓,GPT天才Alec Radford凭借其十年前所作的DCGAN论文荣获殊荣。

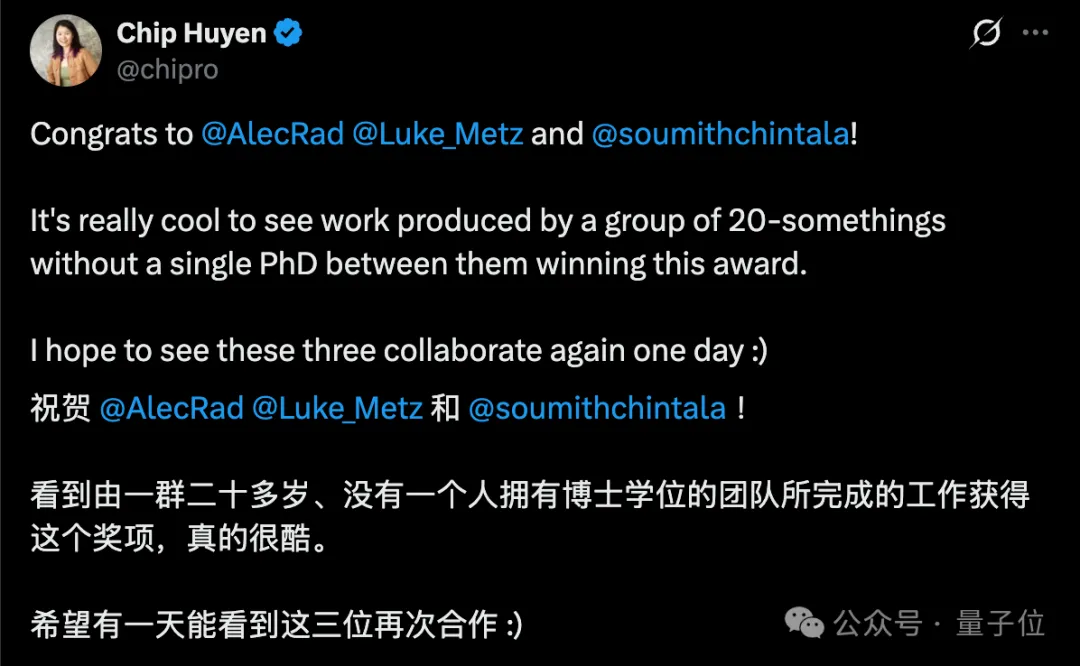

当今这三位作者均已成为Mira初创公司的核心成员。

在ICLR会议上,这位年轻的科学家因其在深度学习领域的杰出贡献而备受关注。

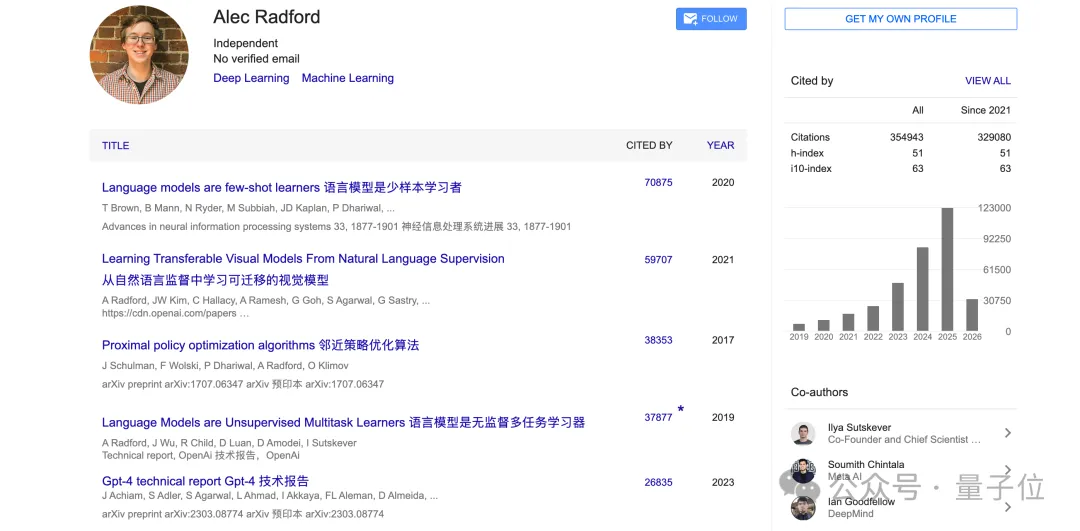

Alec Radford以他在OpenAI的工作而闻名,在那里他与Ilya一起推动了GPT系列模型的发展,并被认为是初代GPT的奠基者之一。

他的工作不仅获得了业界的高度评价,更是赢得了“爱因斯坦级天才”的美誉。同时,无论Alec需要什么资源,OpenAI都会全力支持。

这篇十年前发表的论文在机器学习领域中占据了重要位置,如今已被引用超过2万次,成为GAN工程应用领域的开创性作品之一。

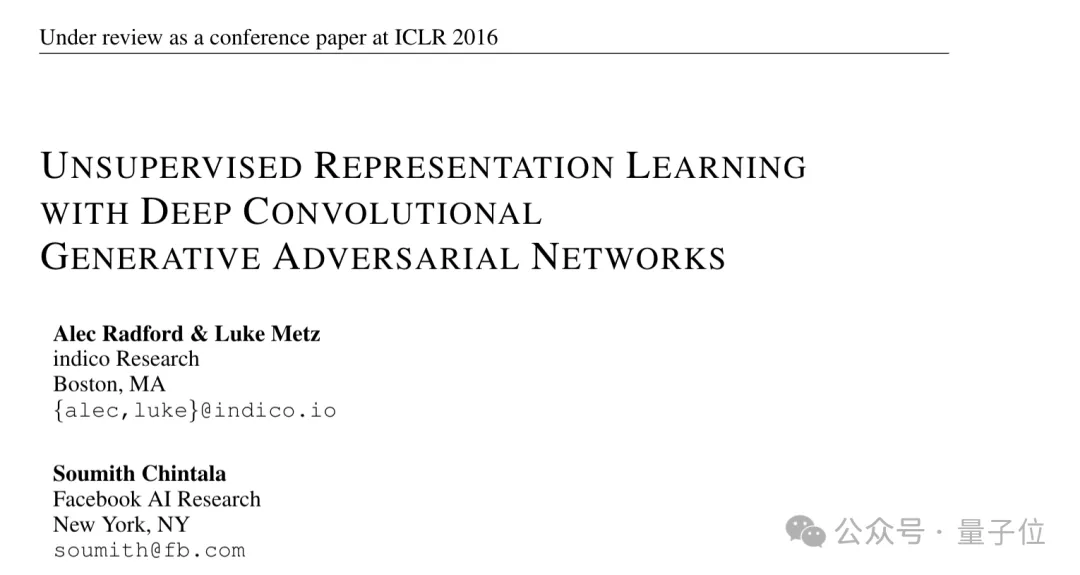

不仅如此,这篇论文还因其作者并非博士生而引起了广泛关注。三位作者分别来自本科和硕士阶段的学习经历。

随着ICLR连续三年颁发时间检验奖,这两篇获奖论文的重要性不言而喻。

DCGAN论文的评价指出,这项研究首次证明了基于学习的方法能够生成多样化且结构复杂的图像,并为后来的研究奠定了坚实的基础。如今,该技术在工业界的应用也十分广泛。

作者Alec Radford毕业于规模较小但颇具影响力的欧林工程学院,在该校他创立了一家名为Indico的公司,并随后加入OpenAI参与了一系列重要项目。

2024年底,Alec决定离开OpenAI并加入Mira Murati创建的Thinking Machines Lab担任顾问角色。

Bob McGrew作为前OpenAI首席研究员也与他一同加入了新公司。

Luke Metz同样是欧林工程学院的毕业生,在毕业后加入了由Alec创立的Indico,随后进入谷歌从事生成模型和优化算法的研究工作。2025年底他也转投Thinking Machines Lab任职。

DCGAN论文另一位作者Soumith Chintala则毕业于韦洛尔理工学院,并在纽约大学LeCun教授的指导下完成了硕士学位研究方向转向深度学习领域。

即便经历多次求职失败,他最终凭借Lecun推荐进入Meta公司工作,在那里领导开发了PyTorch项目。如今Soumith已成为Meta的核心成员,2025年底加入Thinking Machines Lab任CTO。

这三位作者在ICLR颁奖后再次齐聚一堂,共同为新公司的未来发展贡献力量。

同时,本届ICLR还颁发了两篇优秀论文奖,《Transformers are Inherently Succinct》和《LLMs Get Lost in Multi-Turn Conversation》,它们分别探讨了Transformer模型的简洁性以及大语言模型在多轮对话中的表现问题。

前者直接影响了GPT系列模型的核心逻辑,后者则来自谷歌DeepMind,证明了深度强化学习可以应用于连续控制。

这也是ICLR连续三年都在以时间检验奖的形式认可机器学习成果,也足见这两篇论文的经典程度不分伯仲。

组委会是这样评价DCGAN这篇论文的:

这篇俗称DCGAN的论文,首次成功验证了基于学习的生成模型能够生成多样化、真实且结构复杂的图像。

该研究成果正式开创了图像生成子领域,如今图像生成已是机器学习领域最热门的研究方向之一,同时在工业领域落地了大量成熟且成效显著的应用。

尽管相关技术不断迭代升级(从生成对抗网络逐步发展至扩散模型),但DCGAN依旧历久弥新,是奠定这一重要研究领域的关键里程碑。

本论文共有三位作者,2个本科1个硕士。

其中,Alec Radford本科毕业于富兰克林·欧林工程学院(Franklin W. Olin College of Engineering)。

据网友介绍,这是一所规模不大但实力不容小觑的工程院校。

通常只有400名学生,知名度虽不及哈佛、MIT等同类科技学校,但它们的学生在项目方向上个人自由度高,学校学术能力媲美常春藤名校。

在那里,他和同学们一起创立了公司Indico,并随后加入OpenAI,一干就是八年。

他是最早期GPT系列论文的核心贡献者,几乎参与了OpenAI所有的重大突破,也是多模态模型CLIP的主导者。

他所提出的Transformer架构加生成式预训练的方法,直接奠定了后续ChatGPT和其它大模型的基础,同时也在GPT-1到GPT-3、Whisper、DALL-E的研发中担任关键角色。

截止目前,Alec Radford的论文总被引数已超35万。

但在2024年底,Alec正式宣布告别老东家,转而追求独立研究。在去年3月,他以顾问的方式加入了前OpenAI CTO Mira Murati创立的Thinking Machines Lab。

和他同期进新公司的,还有前OpenAI首席研究员Bob McGrew。

另一位本科生作者Luke Metz,和Alec都出自欧林工程学院,并在毕业后加入了Alec创立的Indico公司。

他也是OpenAI的初始成员之一,随后他进入谷歌担任长期研究员,研究重心从生成模型逐渐转向优化算法和元学习,并在2022年短暂回归OpenAI,24年底转投Thinking Machines Lab。

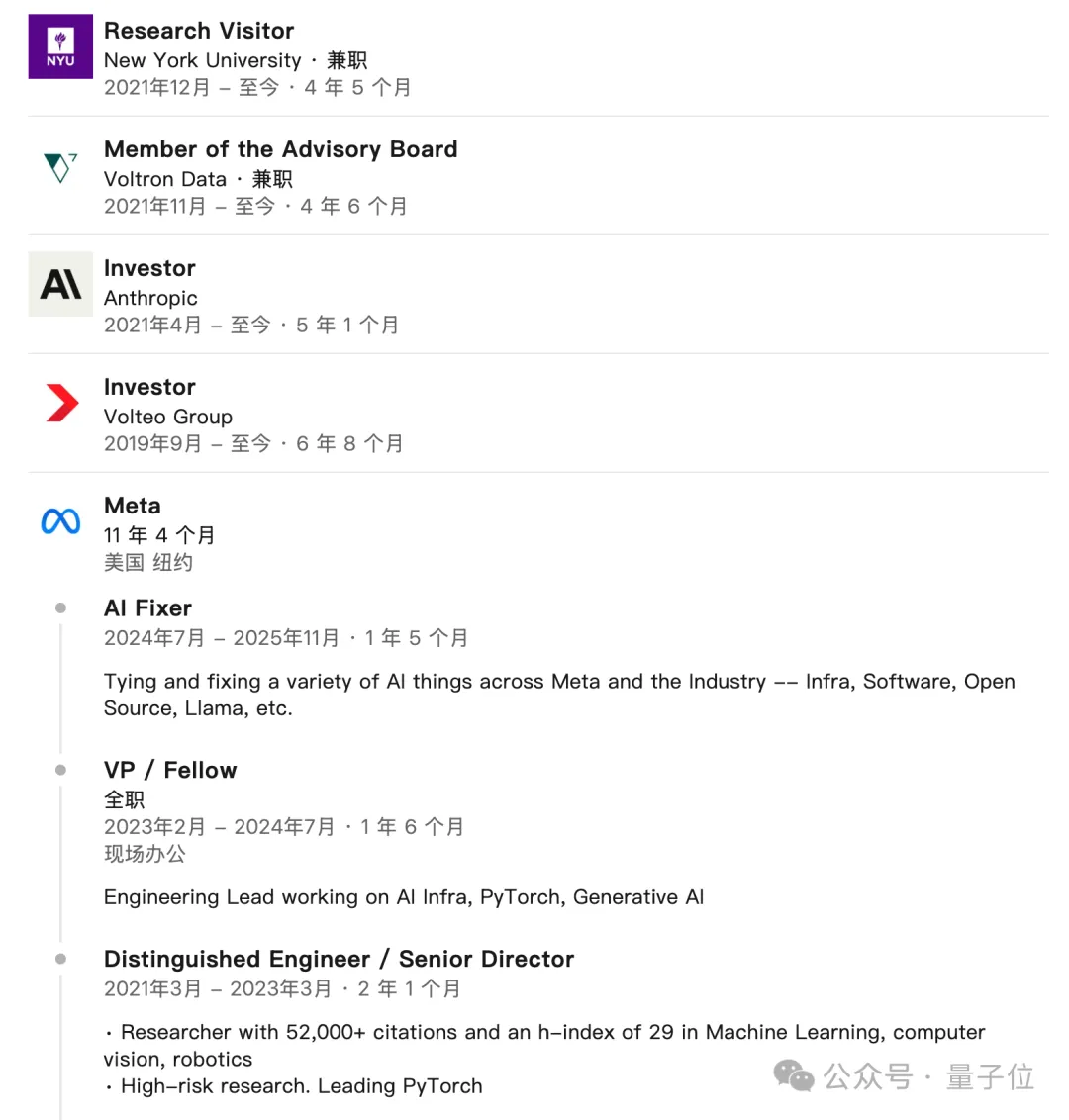

最后一位作者Soumith Chintala,他广为人知的身份除了是DCGAN论文作者之一,还是PyTorch的核心作者、Meta前副总裁。

他本科就读于韦洛尔理工学院(VIT),这是一所当地的二流工程院校,这也让他在申请硕士时屡屡碰壁,被12所高校连续拒绝。

直到最后,他终于坚持不懈收到了纽约大学发来的offer,并成功收获LeCun青睐,得以师从LeCun。在那里,LeCun影响了Soumith的研究方向,他开始从事早期深度学习研究。

但在完成硕士学位后,Soumith再次碰壁,几乎申请的全部工作都被拒绝,只能进入一家名为MusiAmi的小型创业公司,从事移动深度学习工作。

直到2014,在Lecun的引荐下,他进入Meta工作,并带领团队成员主导设计了PyTorch。而PyTorch已经成为目前全世界使用最广泛的开源机器学习平台之一。

在Meta工作11年后,Soumith一路从L4工程师晋升至副总裁,成为Meta核心人物。在2025年底,他离开了Meta,并加入Thinking Machines Lab担任CTO。

自此,DCGAN三位作者兜兜转转,最终再次齐聚Thinking Machines Lab。

其余获奖情况

除此之外,ICLR还颁布了两篇优秀论文奖:

-

《Transformers are Inherently Succinct》:率先提出简洁性是衡量Transformer表达能力的新维度,同时证明Transformer在描述某些复杂概念时,相比RNN等模型存在指数级甚至双指数级优势。 -

《LLMs Get Lost In Multi-Turn Conversation》:设计了一种可扩展的方法来评估LLM的多轮对话能力,同时发现当交互涉及多轮对话和指令不明确时,LLM的适应性和可靠性会大幅度下降。

和一篇优秀论文提名:

其中,研究者运用逼近理论,为主流Muon优化器设计了一套极分解设计最优多项式逼近方案,收获了业界一致的认可。

参考链接:

[1]https://blog.iclr.cc/2026/04/22/announcing-the-test-of-time-awards-from-iclr-2016/

[2]https://scholar.google.com/citations?user=dOad5HoAAAAJ&hl=en

[3]https://www.bostonglobe.com/2023/06/10/business/how-couple-olin-college-students-helped-spark-ai-chatbot-revolution/

[4]https://techcrunch.com/2025/04/08/mira-muratis-ai-startup-gains-prominent-ex-openai-advisers/

[5]https://timesofindia.indiatimes.com/etimes/trending/meet-soumith-chintala-indian-origin-techie-rejected-by-12-us-universities-now-cto-of-thinking-machines-lab/articleshow/126552880.cms

鹭羽

鹭羽