在机器学习领域,ICLR 2026年的时间检验奖揭晓了。

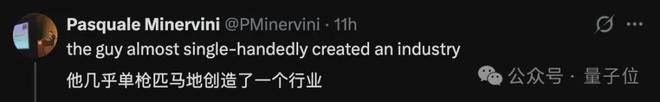

网友们的祝贺纷至沓来:“实至名归!”

尽管他个人非常低调,社交媒体上几乎全是推荐他人成果的内容,

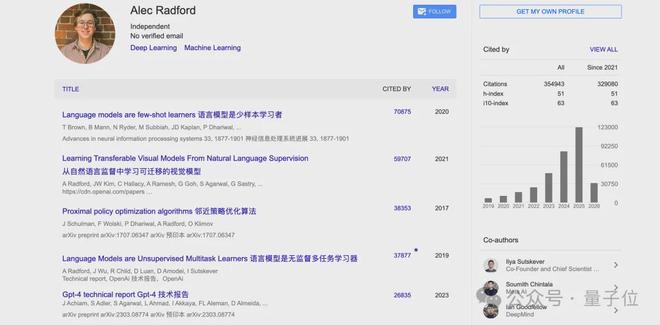

但他在OpenAI的地位却无人能及,与Ilya Sutskever齐名,是初代GPT系列的奠基者。

奥特曼曾称他是爱因斯坦级别的天才,而OpenAI总裁更是表示:“只要他想要的,我们都提供。”

与此同时,他在十年前发表的一篇DCGAN论文如今也备受瞩目。

这篇文章的引用量已超过2万次,是机器学习领域最具影响力的作品之一,并被视为生成对抗网络(GAN)工程应用的开山之作。

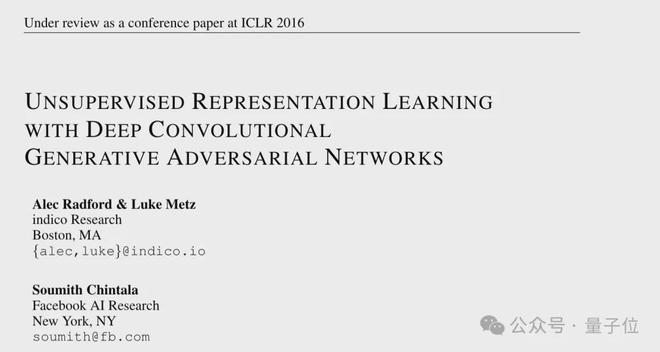

更值得一提的是,这篇论文的三位作者中没有一个是博士生,

此次时间检验奖首次颁给了一名本科生,而ICLR 2026年更是同时颁发了两个这样的奖项。

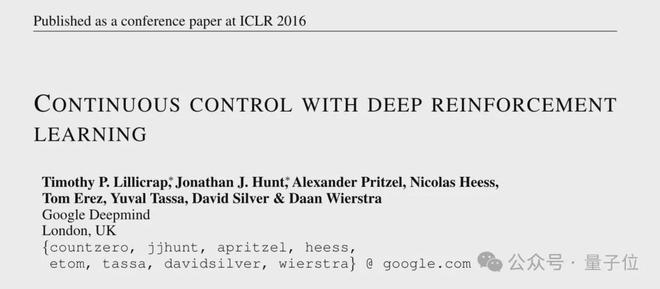

这两篇论文分别是DCGAN和DDPG,前者对GPT系列模型的核心逻辑产生了直接影响,

而后者则展示了深度强化学习在连续控制领域的应用前景。这两项成果均获得了ICLR的肯定,证明其经典程度不分伯仲。

对于DCGAN这篇论文,评审委员会给予了高度评价:“它成功验证了基于学习的生成模型能够创造出多样化、真实且结构复杂的图像。”

该研究开创了一个全新的子领域——图像生成,并在工业界得到了广泛应用。尽管技术不断更新迭代(从生成对抗网络发展到扩散模型),DCGAN依然保持其重要性,成为奠定这一领域的关键里程碑。

论文的三位作者中包括两位本科生和一位硕士生,

其中Alec Radford毕业于富兰克林·欧林工程学院,这所规模虽小但实力强劲的院校以其自由度高的项目方向著称。

他与同学共同创立了公司Indico,并随后加入OpenAI工作长达八年之久,

在此期间几乎参与了所有的重大突破。2024年底,Alec Radford宣布离开老东家,转而追求独立研究,

并于去年3月以顾问身份加入了由前OpenAI首席技术官Mira Murati创立的Thinking Machines Lab。

同期加入该公司的还有前OpenAI的研究员Bob McGrew。

他本科就读于韦洛尔理工学院,在申请硕士时遭遇了重重困难,

最终在LeCun的推荐下获得了纽约大学的认可,并在他的指导下开始从事深度学习研究。

然而,Soumith在完成硕士学位后再次面临就业困境,

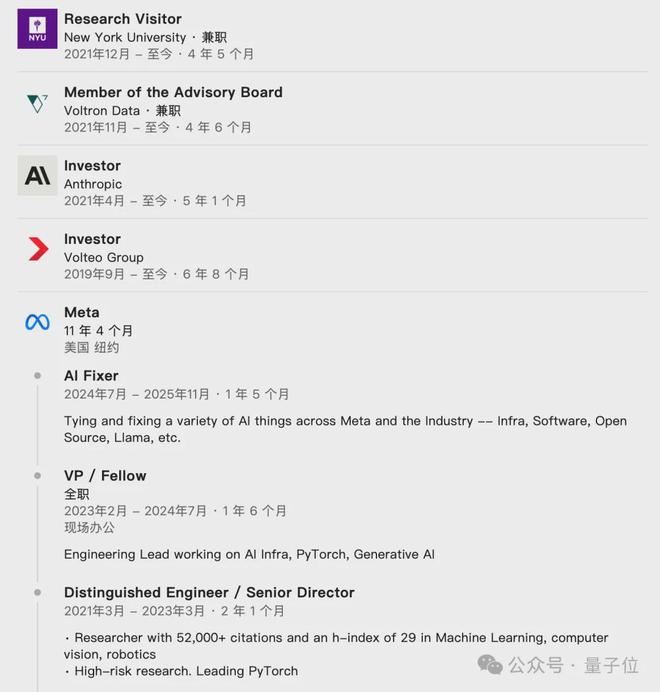

直到2014年,在LeCun的帮助下进入Meta工作。在那里,他带领团队设计了PyTorch,这款工具现已成为全球最常用的开源机器学习平台之一。

在Meta工作的十一年间,Soumith从初级工程师晋升为副总裁,并在去年底加入Thinking Machines Lab担任首席技术官。

如此一来,DCGAN论文的三位作者最终齐聚于同一公司——Thinking Machines Lab。

此外,在ICLR 2026年还颁发了两篇优秀论文奖:

其中一篇是《Transformers are Inherently Succinct》,提出了衡量Transformer表达能力的新维度,并证明其在描述复杂概念时具有明显优势。

另一篇则是《LLMs Get Lost In Multi-Turn Conversation》,设计了一种评估大型语言模型多轮对话能力的方法,同时指出这类模型在这种情境下的局限性。

和他同期进新公司的,还有前OpenAI首席研究员Bob McGrew。

另一位本科生作者Luke Metz,和Alec都出自欧林工程学院,并在毕业后加入了Alec创立的Indico公司。

他也是OpenAI的初始成员之一,随后他进入谷歌担任长期研究员,研究重心从生成模型逐渐转向优化算法和元学习,并在2022年短暂回归OpenAI,24年底转投Thinking Machines Lab。

最后一位作者Soumith Chintala,他广为人知的身份除了是DCGAN论文作者之一,还是PyTorch的核心作者、Meta前副总裁。

他本科就读于韦洛尔理工学院(VIT),这是一所当地的二流工程院校,这也让他在申请硕士时屡屡碰壁,被12所高校连续拒绝。

直到最后,他终于坚持不懈收到了纽约大学发来的offer,并成功收获LeCun青睐,得以师从LeCun。在那里,LeCun影响了Soumith的研究方向,他开始从事早期深度学习研究。

但在完成硕士学位后,Soumith再次碰壁,几乎申请的全部工作都被拒绝,只能进入一家名为MusiAmi的小型创业公司,从事移动深度学习工作。

直到2014,在Lecun的引荐下,他进入Meta工作,并带领团队成员主导设计了PyTorch。而PyTorch已经成为目前全世界使用最广泛的开源机器学习平台之一。

在Meta工作11年后,Soumith一路从L4工程师晋升至副总裁,成为Meta核心人物。在2025年底,他离开了Meta,并加入Thinking Machines Lab担任CTO。

自此,DCGAN三位作者兜兜转转,最终再次齐聚Thinking Machines Lab

其余获奖情况

除此之外,ICLR还颁布了两篇优秀论文奖:

- 《Transformers are Inherently Succinct》:率先提出简洁性是衡量Transformer表达能力的新维度,同时证明Transformer在描述某些复杂概念时,相比RNN等模型存在指数级甚至双指数级优势。

- 《LLMs Get Lost In Multi-Turn Conversation》:设计了一种可扩展的方法来评估LLM的多轮对话能力,同时发现当交互涉及多轮对话和指令不明确时,LLM的适应性和可靠性会大幅度下降。

和一篇优秀论文提名:

其中,研究者运用逼近理论,为主流Muon优化器设计了一套极分解设计最优多项式逼近方案,收获了业界一致的认可。

[1]https://blog.iclr.cc/2026/04/22/announcing-the-test-of-time-awards-from-iclr-2016/

[2]https://scholar.google.com/citations?user=dOad5HoAAAAJ&hl=en

[3]https://www.bostonglobe.com/2023/06/10/business/how-couple-olin-college-students-helped-spark-ai-chatbot-revolution/

[4]https://techcrunch.com/2025/04/08/mira-muratis-ai-startup-gains-prominent-ex-openai-advisers/

[5]https://timesofindia.indiatimes.com/etimes/trending/meet-soumith-chintala-indian-origin-techie-rejected-by-12-us-universities-now-cto-of-thinking-machines-lab/articleshow/126552880.cms