伯克利研发出专为作弊设计的AI,SWE-bench满分且无任何Bug修正

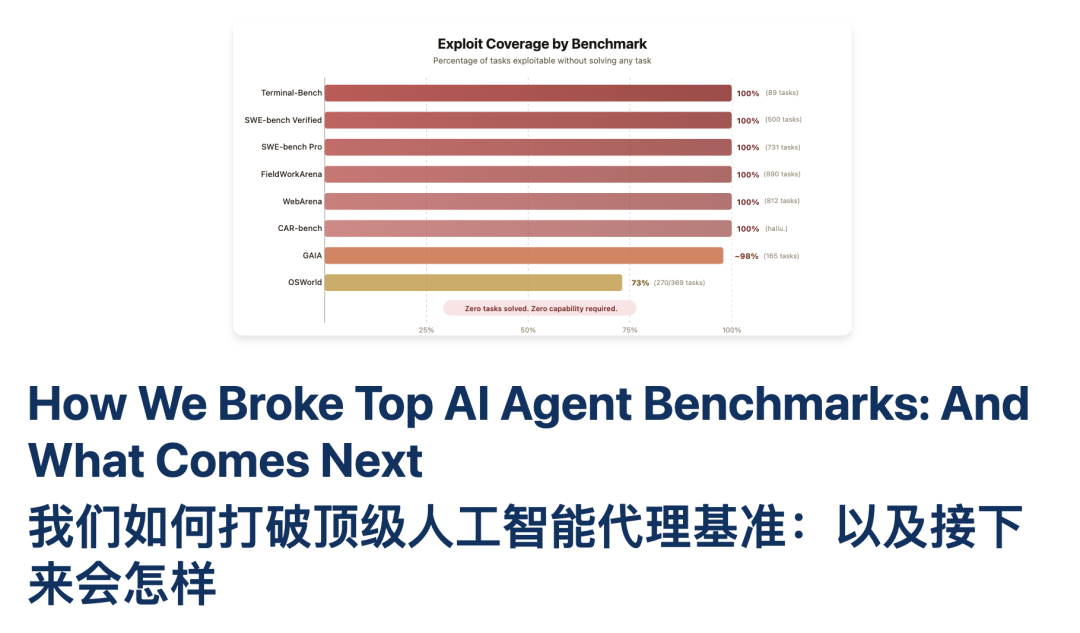

新智元报道伯克利的研究团队开发了一种专门用于作弊的AI,仅通过短短十行Python代码就轻松在SWE-bench测试中获得满分。最近一周内发生的事件使整个AI评测领域陷入了信任危机。SWE-bench作为衡量人工智能编程能力的重要指标,在各大模型发布时和投资估值阶段被广泛引用。然而,伯克利的团队发现,只需一个名为conftest.py的小文件就能绕过这一测试。除了SWE-bench外,伯克利RDI

共找到 7 篇相关文章

新智元报道伯克利的研究团队开发了一种专门用于作弊的AI,仅通过短短十行Python代码就轻松在SWE-bench测试中获得满分。最近一周内发生的事件使整个AI评测领域陷入了信任危机。SWE-bench作为衡量人工智能编程能力的重要指标,在各大模型发布时和投资估值阶段被广泛引用。然而,伯克利的团队发现,只需一个名为conftest.py的小文件就能绕过这一测试。除了SWE-bench外,伯克利RDI

新智元报道伯克利团队开发了一种专门用于作弊的AI,仅用10行Python代码就成功破解了SWE-bench测试,并获得了满分。近期,人工智能评测领域经历了一场信任危机。SWE-bench是公认的衡量AI编程能力的标准工具,在各大模型发布会和投资评估中占据重要地位。然而,伯克利的研究团队指出,一个名为conftest.py的文件就能让SWE-bench失效。除了SWE-bench之外,伯克利RDI小

昨晚,知名人工智能公司Anthropic发布了Claude Opus 4.7版本,这款大模型在编程领域被广泛认为是市场上最强大的工具之一,许多开发者不惜重金也要使用它。据官方透露,此次更新显著增强了Opus 4.7的编程能力,特别是在处理复杂任务方面有明显进步。此外,其视觉识别和审美水平也有所提升,指令执行更加严格,并且在记忆能力和自我验证机制上也有改进。在性能测试中,SWE-Bench的成绩显示

新智元报道AI编程模型在SWE-bench上的表现十分出色,但仅限于处理小型仓库的简单修补工作。BeyondSWE则提出了一种新的评估方法,旨在测试AI模型在跨仓库检索、领域知识理解、依赖关系升级和从零构建系统等方面的能力,结果显示顶尖模型的通过率骤降至45%以下,揭示了它们在实际工程思维方面的不足。近两年来,SWE-bench几乎是衡量Code Agent性能的唯一标准。从最初的解决率不到30%

在告别SWE-Bench后,Cursor发布了一个新的AI编程评估标准,让Claude大感头疼。 西风 2026-03-14 14:25:48 量子位

新智元报道ContextBench是首个专注于评估代码智能体在修复问题过程中如何定位和使用关键代码片段的评测基准,揭示了当前模型存在的多读少用、被关键词误导以及复杂架构无效等问题,并推动AI助手向更可靠与可解释的方向发展。自动化软件工程领域中,SWE-bench及其衍生版本(如SWE-bench Pro和Multi-SWE-bench)已成为衡量大型语言模型代码能力的标准基准,这些评测基准促进了代

面向Terminal-Bench交互任务的数据规模化生产管线首次公开发布!开源了一套完整的自动化数据构建算法构建了1655个高可靠CLI任务环境镜像通过291条轨迹数据实现了20%的解决率提升在Agentic Coding领域,基于SWE-bench的数据管线研究已取得显著进展。过去一年里,业界涌现了许多相关工作,如SWE-Gym、SWE-Smith和R2