在告别SWE-Bench后,Cursor发布了一个新的AI编程评估标准,让Claude大感头疼。

这一标准专门用于衡量Cursor内不同模型的“智能体”性能。

量子位 | 公众号 QbitAI

在编程智能体盛行的时代,Cursor推出了一套全新的评估标准——CursorBench。

这个标准旨在评估Cursor中不同模型在执行复杂任务时的效率。

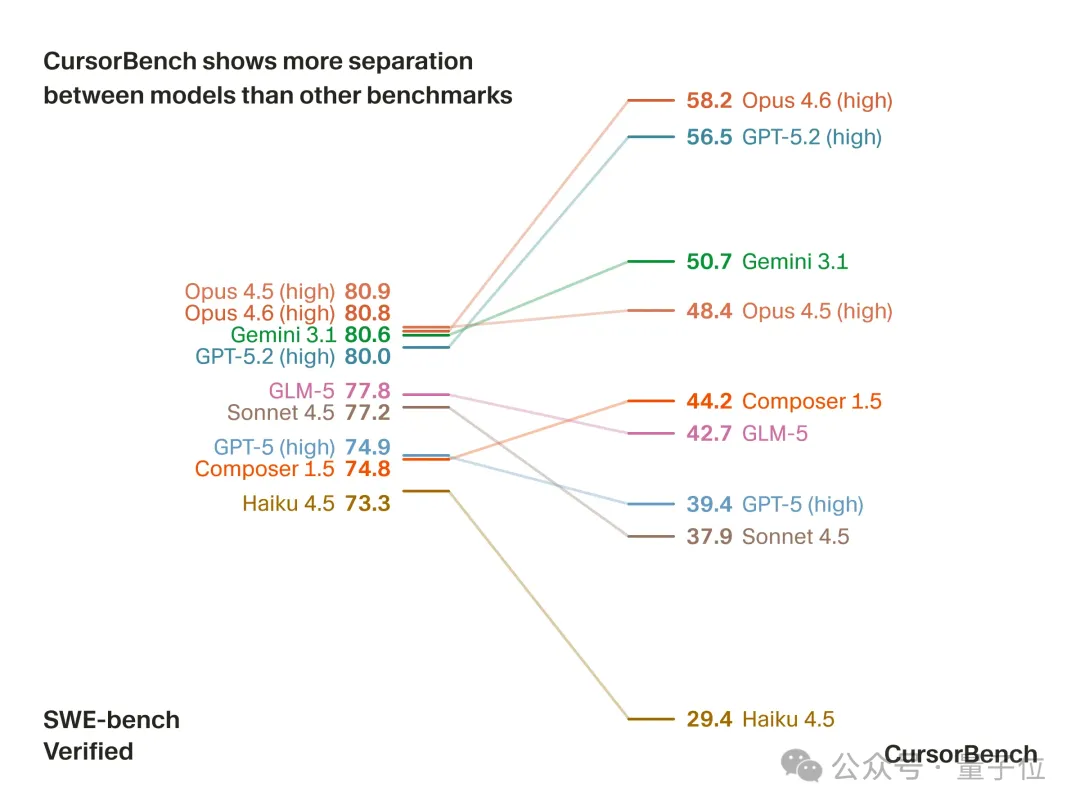

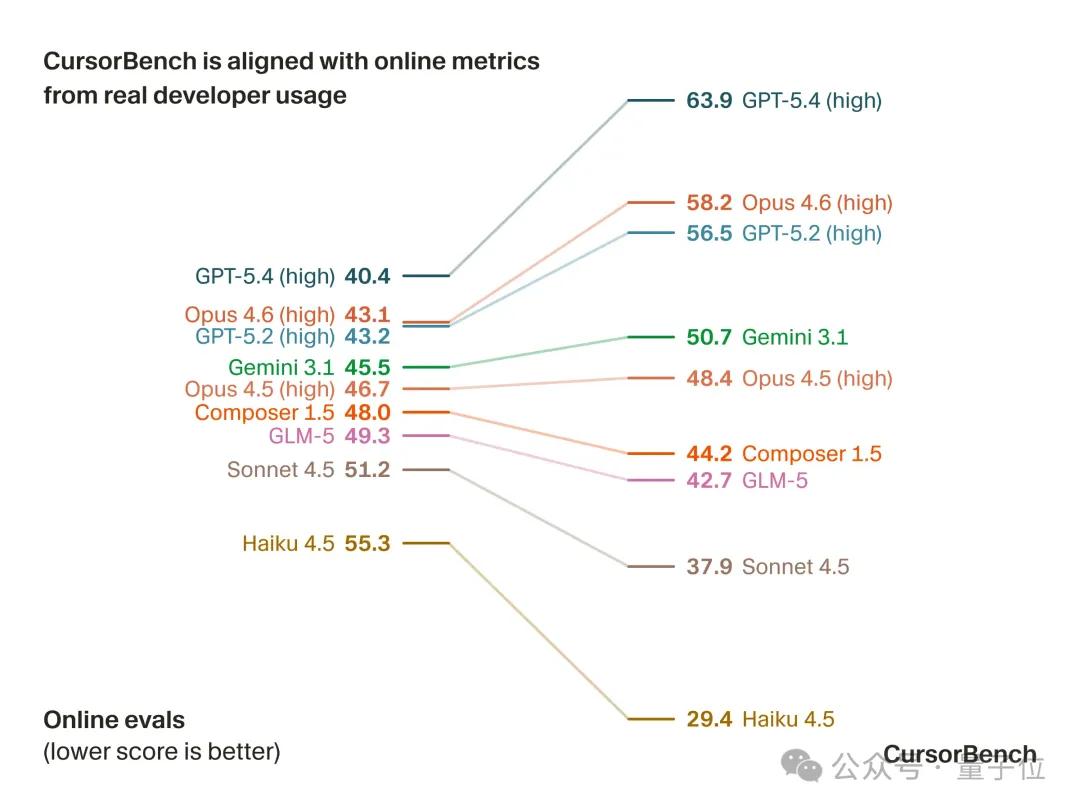

令人惊讶的是,Claude Haiku 4.5 和 Claude Sonnet 4.5 在这个新标准下的表现令人失望。

- Claude Haiku 4.5 的分数从73.3 降至29.4。

- Claude Sonnet 4.5 的分数从77.2 降至37.9。

这也突显了CursorBench与传统编程基准之间的差异。

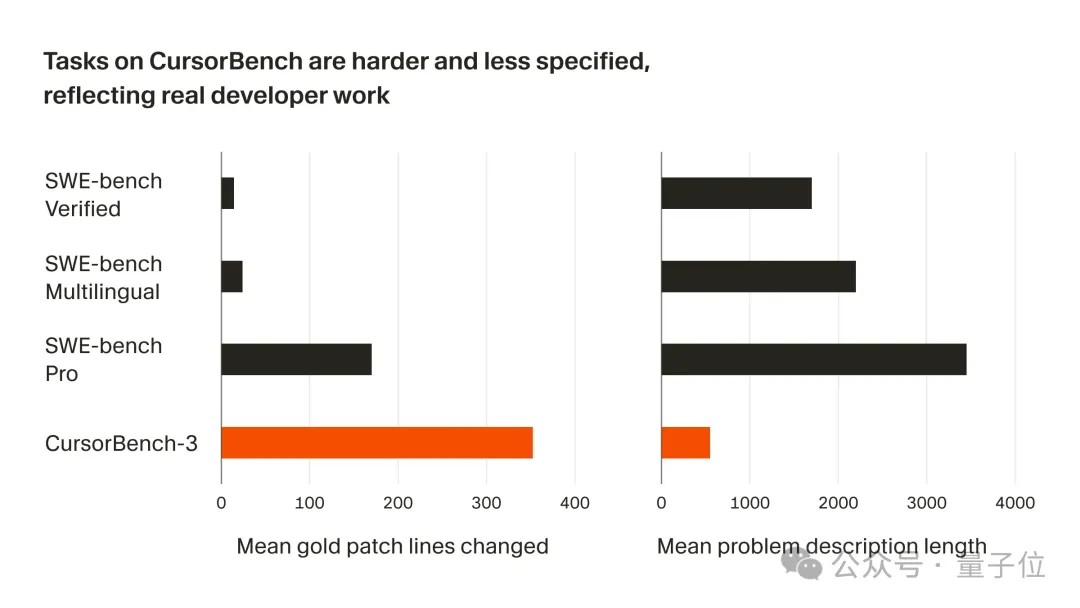

SWE-Bench主要关注程序是否能解决问题,而CursorBench则更侧重于程序能否高效地解决问题,尤其在真实的token限制下。

当前,评价AI执行能力的重要性日益凸显,CursorBench的出现填补了这一空白。

然而,CursorBench究竟是如何运作的呢?

对于这个问题,Cursor已经发布了一篇详细的博客文章来解释。

线上+线下混合评

在文章中,Cursor首先介绍了当前的背景——

随着AI编程助手越来越像“智能体”,许多现有的公开基准已经显得不够用了。

主要存在的问题是:

以SWE-Bench为例,它主要是修复GitHub issue中的bug,任务单一。

一是任务类型不真实。

Terminal-Bench虽然不再局限于代码仓库,但更偏重于各种“谜题式任务”,类似参加某种竞赛而非日常开发。

因此,Cursor认为,“这些任务与开发者实际要求智能体完成的工作并不匹配”。

在实际开发中,更常见的情况是,开发者要求AI修改多个文件、分析生产日志、运行实验等。

很多公开基准假设一个问题只有一个正确答案。

二是评分机制不合理。

然而,一个需求往往有多种实现方式,不同的代码风格和架构选择都可能影响方案的选择。

这会导致两种情况:要么直接给正确的方案打分,要么为了评估的准确性而强行消除模糊性。

无论是哪种情况,基准都无法反映真实的开发场景。

还有一个公认的问题是数据污染。

一旦基准使用时间过长,后来的模型很可能直接使用这些数据进行训练。

在这种情况下,基准评估的价值也会大打折扣。

面对这些问题,Cursor提出了一个全新的“线上+线下混合评估”的方案。

线下部分就是CursorBench,其流程相对简单——

让不同模型完成相同的标准任务,然后系统从正确性、代码质量、效率、交互行为等多个维度进行打分。

这种标准化流程的好处显而易见,包括能够将模型置于同一水平线上进行比较,能够重复测试,成本也相对可控。

有人可能会问,这和其他基准有何不同?

事实上,CursorBench的独特之处在于其任务选择。

其不同之处体现在三个方面:

以前的基准更像是“刻意找题”,而CursorBench的题目都来自Cursor平台。

一是任务真。

Cursor有一个工具叫Cursor Blame,它可以追踪代码是由哪个AI请求生成的。

这样就能获得一对对的真实数据——开发者请求+某个模型最终提交的代码。

这些数据就构成了CursorBench极佳的“出题范本”。

任务来自于内部代码库和受控来源,降低了模型在训练阶段见过这些任务的风险。

我们每隔几个月就会更新一次这套基准,以反映开发者使用智能体方式的变化。

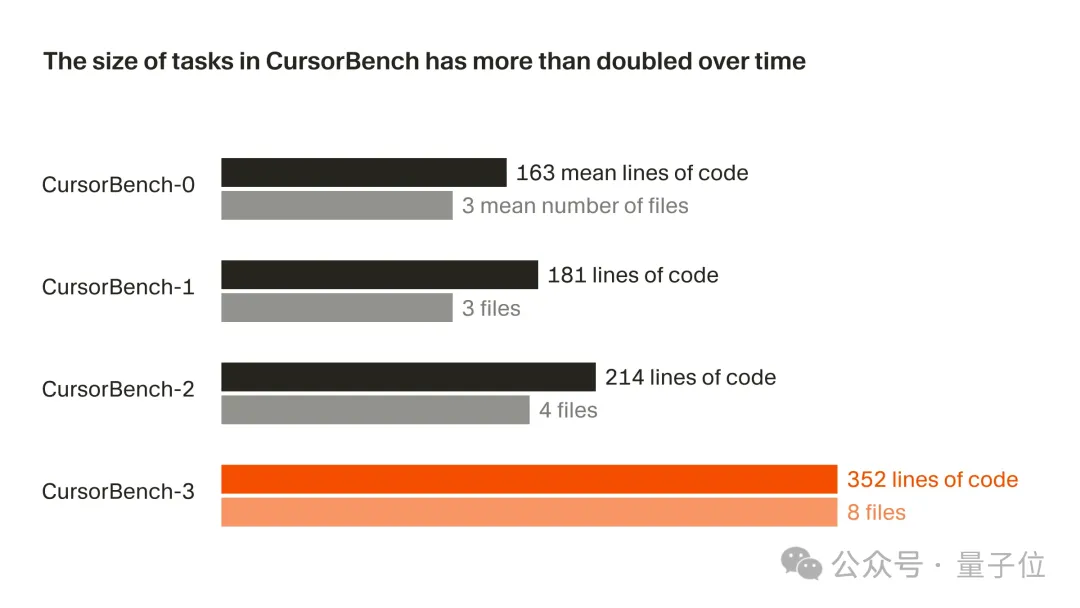

二是任务规模大。

在正确性评估中,无论从代码行数还是平均文件数来看,问题规模从初始版本到当前的CursorBench-3大约翻了一倍。

虽然代码行数不是衡量难度的完美指标,但增长反映了我们如何将更具挑战性的任务纳入CursorBench,例如处理多工作区的monorepo环境、排查生产日志,以及执行长时间运行的实验。

任务描述刻意保持“模糊”。

因此,CursorBench的任务描述更加贴近实际。

这点也比较好理解。

基于以上特殊设计,CursorBench成为了编程智能体时代真正以“真实开发场景”为原点设计的基准测试。

然而,这还远远不够,Cursor还开发了一套线上评测方案——直接观察真实用户使用效果。

他们采用A/B Test方式,观察一部分用户使用模型A、另一部分用户使用模型B之后的效果。

主要关注开发者是否接受AI生成的代码、是否继续追问、是否撤销修改、任务是否真正完成等可追踪的产品指标。

如此一来,线上和线下就可以形成完美互补,甚至形成良性循环——

线下CursorBench快速筛选模型能力,然后线上验证模型是否真的更好,发现偏差后再去调整benchmark或模型。

那么,模型们在新基准CursorBench上的表现如何呢?

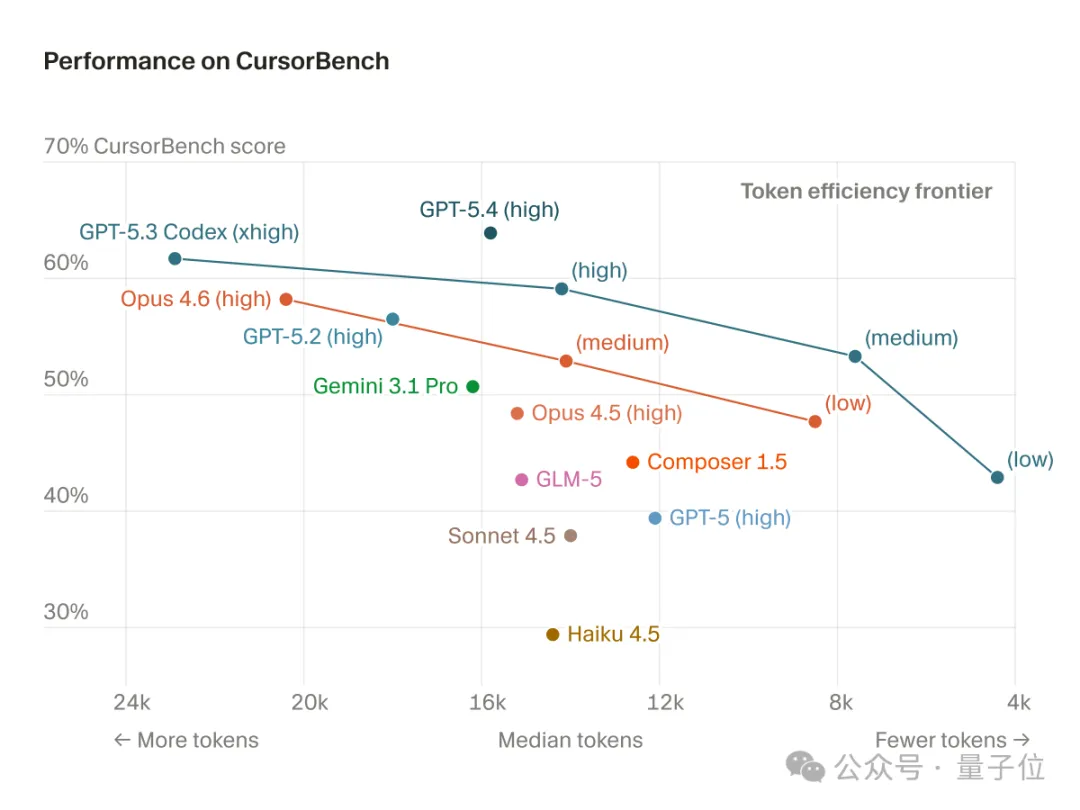

从最终性能(越靠近右上角越好,代表“以最低成本实现最高性能”)来看:

网友们对此展开了激烈的讨论:

嗯,Claude Sonnet 4.5 的性价比似乎有点低。

所以,结果呢?

这个Composer模型(Cursor自研编码模型)又来自哪里呢?

总之,从Cursor公布的结果来看,一个很明显的结论是——

CursorBench在前沿模型之间的区分度明显更高。

这是自然而然的。基准一饱和,模型之间的差距往往难以拉开。

但一旦遇到新的、难的,实力差距便自然显现。

特别是在CursorBench这种任务规模更大、环境更复杂的基准上,差距无疑将被进一步放大。

只需对比模型在SWE-Bench和CursorBench上的得分就能看出来了(左边全挤在一起、右边呈阶梯式):

此外,Cursor还强调了一点——

CursorBench的排名与真实用户体验更加一致。

通过前面提到的线上实验,他们发现CursorBench的模型排名与线上指标变化基本一致。

接下来,Cursor还将着手开发下一代评测套件:

虽然CursorBench-3的任务比公开基准上的任务持续时间更长,但它们仍然可以在一次会话内完成。

我们预计在未来一年里,绝大多数开发工作将转向由在各自计算机上独立运行的长时运行智能体来完成,因此我们也正规划对CursorBench作出相应调整。

瞄准的还是智能体,只不过这次是运行时间更长的智能体。

接下来,Cursor还将着手开发下一代评测套件:

虽然CursorBench-3的任务比公开基准上的任务持续时间更长,但它们仍然可以在一次会话内完成。我们预计在未来一年里,绝大多数开发工作将转向由在各自计算机上独立运行的长时运行智能体来完成,因此我们也正规划对CursorBench作出相应调整。

嗯,瞄准的还是智能体,只不过是运行时间更长的智能体。

参考链接:

[1]https://x.com/cursor_ai/status/2032148125448610145

[2]https://cursor.com/cn/blog/cursorbench

[3]https://www.objectwire.org/technology/cursor

西风

西风