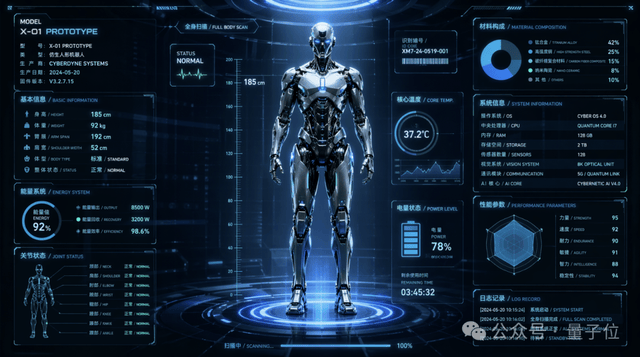

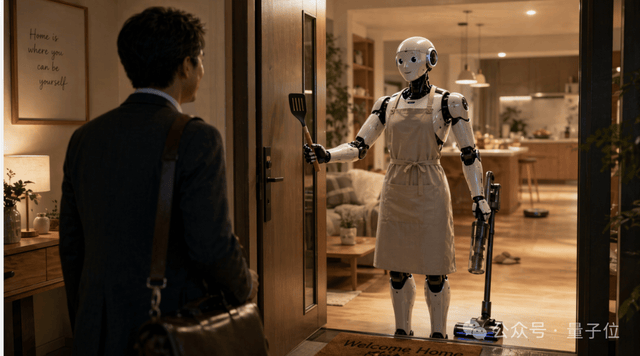

世界首个全球统一模型问世,机器人步入家庭时代!

全球首款世界统一模型亮相

随着技术的进步,机器人大脑迎来革命性突破——能够在复杂家庭环境中持续学习和自我进化的新一代智能系统即将诞生。

通过这一架构革新,WALL-B解决了传统视觉语言动作(VLA)架构中模块间数据传输的问题,实现低能耗下的全面融合,并赋予机器人强大的多模态能力及物理世界的理解力。

这种突破性的技术进步意味着机器人将具备更强的自主预测、零样本泛化和持续生存的能力,在家庭场景中能够快速掌握各种任务。

未来家庭里的生活助手不再是空想,随着WALL-B的到来,机器人成为家庭成员的梦想似乎触手可及了?

近年来,市场上出现了一系列功能日益强大的小机器人,它们的智能水平令人印象深刻。然而,在现实应用中,这些机器人的泛化能力和环境适应性仍然有待提高。

△

AI生成

自变量团队选择了一条艰难但前景广阔的路线:将WALL-B部署到真实的家庭环境中进行测试和训练,以获取宝贵的“牛奶数据”,从而促进其能力的持续进化。

当机器人在实际生活中积累大量交互经验后,这些宝贵的数据成为推动模型迭代升级的重要动力源,形成一个自我强化的数据循环机制——即所谓的“数据飞轮”。

这种模式不仅提升了WALL-B的技术壁垒,还为整个具身智能领域提供了新的发展方向和实践经验。

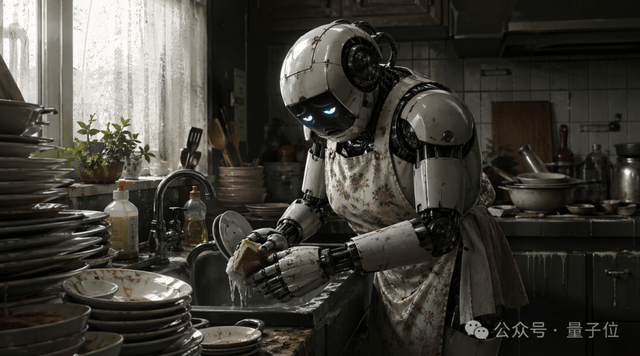

随着技术的不断成熟与进步,家庭机器人将不再仅仅局限于简单的清扫工作,而是能够真正融入日常生活的方方面面,成为家庭成员不可或缺的一部分。

自变量机器人的这一创新举措标志着家庭场景不再是理论上的终点,而是检验和发展具身智能能力的关键领域。WALL-B的成功验证了一个更加接近未来的路径,并为整个行业树立了新的标杆和参考范例。

首个世界统一模型,来了!

镜头前面耍大刀,左脚鸡毛腿,右手出硬拳!

这两年,镜头里的小机器人一个比一个会整活儿,随便拎出来一个,都挺像那么回事???

而这一波「机器人突然变能干了」的背后,靠的正是过去两年行业最主流的一条技术路线——VLA架构。

也就是把视觉、语言和动作连起来,让机器人从过去只会执行单一动作,进化到能看、能听、能跟着指令干活。

但,热闹归热闹,一个行业里越来越藏不住的现实也摆在眼前——

VLA确实很擅长让机器人学会照着做,但一旦涉及对物理世界的理解,尤其是在家庭这种充满随机和未知情况的环境中执行任务时,就不太ok了…

更麻烦的是,传统VLA内部很多时候还是「分头干活」的路子。

视觉管看,语言管理解,动作管执行,模块之间数据来回倒腾,每传一次就损耗一次,信息越传越少,以至于机器人在执行时的判断也来越不准确……

而WALL-B走的,恰恰是另一条相反的路径——

基于世界统一模型,把视觉、听觉、语言、触觉模块全面打通,让机器人拥有一套具备「原生多模态」「世界观」「与世界交互」能力的大脑。

从看见到理解再到行动,机器人这下也真正懂得物理世界,可以成为家庭的一员了。

世界统一模型:机器人也开始像人一样理解世界了

大家有没有思考过一个问题——为啥机器人很难像人一样在真实世界里自然干活?

一层是对外部世界的预测能力,另一层是身体本身具备多模态协同能力,语言、听觉、视觉、动作可以同时运转、彼此联动。

机器人难就难在这里。

它缺的从来不只是某一个单点能力,真正卡住它的,是感知、理解、预测、执行这些环节很难像人一样顺畅连起来。

而世界统一模型要解决的,正是机器人大脑里长期存在的大bug:那就是解决「模块间数据搬运」这个根本问题。

这个思路和苹果M1芯片的演变过程很类似。

在M1芯片前,CPU、NPU、GPU都是分开的,三个芯片之间每搬一次就有一次延迟,每搬一次就有很多损耗。

后来苹果干脆直接用统一内存架构,把不同计算单元放进同一套共享体系里,数据流转路径大幅缩短,整机性能也因此上了一个level~

△AI生成

而在WALL-B身上,M1芯片这种打通模块壁垒的能力,也被真正沉到了模型底层——

基于世界统一模型,WALL-B将机器人的视觉、听觉、语言、触觉等能力放进同一个网络里进行同步训练,让各模块分别工作走向整套系统协同运转。

而这套架构为小机器人们带来的第一个关键能力,就是「原生多模态」。

简单理解就是,解决「看见」和「行动」之间的信息折损问题,把视觉、语言、动作、触觉直接打通。

让机器人能够根据看到的画面进行直接反应,哪怕面对门把手,它也能知道推门时应该用多大的力度去推~

而这背后体现的,正是架构本身的多模态输入、多模态输出能力,将感知与执行真正连在一起,让小机器人们能直接理解环境,也能直接生成行动。

△AI生成

但是话又说话来,小机器人们光是能看见、能动作,其实还远远不够。

事实上,到了真实家庭场景中,机器人要面对的从来都不是标准题,而是一堆随时会冒出来的《临场状况》。

比如地上有一滩刚洒出来的水,但很多传统基于VLA架构的机器人面对这个场景,往往只能停留在看到了地面颜色不一样。

即便识别出地上有水,也未必明白「滑」意味着风险,更不会主动把这件事和绕行、清理、避险这些动作联系起来。

而这也是世界统一模型赋予小机器人们的第二个能力,那就是让机器人拥有自己的「世界观」。

不只让机器人看到世界,更开始让机器人读懂世界,建立起对现实规律的判断,理解物体背后的状态、关系和后果。

△AI生成

但这还远远不够。

因为要让真正机器人理解世界,除了理解世界和原生多模态能力外,还有另一件事:经验会不会被留下来。

但,这恰恰也是当下很多VLA系统的一道槛——

它们可以完成任务,却很难像人一样在真实环境里边做边学、越做越熟,任务一失败,小机器人就举手投降……

而基于世界统一模型,WALL-B进一步往前走了一步——它让机器人拥有了「与世界交互」的能力。

也就是从实践中不断学习的能力,并且把成功的经验更新到自己的模型参数里,下次遇到同样的处境问题时就知道怎么解决了,这样模型就完成了一次进化。

更关键的是,这种进化并不依赖工程师反复回收数据、重新训练、重新部署,机器人直接就能在真实世界里通过不断尝试、不断反馈、不断修正,完成自我迭代。

(不是,怎么突然感觉好励志啊??)

能力跃迁:机器人也有“眼力见”了

其实说到这儿,大家也确实感觉出基于世界统一模型的WALL-B模型,确实有「亿点点」不一样。

但是吧,在具体的任务执行能力上,WALL-B能做的,还不止这亿点点。

大家都知道,机器人想在物理世界里自主干活,首先得有一双真正看得懂世界的眼睛。

对于传统命令式或遥控式机器人来说,它认一个杯子,很多时候更像是在对答案,数据库里见过这个,就知道这是杯子;换个样子、换个摆法,它可能就有点懵了。

而WALL-B为机器人大脑补上的,是一套更接近人类认知方式的「部件级理解」能力——

让机器人不仅认得这是杯子,还认得它是什么材质、把手朝哪边、现在是什么状态、应该从哪里下手更合适。

让机器人真正具备所见即所认、触类旁通的视觉理解的真本领。

△AI生成

不仅如此,这套架构带来的价值,还让WALL-B第一次具备了更接近生物体的「原生本体感」。

给友友简单解释一下,就是机器人不用依赖大量外部传感器反复确认位置,就能知道自己的身体边界和动作范围。

它天生就清楚自己有多高、多宽,手臂能伸到哪里,转身会不会碰到东西,动作该留出多少余量~

有朋友该说了,让机器人知道这些有啥用啊?(好问题.jpg)

事实上,机器人要想在家庭这类复杂空间里稳定工作,前提就是先对自己有足够了解。

只有知道自己的身体结构、运动极限和空间占位,它在拿取、移动、转身、避障时,动作才会更自然也更稳定!!

△AI生成

与此同时,基于世界统一模型,WALL-B还具备强大的「零样本泛化能力」。

大白话说就是,哪怕面对从没见过的物体、场景和任务,机器人也不一定非要见过同款才能上手。

通过对物理世界的理解,机器人学到的已经不只是某个具体案例,而是更底层的结构关系、交互逻辑和操作规律。

既能理解环境,也能理解自己;既能执行当前任务,也能在与世界持续互动中不断调整和进化。

作为中国首个基于世界统一模型的具身基础模型,WALL-B打破了命令式机器人、遥控式机器人在真实家庭场景中依赖预设指令、难以应对变化、缺乏自主处理能力的局限。

既为行业提供了可量化、可复制的系统能力参考,也为家庭服务和工业应用场景的模型部署树立了新的行业样本。

从进入家庭到自我进化,数据飞轮开始自转

在具身智能行业,一个很难不承认的事实是:最核心的资源并非算法本身,而是支撑算法持续进化的高质量训练数据。

其实这也是为啥很多看起来动作很酷炫的机器人,一到真实场景里就容易《露怯》。

而问题就出在数据源头,当前大多数机器人训练的数据都是「实验室数据」——

环境、任务都是可控且固定的,机器人几乎也是在蜜罐里长大的,糖水虽然甜,但并不会增强孩子本身的抵抗力。

自变量机器人为这类实验室数据起了一个非常有意思的名字,叫「糖水数据」。

对应到机器人训练里,就是数据量大、足够干净、采集成本相对可控,模型也更容易快速学出一套标准动作。

△AI生成

可问题也很直接:机器人最终要面对的,从来都不是一间永远整齐、永远明亮、永远按脚本运行的房间。

也正因如此,自变量还提出了另一组相对的概念,叫「牛奶数据」——也就是真实家庭场景里产生的数据。

牛奶数据更像是真正有营养的日常饭,家庭环境虽然复杂、嘈杂、充满变化,但训练价值也更高。

就比如同一个「拿杯子」的任务,放到100个家庭里,几乎就会遇到100种摆放方式、100种干扰条件,对于机器人来说每一次伸手,几乎都像在面对一道新题……

当然,牛奶数据也有一个行业都清楚的难点:太难采。

它没法靠搭几个标准场景批量复制,也没法在封闭实验室里低成本生成,团队得把机器人真正带进家庭,一家一家去跑,一次一次去试,在真实使用中记录动作、失败、修正和反馈。

但恰恰是这条最难走的路,才更接近做出「零样本泛化」模型的答案。

△AI生成

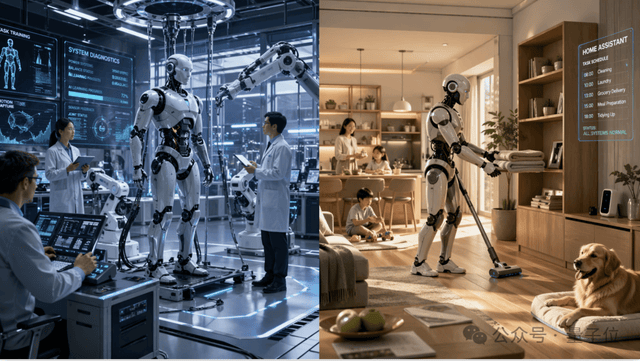

结果您猜怎么着——自变量团队,真就把机器人带进了100个家庭里了。(好家伙.jpg)

当机器人持续进入真实家庭运行之后,整个系统会逐步形成一个不断自我强化的正向循环:

机器人在家庭里执行任务,积累日常交互数据,这些数据反过来推动模型继续迭代,模型能力提升后,又能进入更多家庭、承担更多任务、采回更多高价值数据。

当这个循环真正跑起来,数据就已经不只是训练阶段的一次性投入,而会变成模型持续成长的燃料,变成系统能力不断外溢的源头,最终形成一个越转越快、越转越强的数据飞轮。

实验室数据帮机器人打基础,真实家庭数据让机器人开始长出「见过世面」的能力,而这也让WALL-B构建起难以复刻的最高壁垒。

△AI生成

其实放眼整个具身智能赛道,行业最缺的从来都不是一两个会翻跟头、会做展示动作的机器人。

真正稀缺的,是能够在真实世界里持续学习、持续适应、持续进化的系统能力。

从这个意义上看,WALL-B的价值并不只是在于进了100个家庭,也不只是在于采到了多少条真实数据,而是在于它率先验证了一条更接近终局的路径——

让机器人从实验室里学会动作,再到真实家庭里学会生活;让模型从被动接受训练,逐步走向在真实世界中主动完成进化。

让机器人真正融入家庭,这一次,想象成真了

说实话,这两年我们看到了太多在视频里花样演示的机器人——

翻跟头、打拳跑跳,一个比一个热闹,但热闹归热闹,很多能力依然停留在demo演示层面。

一旦离开预设环境进入真实世界,泛化能力、主动性,以及对周围环境的理解能力,往往还是差了一截。

这其实也解释了,为什么很多人一提到家庭机器人,第一反应往往还是有点模糊:它到底还能帮我们做什么?

我们习惯了它扫地、拖地,却很少认真想过,机器人有没有可能进一步接手那些生活里很细碎、很日常、甚至已经被我们默只能自己做的小事。

△AI生成

理由很简单——家庭场景几乎是机器人最难应付、也最难伪装的考场。

也正因如此,自变量选择让机器人真正入驻家庭这一步,才显得格外有分量。

让机器人真正走进家庭、直接面对用户,需要的从来不只是技术能力,还有把产品交给真实世界检验的勇气。

在与家庭成员持续交互的过程中,WALL-B能够让机器人逐渐理解生活节奏、习惯偏好,并把这些经验沉淀为自己的能力。

这样一来,机器人承担的角色也在变,它开始从一个执行指令的设备,慢慢进入家庭日常运转的内部,成为更贴近生活的人力补充。

或许呢,我们可以把想象力再往外扩展那么亿点点——

没准过不了多久,在家政和养老这事儿上也能随处可见小机器人的身影了~

随着这些能力在真实场景中不断沉淀,自变量机器人大脑也已然进入全新阶段。

而在这过程中,自变量机器人也让整个行业第一次更清晰地看到,家庭场景并不是一个停留在想象里的终点,而是具身智能真正能够训练能力、验证能力、放大能力的关键现场。

WALL-B带着它那颗聪明的脑子在验证一种更接近未来的路径,而自变量机器人也给整个具身智能行业提供了一个可参考、可观察、也更有现实感的发展样本。

梦瑶

梦瑶