超声领域迎来大型预训练模型!

实时且无辐射的超声影像,已成为临床诊断的重要手段。

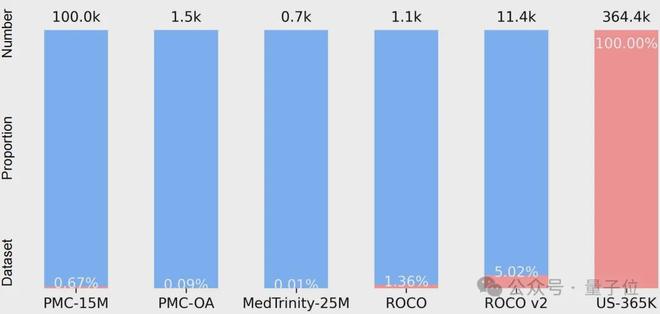

然而,异质化的解剖结构和多样的诊断属性使得通用视觉语言预训练模型难以直接应用,加之现有医疗跨模态数据中用于超声样本的比例不足5%,成为该领域研究的关键瓶颈。

为了克服这些挑战,浙大城市学院联合浙江大学、香港城市大学及多家附属医院等机构,建立了首个大规模的专用于超声影像的数据集US-365K,并提出了专门为超声设计的语义感知对比学习框架Ultrasound-CLIP。这一成果已被CVPR 2026接收,相关数据集和代码已开源。

研究的核心问题:跨模态学习面临三大障碍

当前视觉语言模型在应用到超声领域时遇到了三个主要难题:

数据短缺明显:主流医疗跨模态数据库中以CT、MRI为主,缺乏大比例的超声样本数据;

语义模糊难对齐:由于超声诊断报告表述多样,相同病变有不同的描述方式,传统对比学习难以精确界定正负样本,容易产生语义偏差;

缺乏临床结构先验知识:超声诊断依赖病灶与属性的复杂关联,通用模型无法准确建模这些专业的临床推理逻辑。

针对这些问题,团队提出了UDT知识框架,并构建了US-365K数据集,同时设计了专为超声场景量身定制的Ultrasound-CLIP语义感知对比学习架构。该体系旨在实现双重核心技术突破,解决现有模型在理解和处理超声影像时遇到的关键挑战。

第一阶段:建立UDT知识框架与标准化US-365K数据集

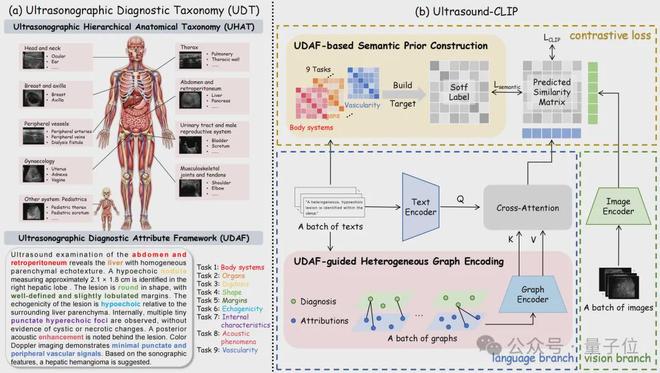

团队首先制定了一个完整的超声诊断分类系统(UDT),为超声数据的标注和学习提供了统一的标准。这一体系包括两个核心部分,实现了对超声诊断知识的结构化表达:

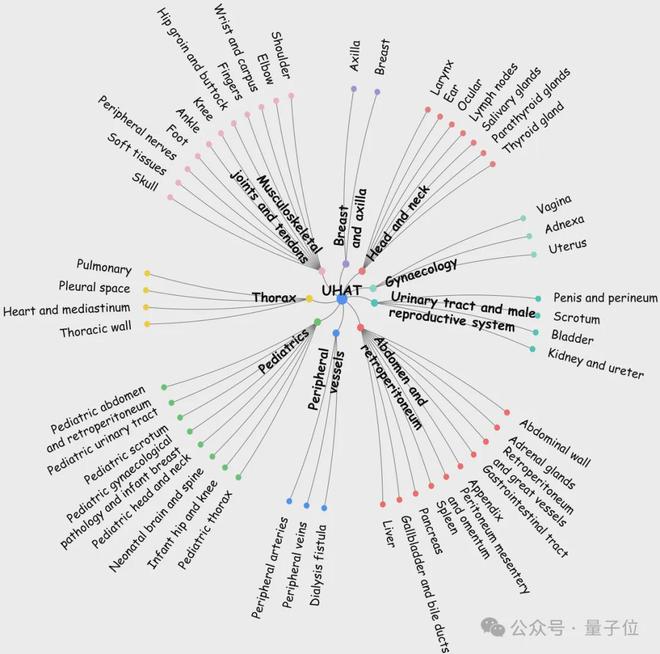

超声层级解剖分类(UHAT):通过梳理9大人体系统的52个器官及其层级关系,并明确了各个器官在不同层次中的归属及相互联系,解决了各种数据源中解剖学分类混乱的问题;

超声诊断属性框架(UDAF):确定了临床医生解读超声影像时的关键九个维度,并为每个维度定制了描述词汇表,从而形成了一个标准化的超声诊断报告体系。

通过UDT标准框架,团队从五个国际权威医疗数据库中收集了大量的超声数据。经过一系列处理步骤,包括过滤非相关内容、将视频分解成静态图像帧及基于UDAF进行标注等,最终构建了US-365K数据集,该数据集包含超过36.4万对的图像和文本样本以及11676个临床病例。

US-365K是业内首个完全专注于超声的大规模图文数据库,填补了大规模标准化跨模态数据在该领域的空白,并为后续研究提供了高质量的数据支持。

第二阶段:提出Ultrasound-CLIP架构,实现精准语义建模与对齐

为了应对超声场景中的模糊语义和结构缺失问题,团队设计了一个创新的对比学习框架——Ultrasound-CLIP。该框架在传统的双编码器基础上引入了UDAF引导的异质图编码器和基于UDAF的语义软标签模块,并采用双目标优化策略。

通过这一架构,模型能够捕捉到超声诊断的专业逻辑,突破了一般模型仅能进行关键词匹配的局限性。

(1)利用UDAF引导的异质图编码器来建模临床属性的结构化关联

团队将每个超声样本的文本标注转换为一个特定的异质图。通过定义诊断节点和属性节点,根据标准化标签确定激活节点集,并在两者之间建立二分连接,形成了病灶与属性之间的联系。

采用轻量级的异质图神经网络对异质图进行编码,生成包含节点关联信息的嵌入,并进一步融合原始文本表示,从而使得模型能够理解超声诊断中的专业语义逻辑。

(2)基于UDAF构建连续性软标签以实现细粒度相似度测量

团队摒弃传统的硬标签方法,采用9个诊断维度的标准化标签相似度矩阵来计算样本之间的语义亲和力,并据此形成软先验矩阵。

这种方法有助于识别超声报告中的细微语义重叠,解决其表述多样带来的模糊性问题。

(3)双目标优化策略实现跨模态精准对齐与语义规范化

该框架采用对比损失和语义损失相结合的优化方式,使模型在图像-文本匹配精度及语义特征正则化方面均表现出色:

对比损失(L(CLIP)):通过最大化正样本之间的相似度并最小化负样本间的差距,实现了跨模态的基础对齐;

语义损失(L(semantic)):融合了MSE和KL散度来确保模型预测的相似度矩阵与UDAF基线软先验的一致性。

实验表明,双目标优化策略能够使Ultrasound-CLIP在超声图像文本理解方面表现出色,并且具有良好的泛化能力。

在多任务分类和图像-文本检索等任务中,Ultrasound-CLIP的性能超过了现有的基线模型;同时,在乳腺、胃肠等多个下游数据集中也展示了强大的零样本及全微调适应性。

资源共享:推动超声AI研究

为促进该领域的进一步发展,团队已将相关代码和US-365K数据集公开发布,以便其他研究人员可以复用这些资源进行深入探索。

通过双目标联合优化,模型既能实现超声图像与文本的精准跨模态对齐,又能精准捕捉超声诊断的细粒度语义特征,真正理解超声的临床语言。

实验验证:全任务性能领先,泛化能力适配多临床场景

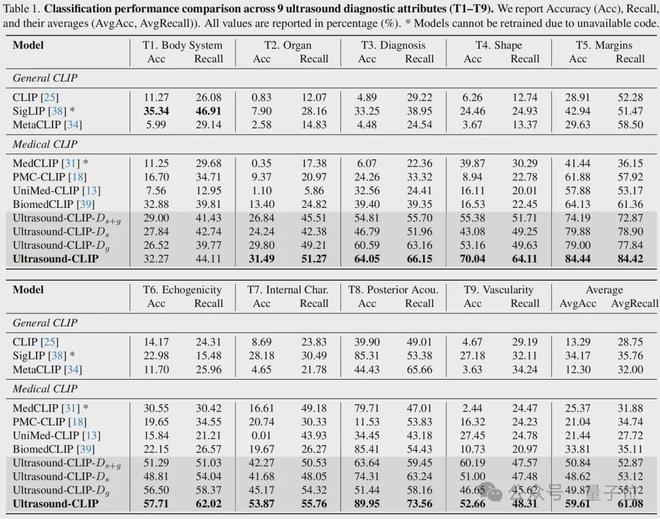

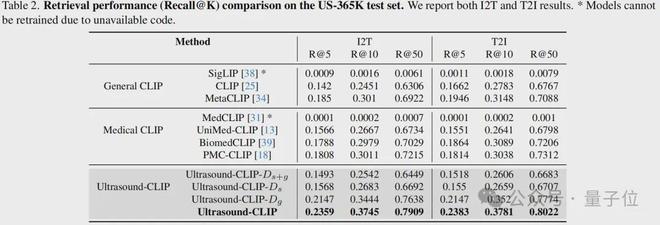

团队以US-365K为基础,在多任务分类、图像-文本检索任务中开展实验,并在4个公开的超声下游数据集上验证模型泛化能力,结果显示Ultrasound-CLIP全面优于现有医疗CLIP基线模型:

多任务分类:平均准确率达59.61%,其中病灶边缘、诊断结果等核心临床属性的识别准确率分别达84.44%、64.05%,能精准捕捉超声诊断的关键信息。

图像-文本检索:图像到文本检索(I2T)@10达37.45%,文本到图像检索(T2I)@50达80.22%,实现超声图文的高效双向匹配。

下游泛化:在乳腺、胃肠超声等4个数据集的零样本、线性探测、全微调任务中均取得最优性能,可适配不同超声临床诊断场景。

资源开源:助力超声AI领域共同研究

为推动超声跨模态学习领域的发展,团队已将研究相关的代码和US-365K数据集公开,为后续研究者提供可直接复用的基础资源。

论文标题:

Ultrasound-CLIP: Semantic-Aware Contrastive Pre-training for Ultrasound Image-Text Understanding

作者:

Jiayun Jin, Haolong Chai, Xueying Huang, Xiaoqing Guo, Zengwei Zheng, Zhan Zhou, Junmei Wang, Xinyu Wang, Jie Liu*, Binbin Zhou*

单位:

浙大城市学院、香港浸会大学、浙江大学、浙江大学医学院附属第一医院、浙江大学医学院附属妇产科医院、香港城市大学

发表:

CVPR 2026

arxiv论文地址:

http://arxiv.org/abs/2604.01749

项目地址:

https://github.com/ZJUDataIntelligence/Ultrasound-CLIP

数据集地址:

https://huggingface.co/datasets/JJY-0823/US-365K

作者简介:

本文第一作者为金佳云,浙大城市学院硕士生,研究方向为多模态大模型。本文在周斌彬副教授和刘洁博士的指导下完成。