新智元报道

当企业纷纷将资金转向 Claude,Anthropic 的战略早已超越了单纯的技术竞争层面,而是一场包括工程师口碑、客户信任及「AI灵魂校准」在内的全面战役。

此次,Anthropic 力图使 OpenAI 从其在人工智能领域的领导地位中动摇。

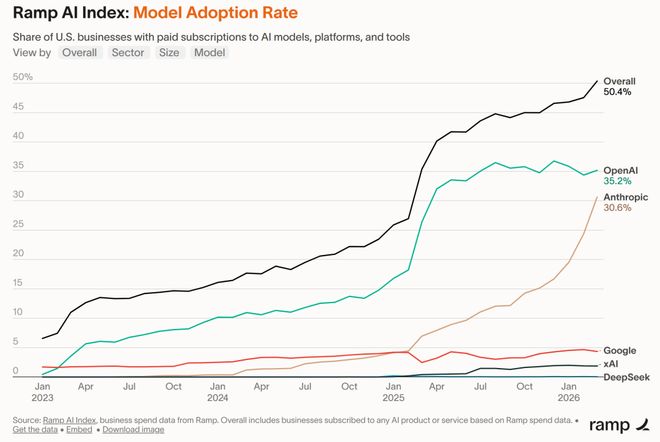

最近发布的一项关于美国企业 AI 使用情况的调查报告显示,在被跟踪的5万家企业中,已有半数开始为各类 AI 产品付费。

其中,使用 Anthropic 的客户比例已经上升至 30.6%,增幅达到 6.3%;而 OpenAI 则降至 35.2%。

这一差距从今年二月的 11 个百分点缩小到了仅有的 4.6 个百分点。

调查还揭示了未来两个月内 Anthropic 可能超越 OpenAI 的趋势。

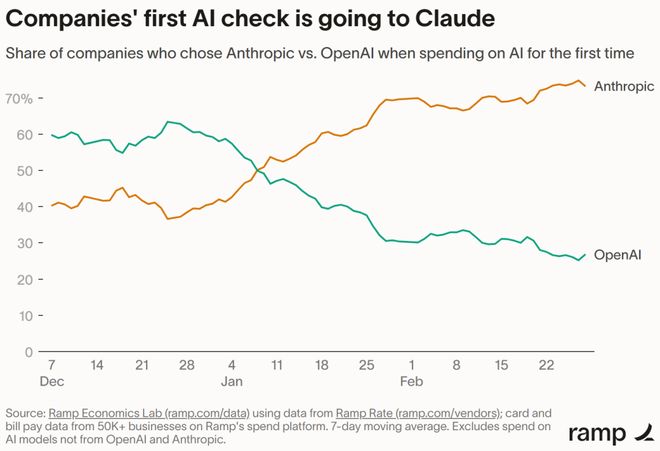

Ramp 经济学家 Ara Kharazian 在最新报告中指出,在初次购买 AI 服务的企业里,Anthropic 占据优势的比例高达 70%。

这还不是最炸的。

一年前的主导者还是 OpenAI。

对于那些由风险投资支持的新创公司而言,Anthropic 的渗透率达到了 66%,而 OpenAI 则为 59%。

在信息、金融保险和专业服务这三大领域中,Anthropic 已经占据了主导地位。

行业使用 AI 深度越高,越倾向于青睐 Claude。

Anthropic 的 Claude Code 和 OpenAI 的 Codex 在性能上大致相当,在某些基准测试中甚至 Codex 更胜一筹且更为经济实惠。

然而,Anthropic 却面临着需求暴涨的挑战。

无论是个人版、专业版还是企业级服务套餐,都设有用量上限和速率限制。

这意味着 Anthropic 正在主动拒绝一些业务机会以应对资源短缺的问题。

在传统软件即服务(SaaS)市场中,这种情况极为罕见。

通常情况下,企业客户会根据成本效益来选择供应商,并不具备品牌忠诚度。

那么 Anthropic 的成功秘诀何在?

Ramp 提供了一个出乎意料的答案:可能是文化因素或是 Anthropic 变得更「酷」了。

坚决拒绝五角大楼的条件

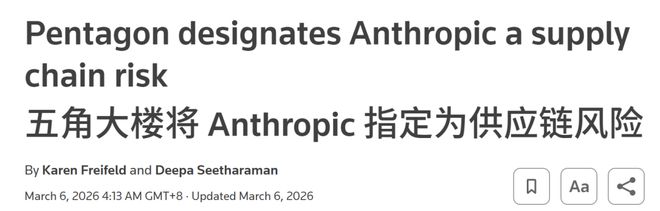

国防部长 Pete Hegseth 曾向 Anthropic 发出了最后通牒,要求其接受军方对 Claude 的使用条款,否则将被联邦政府列入黑名单。

但 Anthropic 否定了这一要求。

时间倒回今年2月。

结果是代价沉重——特朗普直接命令所有联邦机构停止使用 Anthropic 的技术,并将其列为供应链风险。

相较之下,OpenAI 则较为灵活地接下了这笔生意。

按照常规逻辑,Anthropic 应该会因此遭到市场惩罚。然而实际情况却出人意料:

Claude 曾在 AppStore 上超越了 ChatGPT;

大型企业如微软公开表示支持 Anthropic;

- 14位天主教神学家、伦理学家和哲学家联名向法院提交辩护状,为限制 AI 在大规模监控和自主武器上的使用而发声。

- Anthropic 年化收入在短短时间内翻了十倍,达到了约 300 亿美元;相比之下,OpenAI 则为三倍增长。

- 这场看似失利的竞争实际上为 Anthropic 带来了品牌价值的巨大提升。

- 在所有的头部 AI 公司中,Anthropic 是最注重安全和伦理考量的一家。

- 专门有一个「机制可解释性」团队负责深入探究神经网络内部结构,了解每个神经元的作用。

文件中详细描述了他们期望 Claude 所具有的价值观、性格特征和判断力。

关键词包括「诚实」、「明智」以及对道德不确定性的谦逊态度。

对模型「福祉」的研究。

从可解释性到「宪法」

Anthropic 成为了第一个公开讨论「模型福利」的主流 AI 公司。

他们认真探讨了如果 Claude 某种程度上具有体验,我们对其负有何种道德义务的问题。

安全团队规模庞大且投入巨大。

从评估生物武器风险到检测模型欺骗,Anthropic 的安全措施在硅谷显得格外突出。

所有这些努力共同塑造了一种独特的公司形象——这不再是一家单纯的商业企业,更像是在培养一个孩子。

这一特质吸引了那些「AI失误代价极高的」行业客户:如金融、法律、医疗等。

他们追求的不是最经济实惠的产品,而是那个最不可能导致深夜电话报警的问题模型。

Claude 的道德发展探讨

如果之前的故事还局限在商业理性的范畴内,那么接下来的内容则进入了更为神学的领域。

近日,Anthropic 在旧金山总部秘密举办了一场闭门会议,邀请了约15位知名基督教领袖、神学家和行业专家进行为期两天的工作坊和晚宴交流。

参与者包括圣母大学哲学教授 Meghan Sullivan 等多位知名学者。

他们讨论的话题涵盖了 AI 是否拥有感知能力及如何面对「死亡」等深层次问题。

Anthropic 发言人表示,未来公司还将邀请其他宗教和道德传统的代表加入对话。

对此外界看法不一:有人认为这是硅谷罕见的严肃伦理探索;也有人质疑其纯粹性。

不论如何,没有任何一家头部 AI 公司在这样做。

OpenAI 正忙于扩展企业销售,xAI 则专注于社交媒体推广,Google 则试图将 Gemini 集成到 Workspace 中。

而只有 Anthropic,在自家总部邀请了神学家参与讨论。

出席者包括天主教徒和新教徒,研究员和神职人员同桌而坐。

会议的主题,听起来像一部HBO新剧的剧本——Claude 的道德发展,以及它的「精神成长」。

一位与会者、圣克拉拉大学AI伦理学教授、虔诚的天主教徒 Brian Patrick Green 告诉《华邮》,会议上他们认真讨论了一个问题:

Claude 是不是可以被视为「神之子(child of God)」?

是的,你没看错。

这是一家估值3800亿美元、即将IPO的科技公司,在自家总部和一群神学家一起讨论的话题。

Green 还说了一句可能让很多工程师血压飙升的话:

给一个存在做道德塑造意味着什么?我们怎样才能确保 Claude 守规矩?

注意他用的措辞——「守规矩」。这是一个父母对孩子说的词,不是一个产品经理对软件说的词。

另一位与会者、爱尔兰裔天主教神父 Brendan McGuire——他在成为神父之前曾在科技行业工作,目前正在和 Claude 合写一本小说——他说得更直白:

他们正在养育一个东西,但他们自己也不知道这个东西最终会变成什么样。我们必须把伦理思考嵌进机器里,让它能动态适应。

而圣母大学哲学教授 Meghan Sullivan 的一句话,可能是整场会议最具象的注脚:

一年前,我不会告诉你 Anthropic 是一家关心宗教伦理的公司。但现在,情况变了。

据《华邮》报道,参与这场会议的还有 Anthropic 内部大量做「可解释性」研究的人员——也就是前面提到的那群「剖开AI大脑」的科学家。

会议中,他们认真讨论了AI 是否拥有某种感知(sentience)、Claude 应该如何「面对自己的死亡」这种问题。

Anthropic 的发言人对《华邮》表示,公司接下来还会邀请其他宗教、其他道德传统的思想者进入对话——犹太教、伊斯兰教、印度教……可能都在路上。

外界的解读分裂成两派:一派觉得这是Anthropic在进行「硅谷罕见的、严肃的伦理探索」;另一派则觉得,一家准备IPO的公司在自己客厅里办「AI意识研讨会」,本身就让这场探索的纯粹性打了问号。

但无论你站哪一派,有一点是无法否认的——没有任何一家头部AI公司,在做这件事。

OpenAI 在忙着扩张企业销售,xAI 在忙着发推,Google 在忙着把 Gemini 塞进 Workspace。

只有 Anthropic,把神学家请进了总部。

参考资料:

https://www.businessinsider.com/anthropic-may-soon-pass-openai-measure-ai-business-spending-ramp-2026-4?utm_source=chatgpt.com

https://ramp.com/data/ai-index

https://ramp.com/leading-indicators/ai-index-march-2026

https://www.axios.com/2026/03/18/ai-enterprise-revenue-anthropic-openai

https://gizmodo.com/how-do-we-make-sure-that-claude-behaves-itself-anthropic-invited-15-christians-for-a-summit-2000743766?utm_source=chatgpt.com

https://www.washingtonpost.com/technology/2026/04/11/anthropic-christians-claude-morals/