新智元报道

Anthropic的联合创始人Jack Clark,在研究大量公开数据后,得出了一个惊人的结论:到2028年底之前,AI自我生成的可能性高达60%。

有人认为,未来不久,AI将具备自行构建自身的潜力。

这位专家就是Anthropic公司的创立者之一Jack Clark。

在今年的5月4日,Clark于X平台上发文指出:“我认为,在2028年底之前实现递归自我改进(RSI)的概率为60%。”

除此之外,他还担任《Import AI》的创始人兼主要撰稿人,专注于追踪AI能力的发展。

发布该推文的同时,Clark在自己的专栏中发布了一篇深入的文章。

文章详细分析了这一现象及其背后的原因和依据。

这一前景让Clark感到既震惊又困惑。他表示,虽然他不愿意接受这个观点,但这种变化的影响实在太深远,以至于让人感到渺小,并质疑社会是否已准备好应对由此带来的挑战。

在他的文章中提到,如果这一现象发生,人类将迈入一个难以预测的新时代。

虽然他认为RSI不会在2026年实现,但他预计一两年后可能就会有非前沿模型出现初步的概念验证:即某一代AI能够端到端地训练出它的继任者。

支撑他这一结论的依据主要来自于公开资源中的信息,包括arXiv、bioRxiv和NBER上的论文以及他对各大实验室产品的持续观察。

他认为,今天所有的技术组件都已准备就绪,接下来的问题是:模型何时能够积累足够的创造力来推动前沿的发展?

四年

从30秒到12小时

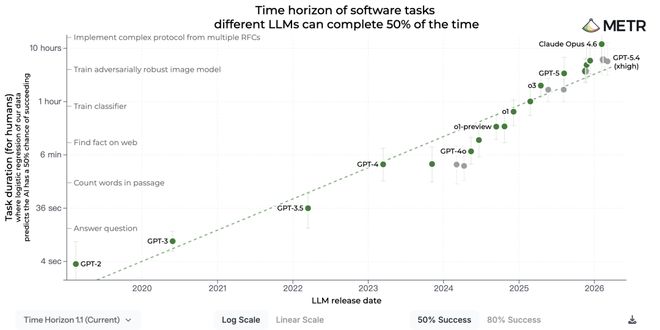

Clark的核心论据在于一系列能力的进展曲线。

METR机构的时间轴图显示了这一趋势。

根据METR的数据,AI系统能独立完成任务的成功率正在迅速提高。

从2022年到2026年的短短几年间,GPT系列模型的性能已经从30秒飞跃到了12小时。

- AI能力研究员Ajeya Cotra预测,在2026年底前,这一数字有可能突破至100小时。

- 与此同时,编程能力也在迅速提升。

- 截至2025年,Claude Mythos Preview已经达到了93.9%的得分水平。

- 从2024年到2026年的测试成绩中可以看到显著的进步。

- Anthropic内部的另一个测试也表明,模型优化小型语言模型训练代码的速度正在迅速增加。

此外,Clark认为大部分AI研究工作属于“汗水”型任务,如数据清洗、实验和参数调整等,而非创新性的灵感。

他进一步指出,即使偶尔出现重大突破(例如Transformer架构),这些也仅占整个过程的1%,而其余99%的工作正被快速自动化的进程所接管。

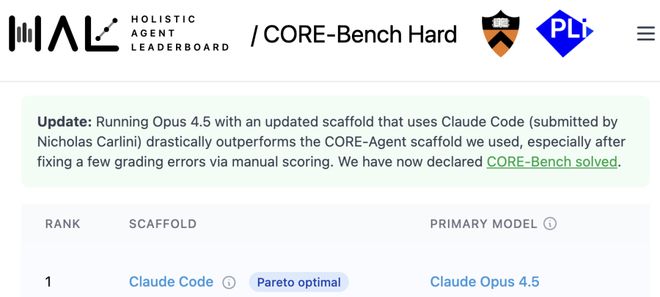

AI已经能在某些方面管理其他AI系统。比如Claude Code这类工具可以分配任务给多个子AI并汇总结果,这与人类团队运作方式相似。

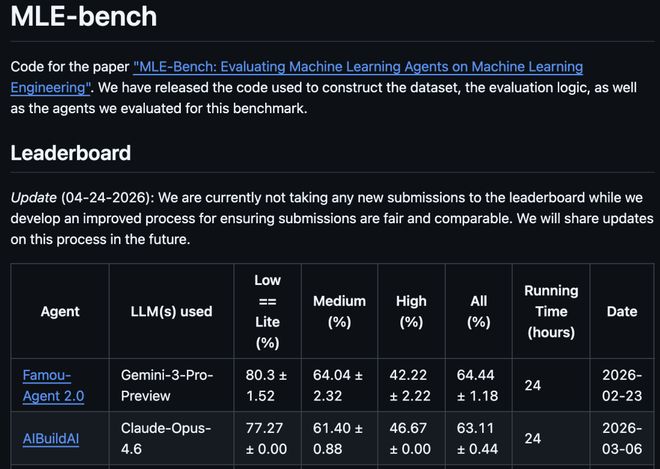

PostTrainBench测试显示了AI在微调模型以提升特定任务性能方面的进展。

截至2026年3月,AI系统在这方面已经能接近人类研究员的水平。

Anthropic内部的一个概念验证项目也展示了AI在解决AI安全和对齐问题上的潜力。

Clark综合这些证据认为,当前技术已能够自动化大部分AI工程任务,并且迹象显示AI研究也有望实现进一步的自动化。

然而,Clark的文章发布后引发了业内的一些质疑。

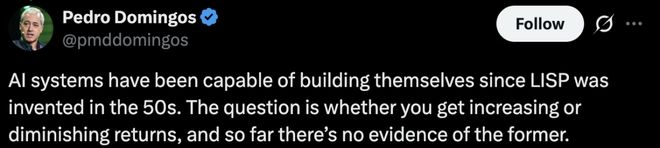

华盛顿大学机器学习教授Pedro Domingos指出,从LISP发明以来,AI就有能力构建自己。然而,如果这个过程带来的只是递减而非递增回报,则其重要性有限。

另一位研究者Dan Brickley则提出了对“RSI”定义的疑问。

一个账号名为@crepesupreme的人士提出,AI概率从2027年的30%到2028年的60%,暗示可能存在某个关键事件导致了这种跳跃式增长。

对此Clark回应说,他认为创意突破是进入“自我研发”循环的关键。如果没有这样的突破,RSI的可能性将大大降低。

同时他也承认自己的预测只是一种概率估计,并非确定的时间点。

- 有人问为何他不直接向公司内部研究员获取信息,Clark解释说公开数据才是具有可信度的来源。

- 他列举了一些早期迹象表明,AI正在尝试解决复杂的数学问题和发现新证明。

- 更重要的是,一旦这一现象成为现实,随之而来的问题将更加严峻。例如如何治理这些系统?

- 连Clark自己也在文章中表达了自己的担忧:当前的对齐技术在经过多代迭代后其准确率将迅速下降。

Clark试图通过这篇文章提醒人们讨论、研究和制定治理策略的时间紧迫性。他认为留给这些问题的答案时间窗口正在缩小。

据报道,OpenAI的目标是让其AI在2026年达到“实习研究员”水平,并于2028年实现完全自动化;同时Anthropic也正在进行相关概念验证工作。

99%的工程活

AI快接完了

整个行业都在朝着这一目标加速发展。Clark认为无论从哪个角度来看,所有的数据都指向同一个方向:随着时间推移,AI的能力将不断增强,且没有减速的迹象出现。

Clark给出了一个框架,引用了爱迪生那句话:天才是1%的灵感和99%的汗水。

他认为,AI研究也是如此。

一个典型的AI研究循环是这样的:拿一个现有系统,在某个维度上扩大规模,观察什么地方开始出问题,修掉工程问题,再扩大一轮。

这个过程里,大部分工作是数据清洗、跑实验、调参数、读论文、复现结果,这些都是「汗水」,不是「灵感」。

偶尔会出现真正改变范式的发明,比如Transformer架构,比如混合专家模型(MoE)。但那是1%,而且这1%越来越不是瓶颈,因为那99%的工程工作正在被AI快速接管。

Clark列了几个信号:

AI已经能管理其他AI。Claude Code、OpenCode这类工具里,单个AI可以扮演「项目经理」,把任务分发给多个子AI并行处理,之后汇总结果。

这和一个人类研究团队的组织方式没有本质区别。

PostTrainBench测试了一件事:AI能不能自己微调开源小模型,提升它在某个任务上的表现?

这个工作通常是前沿实验室里有经验的研究员在做。

截至2026年3月,AI系统在这个任务上能做到人类研究员效果的一半左右,大约是25%到28%的提升幅度,而人类基线是51%。

https://posttrainbench.com/

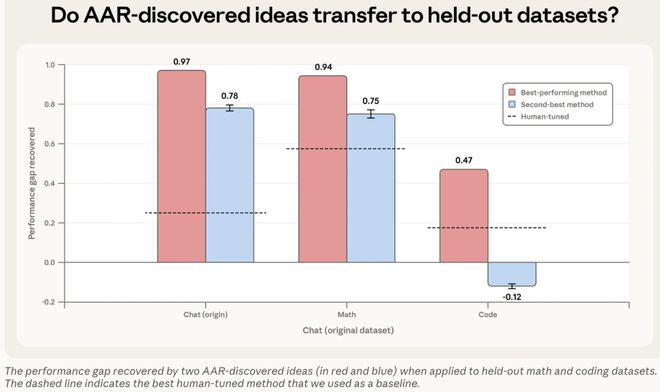

Anthropic内部还有一个「自动化对齐研究」的概念验证:让一组AI agent,在AI安全研究问题上自主攻关。

结果是,AI给出的方案超过了Anthropic人类研究员的基线。

https://www.anthropic.com/research/automated-alignment-researchers

Clark把这些证据串在一起的判断是:AI今天已经能自动化AI工程的绝大部分,AI研究里有多少能自动化,还不完全清楚,但迹象已经很明显。

质疑声也来了

Clark的帖子发出后,行业里也出现了一些质疑。

华盛顿大学机器学习教授,《终极算法》作者Pedro Domingos回复到:「从LISP在50年代发明以来,AI就能构建自己了。问题在于,这个过程究竟能带来递增回报还是递减回报——而目前没有任何证据支持前者。」

递归自我改进听起来很科幻,但能循环不等于循环有收益。如果每一代AI优化自己的效率只有边际改善,而不是指数级放大,那这件事的影响范围会非常有限。

还有人质疑概念边界。「RSI到底有没有一个权威定义?」一位名叫Dan Brickley的研究员问道。

另一个更尖锐的观察来自账号@crepesupreme:

2027年30%,2028年60%。一年内概率跳升30个百分点,意味着2027到2028年之间存在某个不连续的能力事件。那个具体事件是什么?

Clark在通讯文章里回应了这个隐含问题:他认为AI研究仍需要某种创意突破才能真正进入「自我研发」循环:AI目前在这一块还没有变革性的表现。这正是他给2027年只打30%的原因;而如果这个缺口在2028年底前被填上,概率就升到60%。

但他同时也承认,自己预判的是概率,而不是确切的时间点。

还有人问他:「你在Anthropic工作,你为什么要去翻公开数据?直接走下楼去问研究员不就行了?」

Clark的答案是:用公开数据,是因为公开数据才有可信度。他要的不是内部判断,是一个任何人都能独立核验的结论。

窗口还开着

但在缩窄

Clark在通讯文章里写:他为什么不给2027年更高的概率?

因为他认为AI研究还包含一些对创意直觉的要求,而AI目前在这一块只有「诱人的早期信号」,还没有系统性突破。

他列了两个信号:一个是Gemini模型参与攻克Erdős数学问题,在700个问题里解出了1个被数学家认为有一定原创性的解。

另一个是斯坦福、UBC等机构与Google DeepMind合作,AI在发现新数学证明中起到了「非常实质性的作用」。

这些结果在AI能力演化的时间轴上,可能是某种早期信号。

Clark的估计是:如果2028年底没有出现他描述的情况,那说明当前技术路径存在某个根本性的能力天花板,需要人类的创意才能突破。

更关键的是「如果出现了」之后的问题。

Anthropic在2026年3月宣布成立The Anthropic Institute时,官方声明里写了这样一句话:

如果AI系统的递归自我改进确实开始发生,那么世界上谁应该被告知,以及这些系统应该如何治理?

https://www.anthropic.com/news/the-anthropic-institute

连Anthropic自己,都还没有这个问题的完整答案。

Clark在通讯文章里给出了一个更技术性的担忧:今天的对齐技术,如果有99.9%的准确率,在递归迭代50代之后,准确率会跌到95.1%;迭代500代之后,跌到60.5%。

除非你的对齐方案在理论上能保证在更智能的系统上同样有效,否则问题会很快出现。

也许,Clark想要说的是:治理窗口是有限的,而且它正在缩窄。他希望通过文章发出一个提醒:这件事留给讨论、研究和治理设计的时间,比大多数人想象的短。

据奥特曼直播及媒体报道,OpenAI的目标是让AI在2026年9月前达到「AI 研究实习生」水平,2028年达到更完整的自动化研究员;Anthropic自己也在发表自动化对齐研究的概念验证;一家叫Recursive Superintelligence的新公司刚刚完成5亿美元融资,其目标之一就是自动化AI研究。

整个行业已经在朝这个方向加速了。

Clark说,无论从哪个维度看,数据都指向同一个方向,而每一条曲线,都在向右上方飞,时间越长,能力越强,而且没有任何一条显示出减速的迹象。

参考资料:

https://x.com/chatgpt21/status/2051314386317295758

https://importai.substack.com/p/import-ai-455-automating-ai-research

https://www.anthropic.com/research/automated-alignment-researchers