最新研究揭示了Kimi如何将KVCache转化为创新商业模式。

超长上下文福音

衡宇 发自 凹非寺

近期,一项新的研究成果展示了Kimi在长上下文处理上的突破性进展。

本次研究的重点在于大模型推理架构的跨机房调度难题。

研究团队提出了一种名为Prefill-as-a-Service(简称PrFaaS)的新模式,实现了预填充即服务的功能。

PrFaaS的核心创新之处在于让KV Cache能够跨越数据中心传输,并将Prefill和Decode分离到不同的异构集群中运行。

这意味着Prefill与Decode可以在不同地域之间进行调度操作。

特别是在处理长文本时,其效率更加显著。

该研究由月之暗面及清华大学郑纬民院士、武永卫教授团队共同完成。

实验结果表明,在内部测试中PrFaaS-PD架构表现出色,与传统同构PD部署相比,吞吐量提升了54%,P90延迟降低了64%;即使对比未做智能调度的单纯异构方案,其性能依然提高了32%。

跨数据中心传输仅需使用13Gbps带宽,远低于以太网的标准上限,这意味着普通的商用网络也能稳定支持该架构运行。

为何需要跨数据中心?

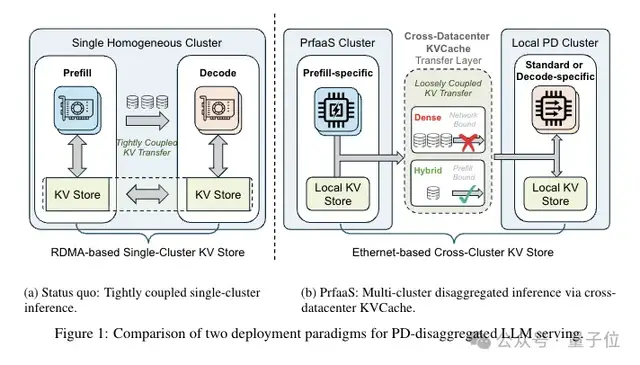

在大模型推理服务中,Prefill-Decode分离已成为行业标准配置。

然而,KV Cache传输高度依赖RDMA网络,使得这种分离只能在单一集群内实现。

这背后是怎么做到的?

如果最适合执行Prefill和Decode的硬件设备不在同一机房,那么它们之间将无法有效协同工作。

强制性地把不同类型的硬件置于一起,则会导致资源利用率低下。

流量波动时,固定的资源配置很容易造成资源分配不均的问题。

由于KV Cache传输带宽的限制,这个问题变得更加突出。

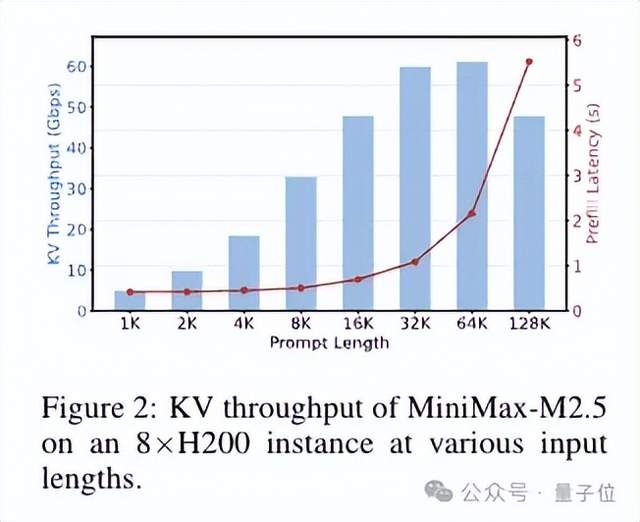

研究团队通过量化分析证明了这一观点。

比如,在MiniMax-M2.5模型中,32K上下文时单实例生成KV Cache的速度达到了60Gbps,而跨数据中心传输通常仅支持10-100Gbps的带宽,这相当于尝试用小水管承载消防水带的流量。

因此,要避免等待延迟和性能下降,Prefill与Decode之间必须通过高带宽、低时延的RDMA网络进行通信。

这就是传统PD分离架构被限制在RDMA领域内的主要原因。

然而,新一代混合注意力架构带来了新的机会。

最近推出的多种模型如Kimi Linear、Qwen 3.5、MiMo-V2-Flash和Ring-2.5均采用了线性注意力与全注意力的结合方式。

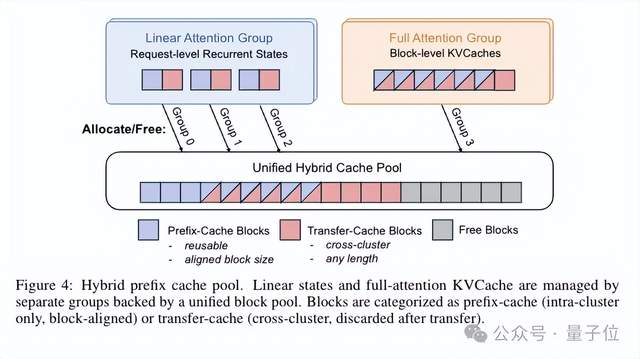

这种组合架构中,线性层产生固定大小的状态,不随上下文长度变化而增加;只有全注意力层会生成KV Cache。

实验结果显示,在32K上下文场景下:

MiMo-V2-Flash的KV吞吐量仅为4.66Gbps,比MiniMax-M2.5降低了13倍;

Qwen 3.5-397B的8.25Gbps相比于同规模密集型模型的33.35Gbps减少了约四分之三;而Ring-2.5-1T通过压缩技术和混合比例优化,整体KV内存节省了大约36倍。

这种架构将KV吞吐量从RDMA级别降低到了以太网级别。

跨数据中心的PD分离因此成为可能。

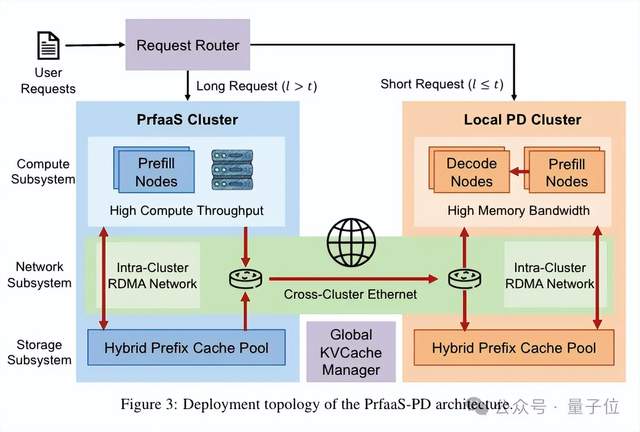

为解决跨数据中心推理问题,提出了PrFaaS方案。

- PrFaaS旨在实现长上下文请求Prefill计算在独立、高性能集群中完成,并通过普通以太网将生成的KV Cache传输至本地Decode集群执行。

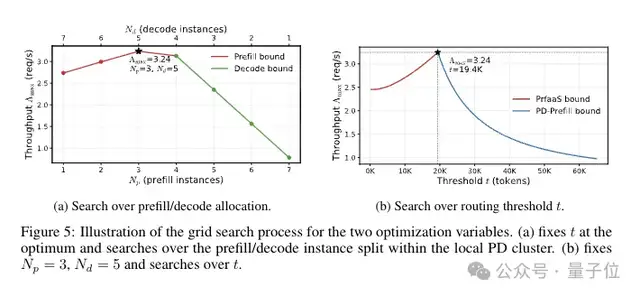

- 具体来说,系统设定了动态长度阈值t。

- 如果是短请求(未缓存长度≤t),则会在本地PD集群内处理整个流程;而长请求(未缓存长度 > t)会送往PrFaaS专用集群进行Prefill计算后返回本地执行Decode。

阈值t根据实时带宽和请求长度动态调整。

这种架构的设计不仅在理论上是可行的,同时具备工程实现的可能性。

为了验证跨数据中心KV Cache传输及PrFaaS架构的实际应用能力,研究团队基于生产级硬件环境进行了严格的对照实验。

实验选择了内部开发的一T参数混合注意力模型,并采用了与Kimi Linear相似的设计方案和配置。

此外,在保持模型性能的同时实现了KV Cache的高效压缩,为跨数据中心传输奠定了基础。

硬件方面,研究团队使用了典型的异构组合:负责长上下文Prefill的PrFaaS集群配备了32张H200,用于处理高负载计算;本地PD集群则配置有64张优化内存带宽的H20 GPU,兼顾短请求和全流程推理。

网络层面上,团队采用跨数据中心通用方案,通过VPC对等连接提供了约100Gbps的跨集群带宽,完全符合主流云服务提供商及多数据中心部署环境的要求。

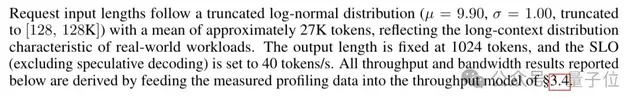

实验工作负载使用截断对数正态分布请求长度,均值约为27K tokens,高度模拟了线上长上下文服务的真实流量特征。

结果表明PrFaaS-PD架构在核心性能指标上表现优异,与同规模的同构PD集群相比,其吞吐量提升了54%,P90 TTFT(首词时延)降低了64%;而与未做智能调度的简单异构部署相比,则有32%的增长。

更重要的是,PrFaaS集群的平均出口带宽仅为13Gbps,在100Gbps的跨集群链路中占比极小,留有足够的冗余空间,保证了不会出现拥塞与链路抢占问题。

实验结果证明,在混合模型和PrFaaS调度机制协同下,KV Cache传输不再依赖RDMA网络,普通的商用以太网也能提供稳定的支撑。

本研究由月之暗面及清华大学联合完成。

第一,计算层。

参与作者包括Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li、Xinran Xu、Yongwei Wu、Weimin Zheng和Mingxing Zhang(通讯作者)。

其中,来自月之暗面的有Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li及Xinran Xu五位成员。

第二,网络层。

Ruoyu Qin是清华大学计算机科学与技术系MADSys实验室在读博士生,导师为该研究通讯作者Mingxing Zhang(章明星)教授,后者长期致力于KV Cache架构和分布式推理的研究工作。

同时,Qin也是月之暗面的员工,并担任Mooncake分布式推理系统的首席研究员。

月之暗面工程副总裁Xinran Xu也在作者名单中。

量子位注意到,在此次研究中贡献突出的五名月之暗面成员同时也是Mooncake架构的核心开发者。

此外,来自清华大学的研究人员还有Yongwei Wu和Weimin Zheng两位教授。

Weimin Zheng(郑纬民)是中国工程院院士、清华大学计算机系教授,在并行/分布处理及大规模数据存储系统领域具有深厚的科研与教学经验。

为什么这样设计?

Yongwei Wu(武永卫)是清华大学计算机科学与技术系副主任,副教授,并在AI Infra公司趋境科技担任首席科学家。

月之暗面与清华大学MADSys实验室曾联合研发并开源了Mooncake项目,趋境科技作为该项目的核心共建单位和深度贡献者参与其中。

参考资料:

[1] https://arxiv.org/abs/2604.15039

[2] https://madsys.cs.tsinghua.edu.cn/people/

在这项研究中,月之暗面与清华大学的合作展现了跨学科合作在推动技术创新方面的重要作用。通过结合理论研究和工程实践,该团队成功地解决了大模型推理架构中的关键问题,并为未来的研究奠定了坚实的基础。

对于带前缀缓存的请求,调度器会权衡缓存命中位置和带宽可用性。如果带宽紧张,优先用本地缓存;如果带宽充裕,可以从远程集群拉缓存来减少重复计算。

长期调度观察各阶段的队列深度和利用率。

当Prefill成为瓶颈时,把PD集群的节点从Decode角色转为Prefill角色;当Decode成为瓶颈时,反向调整。

这种动态重分配让系统能适应流量模式的缓慢变化。

理论可行,同时工程可用

为了验证跨数据中心 KV Cache传输与PrFaaS架构的真实落地能力,研究团队基于生产级配置开展了严格的对照实验,完整还原了异构硬件、跨域网络与真实长上下文流量的组合场景,让方案从架构设想变为可量化、可复用的工程实践。

实验选用团队内部自研的1T参数混合注意力架构模型,整体设计对齐Kimi Linear架构,采用线性注意力层与全注意力层7:1的混合配比。

此外,在保持模型能力的同时实现KV Cache的高效压缩,为跨数据中心传输奠定基础。

硬件层面,团队采用了典型异构组合。

专门负责长上下文Prefill的PrFaaS集群配备32张H200,凭借更强算力吞吐处理高负载计算;本地PD集群配备64张H20 GPU,面向Decode阶段优化内存带宽,兼顾短请求Prefill与全流程推理。

网络层面,团队采用跨数据中心通用方案,通过VPC对等连接提供约100Gbps的跨集群带宽,完全贴合主流云厂商与多数据中心部署环境。

实验workload采用截断对数正态分布的请求长度,均值约27K tokens,高度贴近线上长上下文服务的真实流量特征。

实验结果证明了PrFaaS-PD架构的工程有效性。

在核心性能指标上,相比同等硬件规模的同构PD集群,PrFaaS-PD架构将服务吞吐量提升54%;相比未做智能调度的简单异构部署,吞吐量仍有32%的提升。

在端到端延迟上,PrFaaS-PD架构带来的优化效果更为显著,P90 TTFT(首词时延)降低幅度达64%,长请求不再与短请求争抢本地Prefill资源,排队阻塞与计算拥堵问题大幅缓解。

更关键的是工程可行性指标。

PrFaaS集群的平均出口带宽仅13Gbps,在100Gbps的跨集群链路中占比仅13%,留有充足的带宽冗余,完全不会出现拥塞与链路抢占。

实验结果证实,在混合模型与PrFaaS调度的协同下,KV Cache传输可以不再依赖 RDMA,普通商用以太网即可稳定支撑。

论文团队成员介绍

这项研究由月之暗面与清华大学联合完成。

作者包括Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li、Xinran Xu、Yongwei Wu、Weimin Zheng、Mingxing Zhang(通讯作者)。

其中,研究团队成员中来自月之暗面的,有Ruoyu Qin、Weiran He、Yaoyu Wang、Zheming Li、Xinran Xu五位。

一作Ruoyu Qin(秦若愚),是清华大学计算机科学与技术系MADSys实验室在读博士生,师从本文通讯作者、清华大学计算机系副教授Mingxing Zhang(章明星),后者长期面向KV Cache架构与分布式推理。

同时,Qin也在月之暗面工作,还是Mooncake分布式推理系统的一作。

月之暗面工程副总裁Xinran Xu(许欣然)也在作者名单之列。

量子位发现,作者名单中月之暗面的五位,同样也是Mooncake架构的核心贡献者。

除上述的教授章明星外,研究团队中来自清华大学的作者还有Yongwei Wu和Weimin Zheng。

Weimin Zheng(郑纬民),中国工程院院士,清华大学计算机系教授,长期从事并行/分布处理、大规模数据存储系统领域的科研与教学工作。

Yongwei Wu(武永卫)是清华大学计算机科学与技术系副主任、教授、博士生导师,此外还担任AI Infra公司趋境科技的首席科学家。

此前,月之暗面与清华大学MADSys实验室联合主导研发并开源了Mooncake项目,趋境科技是该项目核心共建单位与深度贡献者。

参考链接:

[1]

https://arxiv.org/abs/2604.15039

[2]

https://madsys.cs.tsinghua.edu.cn/people/

衡宇

衡宇