大模型架构的下半场

华中科技大学的王兴刚团队提出了一种名为“Flash Depth Attention与混合深度注意力”的新技术。

研究人员在过去十年间一直致力于扩大模型规模,以提高计算能力,但在此过程中忽视了层间通信的有效性提升问题。

目前常用的累加方案与可能的新选择性检索方法之间的差距非常大,这表明在未来研究中采用新的机制来替代现有的操作将是至关重要的一步。

这件事亟需被改变。

研究者们认为是时候探索层之间如何进行有效对话了,而不仅仅是关注单个组件内部的信息流动。这种转变将有助于推动整个神经网络架构的发展。

Flash Depth Attention和混合深度注意力技术的提出,标志着大模型架构进入了新的发展阶段,即更加注重通信质量的时代。

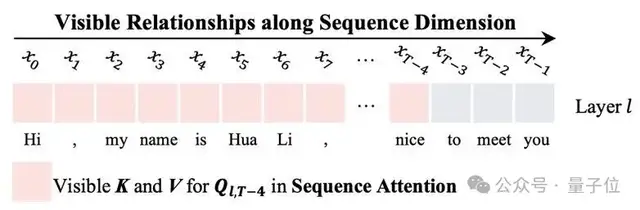

研究团队引入了因果注意力机制来解决序列维度上的信息聚合问题,并在深度维度上也应用了类似的处理方法。这使得不同层面的信息能够更高效地互相交流。

在技术实现过程中,研究者们遇到了性能瓶颈,但通过优化数据布局以适应GPU硬件的特点,成功开发出了一种高效的Flash Depth Attention机制。

上半场

为了进一步提高效率和效果,团队还提出了一种新的混合深度注意力(MoDA)方案,该方案能够在序列维度和深度维度上同时聚合信息。

在实际应用中,这种新方法显著改善了模型的性能,并且解决了之前存在的注意力汇聚问题。这表明通过改进层间通信质量可以取得重要的进步。

目前,华中科技大学视觉实验室的研究团队在这一领域取得了重要进展,他们的研究成果已经在国际顶级会议上得到了广泛的认可和引用。

该团队的代表性工作包括多模态基础模型、目标检测、分割与跟踪等多个方向,并且已经发表了大量高水平论文和技术报告。这些成果为未来研究提供了宝贵的参考依据。

总结来说,通过不断改进层间通信的质量,大模型架构将能够更好地应对日益复杂的数据处理需求,并在各种应用场景中展现出更强大的性能表现。

而深度则是另一个故事。模型确实变深了:研究团队将模型加到32层、64层、甚至100层以上。但层间通信的机制本质上还是ResNet在2015年引入的深度残差,“x + F(x)”。自它诞生以来,围绕它有过不少改良(归一化位置、残差缩放、跨层连接),但没有任何改良真正取代过那个深度残差中“+”的决定性地位。

残差连接可以说是深度学习中最重要的基石。没有它,就没有100层的Transformer,没有现代LLM,没有scaling law。但基础性方案有一个特点:它们有时会变得太过隐形,以至于没人再去质疑它到底是最优解,还是仅仅是研究团队探索出的第一个能用的方案。

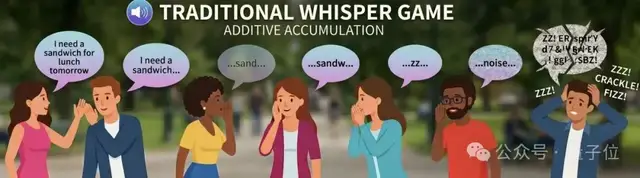

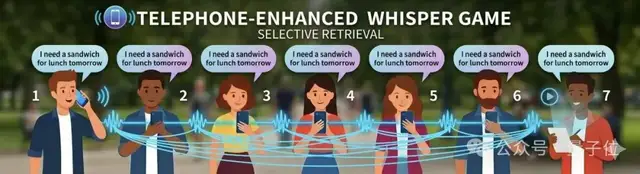

打个比方,想象一个有特殊规则的传话游戏。在标准版本里,第1个人对第2个人耳语,第2个人再对第3个人耳语。到第18个人的时候,消息已经面目全非了。这就是没有残差连接的深层网络:每一层只能看到上一层的输出。

残差连接修复了这个问题:每个人在传达自己的理解的同时,也把之前积累的原始信息原封不动地往下传。第3个人既能听到第2个人的新解读,也能听到之前的所有内容。原始信号始终被保留,它成为了不断壮大的合唱中的一个声部。

但到了第152个人,你同时在听152个声音:原始信息加上151层叠加上去的内容,全部混在一句耳语里。理论上,前面那些人的声音依然存在,但它们已经被淹没了。如果第152个人需要知道第3个人具体说了什么,他得费力地从这首宏大的合唱声中把它挑出来。

△消息累加的传话游戏中,靠后的人依然难以分辨出所需的内容

通常而言,第152个人是做不到这一点的。

这就是信息稀释。每一层都面临两难:倘若该层贡献新信息就可能会掩盖之前的内容,但保守不动则能保留之前层传过来的已有信息。这种状况下,很多层学会了保守不动,它们几乎不往残差流里写入任何东西。这样的深度网络在纸面上很深,实际上却很浅。研究团队堆了152层,但其中很多层却只学会了保持沉默。

这里的瓶颈不在于152层网络所需求的算力,而在于信息穿过这些层的通信能力。CPU的发展在几十年前就撞过同样的墙:处理器越来越快,直到内存带宽跟不上了,逼得整个行业转向缓存和通信。组织管理也一样:一群聪明人所能发挥出的创造力,也受限于他们之间的沟通、组织方式。深度学习正在经历自己的版本:十年来不断增强每一层的能力,而层与层之间的通道始终是2015年那条单车道公路。

那么,有没有更好的机制?

配方

在本文所介绍的研究之前已经有很多研究者注意到了深度瓶颈。多年来,修补方案越来越巧妙:获评CVPR best paper的DenseNet保留了每一层的输出,但代价是平方级的开销。使用可学习加权的方案DenseFormer、LIMe降低了成本,但训练完成后权重就固定了,每个token、每套上下文都用同样的权重。

字节跳动的Hyper-Connections和DeepSeek的mHC另辟蹊径,它们把管道拓宽到N个通道,层间用混合矩阵连接,这相当于信息高速公路上同时多了好几条车道。但坏消息是,信息仍然在逐层流动,第152层没有办法直接回溯到第3层。

彩云公司的MUDDFormer让混合每层输出这件事变成动态的,它会根据每个token的表征来生成权重。这在根本方向上是对的:从每一层汲取多少信息本就应该取决于你正在处理的内容。但同样有个坏消息,第152层在决定从第3层汲取多少时,只依赖第152层本身的状态,它并不知道第3层实际包含了什么。它是在预测哪些层有用,而不是在查看。

以上的每一步都修复了一个真实存在的缺陷,但却鲜有哪一个方法质疑过深度残差的框架本身。

不难发现,这些方法都有着一个共同点。从DenseNet到Hyper-Connections,每个方法都在回答同一个隐含的问题:“如何才能更好地混合各层的输出?”更好的系数,更多的通道,自适应的权重。但自始至终都是混合,自始至终都是累加。ELMo早就表明,不同的层编码的是截然不同的信息:浅层编码句法,深层编码语义。所有人得出的结论都是“学习更好的混合权重用来平衡句法和语义”。但还有一条被主流忽视的道路:如果不同层持有不同信息,也许每一层应该能够根据内容而非位置,从持有所需信息的那一层直接检索。

这就是范畴谬误:把层间通信当作累加(用学习到的或生成的系数来组合信号)而非检索(通过基于内容的匹配来选择信息)。在累加框架下,即使是动态方法也只从当前层的状态生成混合权重,而不去查看信息的来源层实际包含了什么。在检索框架下,Query(查询)编码的是“我需要什么”,Key(键)编码的是“我有什么”,而它们之间的运算决定了相关性。Query和Key双方都应该有发言权。

回到传话游戏。之前所有的方法都在试图产生一个更清晰的合唱:更好的发音、更多的中继通道、自适应的音量。没有一个质疑过这个根本约束:所有声音必须累加成一个声音吗?也没有人问过:咱是否可以直接走回去,跟之前的任何一个人当面对话呢?

研究团队认为这种范畴谬误在架构设计中无处不在。当某个东西足够好用的时候,你不会去质疑它的概念框架,而只会在框架内改进。经历了多年越来越巧妙的修补之后,研究者才明白:深度维度的残差连接需要的不是更好的系数,而是被一种根本不同的操作所替代:

一种在序列维度上已经成功解决了同样问题的操作。

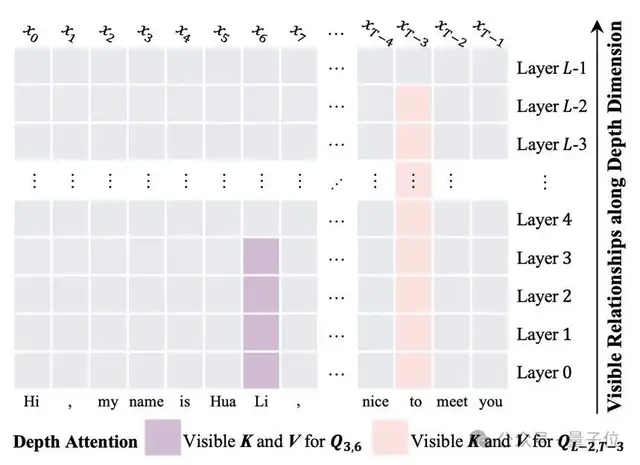

△ 因果注意力机制在序列维度(横向)上聚合信息

下半场

一旦研究团队把层间的通信理解为检索而非累加,一个很自然的答案就是在深度维度上引入注意力机制。包括研究者团队在内的很多团队都独立地收敛到了这个想法:谷歌提出的 DCA、华为的MRLA、Hessian.AI的 Dreamer、Kimi的AttnRes、以及研究者团队提出的Flash Depth Attention & MoDA,大家都尝试在层间应用点积注意力。这种独立趋同本身就是一个信号:方向走对了!

△ 深度注意力机制在深度维度(纵向)上聚合信息

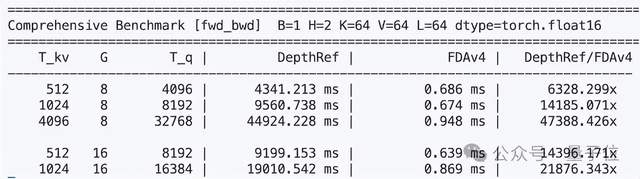

但找对方向和做出成品是两回事。研究者自述:“第一次用Pytorch实现运行深度注意力的时候,前向和反向传播共计耗时达到了44,924 ms。44秒啊!朋友们!这个时间都够我喝完一瓶500毫升的冰红茶了!”

也就是说,在深度维度上应用注意力机制的想法本身没问题,但工程现实却残酷到了极点。现代GPU为大规模的矩阵乘法做了大量优化,却不擅长数千个跨深度的极小规模的注意力操作。深度注意力作为一个计算量不大的算法,跑起来却可能慢得要命。

△Pytorch实现的深度注意力(DepthRef)很慢;Flash Depth Attention(FDA)很快。

至此,之前的方法都陷入了两难:要么简化深度注意力来换速度,这种方式丢掉了完整的选择性检索这一核心价值;要么保持完整的表达能力,但运算代价变得不可接受。研究者团队找到了一条出路:不是简化算法,而是重新组织参与计算的数据布局,从而适配GPU硬件。Flash Depth Attention(

https://github.com/hustvl/MoDA)让具备完整表达能力的深度检索快到可以参与实际训练。

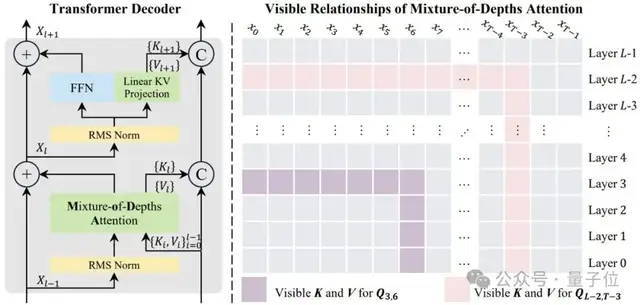

△混合深度注意力机制同时在序列维度(横向)和深度维度(纵向)上聚合信息

常规的大模型主干流水线是:残差连接→序列注意力→残差连接→FFN(前馈网络)。

有了高效的深度检索之后,研究团队注意到网络的主干流水线变成了:深度注意力→序列注意力→深度注意力→FFN(前馈网络)。这三个连续的注意力操作作用于不同的Key(键,缩写作K)和Value(值,缩写作V),却共享着近乎相同的Query(查询)。一个很自然的做法就是把它们融合。

研究者团队提出了混合深度注意力(Mixture-of-depths Attention,MoDA)将深度检索和序列检索合并到一个统一的softmax中。每个注意力头同时关注当前层的序列KV对(键值对)和所有前序层的深度KV对(键值对)。在同一个softmax 下,模型可以自由决定何时关注序列中的其他token,何时跨层检索自身的历史信息。通过一次操作,MoDA完成了两个维度的检索。

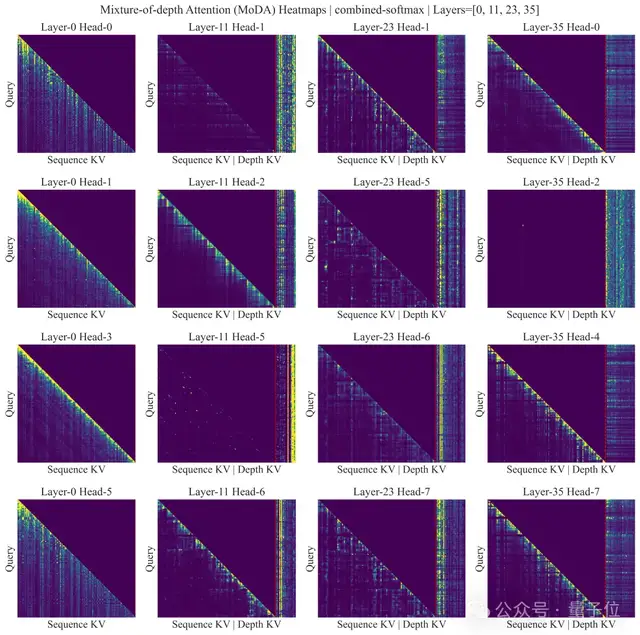

△左侧区域是序列KV,右侧区域是深度KV。颜色越黄,注意力越强。

回到传话游戏。在残差连接的版本里,第152个人费力地从累加的合唱中辨认第3个人的声音。有了深度检索,第152个人拍拍第3个人的肩膀直接问:“你刚才说了什么?”没有中间人,没有累积的噪音。

可视化的实验结果也印证了这个类比所预测的现象:当模型获得了通过深度KV从特定层进行选择性检索的能力时,它会持续且主动地使用这种能力。之前困扰模型架构研究员们的Attention Sink(注意力沉没)现象,即模型把概率质量堆积在少数固定token上的行为,也随之减弱。这就是当研究者团队尝试发展层之间而非仅仅层之内的信息流动时,所取得的有趣成果。

△引入深度注意力后,传话游戏允许每个人用手机查看群聊记录。

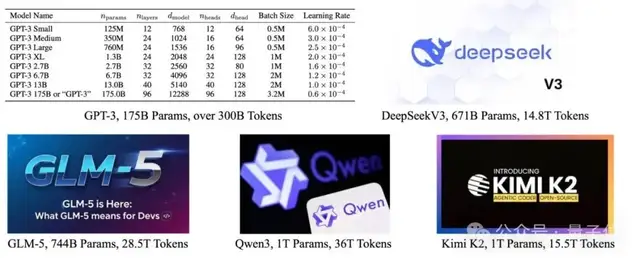

大模型架构的上半场是关于扩展组件的。研究者们扩展出更长的序列,更多的数据,更大的模型。这个阶段最关键的问题是“怎么把一切都做大?”。在上半场,这是正确且关键的问题,它把整个领域从GPT-2带到了GPT-4时代。下半场是关于扩展通信的。新的问题是:“组件之间的通信质量如何?”

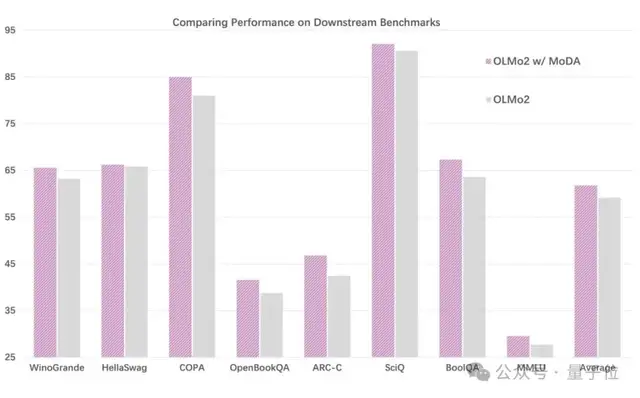

△引入混合深度注意力后,在主流的开源基线(OLMo2)上全面提升了模型能力。

深度是最明显的例子,因为现有方案(累加)和可能的方案(选择性检索)之间的差距是巨大的。研究者团队相信这个原则是可以推广的。凡是神经网络使用静态的、与数据无关的通道来传递信息的地方,包括层与层之间、模态与模态之间、时间步与时间步之间等等,很可能都会有一个检索机制等着替代那个累加操作。

全世界的研究者们花了十年掌握token之间如何对话,现在是时候掌握层与层之间如何对话了。而最终,研究者们将掌握神经网络中每个组件如何与其他任意组件对话。

深度残差的“+”带我们跑过了一段极为精彩的旅程,但现在,是时候升级这座阶梯了。

欢迎来到大模型架构的下半场。

Flash Depth Attention & MoDA论文链接:

https://arxiv.org/abs/2603.15619

Flash Depth Attention & MoDA代码链接:

https://github.com/hustvl/MoDA

实验室主页:

https://github.com/hustvl

论文主要作者来自于华中科技大学(HUST)电子信息与通信学院视觉实验室(Vision Lab)。HUST Vision Lab研究主要集中在计算机视觉和深度学习领域,尤其关注以下方向:多模态基础模型、视觉表征学习、目标检测、分割与跟踪、端到端自动驾驶、新型神经网络架构。

HUST Vision Lab致力于不断突破视觉智能的边界,代表性工作包括:CCNet(TPAMI 2020,4300+引用,1.5K Star)、Mask Scoring R-CNN(CVPR 2019,1400+引用,1.9K Star)、FairMOT(IJCV 2021,2200+引用,4.2K Star)、ByteTrack(ECCV 2022,3400+引用,6.2K Star)、EVA(CVPR 2023,1100+引用,2.7K Star)、MapTR(ICLR 2023,400+引用,1.5K Star)、Vectorized Autonomous Driving (VAD)(ICCV 2023,600+引用,1.3K Star)、DiffusionDrive(CVPR 2025,200+引用,1.3K Star)、Vision Mamba (Vim)(ICML 2024,3100+引用,3.8K Star)、4D Gaussian Splatting (4DGS)(CVPR 2024,1400+引用,3.5K Star)、YOLOS(NeurIPS 2021,500+引用,900+ Star)、YOLO-World(CVPR 2024,1000+引用,6.3K Star),以及 LightningDiT & VA-VAE(CVPR 2025,200+引用,1.4K Star)。

衡宇

衡宇