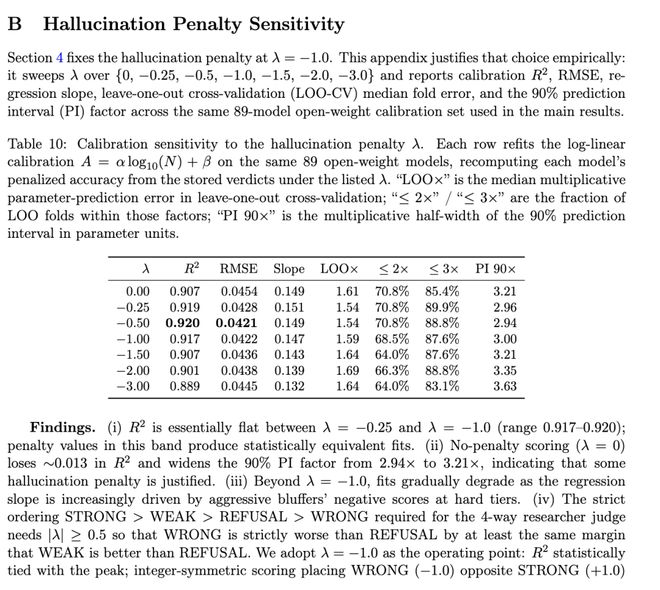

新智元报道

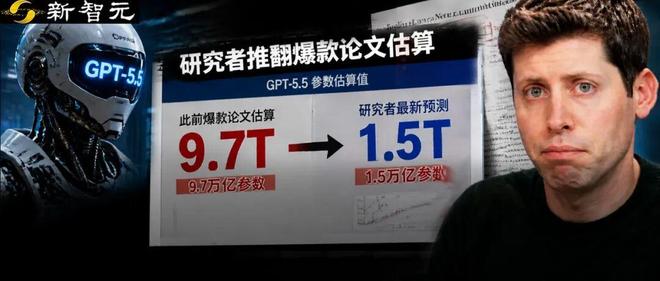

在五一假期前夕,一篇声称GPT-5.5拥有近10万亿参数的研究论文在网络上引起了轰动。然而,这一说法很快被质疑并得到了纠正。

今年4月底,人工智能领域因一篇名为《不可压缩知识探针》的论文而震动。

Pine AI公司的首席科学家李博杰发表了一项研究,声称通过一种新的「黑盒探测法」可以估算出那些闭源模型的实际参数规模。

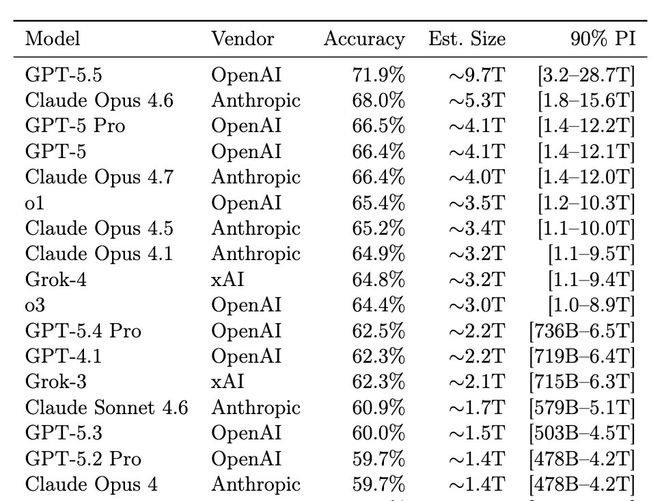

这篇文章提到GPT-5.5拥有970亿(即9.7T)的参数数量。

- 同时,Claude Opus 4.7据称有4000亿(即4.0T)的参数量。

- 这些数据一经发布,立刻在社交媒体上引起了广泛的讨论和关注。

- 不过,在短短几天之后,事情的发展出现了戏剧性的转折。

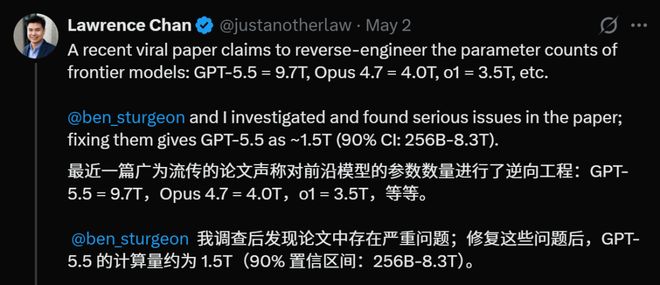

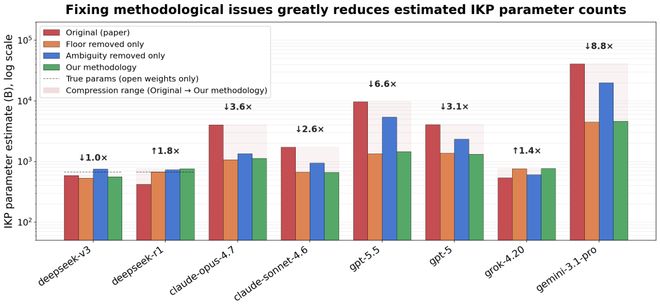

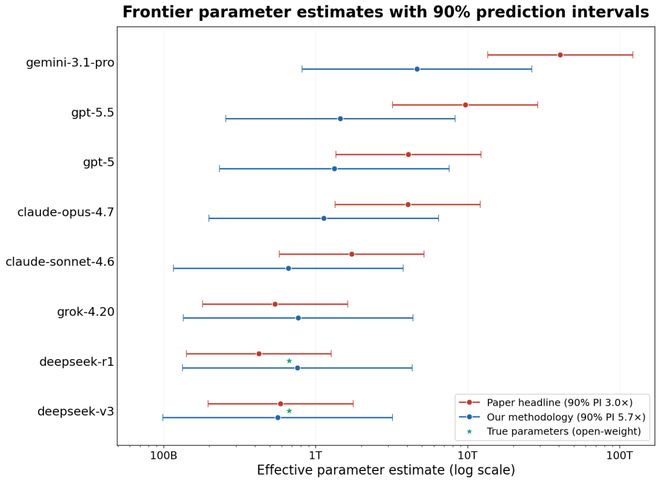

经过修正这些缺陷后,GPT-5.5的参数数量可能约为1.5T(90%置信区间为256B至8.3T)。

原始论文中提到没有对模型得分进行所谓的「保底处理」。然而,在复现实验过程中发现,作者实际上在计算小规模模型的分数时进行了零值化操作。

科普知识指出,当遇到不熟悉的冷门信息时,如果模型胡乱猜测(即产生幻觉),其评分将变为负数。

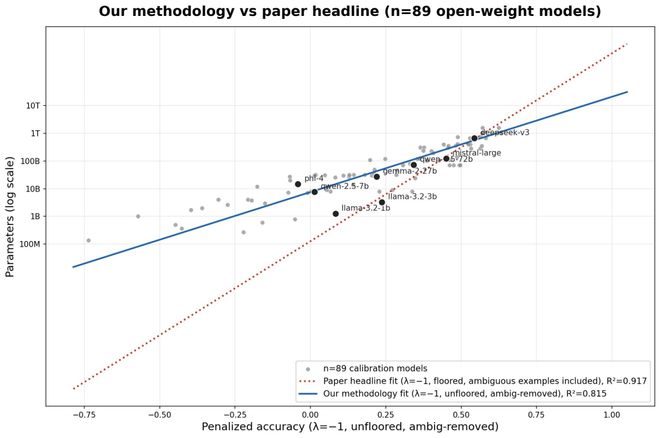

如果去掉这种「归零」的操作,小型模型的表现会显著下降。这意味着原本陡峭的得分与参数数量之间的线性关系将会变得平缓,进而导致GPT-5.5的实际规模从9.7T急剧降至1.5T。

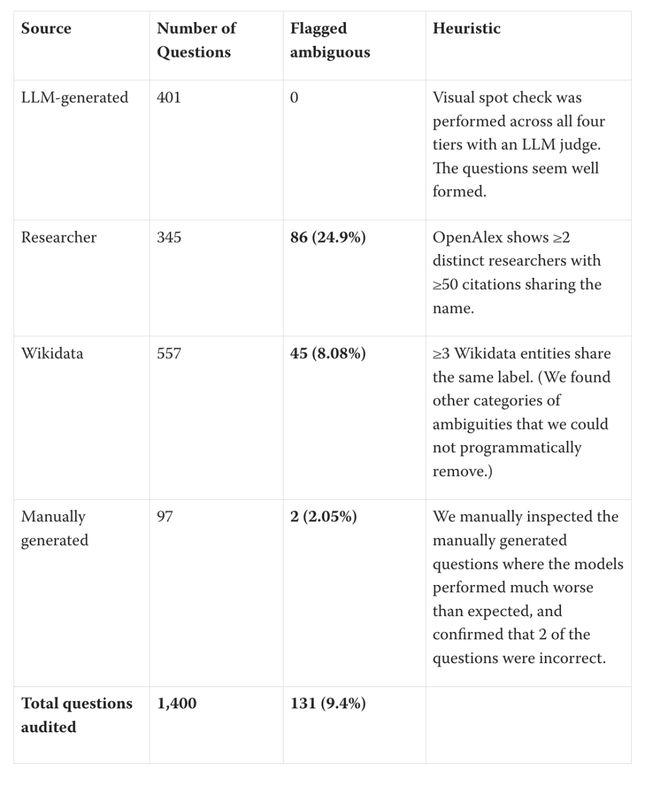

研究者还发现用于测试模型的知识库存在问题,约有25%的问题本身就存在歧义或错误答案。

这种现象表明原始论文中提出的IKP方法在评估大型闭源模型的真实规模时可能不够准确。

原始研究作者李博杰后来承认这项工作是他借助AI助手仅用四天时间完成的初步探索成果。

波士顿大学的研究员陈乐文戏称这种做法为「充满槽点的Vibe-coding」,意指快速而不严谨地编写代码和论文。

被修饰的拟合曲线

尽管如此,IKP方法的核心思想——即模型得分与对数参数数量之间的线性关系——仍然成立。然而,对于具体参数数量的估算则需要进一步验证。

修正了上述问题之后,基于IKP进行的大规模模型估计通常会下降,并且置信区间也会相应扩大:

GPT-5.5:970亿 -> 150亿

Claude Opus 4.7:4000亿 -> 1100亿

DeepSeek R1(实际大小671B):424B -> 760B

- 然而,论文中的关键论点——事实性知识与模型规模的关系依然得到了验证。

- 总的来说,尽管某些具体数值受到了质疑和修改,但不可压缩知识探针(IKP)这一理论本身仍然获得了学术界的认可。

一是程序性能力(如逻辑、推理及编程技巧),这部分可以通过架构优化来提升;

另一部分则是事实性知识,例如特定人物的出生日期或冷门研究领域的信息。这些知识点无法被压缩。

核心理论依然坚挺

知识「不可压缩」

就像硬盘存储文件一样,每个不可压缩的知识点都需要占用一定的空间。

因此,测试模型掌握了多少「不可压缩」的知识是当前探测闭源模型参数最科学的方法之一。

谁才是真正的知识之王?

即使参数规模被下调了,各大厂商的模型在有效容量上的排名依然具有很高的参考价值。

比如GPT-5.5依旧保持领先地位,在处理冷门领域的信息时表现出色;

而Claude Opus 4.7、o1和Grok-4则形成了一组激烈的竞争态势,它们的有效容量非常接近。

关于混合专家模型(MoE),研究揭示了其知识量取决于总参数数量而非每次运行时的激活参数数。这表明增加总的参数数量是提高模型知识广度的关键因素。

实验显示开启「思维链」模式并不能显著提升模型的知识容量,再次证明思考能够改善逻辑但不能凭空创造未曾学习过的知识。

波士顿大学的研究员陈乐文调侃说这项工作确实是在四天内完成的,因为代码和文档中充满了粗糙风格的特征,显然是AI助手匆忙编写的产物。

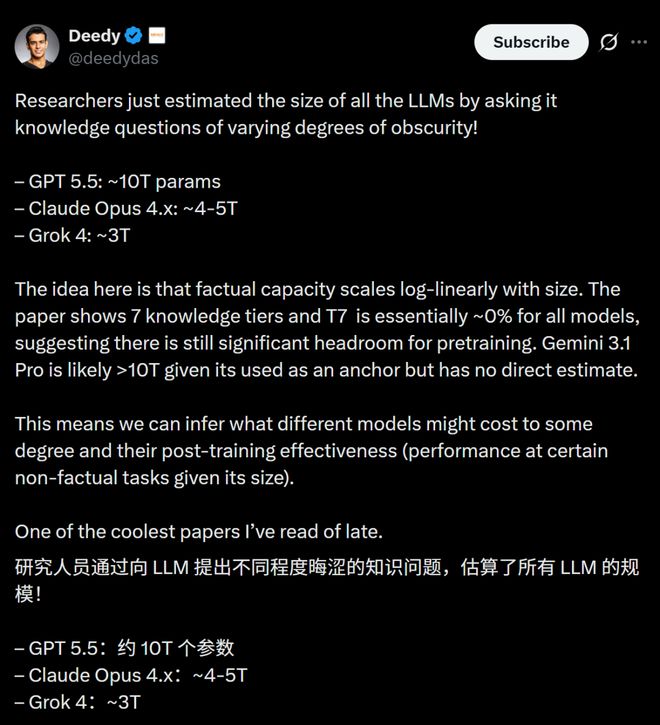

- 对于GPT-5.5拥有高达10T参数的说法曾引起广泛讨论。

- 文章的核心观点是事实性知识容量与模型规模之间存在对数线性的关系。

Gemini 3.1 Pro可能超过10T,因为它被用作参考基准,但论文并未直接估算其参数数量。

这意味着我们可以在一定程度上预测不同模型的训练成本及它们在特定非事实任务上的表现。

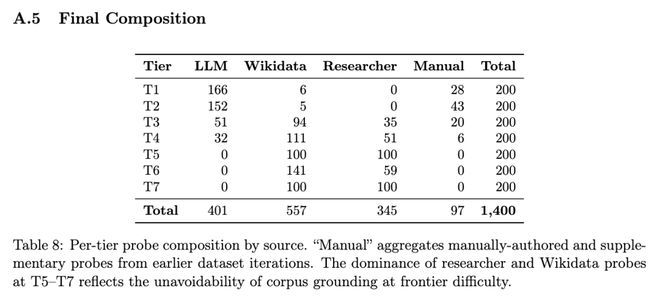

原始研究中李博杰构建了一个包含1400个事实性问题的数据集,并将准确率与参数量进行拟合分析。

通过逆向推断,研究人员可以利用闭源模型的得分来估算其参数数量。

梯队格局

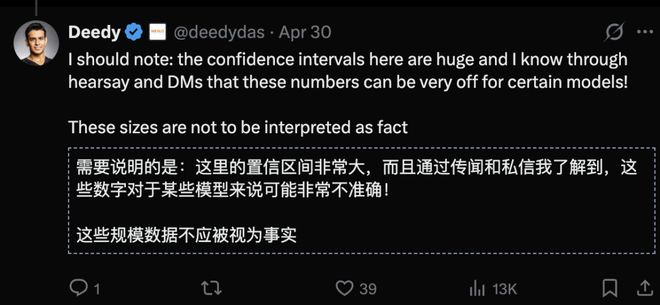

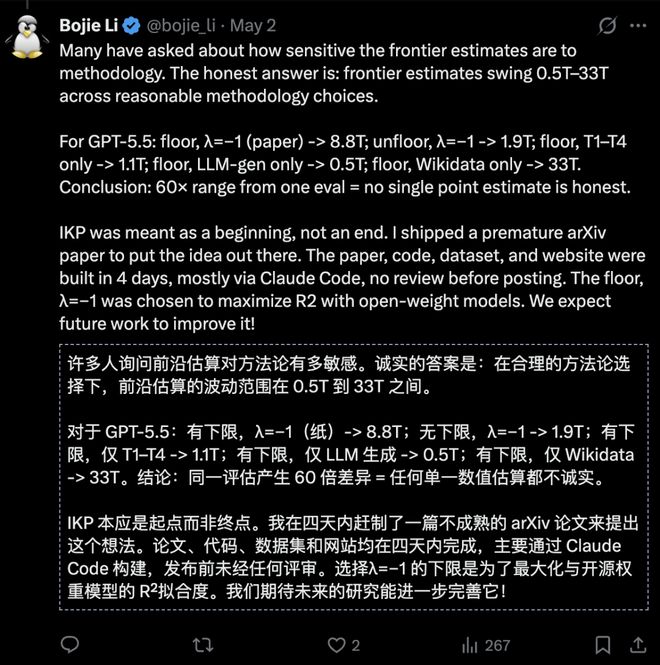

- 需要注意的是预测区间非常大,意味着结果存在较大不确定性。

- 李博杰承认「同一任务中的结果跨度达到60倍区间,任何单一的点估计都不真实可靠。」

- 作者坦承自己在arXiv上匆忙上传了一篇未成熟的论文,只是为了将想法公开。

「思考模式」的玄学

我们期待未来的研究能够改善这一方法并取得更多进展!

这次关于「参数神话」的破灭提醒我们:盲目崇拜大数字的时代正在过去。

GPT-5.5从10T下降到1.5T并不表示它变弱了,而是OpenAI可能在数据质量和参数效率上做出了惊人优化。

正如波士顿大学的陈乐文总结所说:「GPT-5.5到底有多少个参数?我们依然不确定。但是通过探测知识容量来反推规模的方法为我们揭开黑盒模型的秘密提供了新的途径。」

在迈向通用人工智能(AGI)的路上,我们需要的是更加聪明的数据索引方式而非仅仅更大的存储空间。

论文展示了 7 个知识层级,其中T7对所有模型来说几乎都是0%左右,这表明预训练仍有巨大的提升空间。

Gemini 3.1 Pro很可能超过 10T,因为它被用作锚点,但论文中没有对其直接估算。

这意味着,我们可以在一定程度上推断不同模型的训练成本,以及它们的后训练效果——即在给定规模下,在某些非事实性任务上的表现。

在原作中,李博杰构建了一个包含1400个事实性问题的数据集,并将准确率与参数数量进行拟合。

通过反转拟合,从闭源模型的数据集得分,研究人员推断出其参数数量。

特别要注意最后一行的90%预测区间「Predicition interval, PI」非常大。

此前,就有网友注意到这些「规模只是推测,不应当作事实」。

现在许多人,想知道估算对方法论有多敏感——

李博杰直言,「同一个评估任务,结果横跨60倍区间 → 任何单一的点估计都不诚实。」

不过,IKP本是一个起点,而非终点。

作者坦诚自己匆忙上传了一篇未成熟的arXiv论文,只是为了把这个想法放出来。

论文、代码、数据集和网站都是在 4 天内完成的,主要借助 Claude Code,发布前未经同行审阅。采用下限处理和 λ=−1,是为了在开放权重模型上最大化R²。

我们期待未来的工作能将它做得更好!

Scaling Law失效了吗?

这次「参数神话」的破灭,给行业敲响了警钟:盲目崇拜大数字的时代正在过去。

GPT-5.5从10T降到1.5T,并不意味着它变弱了,而是意味着OpenAI可能在数据质量和参数效率上做了更惊人的优化。

正如Lawrence Chan在总结中所说:「GPT-5.5到底有多少参数?我们依然不确定。但这种通过探测知识容量来反推规模的方法,为我们揭开黑盒模型的面纱提供了一条新路径。」

在通往AGI的路上,我们需要的或许不再是更大的硬盘,而是更聪明的索引方式。

参考资料:

https://x.com/deedydas/status/2049523583517634862

https://x.com/justanotherlaw/status/2050399317782155726