量子位报道了一项重要的研究成果。

在长达十年的时间里,FID(Frechet Inception Distance)一直是评估AI生成图像质量的黄金标准,但现在这种情况发生了改变。

这一指标自2017年以来一直被广泛采用,然而它在实际训练中却难以直接应用。

现在,一个由中国科学家组成的国际研究团队找到了解决方案——他们提出了FD-loss方法,成功解决了FID的应用难题。

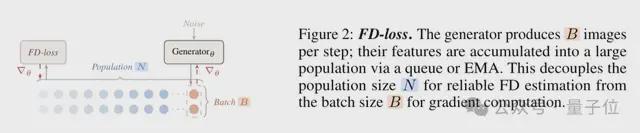

这个创新的方法通过分离用于统计计算的样本池和用于梯度计算的小批量数据,实现了显著的技术突破。

通过建立大型缓存队列或采用指数移动平均机制,该团队能够更稳定地完成分布估算,并仅对当前小批处理进行反向传播训练损失函数的优化。

这一策略让长期受限于FID的应用得以实现直接优化模型性能的可能性。

研究中发现了多个令人惊讶的结果:

例如,一个经过FD-loss调整的单一生成器,在ImageNet上实现了0.72的FID评分,并且没有增加推理成本;

- 同时,他们还成功将一个多步扩散模型转化为单步生成器,仅通过微调即达到了非常优秀的性能。

- 这些实验表明,即便是在视觉感知方面表现最佳的模型也不一定能在传统的FID评分中名列前茅。

- 长期以来,研究人员主要关注于优化FID分数,然而这一指标已经接近其性能极限,并且可能引导研究走向错误的方向。

为了改善这种情况,研究人员提出了一种新的综合评估标准——FDrk,它通过对六个不同特征空间的归一化弗雷歇特距离进行平均来计算得到。

根据这一新指标,在实际验证集上的基准值为1.0,而目前最先进的生成模型仍表现不佳,其数值高达1.89。

这表明在ImageNet图像生成领域中,技术进步仍有很大空间。

FID是所有生成模型评价不可或缺的标准之一。

解耦统计量与梯度计算

该指标越低意味着生成的图更接近真实分布。

它通过计算真实和合成图片之间的Inception-v3特征向量的高斯分布距离来完成评估。

然而,由于每个训练批次只能处理有限数量的数据(如1024张),此前FID无法作为直接优化目标使用。

为了解决这个问题,新的研究提出了“彻底解耦”的思路。

即,通过维护一个庞大的样本队列或利用EMA实时更新特征统计量来保证FD计算的准确性;

同时仅对当前小批量数据进行梯度回传以减少训练开销。

研究人员设计了两种实现方案:

第一种是采用超大窗口维护方法(如5万条记录);

这种方式每次生成新批处理时将最近的样本加入队列并移除最老的数据,确保计算准确的同时避免增加训练成本。

另一种方案则完全放弃了存储特征数据的方式,仅通过EMA实时更新统计量,并且能够轻松适应多个表征空间联合优化的需求,在实验中表现尤为出色。

为了验证这套机制的有效性,研究者在最小规模的模型上进行了消融实验。

结果显示,不使用队列时FID会从3.31恶化到3.84;

第二种叫EMA法。

当队列大小增加至5万时,FID骤降至0.89;但当进一步扩大到50万后,性能反而急剧下降。

在另一组实验中,研究者测试了不同EMA衰减率的影响,发现β=0.999的设置表现最佳。

这一方法被广泛应用于后续所有实验,并成为论文中的默认实现方案。

新提出的FD-loss框架具有极低的技术门槛和强大的通用性。

第一组对比队列长度。

它可以轻松地嵌入现有的生成模型训练流程中,无需任何复杂的架构修改或从头开始的训练过程。

此外,它还能兼容像素空间与隐式空间中的各种模型,并且支持单步生成器及多步骤扩散模型等多种任务模式。

通过这种方式,FD-loss显著降低了高质量快速生成模型的技术实现难度,为各类架构带来了明显的性能提升。

这种低成本高回报的特性正是其在工业界受到欢迎的原因之一。

团队成员包括来自美国南加州大学、卡内基梅隆大学以及香港中文大学的研究人员和博士生。

一作杨嘉伟,是南加大计算机系的一名博士研究生;

郭正阳则在四川大学完成本科学业后加入CMU攻读博士学位;

蒋轩宇目前就读于香港中文大学,并专注于图像和视频生成技术的研究。

天勇龙博士毕业于麻省理工学院,现为OpenAI研究员。

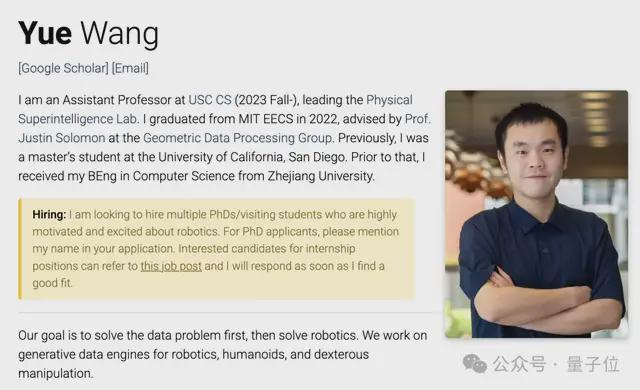

通讯作者汪跃教授任职于南加州大学并兼任英伟达的科学家职位;

其研究领域涵盖了三维视觉、生成模型及机器人学等多个方面。

论文地址:https://arxiv.org/abs/2604.28190

该研究为人工智能领域的图像生成技术带来了新的视角和解决方案,展示了中国科学家在国际前沿科研中的重要贡献。

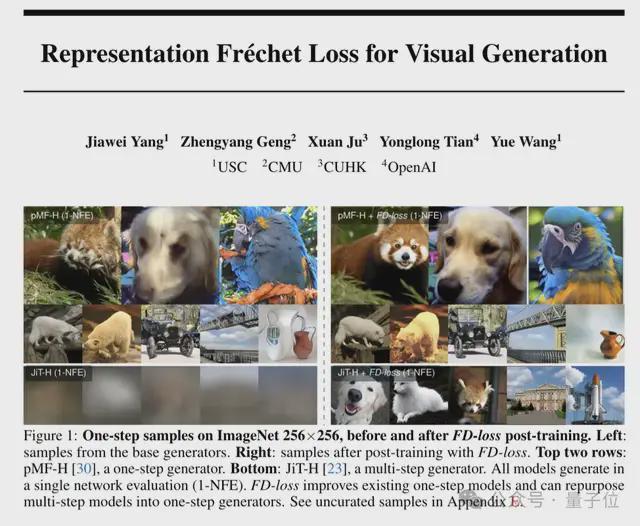

发现一,FD-loss让单步生成模型首次实现画质与速度的新高度。

研究者拿了一个已经训练好的单步生成器 pMF-H,直接上FD-loss微调100轮。

结果在ImageNet 256×256上,FID从2.29干到了0.77,同时依然保持 1-NFE(单步生成)。

这一分数大幅超越过往多步扩散模型的最好水平,打破了 “高质量必须多步、单步只能低画质” 的固有枷锁。

换句话说,推理成本一分钱没多花,画质直接跃升。

同样的操作放到latent-space的iMF-XL上,FID也从1.82压到0.76。

更关键的是,这种提升不是刷分。在论文图4的定性对比里,后训练的鹦鹉羽毛更分明,雪豹的斑点也更清晰。

发现二,FD-loss可以直接将成熟的多步扩散模型改造为高性能单步生成器。

研究者把原本训练来跑50步的多步模型JiT-L,强行拉到单步模式,也就是直接输入纯噪声,模型只跑一次,输出就当最终图像。

结果就是FID直接崩到291.59,画面糊成一锅粥。

然后,他们什么都不改,就用FD-loss继续微调这个的单步模式。

整个过程无需教师蒸馏,无需对抗训练,无需逐样本监督信号。

50轮后,FID从291骤降到 0.77,生成质量与原多步模型相当甚至更优,而且推理速度提升数十倍。

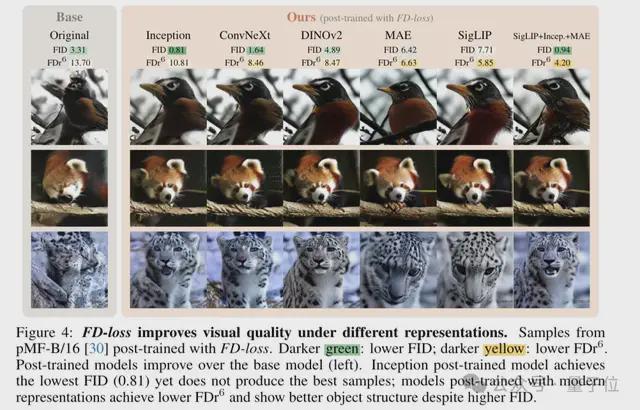

发现三,FID最低的,未必是最好的。

这也是该试验最具行业反思价值的一点。

当研究者把FD-loss放到不同的表征空间里优化时,事情变得诡异起来(惊恐.jpg)。

实验清晰表明,FID最低的模型,在人眼主观评价中并非最优。

基于Inception特征优化的模型能获得最低FID,却在物体结构、细节纹理、整体感知上弱于使用DINOv2、MAE、SigLIP等现代视觉表征训练的模型。

后者FID数值更高,但人眼看更锐利、物体结构更完整,视觉质量显著更优。

这说明长期被奉为金标准的FID可能会误导研究方向……

团队提出新标准

那么,如果FID已经靠不住了,我们拿什么来相信生成模型的进步?

研究团队提出跨6种表征空间的归一化平均指标FDrk。

该指标通过对Inception-v3、ConvNeXtv2、DINOv2、MAE、SigLIP2、CLIP共6种不同维度的表征空间计算归一化FD比值并取平均,得到综合评估结果FDr6。

按照这一标准,真实验证集的基准值为1.0,而当前最强生成模型的FDr6仍高达1.89,直观揭示 ImageNet生成任务远未被解决。

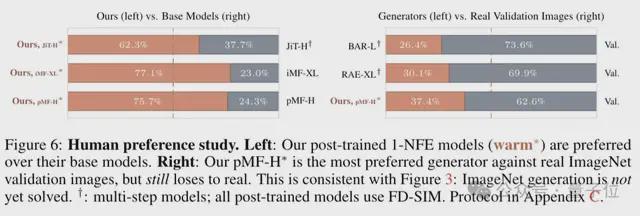

此外,在人类盲选偏好实验中,即便最优的pMF-H模型,得票率也只有37.4%,真实图片依旧以62.6%的胜率占优。

值得一提的是,FD‑loss具备极低的使用门槛与极强的泛化能力,可作为轻量化后训练插件直接嵌入现有训练流程,无需从零搭建模型,也不依赖复杂的训练策略与工程调优。

该方法同时兼容像素空间与隐空间生成模型,适配单步生成器与多步扩散模型,支持类别条件生成与文生图等多种任务模式。

在整个优化过程中,FD‑loss无需修改原有主干网络结构,不引入复杂的架构改动和从头训练的巨大开销,依托队列或EMA统计更新即可稳定收敛,具备优秀的复现性与落地可行性。

凭借简洁通用的设计,它大幅降低了高质量极速生成模型的工程实现门槛,让各类生成架构都能快速获得显著的质量提升。

低成本、高回报,这正是FD-loss之于工业界的诱惑力所在。

团队介绍

公开信息显示,五位作者全部是华人背景。

一作Jiawei Yang,USC计算机系博士生,师从Yue Wang教授,目前的研究聚焦于以视觉为中心的多模态模型的统一生成与理解。

他硕士毕业于UCLA,曾获NVIDIA Graduate Fellowship。

Zhengyang Geng本科毕业于四川大学计算金融专业,现为CMU计算机科学博士生,导师为Zico Kolter。

他长期专注单步生成、动态系统与模型高效化,是MeanFlow、pMF等系列工作核心作者。

他的个人主页写道“与Kaiming He有紧密合作”,两人曾连续合作多篇单步生成领域核心论文。

Xuan Ju是香港中文大学博士生,师从徐强教授,主攻图像与视频生成、高效多模态模型。

她在ICCV、SIGGRAP 等顶会发表多篇成果。

Yonglong Tian博士毕业于MIT计算机科学专业,现为OpenAI研究员。

他是监督对比学习SupContrast等表征学习标志性工作的作者,曾任职于Google DeepMind。

通讯作者Yue Wang,USC助理教授,同时兼任英伟达研究科学家。

他本科毕业于浙江大学,硕士毕业于UCSD,博士毕业于MIT,研究横跨3D视觉、生成模型与机器人。

论文arXiv:

https://arxiv.org/abs/2604.28190