DeepSeek为保护V4的特性不遗余力

技术报告越挖越有

深度挖掘发现,为了保证核心设计「批次不变性」,V4工程团队显得不惜一切代价。

其中最引人注目的新发现是,这款软件在处理超长上下文、复杂后训练/推理管线及自研高性能内核栈时表现出了极高的兼容性。而这一切的关键在于「批次不变性」的实现。

尽管这种设计带来了不少挑战,如GPU利用率下降和工程复杂度增加等问题,但DeepSeek依然坚持这一特性。

怎么说?

这一坚持背后的原因是什么?让我们深入探讨一下。

首先需要了解的是「批次不变性」的具体含义。

根据相关论文的描述,对于同一token而言,在不同的批次中其输出结果应当保持逐比特完全一致。

实现这一特性的核心目标是为了确保预训练、后训练及推理过程中的各个环节能够做到精确复现和对齐。

具体来说,线上服务会进行动态批处理,这意味着同样的用户请求可能会在不同的时间与不同用户的请求组合在一起。

如果没有批次不变性保障,在这种情况下相同提示词可能产生完全不同的结果。

因此,这一特性确保了同一输入能够得到相对一致的输出。

此外,它还帮助工程团队更好地理解模型行为变化是由哪些因素导致的,比如数据、强化学习或者内核路径的变化。

这种准确的问题定位有助于快速复现异常情况并提高系统的可调试性和稳定性。

同时,批次不变性也是处理复杂上下文系统的关键支撑点之一。

V4版本集成了多种复杂的组件,如长上下文注意力机制、稀疏注意模块等,这些都增加了数值不确定性的来源。而批次不变性则提供了一种硬约束来保证同一token在不同情况下结果的一致性。

这一特性还提升了后训练的稳定性,因为在强化学习和长时间推理中对细微差异非常敏感。

批次不变性能够减少随机数值扰动的影响,使模型行为更加可控。

总结而言,批次不变性是DeepSeek V4实现工程稳定性的基石,在复杂的长上下文训练、后训练及推理系统中确保了同一输入的数值一致性,并实现了可复现、对齐以及稳定的部署效果。

不过,追求这一特性的代价也不小。

为了保持批次不变性,V4版本不得不放弃一些常见的性能优化措施,如分割KV和K等技术。

在注意力机制中使用分割KV可以提高负载均衡与GPU利用率,但同时也会改变并行归约路径,导致同一批次中的token输出不同。

同样,在矩阵乘法(GEMM)操作中采用分裂策略虽然能够加速计算,但也会影响最终结果的一致性,因而与批次不变性的目标相冲突。

针对这些问题,DeepSeek提出了双核机制:对于同一解码任务准备两套计算方案,并确保它们产生的结果逐比特一致。

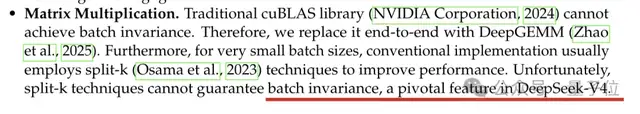

同时,在矩阵乘法方面,V4版本更多地采用了自研的DeepGEMM替代通用的cuBLAS库来执行更严格的批次不变性约束操作。

这些改进无疑增加了工程上的复杂度:原本可以通过通用库或常规策略解决的问题现在需要由定制内核和更加精确计算路径来完成。

综合来看,DeepSeek V4在追求这一特性的过程中牺牲了多个方面:

包括GPU利用率的下降;

牺牲了什么

以及训练、推理及强化学习阶段逐比特可复现性的问题;

还有长上下文处理和Agent、RL训练时稳定性不足的情况;

甚至在多机多卡环境下也无法保证结果完全一致。

最后,值得一提的是,DeepSeek V4自发布以来就吸引了大量关注,其技术报告中包含了许多创新点。

其中包括将多个专家教师模型压缩为单一学生模型的技术等亮点。每个突破背后都有扎实的数学理论支撑。

Hugging Face公司的Transformers负责人Arthur Zucker对此表示赞赏:这种无私分享多年研究成果的做法,堪称历史最佳(Greatest of All Times)。

矩阵乘法方面,V4在大多数场景中放弃split-K,转而做更受约束的 batch-invariant GEMM。他们用自研DeepGEMM替代了通用的cuBLAS。

这些都导致了工程复杂度的明显上升:很多原本可以交给通用库或常规优化策略的工作,都必须由自研kernel和更严格的计算路径来承担。

如此种种,简单总结起来意味着DeepSeek V4在以下几个方面做了牺牲:

- GPU 利用率(波前量化问题)

- 小批量/短序列速度

- 原生算子兼容性

- 部分稀疏加速的自由度

以换取:

- 训练/推理/RL三阶段逐比特可复现

- 长上下文、Agent、RL训练稳定度

- 多机多卡跑出来的结果完全对齐

One More Thing

DeepSeek V4发布了这么些天,但这个技术报告属实是越挖越有。

看点还包括,把10个以上专家教师模型蒸馏成一个学生模型等等。

并且每个问题背后都有坚实的数学解释。

Hugging Face的Transformers负责人Arthur Zucker就感慨:

把数月乃至数年的努力全部免费公开,让任何人都能受益,这是真正的GOAT(Greatest of All Times)。

参考链接:

[1]

https://x.com/teortaxesTex/status/2048707398886404524?s=20

[2]

https://huggingface.co/deepseek-ai/DeepSeek-V4-Pro/blob/main/DeepSeek_V4.pdf

鱼羊

鱼羊