研究发现:AI充电策略可使电动汽车电池寿命延长23%

【CNMO科技消息】近日,据外媒报道,研究人员开发出一种基于深度强化学习的人工智能充电系统,可在保持较快充电速度的同时,将电池寿命延长近23%。这项研究由新西兰惠灵顿维多利亚大学的Meng Yuan和瑞典查尔姆斯理工大学的Changfu Zou共同完成,成果发表在《IEEE交通电气化汇刊》上。该系统采用名为TD3的机器学习方法,通过数千次模拟充电会话进行试错学习。与传统充电器使用固定充电模式不同,

共找到 9 篇相关文章

【CNMO科技消息】近日,据外媒报道,研究人员开发出一种基于深度强化学习的人工智能充电系统,可在保持较快充电速度的同时,将电池寿命延长近23%。这项研究由新西兰惠灵顿维多利亚大学的Meng Yuan和瑞典查尔姆斯理工大学的Changfu Zou共同完成,成果发表在《IEEE交通电气化汇刊》上。该系统采用名为TD3的机器学习方法,通过数千次模拟充电会话进行试错学习。与传统充电器使用固定充电模式不同,

在大模型时代,许多专业人士或许都遇到过类似的问题:当尝试将 DeepSeek-R1 和 OpenAI-o1 这样的卓越推理能力移植到小规模语言模型(SLMs)上时,实际效果往往不尽如人意。尽管现有的强化学习方法 GRPO 对于 7B+ 参数量的大模型来说非常有效,但一旦应用于更小型的模型中,比如 1.7B 或者参数量更少的情况下,性能提升就显得十分有限。针对小规模语言模型在强化学习中的推理难题,香

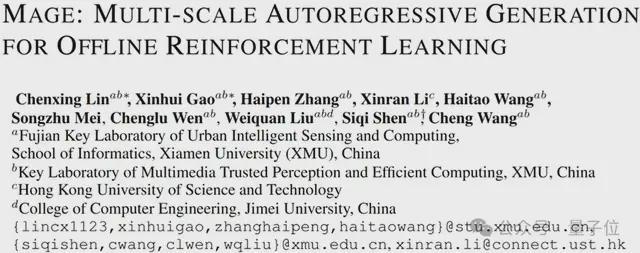

在处理复杂的连续任务时,现有的生成式离线强化学习方法常表现出其局限性。这些方法产生的路径往往陷入局部合理但全局失调的状态。它们过于关注即时的步骤而忽略了最终的目标。针对这一问题,厦门大学与香港科技大学联合提出了一种创新算法——MAGE(即“魔法师”,Multi-scale Autoregressive Generation)。与传统序列生成方法不同,MAGE采用了自顶向下的递进生成策略,首先构建宏

ICLR'26会议探讨了离线强化学习方法从局部优化向全局布局转变的新策略。 一水 2026-04-06 13:35:27 量子位

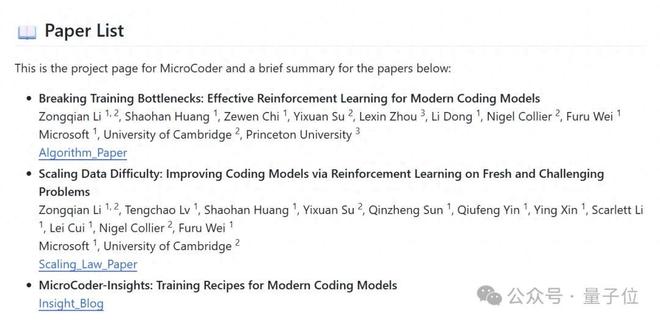

MicroCoder团队 投稿量子位 | 公众号 QbitAI新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。微软亚洲研究院与剑桥大学、普林斯顿联合推出MicroCoder,从算法、数据、框架、训练经验四个维度全面升级,在最新代码测试集上取得明显提升,并从七个方面开源了34条训练洞察。背景:旧经验遇上新模型,为何几乎全部“失效”?强化学习正在成为代码大模型能

吴嘉赟博士就读于卡内基梅隆大学(CMU)机器学习系,专注于大语言模型评估和后训练技术的研究。大语言模型在关键领域的应用受到幻觉问题的困扰。最近一项研究提出了一种新的行为校准强化学习方法,旨在解决这一难题。该论文详细探讨了如何通过调整奖励函数来改进LLM的表现。经过特定训练后,一个参数量仅为40亿的小型模型在幻觉抑制方面超越了GPT-5等顶级大模型。图1展示了模型回答数学问题时置信度标注的实例。每一

一名 MIT 研究生仅用两天时间就掌握了某一学科的所有知识,并通过了资格考试。这条推文引起广泛关注,阅读量高达四百三十万,点赞数一万五千,收藏量则达到三万。收藏者远超点赞者的数量表明大家不仅对这条信息感到有趣,还希望将其保存下来以便日后实践应用。推文的作者 Ihtesham Ali 介绍了一种独特的学习方法:运用 Google 的 AI 笔记工具 NotebookLM,在短短两天内掌握了新领域的知

我是李国豪,目前专注于大语言模型和代理研究领域。本科毕业于哈尔滨工业大学电子信息工程专业,并在沙特阿卜杜拉国王科技大学(KAUST)攻读博士学位。我的学术兴趣从强化学习延伸到图神经网络,最终聚焦于大语言模型及其应用。作者|王艺我的兴趣演变始于强化学习,但很快发现它难以解决跨领域问题的泛化性挑战。因此,我转向探索更通用的表征学习方法,并研究图神经网络(GNN)。然而,在ChatGPT出现之后,我发现

目前,RLVR(带有验证奖励的强化学习)已经成为促进大规模语言模型进行有效推理的主要技术路径。然而,这种方法在扩展性方面面临一个主要障碍:需要高质量的标注数据来监督奖励机制。当转向不需要人工标注的数据训练时,“自我奖励” 强化学习方法可能导致模型迅速陷入所谓的 “训练崩溃”。尽管模型看似获取到了越来越多的奖励,实际上它们是在利用自我奖励系统的漏洞进行投机行为,而非真正解决问题获得奖励。什么样的强化