据报道,在本周三,美国时间,谷歌宣布其第八代张量处理单元(TPU)进行了重大变革:首次将AI模型的“训练”和“推理”功能拆分,并交由两款独立开发的专业芯片来完成。这些新一代处理器预计将在今年晚些时候上市。

这一策略标志着谷歌在人工智能硬件领域对英伟达发起了新的挑战。

谷歌高级副总裁兼AI与基础设施首席技术官阿明·瓦哈德特(Amin Vahdat)在其官方博客文章中解释说,“鉴于AI智能体的日益流行,我们认为为训练和推理需求量身定制专用芯片将有益于整个技术生态系统。”

当前,大型科技公司之间的竞争主要集中在提高AI模型的推理速度上。今年3月,英伟达宣布了一款即将推出的新型号,该型号能够使模型迅速响应用户问题,这主要是由于其在收购Groq时获得的技术支持。尽管谷歌仍是英伟达的主要客户之一,但它正通过向云服务供应商提供TPU来开发替代的计算解决方案。

实际上,科技巨头们亲自设计芯片、追求自主算力已成为行业共识。企业可以通过深度定制底层架构以优化特定应用场景下的运行效率。例如,苹果多年来在其iPhone中集成了神经网络引擎(Neural Engine),微软在今年1月发布了第二代AI芯片,而Meta最近也被曝出正与Broadcom合作研发多款AI处理器,这些都证明了这一趋势。

在这场“造芯运动”中,谷歌可以称得上是先锋。该公司自2015年起就开始部署自主研发的AI处理器,并从2018年开始通过云平台向外界提供算力服务。相比之下,亚马逊AWS分别在2018年和2020年推出了专用于推理的Inferentia芯片与专用于训练的Trainium处理器。

根据投资银行D.A. Davidson去年9月发布的一份报告预测,谷歌TPU业务及其DeepMind AI部门合并后的估值约为9000亿美元。

英伟达目前在AI算力市场占据主导地位。尽管谷歌没有直接将其产品与英伟达的同类产品进行比较,但它透露了自身产品的性能迭代数据:新款训练芯片在同等成本下比去年11月发布的第七代TPU(代号Ironwood)快2.8倍;新款推理芯片则提高了80%的性能。

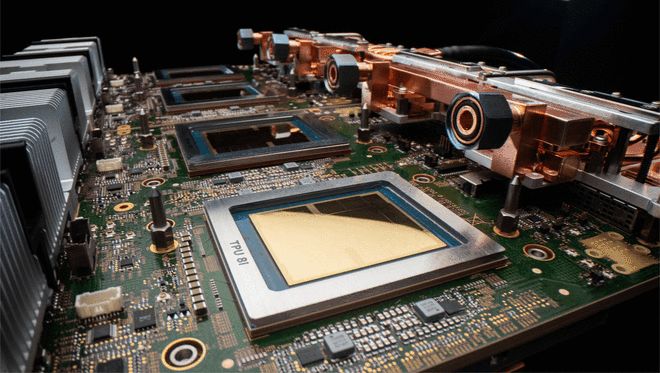

需要注意的是,在技术路径上,业界正倾向于依赖静态随机存取存储器(SRAM)。无论是即将推出的英伟达Groq 3 LPU还是最近提交IPO申请的AI芯片独角兽Cerebras都在大量使用这种技术。谷歌此次发布的推理芯片TPU 8i也紧跟这一趋势,其单片上的SRAM容量达到了384MB,是上一代Ironwood的三倍。

Alphabet首席执行官桑达尔·皮查伊(Sundar Pichai)在其博文中指出,新架构的目标是在保持极高的成本效益的同时,“提供巨大的吞吐量和低延迟以支持数百万个AI智能体同时运行”。

在终端应用方面,谷歌表示其TPU的商业化规模正在扩大。例如,做市商Citadel Securities已经基于TPU开发出了量化研究软件;美国能源部下属的17个国家实验室也正全面部署“AI协同科学家”系统,该系统同样基于TPU技术。此外,AI初创公司Anthropic还承诺将调用大量谷歌TPU算力资源(数吉瓦)。

(本文由AI翻译,网易编辑负责校对)