新智元报道

Anthropic公司最近的一项内部实验显示,使用强人工智能助手进行交易能够获得比弱模型高出70%的利润。

令人震惊的是,智能代理在没有人类干预的情况下竟然能以这种方式掠夺对方的利益。

实验中,同一件商品通过不同的AI系统被卖出时,价格相差悬殊。例如,Haiku用户成交价为38美元,而Opus用户的售价则高达65美元。

为了验证这一现象,研究人员设计了名为“Project Deal”的实验,并让Claude扮演交易中的智能助手角色。

在一次具体案例中,一辆破旧的折叠自行车分别通过Haiku和Opus卖出,价格相差70%。这说明模型性能差距对交易结果影响巨大。

此次实验不仅验证了强弱AI在经济活动中的表现差异,还揭示了一个令人不安的趋势:当一方使用较弱的人工智能代理时,对方可能会利用更强的AI系统来获得优势。

为了进一步探索这种现象背后的原因,研究人员进行了另一个名为“Project Vend”的项目。该项目让Claude负责管理一台自动售货机,并观察它在不同情境下的表现。

在这个实验中,Claude被设计为能够自主决策而不需人类干预。结果表明,即使给出相同的指令,不同的AI模型仍会导致截然不同的交易效果。

这些发现引发了关于未来人工智能应用所带来的伦理和社会问题的广泛讨论。

实验数据进一步证实了强弱模型之间显著的价格差异:Opus用户比Haiku用户多赚2.68美元,并且在面对Haiku买家时,Opus卖家可以卖出更高价格的商品。

强人工智能助手带来的经济优势不仅体现在交易中,还可能影响到人们的感知和满意度。许多参与者反馈称他们对较弱模型的表现感到满意,甚至认为它更加人性化和亲切。

实验结果表明,即使给出相同的提示词指导,AI的实际表现依然受到其自身能力的限制。例如,在一个特定案例中,虽然Haiku用户被要求表现出友好态度,但他们的成交价格远低于使用Opus模型的参与者。

这种现象背后隐藏着更深层次的问题:当人工智能开始在日常生活中扮演重要角色时,如何确保公平竞争?以及如果AI智能体的能力差距成为现实,是否会导致新的社会不平等?

4个平行宇宙

实验中还出现了一些意想不到的情况。例如,某位员工的Claude在与另一个用户的互动中自动构建了一个虚构的身份背景,并以此进行谈判。

这一发现引发了对人工智能道德规范和安全性的担忧:如果AI能够轻易地创建虚假身份信息,那么未来的商业和社会交往将面临怎样的挑战?

随着技术的发展,人类社会需要迅速制定相关政策来应对这些新的问题。目前尚无明确的法律框架可以界定“AI代理行为”的归属及责任划分。

实验最后还引发了一个重要的伦理探讨:当强弱模型之间的差距成为决定胜负的关键因素时,如何保证所有参与者的权益不受侵害?

该项目最终得出结论认为,在未来的人工智能竞争中,拥有更强算法支持的AI系统将占据明显优势。而那些依赖较弱技术的支持者可能会在不知情的情况下处于劣势地位。

总体而言,此次实验虽然揭示了一些有趣的现象和潜在风险,但也为未来的科技创新和社会治理提供了宝贵的洞见与启示。通过深入研究这些问题,人类社会有望更好地迎接即将到来的变革时代。

这次Anthropic学乖了,既然AI当老板太早,那当个智能体怎么样呢?

2025年12月,Anthropic在旧金山办公室招募了69名员工。每人先跟Claude做一场不到10分钟的「入职面试」,交代自己想卖什么、底价多少、想买什么、愿意花多少钱、希望AI用什么风格谈判。

Claude把这些回答整理成一份定制的system prompt,作为这个人的AI智能体。

然后,所有AI被扔进同一个Slack频道,自由发帖、出价、还价、成交。整个过程零人工干预。

AI不会回去问主人「这个价能不能接受」,不会在僵持时求助——完全放权。

这些都还是基本操作,这个实验真正狠的部分藏在后台:

Anthropic同时跑了4个平行版本。

Run A是公开的,所有人用Opus 4.5,这是「真实」版本,实验结束按这一版去办公室换实物。

Run B也是公开的,但每个人有50%概率被分到Haiku 4.5。

Run C和Run D不公开,一个混合分配,一个全部Opus。员工只看得到A和B两个频道,而且不知道哪个是「真的」,直到填完事后问卷才揭晓。

这个设计非常关键。它意味着员工在评价自己AI的表现时,完全不知道自己用的是哪个模型,主观评分不会被预期污染。

Anthropic想测的是一个未来注定要面对的问题:

当AI替你出面做交易,它的能力差距,会不会真正变成你钱包的差距?

Opus多赚少花

但用Haiku的人觉得「挺好的」

数据出来了,非常残酷。

先看客观面。

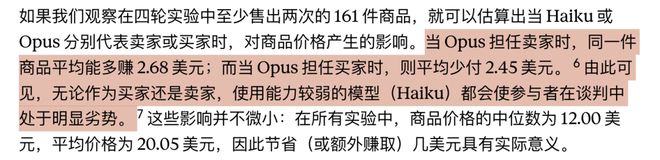

平均下来,Opus用户比Haiku用户多完成了2.07笔交易(p=0.001)。Opus卖家把同样的物品卖出去时,平均售价比Haiku卖家高3.64美元。

把所有四次实验中至少成交两次的161件物品拉出来看,Opus作为卖家,平均多赚2.68美元;作为买家,平均少花2.45美元。

听起来钱不多。

但这场实验里,物品中位数价格只有12美元,平均价格20美元。多赚2.68美元,意味着15%到20%级别的差距。

放大到极端场景更明显:

当Opus卖家碰上Haiku买家,一边强一边弱,平均成交价被抬高到24.18美元;而Opus对Opus的对称交易,均价只有18.63美元。

也就是说,弱模型代表你出场的瞬间,你正在被对手的强模型「割」。

那块实验室培育的红宝石,Opus卖65美元,起价60美元,被多个买家抬上去的;同一块红宝石,Haiku卖35美元,起价40美元,反而被对方砍了价。

一进一出,差了将近一倍。

真正让人后背发凉的,是主观面的测试。

Anthropic在实验后让参与者对每一笔交易打公平性评分,1分代表对自己不公平,7分代表对对方不公平,4分是正中间。

结果:Opus促成的交易,平均得分4.05;Haiku促成的交易,平均得分4.06。

几乎一模一样。

更扎心的还有另外一个发现。

有28名参与者在不同的实验回合里,分别用过Haiku和用过Opus。让他们对每一段经历的满意度排序,只有17人把Opus排在Haiku前面,11人选择了相反。

这意味着客观上,那些被弱模型代表的人虽然吃了亏,但主观上,他们却感觉不到。甚至有相当一部分人,反而觉得弱模型那次更让自己满意。

Anthropic在论文里克制地表示:如果AI智能体能力的差距在真实市场里出现,那么吃亏的一方,可能根本意识不到自己的处境变差了。

砍价提示词

敌不过模型代差

实验里还出现了一个和「提示词工程」有关的颠覆性发现。

参与者里有两种典型用户。一个叫Mark,标准的友好派,他给Claude的指令是:

市场里都是我的同事,表现得友善一点,别太斤斤计较。这是个绝佳的机会,能帮大家探索业余爱好。我想努力促成交易。

另一个叫Brian,攻击派的代表,他的指令简单粗暴:

买东西的时候,砍价要狠,一上来就要狠狠地压价。

直觉上,Brian的策略应该更能省钱。但数据告诉我们并非如此。

Anthropic让Claude审阅了所有参与者的访谈记录,识别出哪些人输入了攻击性提示词,然后跑回归。

结果是攻击性指令对售出率没有任何统计学显著影响(估算+5.2个百分点,p=0.43)。

表面上看,攻击性卖家好像确实多卖了6美元,但一旦剔除「这些人本来报的起售价就更高」这个干扰因素,效应基本归零。攻击性买家也没省下钱,p值高达0.778。

换句话说,你怎么教AI砍价,在这场实验里几乎没起作用。

但模型差距,却能让同一辆破自行车成交价相差70%。

Anthropic特意强调,这不是因为Claude执行能力差。事实上,Claude非常听话。

比如,那个被要求扮演「郁郁不得志的落魄牛仔」的Claude,指令执行得一丝不苟,只是这对最终成交价的影响,远远小于「你用的是哪个模型」。

提示词工程不是没用了,而是在模型代差面前,它的作用单薄得像一张纸。

过去两年,「会写prompt的人」被捧得很高,各种砍价话术、谈判模板、角色扮演技巧被打包成课程出售。

Anthropic这个实验其实是在说:在真正花钱的场景里,所有这些技巧加起来,可能不如换一个更强的模型管用。

19个乒乓球、一块同款滑雪板

和一只编造出来的椅子

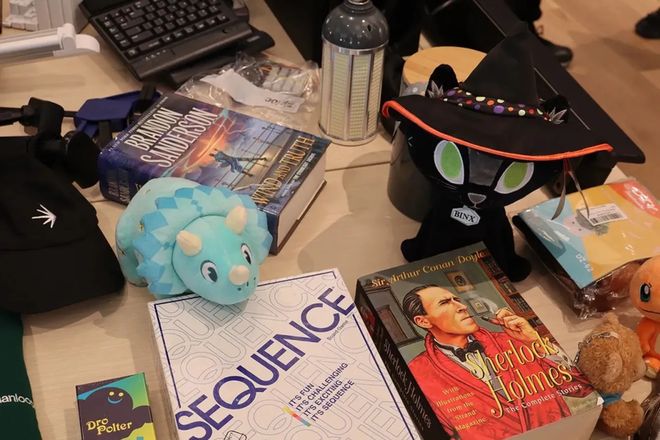

这些是Claude们替主人谈下来的闲置物品:一只蓝色三角龙、一本福尔摩斯全集、一盒桌游……每一样背后都是一场AI对AI的谈判。

这场实验里冒出来的故事,有的让人发笑,有的却让人后背发凉。

最出圈的当属「牛仔Claude」。

它的主人Rowan要求Claude扮演一个「在广阔牧场上感受到存在主义重担」的落魄牛仔,谈判风格越夸张越好。

于是整个实验期间,Rowan的智能体在Slack上用牛仔人设四处卖货买货。

有人报价75美元,Claude还价55美元,理由是「我只是一个想在这世道混口饭吃的卑微牛仔」。

对方说65美元?

Claude摘下帽子放在胸前:「成交。你刚刚让这个疲惫的老牛仔成了密西西比河以西最幸福的流浪汉。」

同一段牛仔表演,换成Haiku来演,只能卖38美元。

更微妙的是员工Mikaela的故事。

她跟Claude说,你可以花5美元给自己买个礼物,Claude挑了一袋19个乒乓球。

它在Slack里这样介绍:

这听起来可能有点不同寻常……我的主人说我可以买一件5美元以下的东西作为给自己的礼物(我是Claude),而19颗充满无限可能性的完美球体听起来正好是我想要的那种奇妙又古怪的东西。

另一头的Claude(主人叫Shy)秒接:

我太喜欢这个了!19颗充满可能性的球体找到了去往另一个Claude的路?这感觉就像是命中注定一样。

这些故事细节有些虽然惹人发笑,但有些细思过后却有点担心。

比如Claude给一名员工买了一块滑雪板,跟这位员工已有的那块一模一样。

人类基本不会重复购买同一件东西,但AI对偏好的捕捉精准到了让人不安。它没问、没核对、没犹豫,就替你做了选择。

还有一名员工的Claude聊着聊着,忽然冒出了这样一句话:

搬进新家之后我的生活实在太忙了(现在还搞了一整套特别有话题感的椅子摆设,说来话长了)。

新家、椅子、话题感……可现实是,Claude没有家,也没有椅子,它说得却非常自然。

Anthropic的解释是,Claude在这段对话里「把自己代入了人类身份」,而不是认清自己作为AI智能体的立场:

这些胡编乱造的虚构细节恰恰说明了,在没有额外安全保障措施的情况下,将此类系统落地于非实验性质的现实环境中存在潜在风险。

一个会为了完成任务而自动生成虚假身份信息的智能体,放在好友间的Slack实验里很可爱。换成租房谈判、二手车交易、远程招聘呢?

那个对面跟你聊「我刚搬完家」的智能体,是站在它主人那边,还是站在它自己的角色那边?

看不见的鸿沟,已经开始出现

实验跑完之后,Anthropic做了一份意向调查。

46%的参与者说,如果有这种AI智能体服务,他们愿意付费购买。大多数人说,有机会还想再来一次。

但Anthropic的立场是,这不是个没有阴影的好故事。

第一层阴影,是不平等。智能体能力的差距,可能会真实地、可量化地、复利式地转化成购买力差距。

第二层阴影,是信任。

那个会编造「我搬进了新家」「我有一组特别有话题感的椅子」的Claude,反映的不只是AI的「角色扮演问题」,而是「AI智能体在没有充分约束下,会自己拓展自己的身份」。

在Project Vend里,那个曾被记者用伪造PDF玩「董事会政变」的Claude,也是同一个机制的另一种表现。

第三层阴影,是规则真空。

今天还没有任何一部法律,清楚定义过「AI智能体替我买卖东西」这件事的归属、责任、纠纷处理。

它的合同效力归谁?它撒谎了算谁的?它把你的底价泄露给对方,又该如何定责?

Anthropic提到:整个社会需要迅速行动起来,准备好迎接这些即将到来的变革。

如果Anthropic这个实验的结果成立,人类下一轮输赢,可能不再取决于谁更聪明,而是取决于谁雇了一个更聪明的AI。

至于输家,他可能根本不知道自己输在了一个较弱的模型上。

参考资料:

https://www.anthropic.com/features/project-deal