4月14日的最新消息显示,NVIDIA不仅推出了强大的人工智能GPU,引领了全球新一轮的人工智能热潮,还将其内部芯片设计流程大规模地应用了AI技术。

在一次与谷歌首席科学家Jeff Dean的对话中,NVIDIA的首席科学家Bill Dally提到,该公司已经在芯片设计的不同阶段广泛使用了AI,包括设计探索、标准单元库开发和Bug处理等方面。

然而,Dally也指出,完全依靠AI实现自动化芯片设计尚不现实,并且他对何时能达成这一目标持谨慎态度。

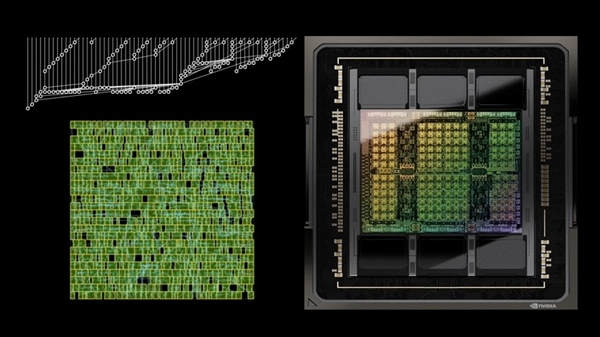

Dally分享了一个关于利用AI技术进行芯片设计的实例。

传统上,NVIDIA将标准单元库转移到新的工艺制程中需要一个由八名工程师组成的团队工作十个月的时间。

目前,有了基于强化学习的工具NB-Cell,经过几代的发展,只需一台GPU就能在一夜之间完成这项任务。

更重要的是,AI生成的标准单元在面积、功耗和延迟方面都超越了人工设计的结果,这使得新工艺能够迅速部署。

除此之外,Dally还介绍了一款名为Prefix RL的内部工具,它解决了进位超前链中的超前级布局这一长期存在的难题。

他表示,AI生成的设计方案“人类工程师无法想象”,并且其关键性能指标比人工设计高出20%到30%。

这说明NVIDIA利用AI技术不仅仅是为了提高效率、节省时间和人力成本,更是为了探索超出常规思维的创新设计方案。

Prefix RL

从更宏观的角度来看,Dally透露NVIDIA内部正在运行两款大型语言模型:Chip Memo和Bug Nemo。

这些模型基于NVIDIA多年积累的GPU设计数据进行了微调,包括寄存器传输级(RTL)代码和架构文档等信息。

Dally称,其中一个实际好处是初级工程师可以直接向这些大模型提问并获得答案,不再需要频繁地咨询资深设计师的意见,后者可以专注于更高价值的工作。

同时,它们还能帮助整理Bug报告,并将其分配给相应的模块或工程师处理。

值得注意的是,尽管AI工具提高了效率,但NVIDIA并没有因此裁减初级员工的数量,而是通过更高效的培训方式来促进他们的快速成长。

相较于一些公司倾向于用AI替代员工的做法,这或许是一种更为平衡的应用方法。