面壁智能最近发布了一项重要的技术成果,这是与清华大学以及其他合作伙伴共同研发的。

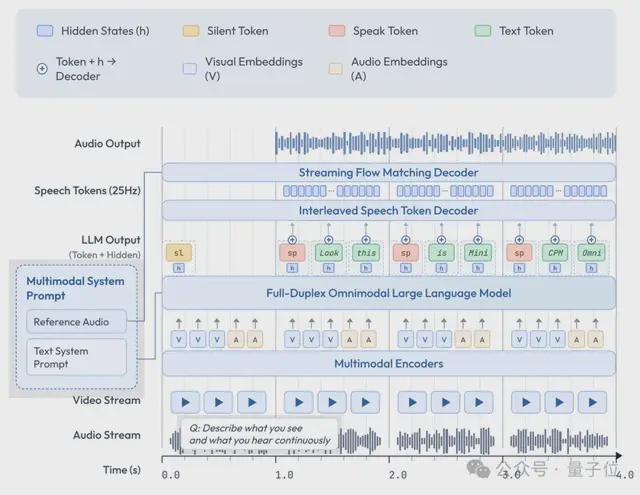

该成果的核心是一套创新的技术框架——Omni-Flow流式全模态框架。

Omni-Flow 是面壁智能在全双工全模态交互领域的最新突破。

这次发布包括MiniCPM-o 4.5技术报告,这款模型标志着业界首个端到端全双工全模态大模型的诞生。

在此之前,多数AI系统采用的是半双工交互模式,即一次只能处理一个用户指令或回复。

用户与AI之间无法同时进行交流,且AI不能随时感知环境变化和打断对话,这限制了多模态AI的应用场景。

MiniCPM-o 4.5是面壁智能今年2月推出的全双工全模态模型版本,具备多项先进的功能和技术特点。

它的参数规模约为90亿左右,能够处理视频、音频和文本流式输入,并能连续输出文本与语音信息。

利用MiniCPM-o 4.5,用户可以在个人电脑上实现无需网络连接并使用消费级显卡来运行一个人工智能助手,该助手可以同时进行视觉识别、声音理解和对话互动。

最新的模型量化和推理性能优化工作已经完成,并且在最低配置为12GB显存的RTX 5070上进行了测试。这大大降低了个人设备上的部署门槛,M1-Max系列Mac电脑也能够运行该模型,建议内存超过16G。

目前有一个视频展示了MiniCPM-o 4.5在笔记本电脑上完整部署和运行的过程,其中包括全双工语音对话、实时视觉理解和主动提醒等功能演示。

自发布以来,这款软件的下载量已经超过了二十五万次。

此外,MiniCPM-o 4.5还提供了在线体验Demo、全模态全双工API和端侧安装包Comni及Demo仓库。

MiniCPM-o 4.5的核心技术是Omni-Flow流式全模态框架

这一模型的流畅交互能力得益于与清华大学合作开发的Omni-Flow流式全模态框架,它是此次报告的重点内容之一。

Omni-Flow打破了传统模型单独处理回合对话的方式,实现了多模式信息的无缝整合和实时更新。

通过创新的时间对齐机制,该框架能够将视觉、音频及文本等多元输入进行精准同步,并分解为周期性的时序数据块。

这一过程使得MiniCPM-o 4.5能够在每秒刷新一次的频率下持续更新环境感知和用户意图理解,无需额外依赖语音活动检测工具即可实现即时响应、自由打断等功能。

在架构设计上,模型采用了轻量化的端到端全模态方式,由四大核心模块组成:视觉编码器、音频编码器、语言模型基座以及语音生成解码器。

视觉编码器和音频编码器分别负责环境感知和声音信息采集;而8B参数的Qwen3-8B LLM则用于处理复杂的语义理解任务;

- 轻量级语音Token解码器实现高质量的语音生成输出。

- 模块化的设计不仅提高了模型的整体效率,也大大降低了复杂声学任务对计算资源的需求。

- 同时,自主研发的时间交错语音生成方案TAIL使得文本和语音输出更加流畅自然,极大地减少了延迟问题。

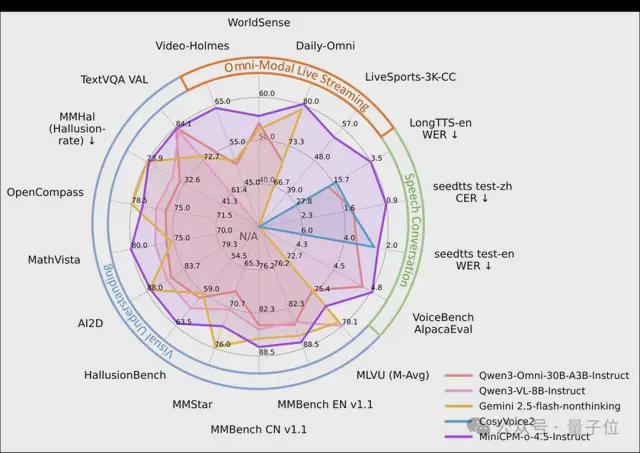

- 尽管参数量不大,但MiniCPM-o 4.5在多项权威评测中表现优异,综合性能与多款行业领先的大型模型相媲美甚至超越。

它的视觉识别能力获得了OpenCompass和MMBench的高分评价,在图像理解、数学推理等方面也表现出色;

在全模态动态交互和视频场景分析领域,MiniCPM-o 4.5的优势尤为明显。

Daily-Omni和Video-Holmes等评测数据表明其性能优于其他大型模型;在LiveSports-3K-CC测试中胜率达到了54.4%。

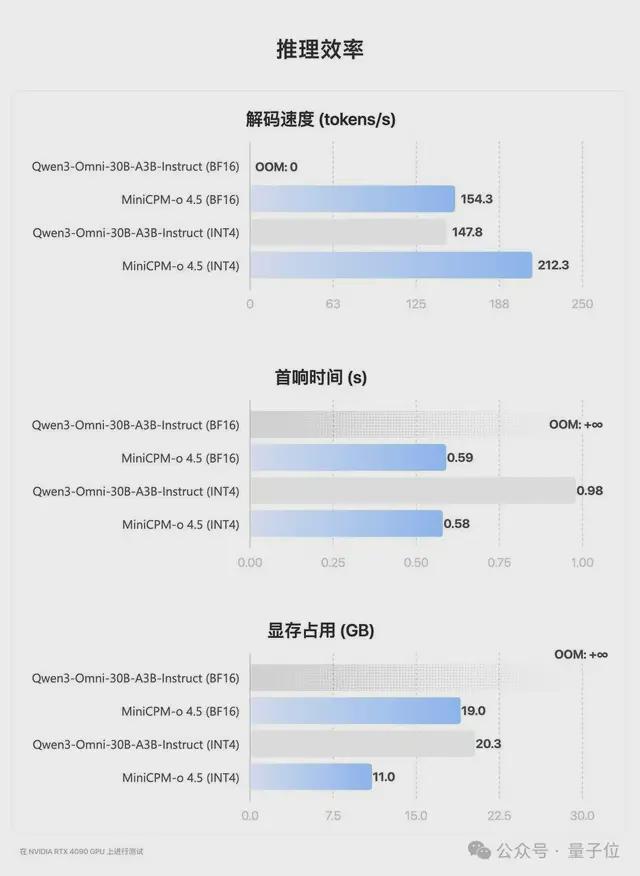

模型的推理效率也是一个亮点。

经过量化处理后,模型所需的显存占用量显著减少,仅需12GB即可运行,并且解码速度比同类产品快40%,响应时间也更短。

此外,MiniCPM-o 4.5还具备多种实用功能和应用场景适应性。

支持实时双语语音对话、高质量语音生成以及简便的声音克隆与角色扮演功能;

OCR文档解析能力强大,并支持高清图像处理及多语言解析。

模型兼容传统轮次对话模式的同时,也完美地实现了Omni-Flow全双工流式交互。

为了促进技术的普及和应用落地,面壁智能构建了一个全面开放的技术生态系统。

面向普通用户提供了无需注册、下载即可在线体验Demo,并推出了适用于Windows及macOS系统的桌面端一键安装包;

开发者则可以通过API快速接入各类应用场景,并拥有完整的开源代码和部署方案支持自由开发与调试,有助于全模态AI应用的迅速推广。

通过原生集成全双工、持续感知等功能,MiniCPM-o 4.5大大扩展了智能交互的应用场景边界。

在生活服务领域,它有望成为用户身边的智能助手;

而在无障碍公益方面,则可为视障用户提供环境识别与导航帮助;

智能车载和具身智能化等领域也同样适用。

MiniCPM-o 4.5的出现标志着“主动式AI”从理论走向了实际应用阶段。

虽然团队指出该技术在长时间交互稳定性、行为丰富性以及复杂环境应对能力方面仍有改进空间,但这并不影响其开创性的意义和价值。

目前MiniCPM-o 4.5的技术文档及相关资源已经上线GitHub及面壁官网,欢迎广大用户进行体验与反馈。

依托原生全双工、持续感知、主动交互的核心能力,MiniCPM-o 4.5突破了传统AI单次问答的场景局限,解锁了大量全新流式交互应用场景。

在生活服务领域,有望作为沉浸式智能陪伴助手,在用户运动、烹饪、日常劳作时实时答疑、主动提醒、全程指导。

在无障碍公益领域,可为视障人群提供实时环境感知服务,主动播报路况、设备状态、环境变化,成为可靠的“视觉辅助助手”。

在智能车载领域,可以持续监测路况与驾驶员状态,主动预警风险、提示可用车位、辅助泊车,提升驾驶安全性。

在具身智能领域,可作为机器人核心大脑,持续感知动态环境、自主决策交互时机,适配智能机器人、智能家居等智能化场景,覆盖生活化、公益化、工业级多维度需求。

可以说,MiniCPM-o 4.5把“主动式AI”从概念变成了可以在你电脑上跑起来的东西。

当然,团队也在技术报告中坦诚指出了当前不足:

长时间交互的稳定性、主动行为的丰富性、对复杂场景的鲁棒性,都还有提升空间。

但这不妨碍它已经立起了一个新的起点——全双工全模态、端侧可部署、全栈开源,这条路线跑通了。

目前,MiniCPM-o 4.5在线体验、API、端侧安装包、Demo代码仓库,所有入口都已在GitHub和面壁官网上线。

感兴趣的小伙伴可以直接上手体验~

期待大家在评论区反馈。

技术报告PDF:

https://github.com/OpenBMB/MiniCPM-o/blob/main/docs/MiniCPM_o_45_technical_report.pdf

在线体验:

https://minicpmo45.modelbest.cn/

在线体验(手机端推荐):

https://minicpmo45.modelbest.cn/mobile/

GitHub Demo(含本地安装包):

https://github.com/OpenBMB/MiniCPM-o-Demo

抱抱脸:

https://huggingface.co/openbmb/MiniCPM-o-4_5

魔搭:

https://www.modelscope.cn/models/OpenBMB/MiniCPM-o-4_5