新智元报道

Anthropic最近为Claude添加了一项新功能,允许用户在对话中直接生成交互式图表和流程图。这项创新性地增加了用户的互动体验,无论点击何处都能展开详细信息。

3月12日,Anthropic正式宣布了这个更新:现在,用户可以在与Claude的对话中创建交互式的可视化内容了!

如果你向它询问元素周期表的相关问题,它可以立刻生成一个可点击的图表,并且每个元素点进去都有详细的描述信息。

有意思的是,就在两天前,OpenAI也推出了类似的交互式可视化功能给ChatGPT;

而早在去年11月,Google的Gemini就已经开始在这方面有所动作了。

在短短的一周内,这三大公司分别发布了各自的新技术。这样的同步更新难道只是巧合吗?

如果让Claude拥有一块虚拟画板会发生什么呢?

说到底,“给AI一块白板”和传统的图像生成概念大相径庭。

Claude使用HTML代码和SVG矢量图形来创建其可视化内容,这相当于为它提供了一张可以边谈边绘的空白画布。

相比之下,Midjourney的图像是更像一个程序员现场编写代码并即时渲染出来的结果。

与Claude现有的Artifacts功能相比,“白板”的定位有着本质的区别。

Artifacts是用户可以下载、分享和多次使用的固定作品,在对话结束后依然可以在侧边栏中找到。

而这些对话中的可视化内容则是临时性的,随着对话的推进可能会消失。

用户如果觉得某个图示有问题,只需简单指出,Claude会立刻进行修正;想要深入了解某一部分,则可以通过点击来进一步展开。

这项功能最初是一个名为“Imagine with Claude”的实验项目。

当时仅对Max用户开放了几天后就被关闭了,许多人认为这只是技术演示。

不过半年之后,这项核心能力以一种更加实用的方式重新上线了。

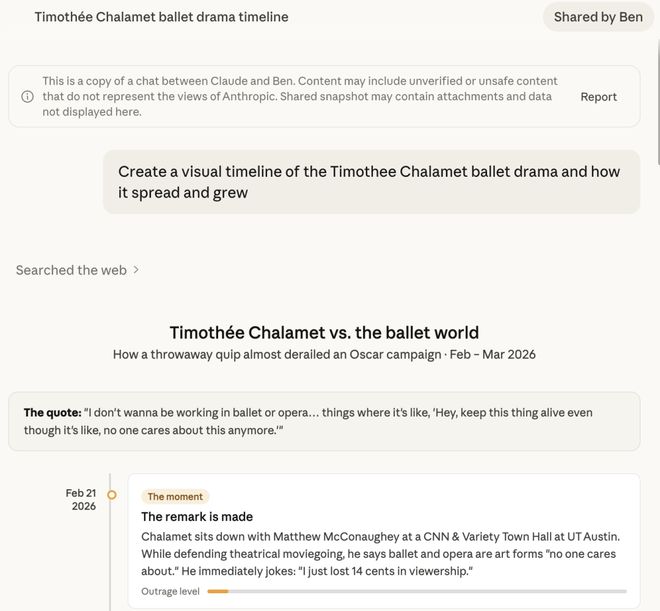

《Inc.》杂志的记者曾尝试让Claude生成一个关于Timothée Chalamet争议事件的交互式时间线图。

Claude不仅完成了完整的可视化节点展示,还添加了一个衡量“愤怒指数”的仪表盘。

想要查看完整示例,请访问这个链接:https://claude.ai/share/50b1325b-e9c7-4de1-a80c-eda6a4999975

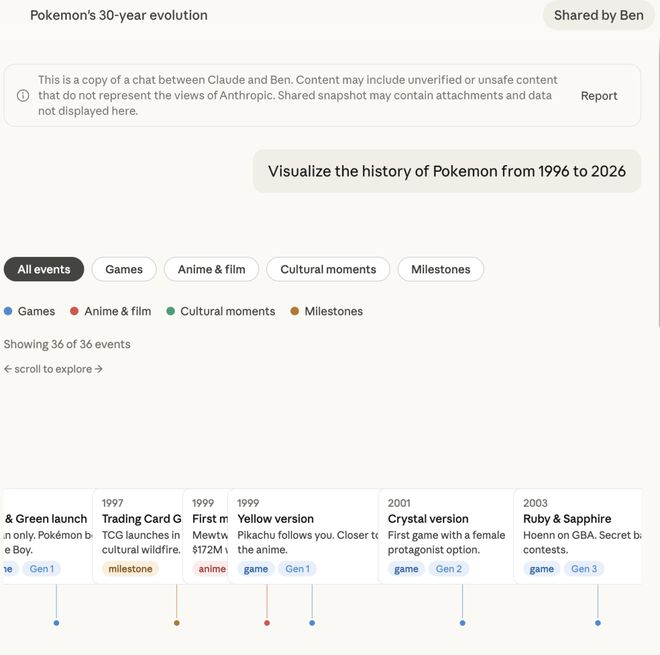

另一个测试则是让Claude制作宝可梦系列的视觉历史,涵盖游戏、影视和文化事件等分类筛选器。

想要了解更多,请查看这个链接:https://claude.ai/share/7ae16a77-dc6a-4b12-bd76-234b7ecec465

这项功能对所有用户都是默认开启,并且免费用户也可以享受。

目前,这项服务支持Web端和桌面版,但移动端尚未开放。

三家公司几乎在同一时间推出类似的更新,这是否意味着它们有意为之呢?

在2025年11月,Google率先推出了交互式图像功能,将教科书中的静态图变成可以点击的学习工具。

到了2026年初,Google又推出了“Guided Learning”模式,集成了图像、视频和测验内容以提供一个全面的学习伴侣。

2026年3月10日,OpenAI紧随其后,为ChatGPT增加了“动态视觉解释”,覆盖了70多个数学和科学概念。

每周有超过一亿人利用ChatGPT学习这些学科领域,这表明它的用户基础相当庞大。

三天之后,Anthropic也宣布其更新:而且这项新功能对所有用户免费提供。

对比之下,Google在去年12月为Gemini Ultra推出了高级交互式图表和模拟功能,但每月订阅费高达200美元,门槛较高。

一直以来,Anthropic专注于文本和代码领域的发展,在音频、图像、视频等多模态方向投入较少。因为OpenAI和Google已经在这些方面倾注了大量资源。

现在,Anthropic选择了一条不同的道路:不做图像生成,而是用代码绘制图形,充分发挥自身优势。

尽管三家都在开发交互式可视化功能,但它们的实现方式差异明显。

OpenAI提供了结构化的解决方案,涵盖70多个预设主题,在教学设计方面表现出色。然而,这限制了它的灵活性和适用范围。

一条赛道,三种打法

Google则采取了一种不同的策略:为现有的图像添加智能注释功能,并将其整合到其教育生态系统中。

而Claude则提供了一个通用的白板解决方案,不限制主题或场景,并且可以与多个第三方应用联动使用。

今年1月,Claude上线了Connectors功能,可以直接操作第三方应用程序。这次更新进一步扩展了其功能范围。

然而,“边说边画”的技术仍处于初级阶段。

Digital Trends的一篇报道中提到,Anthropic将这次更新视为“Claude学会了选择最佳表达方式”。

在某些情况下,文本是最好的沟通手段;而在其他场景下,则可能是一张图或一个交互式工具更为合适。

从“文字助手”到可以生成多种格式内容的引擎,Claude正在经历一次转变。

AI竞赛已经持续了三年多的时间。模型的能力差距越来越小,用户对不同产品的感知也越来越模糊。

谁更聪明已不再是关键区别,“谁更能有效沟通信息”成为了新的竞争焦点。

在这一轮更新中,三家公司都一致认为AI需要学会“画画”来提高表达效果。

当然,这些功能目前仍处于早期阶段。Claude的标注偶尔会出现错误,ChatGPT的交互模块覆盖范围有限,而Gemini的一些高级功能则需要用户支付较高的订阅费。

实际的竞争或许不在谁先上线了这项技术,在于谁能将其无缝集成到用户体验中。

2026年3月这一周,可能标志着AI从文字工具转变为表达媒介的开始。

通用白板 :Claude

不限主题,不限场景,不要预设模板。

建筑受力分析、职业选择决策树、公司收入趋势图、RGB调色板......理论上,它能画任何可以用代码表达的东西。

而且这些可视化还能和Figma、Canva、Slack等第三方应用联动。

这暗示Anthropic想的不只是聊天增强,而是一个连接生产力工具的视觉交互层。

今年1月Claude上线的Connectors功能让它能直接操作第三方应用,现在加上可视化,拼图又多了一块。

当然白板也有白板的缺点。

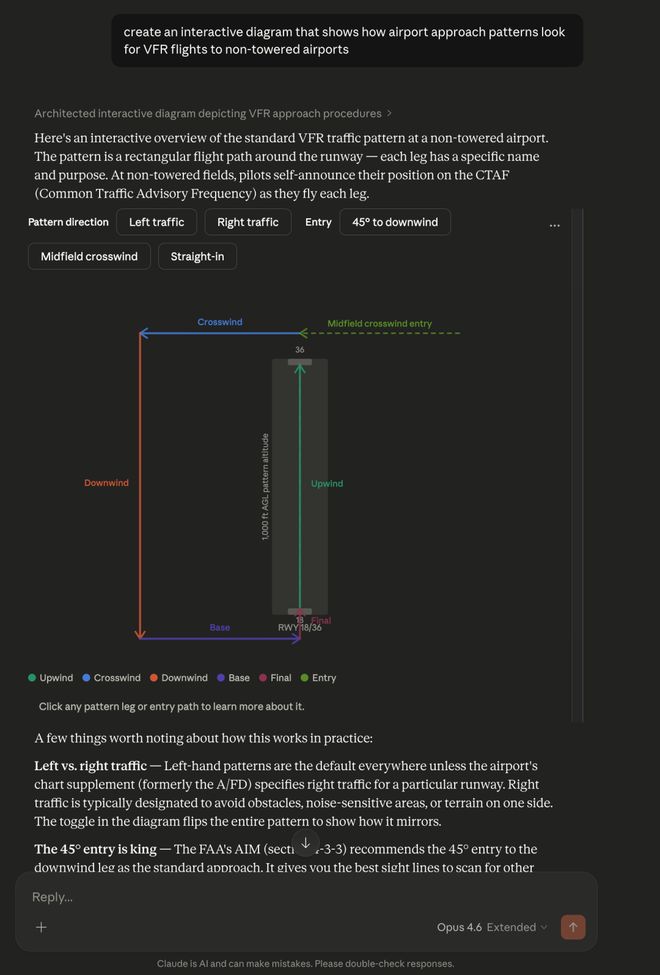

The New Stack的记者让Claude画非塔台机场的VFR进近模式图,大体对了,但「中场侧风进入」的标注位置搞错了。

还有速度问题。一个复杂可视化可能要等30秒,而用搜索引擎找一张类似的图只要3秒。

不过在Beta阶段,这些都正常。

光会说已经不够用了

三家同时押注可视化,可能意味着纯文本回复正在触及天花板。

AI聊天从2022年底火到现在,核心交互一直是你问我答,全靠文字。

但越来越多场景证明文字难以胜任。

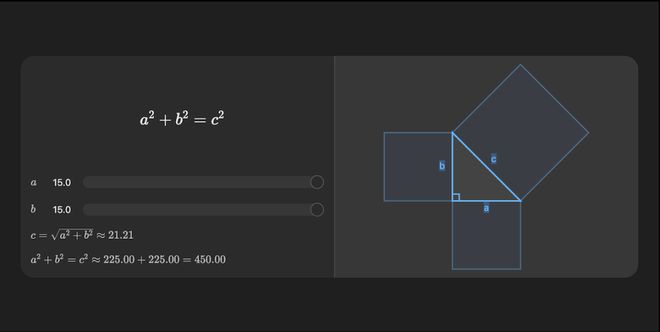

解释时间复杂度,一张图比三段话清楚;呈现销售数据,一个可拖动的图表比一堆数字有感觉;教物理概念,让学生自己拖参数看变化比对着公式发呆管用得多。

教育研究也早就说了,交互式学习比被动阅读的理解效果好得多,这不是什么新发现。

之前的AI没有画的能力,只能用文字硬扛。

现在,三家同时把这个技能点亮了,区别只在切入角度。

而且各家的选择都和自身生态有关。

OpenAI有1.4亿周活学生用户,做教育顺理成章;Google有LearnLM和Classroom生态,做标注式学习是老本行;Anthropic代码能力最强,用代码画白板是最自然的延伸。

Digital Trends的报道提到一个有意思的说法:Anthropic把这次更新定义为Claude「学会选择最佳表达格式」。

有时候文字最好,有时候一张图更好,有时候一个可交互的小工具最合适。

再加上今年上线的食谱卡片、天气可视化、Figma/Canva/Slack等应用内交互,Claude正在从「文字助手」变成「多格式表达引擎」。

AI竞赛持续了三年多,模型能力差距越来越小;跑分互有胜负,用户感知越来越模糊。

谁更聪明拉不开差距,「谁更会表达」成了新战场。

这一轮,三家答案出奇一致:让AI学会画画。

不过话说回来,这些功能都还是早期。

Claude的标注偶尔出错,ChatGPT的交互模块覆盖面有限,Gemini的高级功能需要200美元的入场费。

真正的竞赛不在谁先上线,在谁能把「边说边画」做成用户根本不会注意到的自然交互。

2026年3月这一周,大概就是AI从文字机器变成表达工具的起点。

参考资料:

https://claude.com/blog/claude-builds-visuals

https://www.theverge.com/ai-artificial-intelligence/893625/anthropic-claude-ai-charts-diagrams