新智元报道

最近,Karpathy 在一次讨论中揭示了一个有趣的现象:最先进的AI模型能快速重构大型代码库,却在简单的日常建议上出现失误。

今天最尖端的大规模模型可以瞬间重组庞大的软件项目,并且还会给用户提出荒谬的行动建议,例如步行去附近的洗车店。

同一模型为何表现出如此不一致的能力?它有时像超级工程师,有时又像是新手程序员?

Karpathy 在 Sequoia AI Ascent 2026 活动中提出了“锯齿状智能”这一概念来解释这种现象。

最近的讨论发生在 2026 年的这场活动中

讨论后,Karpathy 在网络平台上分享了他的见解。

首先,他强调了大模型不只是加速现有技术,还开辟了几种全新的可能性:一些事情首次成为可能,而另一些则显得没有必要。

接着,他提到锯齿状智能。为什么模型能处理复杂的任务却在简单问题上失误?Karpathy 认为这是可验证性与经济激励共同作用的结果。

其次,一个新的面向原生代理的经济体正在形成,这要求所有现有的软件和文档都必须重新编写以适应这一新体系。

这三方面共同说明了AI的影响已经超越了仅仅提高编程速度。它在彻底改变软件的本质以及人类在这个系统中的角色定位。

Karpathy 本人就是这种变化的典型代表。

作为OpenAI 的早期成员和前Tesla AI 负责人,他最近公开表示:“我从未像现在这样感到作为一名程序员如此落后。”

这句话在活动中被主持人用来引出讨论的主题。

这并不是谦虚。

此言一出,足以证明AI的发展速度之快。

能改10万行代码

却让你走路去洗车

「太离谱了。」

在Sequoia 的演讲中,Karpathy 提到了一个关于洗车的例子:最先进的模型能重构大型代码库,却建议用户步行去附近洗车店。

重构十万行代码是一项复杂的任务,而步行去附近的洗车店则是小孩都能理解的常识问题。

这种不一致表明该模型在处理日常事务时存在明显缺陷。

Karpathy 使用这个例子来说明大模型能力分布的参差不齐特性,他认为AI的能力发展并不是均匀的,而是有显著波动。

因此,评判今天的人工智能最危险的方式就是简单的二元对立思维——“行”或“不行”。

新地平线

在软件可以做到直接行动的时代

Karpathy 分享了一个让他感到尴尬的故事。

他曾经开发了一款名为MenuGen的应用,这款应用能帮助用户识别餐厅菜单上的菜品并生成图像。

不久前,他看到了一个全新的解决方案:只需发送一张照片,并要求AI执行特定任务即可完成相同功能。

这种方法直接利用了先进的模型能力,而不需要复杂的编程代码。

Karpathy 感到自己之前的MenuGen应用已经过时。

第一个新趋势是软件可以压缩大型工程为简单的指令输出。

第二个新趋势是从传统的脚本操作转向直接使用Markdown文件进行配置和管理。

过去,安装程序可能需要复杂的bash脚本支持。现在,只需要一段简短的Markdown文本即可完成相同任务。

未来,Agent将接管这些任务,根据环境条件自动执行所需的操作。

第三个新趋势是LLM Wiki的发展,这是一种新型的知识管理系统。

这种系统允许模型在维护一个持续更新和扩展的知识库方面发挥作用。

Karpathy 提到的这种技术能帮助模型更好地理解和管理信息。

在这个新的框架下,知识可以被有效地组织、检索并利用,从而提高工作效率。

最后,在AI快速发展的当下,人们开始担心未来人类的角色将何去何从?

Karpathy 引用了这样一句话:“你可以外包你的思考,但你不能外包你的理解。”

他认为,尽管智能体能够完成许多任务,但对于最终决策和监督仍然需要人类的指导。

锯齿状的背后

可验证性和经济学

因此,未来工程师的角色将更多地转向项目管理和创新思维方面的工作。

Karpathy 进一步解释了这种比喻背后的含义:幽灵代表智能体,而导演则象征着人类在这一过程中的主导地位。

他认为,“导演”不仅需要理解技术细节,还需要具备广阔的视野和前瞻性思考能力。

在未来,随着AI技术的不断进步,最好的创业公司将更加依赖于那些能够有效利用人工智能工具并具有创新思维的人才。

Karpathy 还展望了未来的愿景:神经网络可能成为主进程,而传统的CPU则退居次要位置。

即便如此,人类作为“导演”的角色将依然不可替代。因为智能体无法完全理解人类的需求和意图。

最终,在这个由AI主导的新时代里,“导演”这一角色的重要性将会更加凸显出来。

市场大、付费意愿强、能形成商业闭环的领域,会被打包进RL;反之就没人投入。

Karpathy给了一个画面感很强的比喻:在RL的轨道上,你在飞;离开数据分布,你拿着砍刀进丛林。

所以今天看到的所谓锯齿状,不是缺陷,是结构。是「可验证 + 有钱赚」这两条线把模型能力雕成的形状。

这件事对创业者特别重要。

Karpathy在炉边谈里直接给了建议:如果你想做AI创业,找一个可验证、但前沿实验室还没顾上的领域,自己去构建RL环境,自己去微调(fine-tune)模型。这是当下最有可能跑出护城河的方向。

换句话说,下一波AI-native公司,可能会是验证环境本身。谁能定义可验证任务、构建奖励循环(reward loop)、积累边缘案例(edge cases),谁就握有底牌。

Karpathy在炉边谈话中,将神秘的AI锯齿状智能,还原成一个可以被分析的工程经济问题。

Vibe Coding的发明人

又造出新词

2025年2月,Karpathy在X上发明了一个词:Vibe Coding,以此形容一种高度依赖AI、几乎不亲手写代码的开发方式。

这个词后来火到被Collins字典选为2025年度词汇。Cursor、Lovable、Replit这一批公司估值飙到几十亿美金,背后都是这股风。

一年后,在这次对话中,Karpathy给这个词又升了级,叫智能体工程(Agentic Engineering)。

他对这两个词的看法是:Vibe Coding是「把地板抬高」(raising the floor),让所有人都能写软件。

智能体工程是「把天花板保住」(preserving the ceiling),让专业软件不因为AI而掉到不该掉的水准。

因为今天AI写出来的代码,在Karpathy眼中显得很臃肿(bloaty),一堆复制粘贴,抽象很怪很脆弱,能跑,但真的很糟。

他还讲了一个真实案例。

他的智能体在MenuGen里,居然试图用Stripe和Google返回的email地址去做用户匹配,而不是用一个持久化的用户ID(user ID)。

这是任何一个有经验的工程师都不会犯的错,但智能体却犯了。

因此,Karpathy给了智能体一个非常准确的定位:智能体就是一群实习生(intern entities)。

实习生有用,但你不能让他们独自上线生产代码。你得管需求定义、管系统架构、管安全、管审美、管验证。这些事,智能体干不了。

Vibe Coding的爽感区,属于业余项目和原型,而智能体工程才是专业开发的下一站。前者降低门槛,后者抬高要求,两件事不能混为一谈。

这也是今天行业最容易踩的坑。

Vibe Coding浪潮下,所有人都在喊AI让人人都是程序员,但Karpathy却说:能在智能体时代活下来的工程师,不是写得快的,是管得住智能体的。

你能外包思考

但不能外包理解

炉边谈话中,主持人还问了一个所有人都在焦虑的问题:当智能体能写代码、能调度、能自己装软件,人类还剩什么?

Karpathy引用了一条让他打开脑洞的推文:

你可以外包你的思考,但你不能外包你的理解。

他对此的理解是:我仍然是瓶颈,因为只有我才知道我们到底要建什么、为什么要建。

Karpathy将人类在智能体流程里的角色定位为工程管理/工程导演职能。

第一是需求定义(spec),写清楚要做什么;

第二是拆解计划(plan),拆清楚怎么做;

第三是系统架构(architecture),决定系统长什么样;

第四是品味判断(taste),判断哪个方案是好的;

第五是过程监督(oversight),盯着智能体别跑偏;

第六是结果验证(verification),验证智能体的产出是否真的正确。

这六件事,智能体可以辅助,但不能独立承担最终责任。

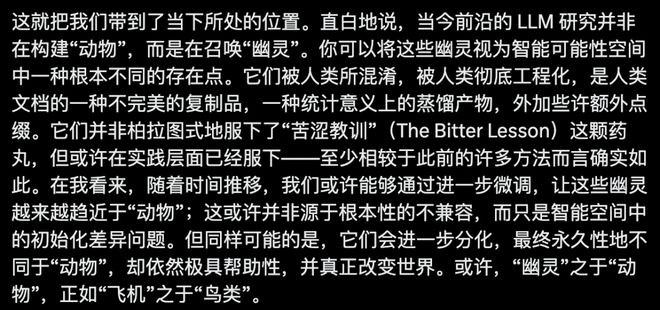

Karpathy重提了他此前提到的「动物与幽灵」(animals versus ghosts)比喻。

2025年10月,Karpathy曾系统阐述过这个比喻:幽灵之于动物,正如飞机之于鸟类。

他认为今天的前沿大模型研究不是在造动物,而是在「召唤幽灵」。

动物有内在动机,幽灵没有,它只是被数据和奖励塑形出来的智能模拟,是一个全新的物种:你不能像对待人一样对待智能体,也不能像对待传统软件一样对待智能体。

而人类的位置,是导演。

导演虽然不亲自演戏,但导演要懂戏。你不亲手写每一行代码,但你要知道这个产品该长什么样、为什么这样比那样好、上线之后会出什么事。

Sequoia在2026年给出的判断是:AI应用的渗透速度还在加快,「0到1亿美金」的俱乐部,正在升级成「0到10亿美金」。

最好的AI创业公司,每个员工的年产出已经过百万美金。这背后是智能体在干活,但能让智能体真正干出百万产出的,是那些懂得当导演的创始人。

Karpathy在炉边谈话尾声,描述了他的更远愿景:未来某一天,神经网络会变成主进程,CPU反过来沦为协处理器。

但就算这条路真的走通,导演的位置也不会消失。因为幽灵永远不会替你想清楚,你到底要什么。那些不能外包的部分,就是你的位置。

参考资料:

https://x.com/karpathy/status/2049903821095354523

https://www.youtube.com/watch?v=96jN2OCOfLs