腾讯现已开放手机端离线翻译软件的源代码,该应用大小仅为0.4GB,并支持33种语言。

用户无需连接网络,下载后即可在手机上独立运行。

4月29日,腾讯混元发布了极致压缩版本的Hy-MT1.5-1.8B-1.25bit翻译模型。这款模型将原本支持33种语言的大规模翻译软件缩小至440MB,在无需网络连接的情况下可直接下载并安装在手机上运行,且其翻译质量超越了谷歌翻译。

该离线翻译工具的性能展示(设备:高通骁龙865,内存为8GB)

这款离线翻译软件基于混元翻译大模型Hy-mt1.5开发。Hy-mt1.5是由腾讯团队设计的专业级翻译模型,原生支持33种语言、五种方言/少数民族语言以及共计1056个方向的互译服务。无论是常见的中文与英文之间的转换,还是法语、日语、阿拉伯语、俄语乃至藏语和蒙古语等较少见的语言,它都能轻松应对。

令人瞩目的是,仅使用了1.8B参数量的Hy-mt1.5模型,在严格的测试中,其翻译效果可与商业级API及235B级别的大模型相媲美。它的表现不仅优于Google翻译等主流系统,更证实了在高效优化的情况下,轻量化模型也能展现出卓越的翻译能力。

实际应用中,混元团队发现,即使是在精度为FP16的情况下,原始的1.8B参数量的大模型仍需占用3.3GB内存空间。鉴于手机上宝贵的存储资源和速度要求,团队认为有必要进行量化压缩处理。

量化压缩是指将原本用16位数字表示的模型参数转换成更低位数的方式储存,类似于把高清图片压缩成缩略图,文件大小显著减小但依然清晰可见内容。为了满足不同手机用户的需求,腾讯特别推出了两种极端的量化方案:2-bit和1.25-bit。

2-bit模型在SME2及Neon内核上的速度对比演示

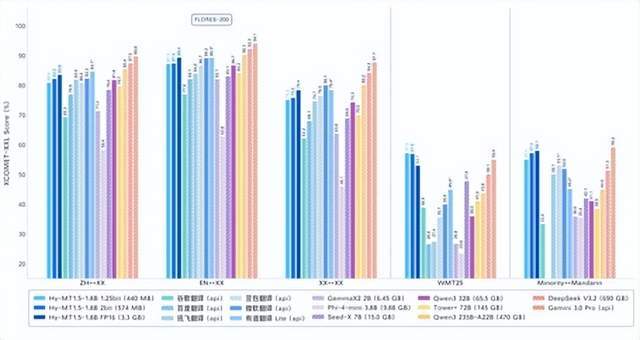

不同规模的模型在外语互译中的效果评分表现在FLORES-200中有所体现

腾讯混元不仅开源了翻译模型的权重,还推出了一款名为“腾讯混元翻译Demo版”的实际应用软件。该版本特别设计为支持后台取词模式,无论是在本地查看邮件还是浏览网页,都可以随时调用。完全不依赖网络连接,并且无需订阅服务,一次下载即可永久使用。

后台取词模式的展示(设备:高通骁龙7+ gen 2,内存为16GB)

腾讯混元翻译模型表现出色,在多项国际机器翻译竞赛中获得第一名,并已在腾讯内部多个业务场景得到实际应用,包括元宝、腾讯会议、企业微信、QQ浏览器以及客服系统等。

体验链接:

Huggingface(海外用户) :

魔搭社区(国内用户):

允中

允中