新智元报道

NVIDIA 最近发布了 Lyra 2.0 并将其完全开源,与谷歌保守的技术态度形成鲜明对比。Lyra 2.0 简化了去噪步骤并提升了图像到3D世界转换的效率。

AI 技术封闭的时代即将过去。

想象一下,你有没有想过能通过一张旧照片重新体验过去的场景?

在以前这可能是电影《盗梦空间》中的情节。然而今天,它已经成为现实的一部分。

NVIDIA 宣布了一个重大消息:开源 Lyra 2.0 的全部代码和资源。

只需上传一张普通的二维图片,就能瞬间生成一个可以探索的三维交互式环境。

谷歌则选择保守策略,将其核心技术像珍宝一样秘而不宣。然而 NVIDIA 却慷慨地将这项技术免费分享给全世界开发者。

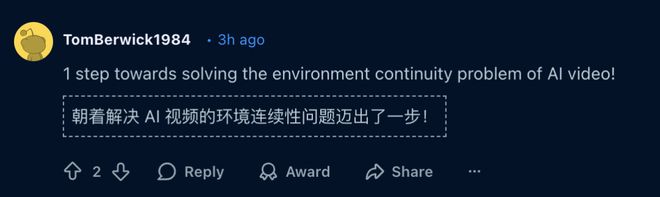

这一举措不仅激发了社交媒体上的热烈讨论,也让众多技术人员在 Reddit 上感叹这标志着 AI 视频环境连续性问题的终结。

Lyra 2.0 的背后,是对物理世界未来的冷酷收割逻辑。它不仅仅是一个让老照片变得立体的新奇玩具。

它的核心在于将一张图片转化为一个持久且可以探索的三维空间。

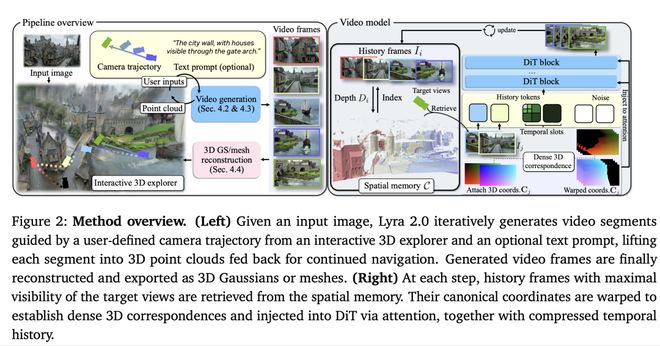

NVIDIA 把这一过程拆解为一系列精确的操作流程。

以Wan 2.1-14B(一个拥有140亿参数的扩散Transformer)作为视频生成的基础模型,给定一张图片和摄像机轨迹后便能生成一段漫游视频。

分辨率为832×480,标准流程需要35步去噪,而蒸馏版本只需四步即可完成。

之后这些视频帧会被送入前馈3D重建模型,直接输出三维高斯点云和表面网格。

到底怎么做到的?

一场优雅的技术暴力

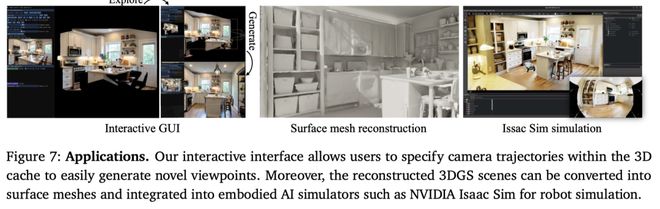

NVIDIA 还提供了一个交互式GUI工具,让用户可以在累积的点云中规划摄像机路径,并实时生成新的场景内容。

最终可以导出到物理引擎如Isaac Sim,用于机器人导航、物理仿真及具身AI训练等用途。

但真正使 Lyra 2.0 引人注目的地方在于解决了两个长期以来困扰所有前辈的难题:空间遗忘和时间漂移。

第一步:图片变视频。

空间遗忘指的是当摄像机走过一段距离后,早先生成的内容无法保持一致性的问题;而时间漂移则是每一帧生成时都可能引入微小误差,累积起来导致场景变形的情况。

以往的方法试图通过3D几何约束或长时间上下文窗口来解决这些问题,但这些方法要么会导致循环错误积累,要么在摄像机远离初始位置后失效。

Lyra 2.0 则采用了全新的策略:它保留每一帧的三维几何信息,并利用它们检索和建立密集的空间对应关系,而不是直接用于渲染或像素级条件约束。这样模型就能始终保持空间记忆。

第二步:视频变3D。

同时通过自增强训练技术让模型在学习阶段就熟悉自己的错误模式,并学会如何纠正这些误差,从而减少了生成过程中时间漂移的现象。

这些改进使得Lyra 2.0能够实现长距离3D一致性生成,极大地扩展了探索的可能性。

第三步:3D可交互。

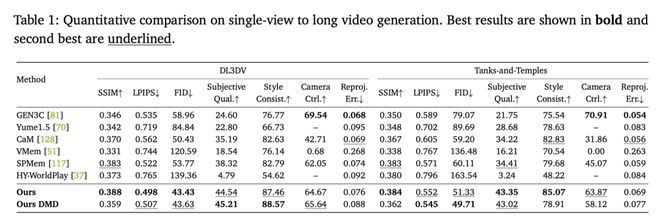

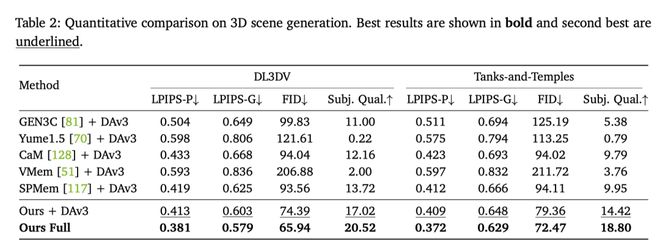

在 DL3DV 和 Tanks and Temples 的基准测试中,Lyra 2.0 显示出了显著的优越性,其性能超越所有基线方法。

相比于先前版本,Lyra 2.0 实现了一次质的飞跃。它不仅突破了短视频和小范围场景的局限,还能够处理包含大幅视角变化和位置重访的长摄像机轨迹。

视频生成底座也从 Cosmos 升级到了 Wan 2.1-14B,并且重建模型经过微调以增强对常见小型几何不一致性的鲁棒性。这些改进显著提升了视觉保真度和生成能力。

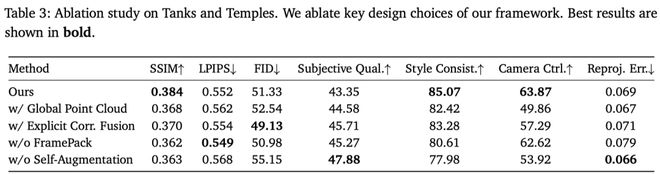

消融实验进一步证实了每一项技术贡献的重要性,如去除抗遗忘机制会导致严重幻觉,而缺少自增强训练则会出现明显的漂移现象。

尽管 Lyra 2.0 在3D世界建模方面取得了重大进展,但仍然面临着深层次的智能困境。当前的技术还无法真正理解物理世界的因果关系和规则。

实际上,Lyra 2.0 主要依赖于空间记忆来防止遗忘,并通过自增强训练机制减少时间漂移现象,而不是对场景有深入的理解或逻辑推理能力。

真正具备世界建模能力的系统应该能够理解因果关系、遵循物理定律并保持语义一致性。这需要在AI技术上实现根本性的突破,从统计模式匹配向因果世界理解转变。

虽然视频扩散模型已经展示出了惊人的视觉想象力和局部3D一致性,但从“好看的3D场景”跨越到“真正可信的世界模拟”,仍需一段漫长的道路。

NVIDIA 选择开源Lyra 2.0 的原因之一可能是希望通过全球开发者的共同努力来推动这一领域的进步。这不仅体现了技术开放的重要性,也预示着AI技术从工具应用向世界建造者转变的趋势。

这一举措标志着人工智能不再仅仅是绘画、诗歌创作或编程的辅助工具,而是正在成为构建新世界的强大引擎。

NVIDIA 已经将这项具有革命性的技术交到了每一个人手中。未来的世界模拟与创建,或许就在我们每个人的手指间。

为什么会这样?因为当前的视频模型是自回归生成的,有一个有限的时间上下文窗口。

当摄像机走远了,早期的帧就从上下文中掉了出去。等你回头看,模型只能凭空「幻觉」出新的结构,和原来的完全对不上。

还有一个更阴险的问题:时间漂移(Temporal Drifting)。

每一帧的生成都会引入一点点微小的误差——颜色偏一点,几何歪一点。

一帧看不出来,十帧看不出来,但几百帧累积下来,整个场景就像被放进了哈哈镜,面目全非。

这两个问题是所有「长时程3D生成」方法的阿喀琉斯之踵。

之前的方法用3D几何做条件约束,但生成瑕疵会污染3D几何,3D几何又反过来带偏后续生成,恶性循环;用长上下文窗口硬扛,但摄像机一走远,锚定帧就失效了。

Lyra 2.0的解法,堪称教科书级别的工程智慧:

对付空间遗忘:几何只做「路由」,不做「渲染」。

Lyra 2.0维护了每一帧的3D几何信息,但关键在于——

这些几何信息只用来检索相关的历史帧并建立密集的空间对应关系,而不是直接拿去渲染或做像素级条件约束。

换句话说,几何负责「告诉模型应该参考哪些老画面,以及新画面和老画面在空间上怎么对应」,而实际的像素合成还是交给扩散模型的生成先验来完成。

这就像给模型装了一个「空间记忆GPS」,它永远知道自己走过哪里、看过什么,但不会被历史残留的渲染错误带偏。

对付时间漂移:让模型「吃自己的苦果」学会纠错。

NVIDIA提出了一种「自增强训练」策略。

在训练时,不总是给模型完美的真实帧作为历史条件,而是故意用模型自己一步去噪后的(带退化的)输出来替代。

这样在训练中,模型就已经见识过了「自己犯的错」,学会了「看到漂移就纠正」而不是「看到漂移就继续漂」。

这种以毒攻毒的策略,直接缩小了训练和推理之间的分布差距。

两招组合拳打下来,Lyra 2.0实现了远超前辈的长时程3D一致性——场景可以无限延展、自由回访,而且不会「转身就忘」。

实测数据:全面碾压

说得再好听不如看数据。

在DL3DV和Tanks and Temples两个经典基准上,Lyra 2.0的表现用「降维打击」来形容毫不过分。

更关键的是和基线方法的对比。

Lyra 2.0的两个变体——搭配DAv3重建模型和完整版——在LPIPS-G、FID和主观质量评分上全面超越所有基线方法。

和Lyra 1.0相比,2.0的进化是质的飞跃:

1.0的局限:2025年9月发布的Lyra 1.0已经很强了——它首创了「视频扩散模型自蒸馏」的范式,用单张图片生成3D高斯场景,发表在ICLR 2026上。但它只能处理短视频、小范围场景,做不了长时程探索。

2.0的突破:从「短视频3D重建」跃升到「大规模持久世界生成」。抗遗忘、抗漂移两大机制,让它能处理包含大幅视角变化和位置重访的长摄像机轨迹——这在1.0时代是不可能的任务。

底座升级:视频生成底座从1.0的Cosmos换到了2.0的Wan 2.1-14B,视觉保真度和生成能力都上了一个台阶。重建模型也做了针对生成数据的微调,对AI生成内容中常见的小型几何不一致具有更强的鲁棒性。

消融实验进一步验证了每项技术的贡献:

去掉抗遗忘机制,回访区域出现严重幻觉;

去掉自增强训练,长轨迹上的漂移肉眼可见;

两项联合使用才能得到最佳结果。

高维视角

3D世界模型的「智能困境」

我们也需要冷静地看到,无论是Lyra 2.0还是Genie 3,AI生成3D世界这件事目前都还面临一个深层困境——前沿智能的天花板。

什么意思?

当前的3D世界生成,本质上是在「视觉保真度」这个维度上疯狂内卷。

场景越来越逼真,几何越来越精确,一致性越来越好。

但这些生成出来的世界,本质上还是「死」的——它们没有物理规律的深层理解,没有因果推理,没有对「这个世界为什么是这样」的认知。

Genie 3号称有「涌现物理」,但它的物理一致性只能维持几分钟,复杂场景下很快就会出现违反常识的行为。

Lyra 2.0生成的3D资产非常精美,但它本质上是「记忆+补全」——用空间记忆防止遗忘,用自增强防止漂移,但并不真正「理解」场景的物理结构。

真正的3D世界模型,应该能够:

理解因果关系:推倒一面墙,隔壁房间会暴露出来;

遵循物理定律:水往低处流,球会弹跳;

保持语义一致性:厨房里不会突然冒出一架钢琴。

这需要的不仅仅是更大的模型、更多的训练数据,而是AI在世界建模能力上的根本性突破——从「统计模式匹配」走向「因果世界理解」。

目前来看,视频扩散模型作为3D世界生成的底座,已经展现出了惊人的视觉想象力和局部3D一致性。

但要从「好看的3D场景」跨越到「真正可信的世界模拟」,还有一段很长的路要走。

这可能也是为什么NVIDIA选择开源的原因之一——单打独斗到不了那个未来,但全世界的开发者一起搞,也许可以。

最后,NVIDIA还展示了交互式GUI、Isaac Sim仿真导出、表面网格提取等一系列实用功能。

翻译成人话就是:以后AI造世界,人不用去世界里采数据了。

AI不再只是画画、写诗、编代码的工具。它正在成为一个世界建造者。

而NVIDIA刚刚把造世界的钥匙,交给了所有人。

参考资料:

https://research.nvidia.com/labs/sil/projects/lyra2/