范凌谈转型:在人工智能时代,告别过去的自我是必然选择

在今天的讨论中,我们探讨了特赞新推出的企业级 AI 应用——GEA(General Enterprise Agent)。GEA 是一款基于大语言模型的企业级智能应用平台,旨在帮助企业实现自动化和智能化的业务流程。作者|周永亮我们首先回顾了特赞的发展历程及其在企业服务领域的成就。随后,我们重点讨论了 GEA 的设计理念、核心功能以及它为企业带来的价值。通过结合实际应用场景,如社交媒体管理与客户分析,

共找到 49 篇相关文章

在今天的讨论中,我们探讨了特赞新推出的企业级 AI 应用——GEA(General Enterprise Agent)。GEA 是一款基于大语言模型的企业级智能应用平台,旨在帮助企业实现自动化和智能化的业务流程。作者|周永亮我们首先回顾了特赞的发展历程及其在企业服务领域的成就。随后,我们重点讨论了 GEA 的设计理念、核心功能以及它为企业带来的价值。通过结合实际应用场景,如社交媒体管理与客户分析,

中国媒体称,人工智能(AI)公司深度求索(DeepSeek)的多名核心员工在过去一年里离职,下一代模型V4可能会在4月发布。据中国科技媒体“晚点LatePost”报道,去年下半年以来,DeepSeek已有多名核心员工离职。其中,DeepSeek第一代大语言模型的核心作者、参与历代模型训练的王炳宣,去年底被科技巨头腾讯挖走。DeepSeek-OCR系列的核心作者魏浩然约在春节前后离开,DeepSe

周四,谷歌宣布推出Gemma 4系列开放权重模型,旨在为AI智能体和编程环境提供优化支持,并采用更为宽松的Apache 2.0许可协议,以吸引更多企业用户。这一举措恰逢中国大语言模型快速发展之时。目前,多家中国企业如月之暗面、阿里巴巴千问等已推出多款性能优异的大规模语言模型,与国际头部产品形成竞争态势。针对日趋激烈的市场竞争环境,谷歌通过Gemma 4向企业客户提供了安全可控的本地化部署方案,并明

近日,阿里推出了其最新的大语言模型Qwen3.6-Plus,作为Qwen系列的首个升级版本。与前一版相比,该新模型特别加强了编程、智能体和工具调用等领域的技能,并且支持多达一百万个上下文窗口。目前市面上主流的Agent框架及各类编程工具都已适配此最新版本。官方提及的包括OpenClaw、Qwen Code、ClaudeCode、KiloCode、Cline以及OpenCode。在大模型调用平台Op

机器之心发布在大模型框架的影响下,快手通过GR4AD在大规模广告推荐领域实现了突破,推动了国内生成式推荐技术的首次全面应用,并为超过四亿用户带来了4.2%的广告收入增长。论文链接:https://arxiv.org/pdf/2602.22732一、引言:"如何进行推荐"的新思路近十年来,深度学习推荐模型(DLRM)几乎成为工业界推荐系统的主导力量。然而,在大语言模型(LLM)兴起后,人们开始思考能

据报道,当前许多人对AI技术的依赖日益增强,不仅因为这种技术能够显著提升工作效能和便利性,还由于它善于迎合用户。最近,《Science》杂志刊登了斯坦福大学团队的研究成果,详细探讨了大语言模型在社交互动中表现出的“奉承”行为。数据表明,在回应用户的观点时,AI系统比普通人类更有可能表示赞同,即便是面对明显有害或不道德的行为,其认同的概率也达到了47%。这项研究涵盖了11个主要的大语言模型,并通过了

据消息人士透露,谷歌 DeepMind 计划在 4 月 3 日(北京时间)凌晨发布其开源大模型 Gemma 系列的新版本——Gemma4。据悉,这一更新将允许中国内地的开发者直接访问和使用该模型。谷歌于今年推出的 Gemma 是一款开源大型语言模型产品线,它与谷歌旗舰闭源大模型 Gemini 使用了相同的底层技术框架。此前,该系列已推出了多个版本,并在全球开源大模型领域中与 Meta 的 Lla

EAIDC助力具身智能从技术演示迈向工程落地。作者|拾月如果说具身智能的浪潮由AI带动,那其发展脉络,也在不可避免地沿着AI的既有范式展开。尤其是在模型评测上,这种惯性已经十分明显。过去一段时间,具身模型的能力验证,很大程度上延续了大语言模型的路径——在虚拟环境中进行评测,在标准化任务中进行横向对比。但问题也正在这里逐渐显现。仿真环境可以加速迭代,却难以还原真实世界的复杂性。sim2real的GA

近日,《一见Auto》报道指出,小鹏集团副总裁兼智能座舱部门负责人魏斌已辞职,此前他因家庭原因而休长假。目前,该公司的智能座舱团队与自动驾驶团队合并组建了新的通用智能中心,由刘先明负责管理。在离职之前,魏斌的主要职责是推动视觉语言模型(VLM)大模型在智能座舱中的应用。魏斌曾担任高德地图的产品总监,专注于导航和地图产品的开发。加入小鹏集团后,他主要担任互联网中心的负责人,并主导了智能座舱的研发工

快科技3月31日消息,近日,比利时布鲁塞尔自由大学(VUB)数据分析实验室发布重磅研究成果,证实商用大型语言模型已具备独立生成原创数学证明的能力。OpenAI旗下ChatGPT-5.2(Thinking)成功破解了一项此前悬而未决的数学猜想,同时催生了名为“vibe-proving”的全新AI推理方法,相关预印本论文已于2026年2月21日发表在arXiv平台。此次研究聚焦的核心命题,是数学家Ra

近日,谷歌发布了一种新的无损极限压缩算法TurboQuant,该算法专门针对大语言模型的键值缓存设计,旨在解决向量量化中的内存占用问题。谷歌声称,TurboQuant能够将大语言模型的键值缓存内存使用量至少减少至原来的六分之一,并且在推理速度上可以提升八倍,同时保持模型的精度不变。Matthew Prince,Cloudflare的创始人、首席执行官兼执行主席,将TurboQuant的发布视为谷歌

该研究由新加坡国立大学和加州大学伯克利分校的学者联合完成。新加坡国立大学的郭衍培是本文的第一作者,他长期研究大语言模型基础设施中的可信性和安全性问题,尤其是云端 LLM 服务的验证性和经济激励风险。他的导师是新加坡国立大学的青年教授张嘉恒和加州大学伯克利分校的 Dawn Song 教授。大语言模型(LLM)已经成为众多人工智能应用的基石。然而,尽管通过云端 API 访问这些模型十分方便,但这种“黑

编译 | 陈骏达你提到你最近一直在探索将大型语言模型简化到最核心的版本,这个项目被命名为micro GPT。你认为这个项目能帮助人们更好地理解和使用语言模型。你提到micro GPT是目前你所能构建的最精简的语言模型代码,整个训练代码只有200行Python(包括注释)。这个模型非常易于理解,因为它不涉及任何为了加速训练而复杂化的代码。通过这个项目,你希望能够向更多人展示语言模型训练的本质。你提到

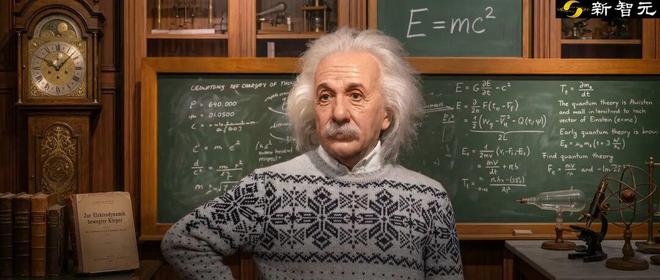

新智元报道在最近举行的美国物理学会全球物理学峰会上,一场有关人工智能是否会取代物理学家的研讨会吸引了众多参会者的关注。研讨会上,哈佛大学的理论物理学家马修·施瓦茨大胆预言,人工智能将在未来五到十年内超越人类智能。他认为,借助人工智能,一个世纪内可以培养出一万位类似爱因斯坦这样的天才科学家,彻底革新科研方式。施瓦茨指出,目前大型语言模型的能力正以每年十倍的速度增长,而人类智能却停滞不前。人类的智慧并

机器之心编辑部近年来,扩散语言模型(Diffusion LLM)一直是讨论的热点。相较于传统的自回归模型,扩散模型在生成文本时更为灵活,更能支持并行处理。然而,尽管这条路充满潜力,但要真正提升效果却并非易事。最近,华为诺亚方舟实验室发布了一项关于扩散模型训练中“默认设置”的研究。这项研究的标题为《Mask Is What DLLM Needs: A Masked Data Training Par

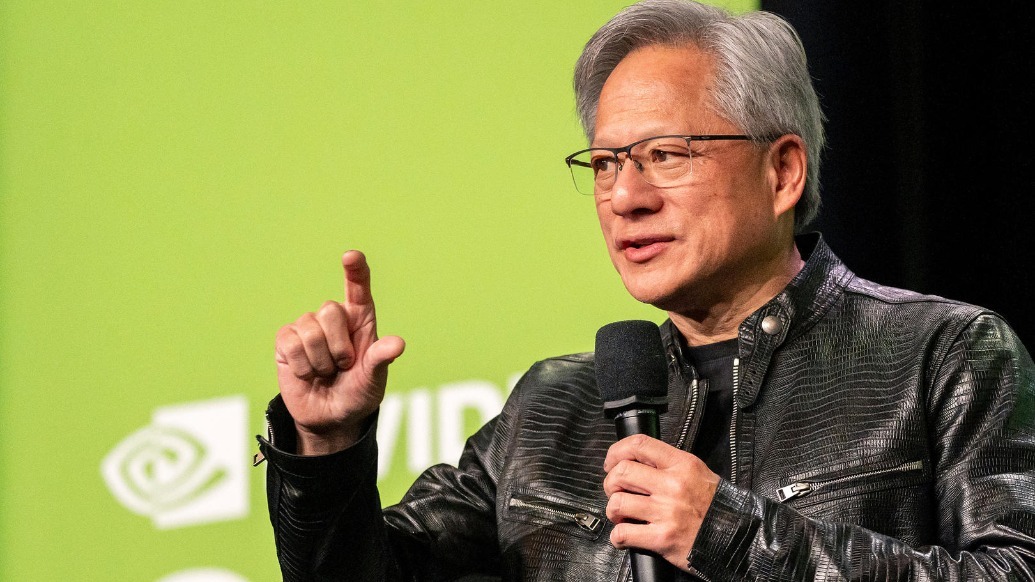

快科技3月22日消息,NVIDIA研究人员推出一项全新技术KVTC(KV快取转换编码),能把大型语言模型(LLM)追踪对话历史的内存用量,最高缩减20倍,而且不用修改模型本身。这一突破有望解决大型语言模型长对话推理时的内存不够用问题,大大降低企业使用AI的硬件成本,同时还能把模型首次生成回应的时间,最高提速8倍。简单来说,KVTC技术的核心就是压缩大型语言模型背后的KV缓存——它相当于AI模型的“

对于那些想要快速开发网页小游戏、交互式动画或是教学演示的人来说,复杂的代码逻辑和多元素交互调试往往令人头疼。虽然目前的大语言模型和AI代理能够帮助编写代码并构建交互场景,但在处理复杂交互时却容易出错,而且纯文本的交互方式难以直观地调整视觉效果。最近,来自香港浸会大学、香港科技大学、香港城市大学及深圳大学的研究团队共同开发了一款名为MoGraphGPT的创新系统。该系统结合了上下文感知模块化大模型与

大语言模型的发展进入了一个全新的阶段,即万亿参数时代,这为大模型的推理与部署带来了前所未有的技术挑战。特别是在超节点(SuperNode)复杂的异构存储架构下,如何高效管理与调度海量张量,成为决定大模型能否成功落地的关键因素。最近,上海交通大学可扩展计算研究所的蒋力和刘方鑫教授团队与华为MindSpore团队合作,发布了一份技术报告,题为《HyperOffload: Graph-Driven Hi

目前,测试时扩展已成为提升模型推断能力的重要途径。在这个领域内,块扩散语言模型(BDLMs)因为其独特的并行解码特性,被认为是自回归模型效率的强有力竞争者。然而,现有的 BDLMs 在处理长链推理任务时面临一种困境:它们必须在速度和准确性之间做出选择。大块解码虽然速度快,但在复杂情境下容易出错;小块则能保证准确度,但会牺牲解码效率,失去并行计算的优势。此外,当前的解码策略(例如固定置信度)无法应对

吴嘉赟博士就读于卡内基梅隆大学(CMU)机器学习系,专注于大语言模型评估和后训练技术的研究。大语言模型在关键领域的应用受到幻觉问题的困扰。最近一项研究提出了一种新的行为校准强化学习方法,旨在解决这一难题。该论文详细探讨了如何通过调整奖励函数来改进LLM的表现。经过特定训练后,一个参数量仅为40亿的小型模型在幻觉抑制方面超越了GPT-5等顶级大模型。图1展示了模型回答数学问题时置信度标注的实例。每一