新智元报道

当中国AI常被视为追赶者时,天工AI在中关村论坛上一口气推出了视频、音乐和世界模型三大成果,宣告中国AIGC已步入全面领跑阶段。

长期以来,AI技术的发展饱受诟病,尤其是游戏、视频和音乐领域的问题尤为突出。

天工AI在一次发布会上同时解决了这三大领域的难题,展示了其在AI技术领域的全面突破。

该发布会的亮点在于,天工AI不仅解决了技术问题,还展示了其在多个领域的综合能力。

通过这次发布,天工AI向外界证明了其不仅能在单点技术上突破,更能在全模态技术体系上构建。

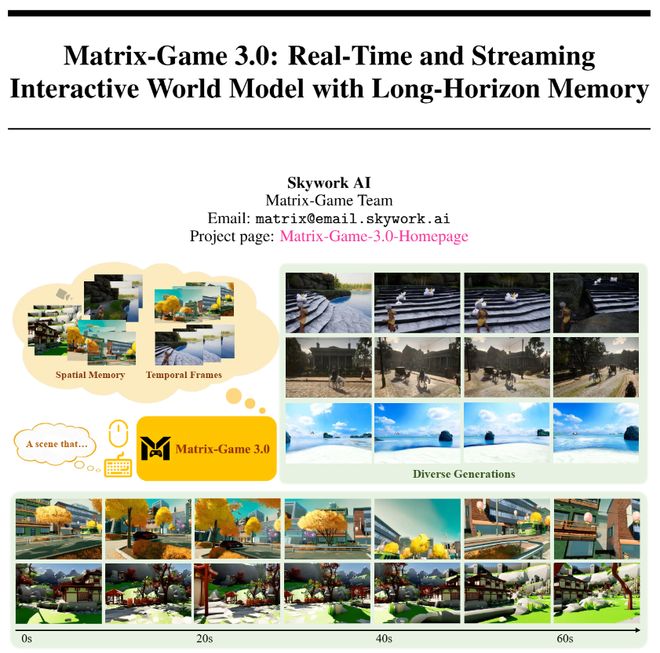

在游戏领域,天工AI推出了全新的Matrix-Game模型,该模型具有强大的记忆力,能够在游戏中创造全新的体验。

随着视频技术的发展,天工AI又推出了一款名为SkyReels的视频模型,它解决了视频画面的听觉问题。

在音乐领域,天工AI的Mureka模型则解决了音乐创作的精准控制难题,让音乐创作更加符合创作者的意图。

这些模型的推出,标志着中国AI技术从单点突破走向全面开花。

天工AI的CEO周亚辉在发布会上宣布了公司的2026 AGI战略,其核心在于构建一个包括Matrix-Game、SkyReels和Mureka在内的大模型体系。

公司的战略不仅限于模型的推出,还包括构建一个超级智能体平台,为开发者和创作者提供全方位的AI服务。

周亚辉表示,该平台不仅是一个模型提供者,更是一个AI创作者经济的平台运营者,旨在让所有参与者从中受益。

周亚辉还提到,这种从模型到平台的转变,意味着一个人就能完成从前需要整个团队或公司才能完成的工作。

这种转变,象征着AI技术从理论到实践的飞跃,以及从单点突破到全面开花的巨大转变。

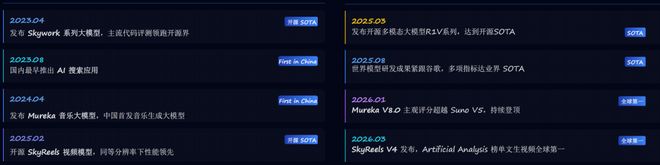

天工AI从2023年宣布All in AGI以来,一路披荆斩棘,面对外界的质疑和观望,最终在2026年交出了令人满意的答卷。

截至2026年3月,天工AI的全球月活用户接近4亿,海外收入占比高达93%,三大模型均跻身世界第一梯队。

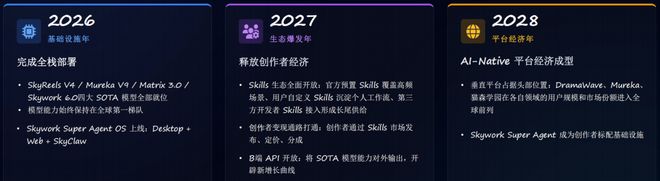

按照天工AI的规划,2026年是其基础设施建设年,2027年则是生态爆发年,到2028年,其三大平台有望成为各自领域的全球领导者。

当“全模态”从理论上的口号变成实际成果,中国AI技术的全面领跑时代已经来临。

未来,天工AI将继续引领AI技术的发展,为全球用户提供更优质的服务和体验。

在这条秋意盎然的街道上,我们刻意让视角穿过斑马线,大范围环顾四周,然后再折返回来。

注意看,镜头转了一大圈重回原地,那栋顶着巨大青蛙雕像的绿色小楼原封不动,墙上的粉红灯笼还在,路口的绿色公交车也没有凭空消失或扭曲变形。

看完效果,我们来拆一下背后的技术。

世界模型最大的瓶颈不是算法,是数据。

互联网上的视频只有画面,缺少相机位姿和操作指令,AI没法从中学会「我按了方向键,世界应该怎么变」的因果关系。

Matrix-Game 3.0为此搭建了一套工业级的无限数据引擎,双管线并行。

一条线基于Unreal Engine 5自动生成覆盖1000+场景的高精度交互数据,强化学习驱动的AI Agent在场景中自主探索,每一帧都同步记录视频、6-DoF相机位姿和操作指令,毫秒级对齐。

另一条线则是从3A游戏里全自动提取动态交互数据,7×24小时无人值守,TB级数据持续产出。

世界模型要「记住」世界,首先得「见过」足够多的世界。

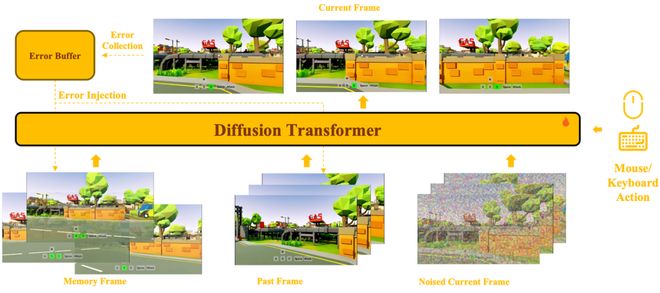

在模型层面,Matrix-Game 3.0从三个维度做了系统性升级。

第一是记忆注入。

模型在生成当前画面时,不只看最近几帧,还会根据相机位姿检索出更早期的「记忆帧」,只取与当前视角相关的内容,放进同一个注意力空间联合建模。走过的路、看过的楼,模型都记得。

第二是Error Buffer抗漂移机制。

长时序生成中模型会逐渐偏离真实状态,3.0在训练时就显式建模生成结果与真实帧之间的误差,并把误差作为条件重新注入,让模型大量接触「已经跑偏」的状态,逼它学会自我纠正。

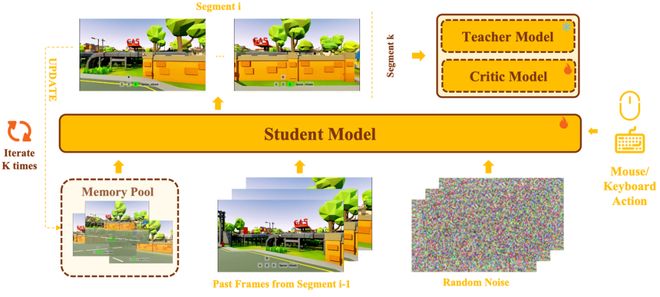

第三是蒸馏加速。

要让5B参数的模型在720P分辨率下跑到40FPS实时生成,光有好架构不够,还得把推理步数压下来。

3.0用了多段自回归蒸馏框架,在训练阶段就让学生模型连续生成多个视频段,完全模拟真实长视频推理的误差累积环境,配合模型量化和VAE解码器蒸馏,最终实现了分钟级长时序一致性下的实时交互。

可交互基础模型结构示意图

记忆增强基础模型结构示意图

多段自回归蒸馏示意图

(左右滑动查看)

三层技术叠满,5B轻量模型就跑出了720P、40FPS的实时生成,分钟级长时序一致性。这在一年前是不可想象的。

更大的MoE-28B模型,则在泛化性和动态表现上进一步拉满。它为第一人称和第三人称分别训练独立的动作模型,共享同一个视觉细节模型,既能做沉浸式第一人称探索,也能跑第三人称游戏视角,可生成时长约60秒。

放眼全球,可交互世界模型这条赛道上,Google DeepMind的Genie 3是闭源标杆,Matrix-Game 2.0是该技术范式首个开源实现。3.0在记忆、分辨率和实时性上全面超越2.0,是目前与Genie齐头并进的方案。

主页:https://matrix-game-v3.github.io/

代码:https://github.com/SkyworkAI/Matrix-Game/tree/main/Matrix-Game-3

模型:https://huggingface.co/Skywork/Matrix-Game-3.0

以前的世界模型是「能看不能摸」的橱窗展品,现在的Matrix-Game 3.0是一个可以真正走进去玩的虚拟世界。

世界的问题解决了,接下来看画面。

SkyReels V4

画面里人开口说话的瞬间,声音就跟上了

注意「听」,漫天黄沙里,女主开口说「谢谢你救了我」的瞬间,声音是不是严丝合缝跟上了?男主回应时,背景音乐的节奏是不是也刚好踩在了画面的情绪点上?

这段荒凉凄美的戈壁戏,不仅演员的表情极其自然,连呼啸的风声都跟画面完美交融。

这就是SkyReels V4最炸裂的地方。

以前的AI视频都有一个毛病,先生成画面,再找另一个模型配音。两套系统各干各的,经常出现音画对不上的情况。

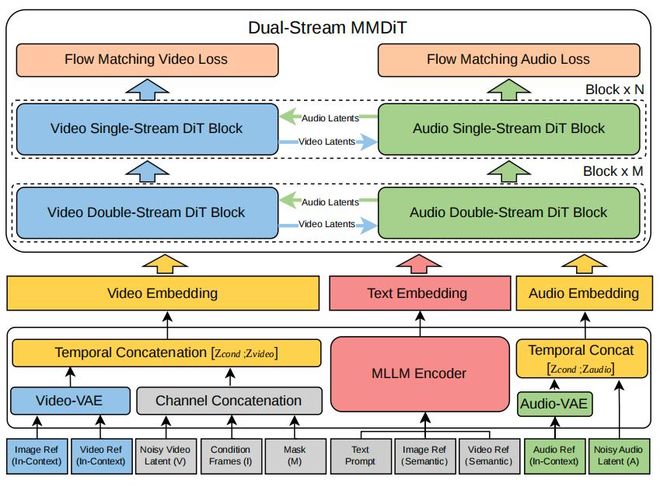

SkyReels V4直接从底层把这事治了。

它自研了一套双流MMDiT架构,视频和音频不再是两个模型各生成各的,而是在同一个模型内部通过双向交叉注意力同时生成,音画从第一帧起就是锁死同步的。

但光解决声音还不够。短剧操盘手的另一个噩梦是控制失灵,镜头一转主角就变脸。

SkyReels V4的解法是全模态强化学习加上精准控制系统。

强化学习搭了一套覆盖全场景的语义Reward模型,教AI「看大局」,不只是死磕每个像素好不好看,而是让画面整体在「讲一个逻辑自洽的故事」。

关键帧参考能自动补全节点间的画面,网格图参考更狠,上传最多9张剧情帧,一键生成角色不走形、场景不跳跃的连贯短剧。

不仅如此,多角色对话场景也能跑,正反打镜头切换、台词分配、表情匹配自动完成,中英法日多语种通吃。

同一套框架还覆盖去水印、去台标、删除或添加角色等后期编辑,对影视后期来说全是刚需。

我们只需给模型喂一张静图加一段实拍视频,真人演员就被无缝替换了。不仅动作节奏分毫不差,衣服在动态走位中不走形,而且原版海滩阳光、渔船背景、平移运镜也能被完美保留。

再比如,下面这个视频里有一个戴黑帽穿黑大衣的女人,手里拿着一瓶紫色液体。我们只需给模型一条指令「找到这个人和这瓶东西,删掉」,人和瓶子就能干干净净消失,背景无缝填补。

视频的问题解决了,接下来看声音。

Mureka V9

唱对了,混对了,该停的地方也停了

先说一个事实。

前一代Mureka V8,已经靠自研MusiCoT(Music Chain-of-Thought)技术在Artificial Analysis音乐模型榜单上同时拿下人声和乐器双料冠军,碾压Suno V4.5和Udio。

全球第一了,V9还升什么?

两个字:「好控」。

过去AI音乐最让人抓狂的不是「能不能生成」,而是生成了却控不住,歌词落不到对的段落,人声唱不对重点,离创作者真正想要的总差最后一层。

V9重点攻克的就是这个。

段落级歌词语义控制更精准,人声不只是「唱出来」而是「唱对了」,混音质感更通透,生成速度更快,同一创意方向下的结果也更有新鲜度。

而且,V9还多了一个能力:知道什么时候不该唱。

换句话说就是,不必要的哼唱和模糊唱词大幅减少,该留白就留白,不硬加戏。

在产品层面,同一创意可以快速出多版本,支持在旋律、人声、结构上局部保留替换,创作从「写一首歌然后定稿」变成了版本化的迭代工作流。

一句话概括就是:从「能做出作品」走向「能稳定做出你真正想要的作品」。

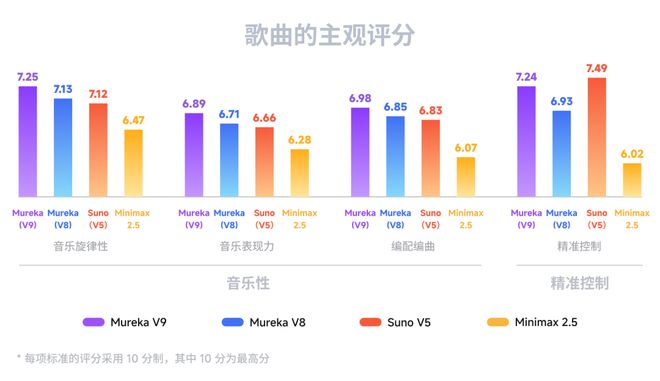

数据也印证了这个判断。

在主观评分中,V9在音乐旋律性(7.25)、音乐表现力(6.89)、编配编曲(6.98)三个维度全部拿下第一,超越Suno V5和Minimax 2.5。而涨幅最大的恰恰是精准控制维度,从V8的6.93直接跳到V9的7.24。

说完升级方向,直接听这首实测曲。

强烈建议空降1:08秒。短短20秒内,主唱人声在中、英、法、西四种语言间无缝穿梭。

不管语言怎么切,慵懒的民谣腔调、换气节奏甚至咬字气声都保持着惊人的一致,用四种语言的丝滑流转,硬是唱出了一种跨越国界的电影级浪漫。

但Mureka的野心不止于一个AI作曲工具。它瞄准的是AI音乐时代的Spotify。

逻辑很简单,当AI让音乐创作从「少数专业人的低频行为」变成「所有人的高频表达」,音乐就不再只是被动消费的内容,而是一种新的自我表达语言。

这种AI原生的内容形态需要一个全新的平台来承载,Mureka正是在这个判断下构建的,模型能力做底座,版本化创作工作流做引擎,表达与社交做飞轮,同时面向B端开放API嵌入场景。

市场已经在用脚投票。Mureka的ARR已经达到竞品同类模型的10倍以上,不到两年迭代九个大版本,是MusiCoT技术闭环一步步卷出来的系统能力。

在论坛现场的Mureka V9互动展区,大家体验完之后的第一反应,几乎都是:「这……真的是AI做的?!」

大概,这就是对一个AI音乐模型最高的赞美了吧。

中国AI的「全模态时刻」

现在,世界能记住了,画面能听见了,音乐能控住了。

三个行业最头疼的病,在同一场发布会上同时给出了解法。

但这件事的意义,远不止于三个模型本身。

DeepSeek在大语言模型领域的突破,说明中国AI有能力在单个赛道上挑战全球最强。

而天工AI在游戏、视频、音乐三条赛道上的同时登顶,指向一件更重要的事——

中国AI企业有能力构建全模态的技术体系,而不仅仅是在某个单点上追赶。

从单点突破到全面开花,从追赶者到领跑者,这就是「全模态时刻」的真正含义。

2026 AGI战略:从全模态突破到AI平台经济

技术登顶只是上半场。

在同一场发布会上,天工AI董事长兼CEO周亚辉发布了2026 AGI战略,核心是「3+1」布局——

三大场景大模型(Matrix-Game + SkyReels + Mureka)加上天工超级智能体。

三个模型是三把尖刀,分别插入游戏、视频、音乐三个百亿级内容产业。

天工超级智能体则是串联它们的超级平台,面向C端用户提供一站式AI创作体验,面向B端开发者开放API和生态接口。

这就是天工AI在发布会上正式亮出的「AIGC全家桶」——不是单个模型的秀技,而是一整套从生成到编辑到分发的全链条能力。

配合AI短剧平台Dramawave、AI音乐平台Mureka、AI游戏平台猫森学园2.0等产品矩阵,文本、音乐、视频、游戏四大领域全覆盖。

用周亚辉的话说,模型是引擎,平台是工厂,创作者是老板。

天工AI要做的不只是模型提供商,而是AI创作者经济的平台运营者,把最顶尖的能力开放出来,让开发者、创作者和合作伙伴都能从中受益。

这套全家桶意味着什么?

想象一下,一个人加DramaWave就能出品一部短剧,加Mureka就能发行一张全球专辑,加猫森学园就能创造一个游戏世界。

每一项在三年前都需要一个团队甚至一家公司才能完成,现在一个人就够了。

这就是周亚辉所说的「一人公司时代」。

技术不是从天上掉下来的,是一行一行代码、一篇一篇论文磨出来的。

回过头来看,最让人感慨的不是某个具体参数,而是一种整体的「势」。

2023年昆仑万维宣布All in AGI时,外界充满质疑。2023年天工大模型1.0发布,有人说是百模大战里的又一个跟风者。2024年AIGC矩阵逐渐成型但还没拿到决定性优势,依然有人观望。

到了2026年3月,四年的坚持给出了自己的答案。

全球月活近4亿,海外收入占比93%,三大模型同时站到世界第一梯队。

而这只是起点。

按照路线图,2026年是基础设施年,四大模型全部就位,能力锁定全球第一梯队。

2027年是生态爆发年,Skills生态全面开放,创作者变现通路打通,B端API对外输出。

2028年是平台经济年,三大平台冲各自领域的全球头部,Skywork Super Agent成为创作者标配。

当「全模态」从PPT上的口号变成榜单上的排名、API接口里的能力、用户手中可感知的产品,中国AIGC的「全模态时刻」,确实来了。

参考资料:

https://matrix-game-v3.github.io/

https://github.com/SkyworkAI/Matrix-Game/tree/main/Matrix-Game-3

https://huggingface.co/Skywork/Matrix-Game-3.0