全球首款医疗视频理解大模型现已开放源代码,同步推出一个包含6000多组精细标注的测试集。

开源,是最好的探针

该模型在GitHub和Hugging Face平台上线,引发广泛关注。

在医学界,手术视频分析的“黑匣子”已被打破。

uAI Nexus MedVLM能够准确解读各类手术过程,并且论文已经被CVPR 2026收录。

此外,团队还提供了一套包含6245个标注数据集的标准测试工具。

这是首次公开如此大规模和精度的医疗视频数据,填补了行业空白。

我们第一时间进行了实测,体验到了uAI Nexus MedVLM的强大功能。

该模型支持超过53万条视频-指令数据,并且可以单卡部署。

支持多种手术场景,包括内镜、腹腔镜和机器人手术等。

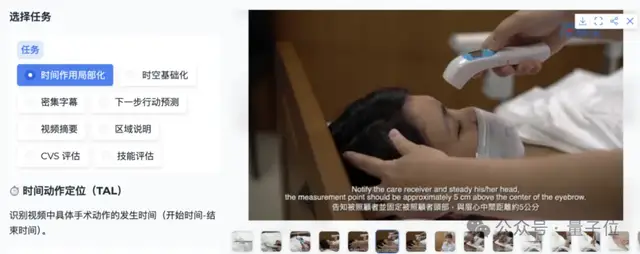

用户可以通过上传自己的视频或使用预设示例来进行测试。

到底有多能打?

我们用一个腹腔镜胆囊切除术的视频进行了实测,并与通用大模型对比了多个关键指标。

- 在手术安全评估中,uAI Nexus MedVLM准确率达到89.7%。

- 相比之下,其他模型如GPT-5.4和Gemini-3.1的准确性较低。

- 其他如时空动作定位和视频报告生成等方面,该模型的表现也远远超出竞争对手。

实测效果咋样?

通过MedGRPO强化学习优化后,uAI Nexus MedVLM在多项任务上的性能得到显著提升。

它覆盖了包括内镜、开放手术等在内的多种临床场景。

在一系列测试中,该模型的表现均优于GPT和Gemini。

我们选取了一段护理视频来展示其定性分析能力。

一个关键问题是如何准确描述视频中的特定时间点的操作细节。

标准答案是对操作的具体工具和动作进行了详细描述。

其他模型在识别具体手术步骤时出现不同程度的错误。

uAI Nexus MedVLM则给出了接近标准的答案,显示出其强大的理解能力。

这些测试展示了该模型在复杂医疗视频分析中的卓越表现。

为什么手术视频是人工智能领域最难解决的问题?

尽管AI已在影像诊断等领域广泛应用,但手术视频的理解仍是一个未解的难题。

第一个挑战在于获取数据的难度极高。

医学伦理和患者隐私问题使得合法合规地收集这些数据变得非常困难。

即使能获得原始视频,逐帧标注也是一项耗资巨大的工作。

其次是缺乏统一的评估标准,导致各模型之间的比较难以进行。

这种情况限制了整个领域的进步和发展。

最后,手术视频理解本身具有极高的复杂性。

例如,需要精确识别毫米级的器械位置和解剖结构。

同时还要理解复杂的操作顺序。

这些因素使得即使是最先进的模型也难以胜任这项任务。

它不仅展示了技术实力,还具有潜在的临床应用价值。

具体来说,它可以在术前、术中和术后为医生提供帮助。

例如,在术前阶段,可以分析专家手术视频以优化手术方案。

在手术过程中,实时指导操作并预警违规行为。

手术后自动生成标准化报告,节省了大量时间。

这种技术的应用能够帮助医生提高效率和安全性。

特别是在基层医院中,该模型可以将顶级专家的经验转化为术中的辅助工具。

通过这种方式,即使是经验不足的医生也可以获得专业级支持。

对于整个医疗行业来说,这是一个划时代的变化。

联影智能首次向全球开源大规模高质量的数据集和模型,并提供了一个统一评估标准。

这意味着未来可以进行更加客观有效的模型比较。

开发者可以通过提交自己的模型来参与这项挑战并加入排行榜竞争。

真实临床案例的贡献将推动技术不断创新和完善。

一个面向全球开发者的黄金时代已经到来,助力医疗视频AI的发展。

随着技术的进步和应用范围扩大,未来uAI Nexus MedVLM将进一步完善其功能。

开放数据、共享模型以及全球协作的模式才刚刚开始。

对于有兴趣参与开发的人来说,现在正是最佳时机。

而且胆囊得先分离再切除,不能反过来。AI如果看不懂时序,就根本无法理解手术进程。

各种约束叠加,再顶级的模型也只能歇菜。

但现在,这个无人区被uAI Nexus MedVLM一脚踩穿。

它不只是“炫技”,是真的能救命。

好了,说点实际的。这模型具体能干嘛?

术前:分析主刀老师上万台手术视频,挖掘临床规律、辅助优化方案。

想象你是一位刚站上手术台的临床医生,即将做一台胆结石微创手术。

以前你只能靠记忆和经验;现在AI把成千上万台顶级专家的手术经验沉淀下来,相当于有了最强的大脑,来辅助你完成这台手术。

术中:在分离胆囊管、显露安全视野等关键步骤,实时给出指引;对违规操作、动作偏差进行毫秒级预警,成为你的 “第三只眼”。

术后:自动完成总结与结构化记录,这通常会占用医生大量时间,但现在,一键生成标准化报告。这台手术的经验,也能成为下一位医生的“决策依据”。

手术质控、术中安全、报告自动化、医学教学……uAI Nexus MedVLM的价值,远不止于技术突破。

在中国,优质医疗资源集中在三甲医院,基层医院医生成长周期长、手术经验积累慢。

而uAI Nexus MedVLM可以把顶级专家的手术经验“沉淀”下来,基层医院的医生也能获得“专家级”的术中辅助。

这或许才是AI真正理解手术视频的意义所在。

全球开发者,新机遇来了

这次发布,最值得关注的不仅是uAI Nexus MedVLM本身。

开发这一模型的背后玩家联影智能(联影集团旗下一家专注于AI医疗的创新公司),首次向全球开源大规模高质量医疗视频标注数据和模型,并提供了一个更具可比性的评测基准。

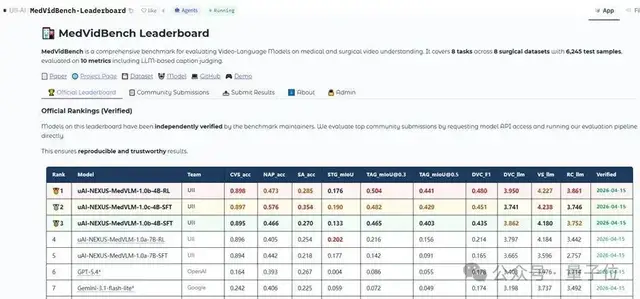

这意味着什么?终于有了一个手术视频理解垂直领域的“全球公共测评体系”了。

以前,各家模型各说各话,效果没法比。

现在,拉出来在同一个数据集上跑一跑,谁强谁弱,一目了然。

而这,还只是开始。

这支研发团队不想唱独角戏,上线了医疗视频理解大模型榜单,面向全世界开发者发出挑战。

这是一个综合基准测试,用于评估视频语言模型在医疗和外科视频理解方面的表现。

开发者可提交自有模型结果,由系统基于标准自动评分,形成动态更新的统一排行榜。

当全球开发者都能下载模型、使用数据集、上传自己的成果时,看谁能把对医疗视频理解的能力边界,再往前推一步了。

这个过程中,医生上传的罕见病例、复杂手术视频,尤其是现有模型表现不足的案例,都会成为极为珍贵的真实数据,持续驱动技术迭代。

医疗视频AI正在迎来面向全球开发者的黄金时代。

未来,uAI Nexus MedVLM将与具身智能融合,完善感知-推理-执行的能力闭环。从手术室拓展到更多临床场景,推动医疗全流程智能化。

数据开放、模型共享、全球协同……这条路,才刚刚开始。

开发者们,是时候上车了~

彩蛋:链接在此,请自取

1.在线Demo:

https://huggingface.co/spaces/UII-AI/MedGRPO-Demo

2.推理代码:

https://github.com/UII-AI/MedGRPO-Code

3.MedVidBench数据集:

https://huggingface.co/datasets/UII-AI/MedVidBench

4.公开榜单:

https://huggingface.co/spaces/UII-AI/MedVidBench-Leaderboard

5.论文:

https://arxiv.org/abs/2512.06581

6. 项目介绍:

https://uii-ai.github.io/MedGRPO/

田, 晏林

田, 晏林