最近,机器视觉领域迎来了一项重要突破。

新的模型已实现无限流视频处理:观看无尽帧数也能实现实时稳定的3D重建。

让我们一起感受这项技术的魅力:

无论是扫地机器人还是自动驾驶车辆,这一创新都将带来革命性的改变。如果应用到清扫机器人上,它能一边打扫一边构建家庭的三维结构;在自动驾驶领域,则可以边驾驶边实时分析道路情况。

这项技术让人联想到《火影忍者》中宇智波宁次的能力白眼——全方位无死角透视和细节洞察力。

最近,蚂蚁灵波推出了他们最新的开源项目LingBot-Map,一个专注于纯自回归的流式3D重建的基础模型。

与以往的具身智能视觉相比,这次的新技术在速度、准确性和效率上都有了显著提升。

这项创新打破了实时性、记忆和节省内存三个看似不可兼得的目标之间的矛盾。

流式3D重建为何如此复杂?

△图源由AI生成

首先我们需要区分两种不同的概念:离线3D重建与流式3D重建。前者需要拍摄完整视频,存储所有帧画面后再进行全局建模;而后者则可以边拍边构建模型、边感知边决策。

然而,在实现过程中,行业内普遍认为有三大难题难以克服。

其一为过多的内存占用问题。如果试图保留所有的历史帧信息,系统会面临巨大的显存压力;其二是若只保存少量的历史帧,则会导致模型遗忘先前的信息;最后则是精度和速度之间的权衡问题。

以往大多数流式方案要么依赖测试时优化,或者使用未来帧数据进行全局校正,而LingBot-Map则采取了一种全新的、纯自回归的方法:完全依靠历史信息推理当前状态,并且不依赖未来的任何信息或人工规则。

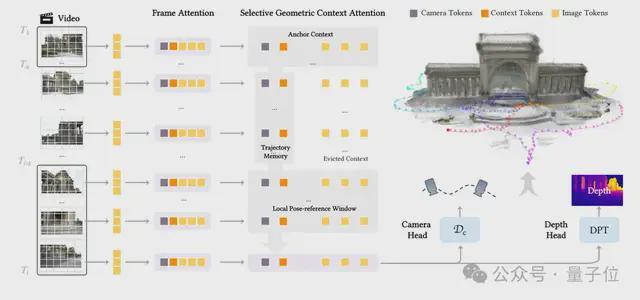

这一技术的核心在于其几何上下文注意力机制(Geometric Context Attention, GCA),灵感来源于人类大脑的选择性记忆功能。这种机制使得模型可以在有限的资源下高效工作,同时保持出色的重建质量和实时性能。

具体来说,LingBot-Map通过GCA对内存进行了优化管理,包括锚点、位姿参考窗口以及轨迹记忆三个关键部分。

锚点模块确保了初始几帧的稳定性和尺度一致性;其次,位姿参考窗口则帮助模型记住最近的关键信息;最后,轨迹记忆部分则负责处理长序列历史数据,并将其压缩至极简的信息形式。

这种多层次的记忆管理机制使得LingBot-Map能够在处理长时间视频序列时保持稳定的性能和较低的内存消耗。

实验数据显示,LingBot-Map在多项基准测试中均表现出色,在精度、速度以及显存使用方面都超越了现有解决方案。

除此之外,其技术特点还使得流式3D重建能够在消费级硬件上运行,并且能够应用于机器人巡检和家庭服务等多个领域,实现低成本的大规模部署。

这项创新不仅为具身智能的技术发展提供了新的可能,同时也推动了整个行业的进步。蚂蚁灵波公司的持续开源策略更是加速了这一进程,让更多的开发者和企业得以利用这些先进技术进行开发和应用。

目前,LingBot-Map已经在Hugging Face、ModelScope以及GitHub平台上开放源代码,供全球的研究者与开发者使用及参考。

△图源由AI生成

第一,记太多就爆显存。

如果模型硬存所有历史帧,几千帧过后显存直接拉满,消费级显卡根本跑不动,工业设备也扛不住长时运行。

第二,记太少就忘光光。

若是只缓存最近几帧,模型会出现灾难性遗忘,长时间运行后轨迹疯狂漂移、重建场景扭曲变形,相当于人走久了忘了自己在哪。

第三,精度速度不可兼得。

要么建模精准但推理慢到卡顿,要么实时性够了但画面糊成马赛克,始终找不到平衡点。

更关键的是,之前绝大多数的流式方案,不是依赖测试时优化,就是用未来帧信息做全局校准,亦或者加入人工设计的关键帧规则,并非端到端的纯推理。

而LingBot-Map走的是纯自回归这条更难的路:严格遵循因果律,仅依赖历史帧信息推理当前帧,无任何后处理、无未来帧依赖、无人工优化规则,所有能力全靠模型端到端学习。

也正因为有了纯自回归的约束,相当于让蒙眼的人仅凭过往记忆走迷宫,既要求走得快、又要求记准路、还不能多耗脑力……

难,是真的难。

但蚂蚁灵波这一次,还真就把这个硬骨头给啃下来了。

像人一样选择性记忆

LingBot-Map背后技术的灵感,来源于人。

就好比咱们在大城市里逛街,却能做到不迷路,不是因为我们的大脑像录像机一样全程“录制”,关键在于大脑执行的是选择性记忆这个操作。

说白了,就是只记住有效、关键的帧。

LingBot-Map的核心,正是完美复刻了这种机制,名曰几何上下文注意力(Geometric Context Attention,GCA)。

更具体而言,LingBot-Map通过GCA,对记忆进行了非常精妙的分层结构化管理。

首先是锚点(Anchor),它的作用让机器人记住“我从哪来”。

任何3D重建都需要一个绝对的坐标系和尺度基准,就好比人类进入陌生房间,会下意识记住门口位置当参照系,防止迷路。

LingBot-Map的锚点模块,就是起到这样的一个作用。

它会锁定初始几帧画面作为基准,固定全局坐标和尺度,如此一来,就解决了纯自回归模型容易出现的尺度模糊、坐标漂移等问题,给整个重建过程定好原点。

其次是位姿参考窗口(Pose-reference Window),用来记住“我身边有什么”。

因为光有起点是不够的,要想走得稳,还得看清脚下的路。

于是团队便在LingBot-Map里设置了位姿参考窗口,它只保留最近的k帧的完整高维特征。

这部分记忆虽然是短期的,但信息极其丰富密集,这样就可以确保模型能够精准地捕捉局部的几何细节,让当前帧能够丝滑地与前几帧拼接在一起,让每一步都踩得极准。

最后就是轨迹记忆(Trajectory Memory),起到记住“我走过的路”的作用。

这也是LingBot-Map中非常关键的一个步骤。

对于那些既不是起点、也不在眼前,属于很久以前的中间历史画面,模型不再存储它们庞大具体的图像像素细节。

取而代之的是,它将这些历史帧的宏大信息,极致压缩成了区区6个极简的Token(包含相机、锚点和寄存器 Token),并打上时间戳(位置编码)。

对比传统因果注意力,LingBot-Map的单帧信息增长量直接降低80倍,哪怕处理万帧长视频,显存消耗也几乎恒定。

三大模块协同发力,便是LingBot-Map打破不可能三角的关键原因了。

那么这套打法效果又如何呢?

实测拿下新SOTA

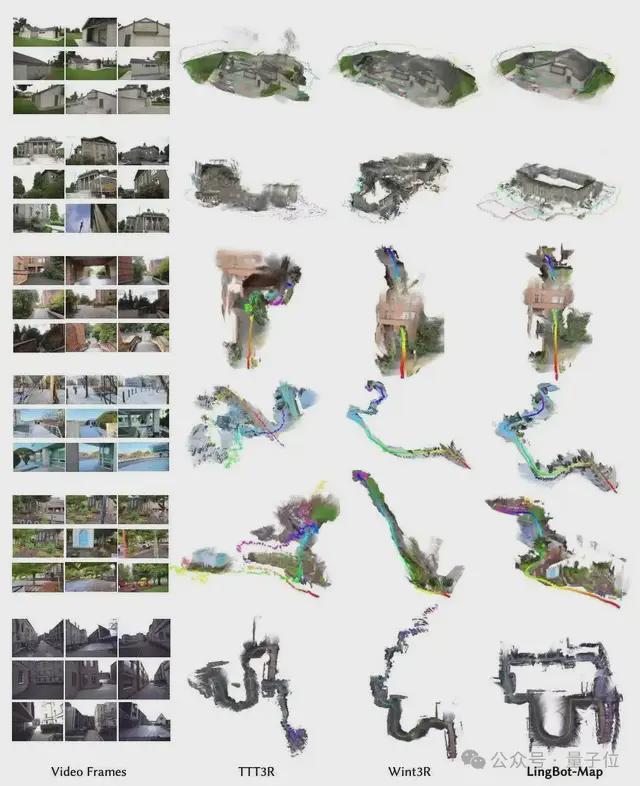

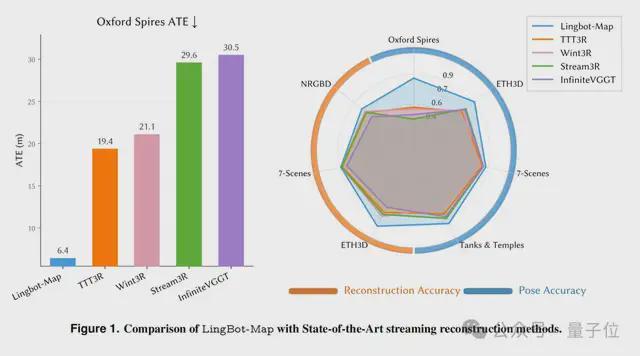

从论文中呈现的实验结果来看,LingBot-Map已经在多项权威基准测试中,全面碾压其它流式模型,稳坐SOTA之位。

首先是长序列稳定性。

在10000+帧的超长视频序列测试中,模型全程保持稳定重建质量,没有出现任何明显的轨迹漂移。要知道,同类纯自回归模型往往几百帧就开始扭曲,万帧稳定的表现,直接刷新了行业纪录。

其次是速度与精度双突破。

在518×378的主流分辨率下,推理速度达到20FPS,比同类流式方法基线快了近一倍,完全满足机器人、自动驾驶的实时性需求。

在Oxford Spires、ETH3D、Tanks & Temples等权威数据集测试中,轨迹误差降低约77%,3D点云建模精度、全局一致性远超所有流式竞品,甚至比部分离线优化模型表现更优。

除此之外,模型运行显存仅需13.28GB,普通消费级显卡即可流畅部署,彻底告别对高端专业显卡的依赖。

对比同类方案动辄30GB+的显存需求,LingBot-Map实现了“技术顶尖、落地亲民”,让流式3D重建具备了规模化商用的基础。

而且效率测试的数据更加直观。

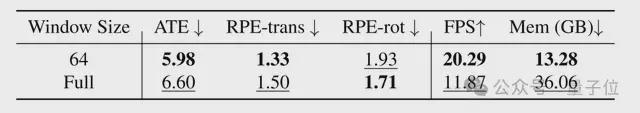

对比全历史帧缓存方案,LingBot-Map用64帧窗口设计,将推理速度从3.12FPS提升至19.95FPS,显存从36.06GB压缩至13.28GB,速度提升6倍、显存降低63%,同时精度反而更高,印证了GCA记忆机制的优越性。

在看完LingBot-Map背后的技术和展现的效果之后,还有一个话题值得聊一聊:

LingBot-Map的开源绝不是为了单点刷榜、秀肌肉。

补齐另一块具身智能关键拼图

若是大家长期关注蚂蚁灵波,就不难发现它在下一盘大棋。

仅仅在今年1月,蚂蚁灵波便已经陆续开源了多款模型:

从感知世界的LingBot-Depth,到理解物理规律的LingBot-World,再到控制身体的LingBot-VLA和全球首个具身世界模型LingBot-VA。

而今天LingBot-Map的开源,则补齐了“边走边记、理解并重建连续真实三维空间”的关键拼图。

这就意味着蚂蚁灵波正式构建了“感知-建模-模拟-控制”全链路具身智能技术栈,从看懂世界、建模世界,到理解世界、操控身体,形成了完整的技术闭环。

此举对全产业落地来说,亦是有着重要的价值。举三个例便一目了然了:

- 机器人:仓库巡检、家庭服务,机器人不再需要昂贵的激光雷达,单靠摄像头就能边走边建图,真正实现低成本、大规模部署。

- AR/VR:戴上眼镜,虚拟物体可以零延迟、不漂移地叠加在真实桌面上,虚实融合的体验将被拉满。

- 自动驾驶/无人机:城市级大场景的实时建模成为可能,为纯视觉的自动驾驶方案提供了更强大的时空理解能力。

因此,综上所述,LingBot-Map的出现,可以说是机器理解真实物理世界迈出的关键一步。

与此同时,蚂蚁灵波的持续开源,也让我们清晰地看到,具身智能的规模化落地,正在以前所未有的速度向我们驶来。

Hugging Face:

https://huggingface.co/robbyant/lingbot-map

ModelScope:

https://www.modelscope.cn/models/Robbyant/lingbot-map

GitHub:

https://github.com/Robbyant/lingbot-map

Paper:

https://arxiv.org/abs/2604.14141

Homepage:

https://technology.robbyant.com/lingbot-map