设计硬件时,应当着眼于未来模型的发展方向。

作者|张勇毅

昨日 OpenAI 发布智能手机的具体规格和供应链消息后,我首先想到的是他们不得不迈出这一步,并且联想到了两周前 Richard Ho 在斯坦福大学的交流会。

Richard Ho 是 OpenAI 的硬件负责人,曾任职于 Google 负责 TPU 项目。

当时,在 IEEE 组织的一场内部讨论会上,他并未提及手机一词。然而结合最近的新闻和当时他的发言来看,整个路径已经非常清晰了——只是没有具体的产品形态来体现它。

对外而言,OpenAI 进入手机行业似乎是一次跨界的尝试。但遵循 Richard Ho 交流时所阐述的观点,你会发现这其实是一条早已规划好的道路。

手机对于所有模型开发商来说,仅仅是众多终点之一,并非起点。

模型的下一次重大突破将由硬件推动实现

01

在那次讨论中,Richard Ho 强调了 OpenAI 为何必须自行开发硬件的原因。

他反复提到:“真正的限制不仅在于模型本身,还涉及算力、能耗、成本和延迟等整个系统的因素。”

听起来像是普通的技术陈述。但在 OpenAI 的背景下,这句话具有不同的含义——它表明公司不再仅仅是一家专注于模型开发的公司。

GPU 是为通用并行计算而设计,在推荐系统和传统的并行任务中表现良好。

然而对于今天的主流 Transformer、代理以及长上下文推理来说,GPU 并未完全符合这些应用的设计初衷。特别是代理——多轮次的持续执行与跨任务协作使得整个系统的效率问题被放大了很多倍。

Richard Ho 当时曾说:“虽然 GPU 将我们带到了现在的位置,但它并不是为这种负载而设计的。”

这句话的意思是,一旦模型发展到一定规模后,其进步就会受到基础设施瓶颈的影响。因此 OpenAI 必须从模型公司转变为一个拥有自己硬件设施和设备制造能力的企业。

未来算力需求将远超数据中心所能提供的范围,达到相当于几个核电站的发电量水平。

Richard Ho 表示:“当谈论如此庞大的能源消耗时,电力供应问题甚至国家安全都会成为讨论焦点。”

将这一切结合起来看——从模型、基础设施到自研芯片、操作系统和边缘设备——可以发现 OpenAI 推出手机并不是孤立的决定,而是这条路径自然发展的结果。

手机只是外界首先看到的形式。而更深层次的变化在于计算范式正由应用程序为中心转向以代理为中心的发展趋势。

随着默认入口变为代理,当前的设备、芯片和操作系统都将面临重新定义的需求。

此次调整使得 OpenAI 不再局限于模型开发领域,而是转型成为一个全方位的技术提供商。

当代理成为默认入口时,

今天的操作系统是否会因此而被重写呢?

Richard Ho 提到,外界看到的模型是几个月发布一次,但内部其实是一条连续的 pipeline——「我们能看到接下来 6 到 9 个月模型会怎么变」。

这句话才是整段最关键的。它意味着 OpenAI 的硬件团队不是在为今天的模型设计芯片,而是在为还没出现的模型「预备」设计。

具体到细节上,这种「向前看」会影响很多决定:模型对内存压力的变化会直接决定 HBM 应该用 8-high、12-high 还是 16-high;网络带宽要扩到多少;新的 compression algorithm 出现会不会改变数据流的形状;inference 和 training 的比例正在快速变化(推理负载越来越重),这对硬件的要求又是另一套。

Richard Ho 把这一点总结成一句话:

「你必须为模型将要去的方向设计硬件,而不是为今天的模型。」

这就是 OpenAI 的芯片和 NVIDIA、AMD 的根本不同之处——它不是一颗对外销售的通用 GPU,而是高度贴合 OpenAI 自身模型路径的、几乎一对一定制的系统。从这个角度看,OpenAI 做芯片更像 Google 做 TPU,而不是像 NVIDIA 做 H100。

但即便如此,硬件优化的天花板远没有到。Richard Ho 反对「晶体管进步变慢,所以芯片红利结束」这个论断。他的判断是:单颗芯片确实在变慢,但整个系统层面还远远没有被优化好。memory hierarchy、networking、data movement——这些大瓶颈都没解。他举的例子很具体:现在高速 copper 互联在高带宽下只能支持大约 2 米的距离,这对数据中心布局是非常大的限制。

简单说一句:OpenAI 在做的事情不是把一颗芯片做得更快,而是把整个 AI 计算系统重新优化一遍。

手机这件事,是这个系统的最末端。

02

「手机不是为 agent 设计的」

回到手机。

Richard Ho 在那场交流上有一句话,今天回头看几乎就是 OpenAI 做手机的全部理由——「手机不是为 agent 设计的」。

「今天的手机交互是 app-based、session-based 的,你打开一个 app,做一件事,关掉。但 agent 需要的是持续存在、持续执行、跨任务协同。一个真正的 agent 不会等你打开它再开始工作,它会在后台一直理解你的状态、调度你的任务、跟其他 agent 通信。」

这种交互范式,直接等同于在说:今天的 iOS 和 Android 都不是为它设计的。

这就是为什么 OpenAI 必须自己做。Richard Ho 的判断是「未来不是 cloud-only,也不是 edge-only,而是两者结合」——个人上下文、隐私数据、低延迟交互必须在设备端,复杂推理留在云端。如果一个 agent 想随时拿到用户的「当下状态」,它必须在操作系统层有完整权限。

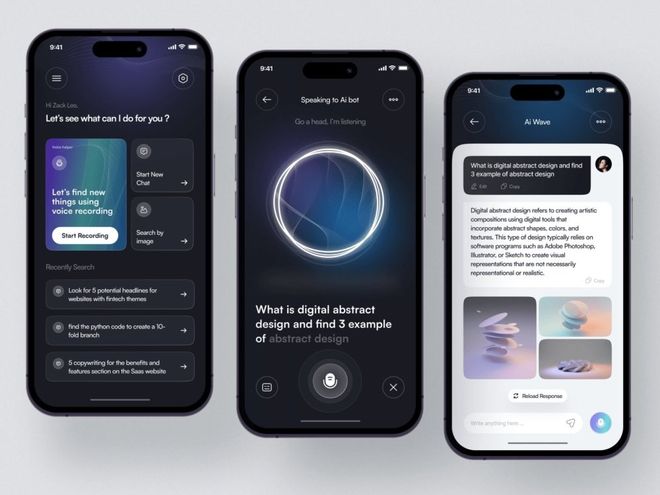

现有手机系统在满足 AI 时代原生用户需求面前有天然的短板 | 图片

这件事在 iOS 和 Android 上很难干净地做——不是技术问题,是利益问题。Apple 不会把系统级权限完全开放给一个第三方 agent,Google 也不会。

也是从这个角度,去年 OpenAI 收购 Jony Ive 团队相关的公司(io)的逻辑就清楚了。Richard Ho 说,做端侧个人设备这部分工作「是目前最有意思的一块」——因为这是第一次把基础设施和消费电子设备真正接在一起。

这其实是 OpenAI 整个硬件战略里最有想象力的部分,也是最危险的部分。有想象力是因为它在做 Apple 当年没做的事:用 AI agent 把操作系统重写一遍。危险是因为消费电子是另一套游戏规则——产品节奏、供应链、零售、品牌——不是从云端工程师团队里能长出来的能力。

但 io 的存在解决了一部分问题。Jony Ive 不是来做芯片或者操作系统的,他是来做硬件形态和工业设计的——这本来就是 Apple 这些年从 OpenAI 手里能短暂保住的最后一块地。

03

不是所有 AI 公司都在做同一件事

消费电子的难度有多大,看过去两年其他 AI 公司在硬件上的尝试就清楚了。

每一家都想用 AI 重新定义某个硬件形态。但每一家走的路径不一样,结果也很不一样。

最早的是 Rabbit R1。

2024 年初的 CES 上,吕骋拿出那台橙色小盒子,喊出「干翻所有 App」——用 LAM(大动作模型)替代手机里 App 的交互方式,一句话订外卖、打车、订机票。当时引发的关注度堪比「AI 时代的 iPhone 时刻」,开售两周卖出 5 万台。

Rabbit R1 是首批 AI 硬件中为数不多「口碑反转」的产品|图片

但首批用户体验出来之后,事情翻得很快。先是被开发者证实是套壳安卓——Rabbit OS 实际上是 AOSP 的修改版,APK 可以直接装到 Pixel 6a 上跑。LAM 被发现依赖 OpenAI 的 API。续航 4 小时,订一次外卖要试十几次。

Rabbit 失败的真正原因不是产品质量,而是路径——它只做了硬件壳子,没碰底层。芯片是联发科 Helio P35(入门手机水平),系统是套壳 Android,模型靠第三方 API。这种做法的天花板很明显:你做的事情,一个手机 App 都能做,而且做得更好。

Meta 选了一条完全不同的路。

Meta 的判断是不挑战手机这个形态,让 AI 借眼镜这个已经存在的硬件形态进入日常。Ray-Ban Meta 做对了三件事:找 EssilorLuxottica(雷朋母公司)做合作方,让眼镜回归眼镜本身——时尚、轻、舒适;把 AI 做成「附加项」,299 美元起售;不强求每个用户都用 AI,先把一副好眼镜卖出去,AI 是 bonus。

结果是 Ray-Ban Meta 卖出超过 200 万副,Meta 一家拿下全球智能眼镜市场 75% 以上的份额。

但这条路的边界也清楚——Meta 解决的是「AI 怎么进入日常」这个问题,不是「AI 怎么重新定义计算」这个问题。眼镜只是一个加了摄像头和麦克风的入口,它不会替代手机,也没打算替代。

阿里千问基本上是 Meta 路径的中国版本。今年 2 月 MWC 发布、3 月 G1 系列发售(国补到手价 1997 元起)、4 月 S1 上市(国补到手价 3499 元),节奏很快。逻辑也清晰:千问 App 已经做到超 3 亿月活、8000 万 DAU,眼镜是把 AI 助手能力从手机延伸到日常佩戴形态——支付宝、高德、淘宝、飞猪一整套阿里生态都接进来,用户对眼镜说「点外卖」「打车」「翻译」就能办事。芯片是高通骁龙 AR1,系统在 Android 之上,模型用千问。

千问眼镜本质上是一次生态延伸,不是底层重构。它的优势是阿里生态足够厚,眼镜成为阿里 AI 服务的一个新入口。

把这三条路放在一起看,再对比 OpenAI——你会发现 OpenAI 是唯一一家在做「全栈重新定义」的公司:

Rabbit 想绕过 App 但没动操作系统,结果是空中楼阁;Meta 选择不挑战手机,让眼镜做配角,做对了爆款但天花板就是配角;千问跟随 Meta 的形态选择,把眼镜做成 AI 服务的延伸入口;而 OpenAI——从芯片、基础设施、能源、操作系统、设备一路打通。

这是另一个量级的事。

04

真正的护城河,不在模型层

那场交流的最后,Richard Ho 还给了一句对未来格局的判断:

「(模型公司)不再是在芯片层赢,而是在系统层赢。」

这句话的意思是,未来的 AI 竞争不只是模型能力的竞争,而是整套系统能力的竞争——同样的功耗下能提供多少计算、能服务多少用户、延迟能压到多低。这种系统级的优势,单靠模型本身是没法替代的。

放在 OpenAI 的位置上看,这是一种相当自洽的逻辑:模型团队在 GPT、o 系列、agent 这些方向上往前推,但一旦推到某个体量,模型本身的进步就要被基础设施的瓶颈限制住。所以 OpenAI 必须从模型公司变成基础设施公司——再变成设备公司。

这也是为什么 Richard Ho 在被问到未来算力规模时,给出的数字是20GW。把 OpenAI、Oracle、SoftBank 等合作方的规划加起来,未来需要的算力大约相当于十几到二十个核电站的发电量。

这个数字第一次听到的时候我没反应过来。20GW 已经不是数据中心能解决的问题——它是国家电网和能源政策的问题。Richard Ho 自己也说,「当你开始谈这种规模,就必须谈电力,甚至是国家安全」。

把这件事和「OpenAI 做手机」放在一起看,才能看清楚整个图景:一边是国家级别的能源基础设施,一边是用户兜里的一台设备,中间是一整套自研的芯片、系统、操作系统。OpenAI 想做的,是把这两端连起来。

把所有的点串起来——模型、基础设施、自研芯片、能源、edge device、操作系统——会发现 OpenAI 做手机不是一个单点决策,而是这条路径自然长出来的结果。

手机只是第一个被外界看见的形态。但真正的变化是更底下的那一层:计算范式正在从 app 为中心,转向 agent 为中心。

一旦默认入口变成 agent,今天的设备、芯片、操作系统,都会被重新定义一次。

这一次重新定义里,OpenAI 不再只是一家做模型的公司。

*头图

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

极客一问

当 agent 成为默认入口,

今天的操作系统会被重写吗?