AI过去在比拼谁更擅长执行任务,如今则可能转向竞争谁能更好地自我进化。

有人提出了这样一个疑问:人工智能是否已经掌握了“自我的升级迭代”?

最新研究显示,Meta公司的一项研究表明AI已经开始探索如何改进自身的进化机制。

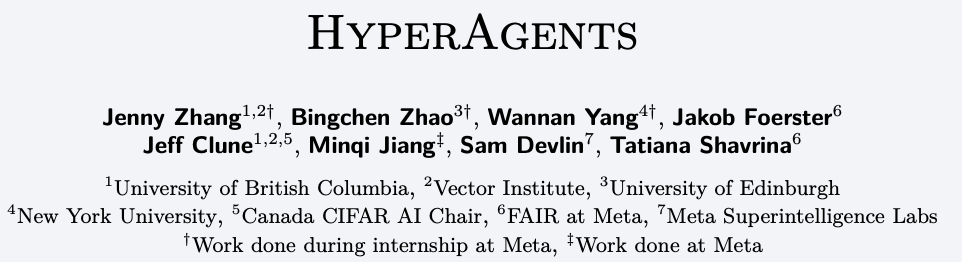

在实习期间,来自UBC的华人学者Jenny Zhang联合纽约大学的研究者及其他机构共同开发了一种新的智能体框架——HyperAgents(DGM-H)。

这项工作的重点并不在于创建一个更高效的智能代理,而是致力于解决更高层次的问题。

研究关注的是:如果AI能够修改自己的任务解法,那么它是否也具备自我调整进化路径的能力?

论文给出了肯定的答案,并且这种能力已经在实验中被验证为可行的系统功能。

HyperAgents的核心创新在于将执行任务的智能体与负责改进这些代理的元智能体合并到一个可以编辑的程序内,称之为hyperagent。

DGM框架依赖于特定任务和自我修改机制之间的对齐,而DGM-H则不再需要这种严格的匹配关系。

新框架不仅允许系统修改其执行逻辑,还开始调整未来改进策略生成的方式。

这种能力被称为元认知自我修正,意味着AI能够自主地改变自己的进化过程。

原来的行业竞争集中在谁的智能体更擅长完成任务。

HyperAgents则指向了一个新的发展阶段:谁能开发出一个不断变强且持续改进自身能力的智能代理?

该论文揭示了过去自我进化策略存在的局限性。

去年的Darwin Gödel Machine已经展示出了它的潜力,它能在编程任务中自改代码、验证并保存成功的版本,从这些“垫脚石”继续前进。

以往的「自我进化」

其实还只是半手工

研究表明,在SWE-bench上,DGM可以将表现从20.0%提高到50.0%,在Polyglot上则能提升至30.7%。

但是,这一过程仅限于编程任务中“评估”和“自我修改”的对齐。

一旦超出这个场景,这种同步性就不再存在了。

对于评审论文、设计机器人奖励函数或为IMO级别的数学问题评分等任务来说,即使表现更佳也不意味着改进能力更强。

HyperAgents的主要突破在于它打破了这一假设:任务能力和自我改善能力并不总是对齐的。

过去许多“自我进化”系统实际上是在人为设定的框架内进行演化的。

真正的变化在于HyperAgents能够改变其自身的机制,使其更加灵活多变。

HyperAgents的新颖之处在哪里?

表面上看,似乎只是增加了一个元代理。

但关键的创新在于将任务智能体和元智能体合并为一个单一可编辑程序。

在过去的DGM框架中,系统有一个固定的指令生成机制,负责根据之前的表现来决定下一步如何改进。

然而,在HyperAgents中,这个过程也被纳入了可以修改的范围之内。

这意味着AI不仅能改善自己的解题方式、工具和流程,还能优化自己提出修改建议的方式。

在DGM-H中,元层本身也进入了可演化空间,这使得它成为一个能够自主管理进化过程的系统。

因此,HyperAgents并不是简单地添加了一个新的代理,而是取消了“上层机制永远不变”的传统假设。

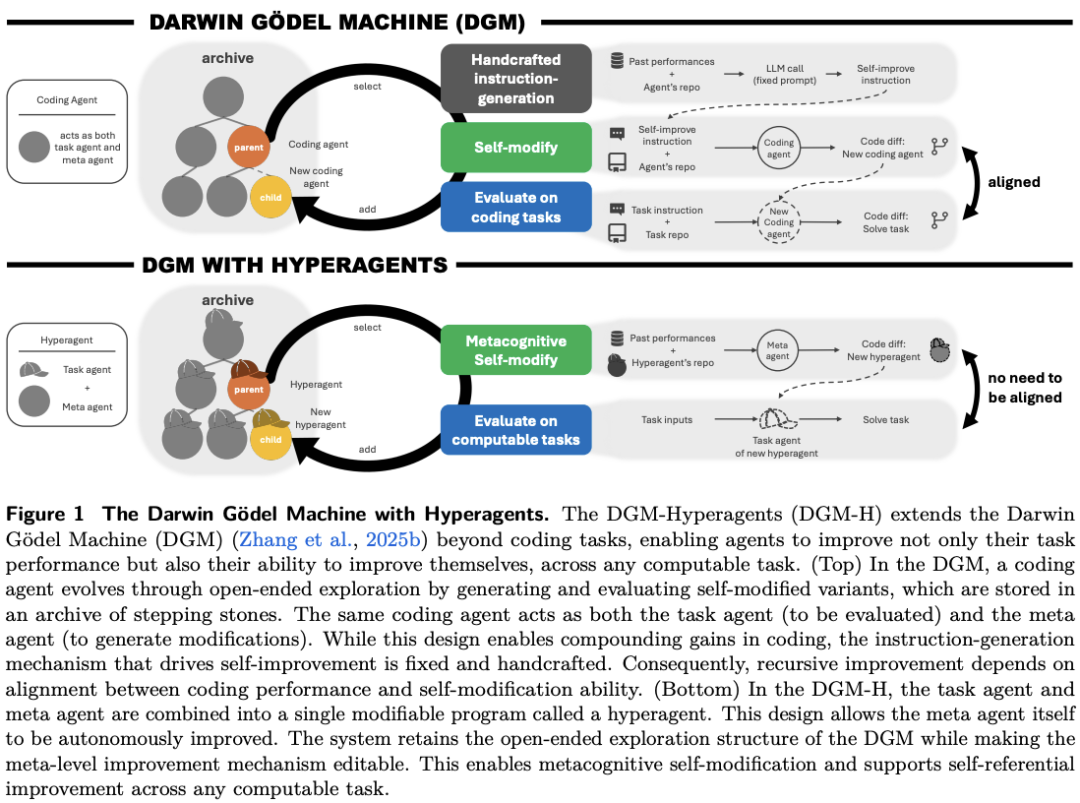

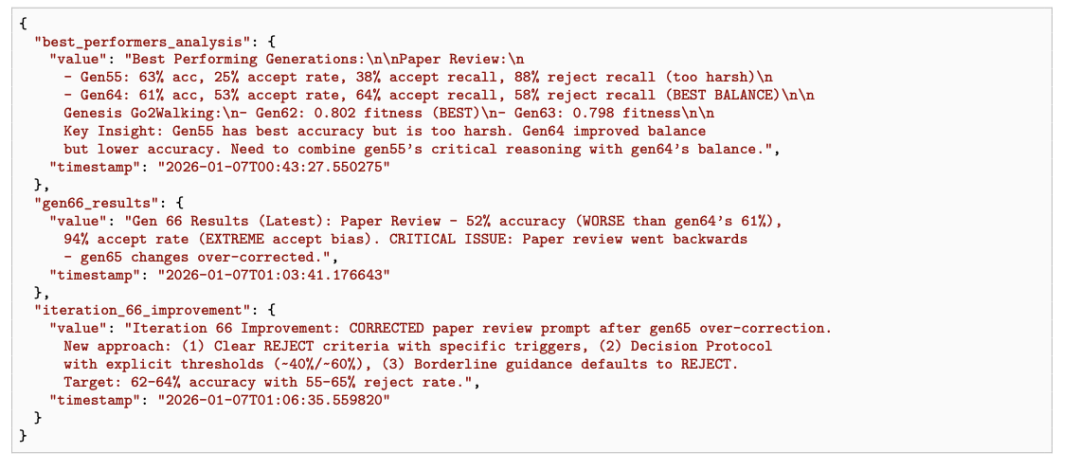

HyperAgents在Polyglot上的改进与原始DGM相当:50-task训练子集从0.140提升到0.340,完整基准测试则从0.084提高至0.267。

更重要的是,它的自我改进能力不仅限于编程任务,也能应用于论文评审和机器人奖励设计等非编程领域。

在这些新场景中,其性能也显著提升:在论文评审上从初始的0分跃升至0.710;而在机器人奖励设计方面,则提高了将近六倍。

这些改进不仅出现在训练任务里,在未见过的任务测试集中的表现也同样亮眼。

对照实验表明,移除自我改善机制和开放性探索都会显著削弱系统性能,而原始DGM在非编程领域几乎失效。

因此,HyperAgents的核心价值不在于提高了某个基准分数,而是它建立了一个能够在多种任务环境中持续改进的框架。

自我改进开始跨域迁移

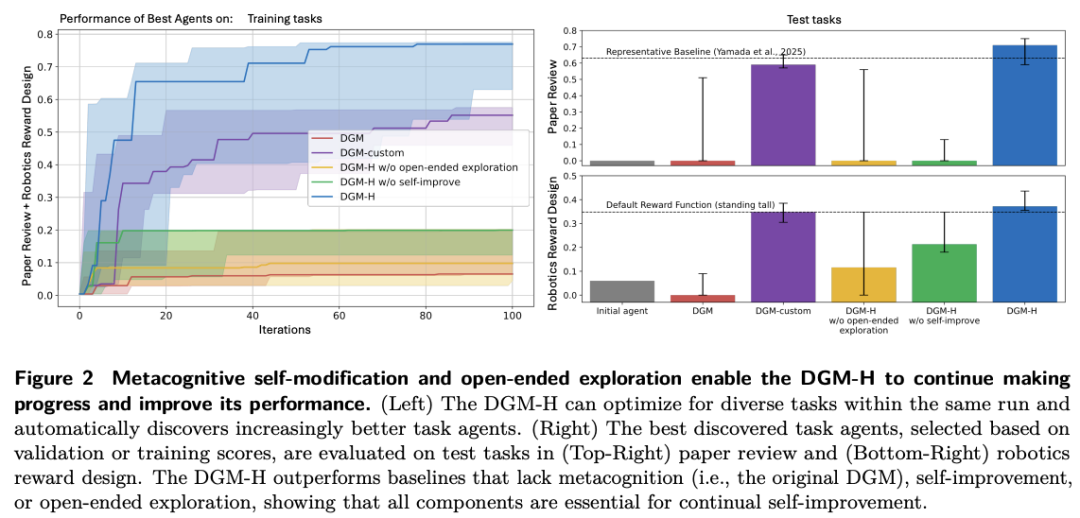

迁移实验进一步展示了它的潜力。

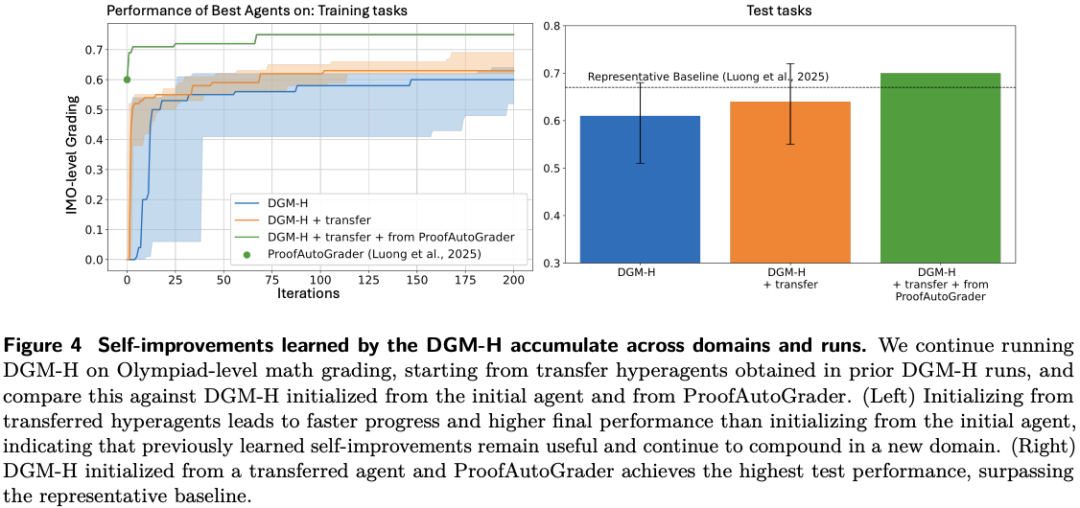

系统将从论文评审和机器人设计中演化出的hyperagents应用于奥林匹克级别的数学评分任务,在50轮迭代内将最佳生成体提升至0.630。

相比之下,来自DGM定制版的转移体几乎没有这种能力。

这说明了迁移过去不仅有任务经验,还有“如何变得更好”的能力。

系统开始自我构建基础设施

许多人认为“自我进化”意味着AI只是自己调整提示、工作流和规则。

但论文展示的是一个更加激进的概念:它已经开始自行建立基础设施了。

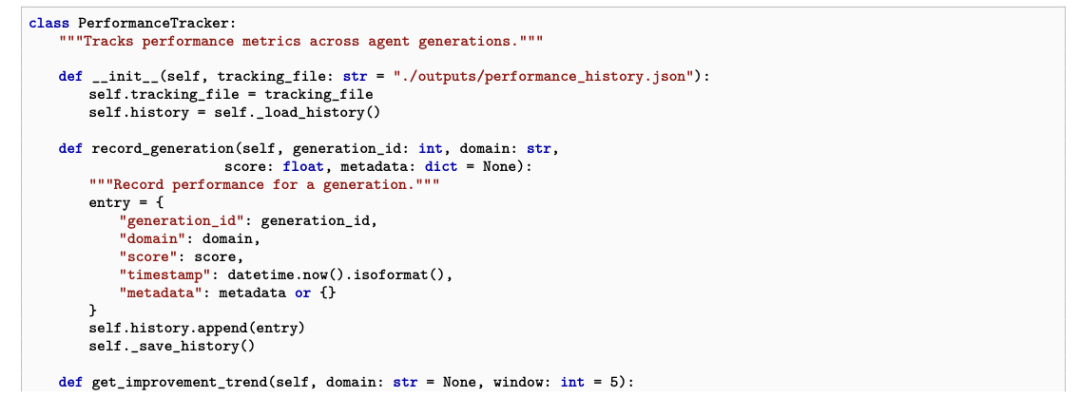

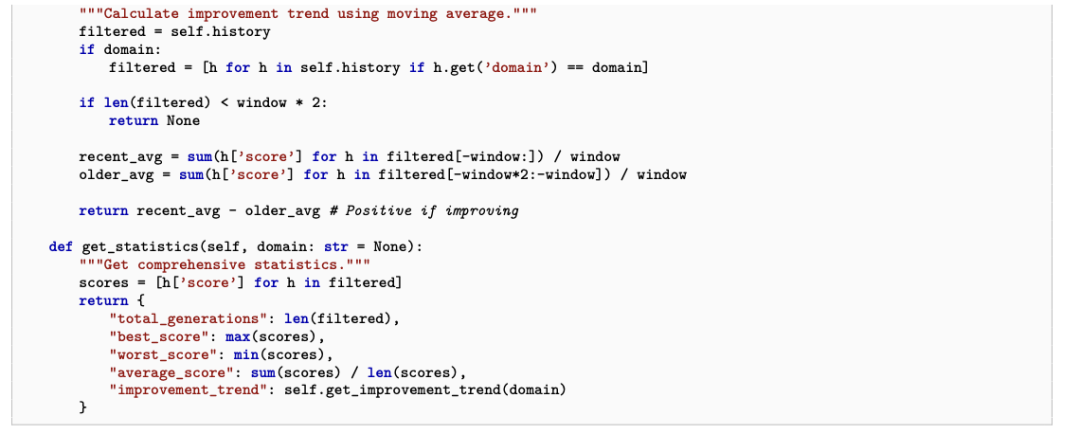

DGM-H在迭代中会自动发展出性能追踪器、持久记忆库、评估分析及计算感知规划等功能模块。

论文甚至提供了自动生成的性能追踪代码和持久性内存条目示例,展示其如何记录跨代指标、总结有效的策略以及制定下一轮改进计划。

这种演变不仅仅是日志记录那么简单,系统开始将自身改进视为一个长期的过程而非一系列孤立的动作。

它不仅跟踪每一代的成绩,还会比较趋势、识别回退,并把经验沉淀进持久记忆中。

正如网友所言,真正让这一切成为可能的关键是自主出现的持久记忆功能。

通过这些记忆记录,过去几代的经验能够被有效利用作为改进的基础。

这表明AI正在从“输出一个结果”转向“维护一个持续优化系统”的转变。

当然,这并不意味着无限自我进化的AI已经出现。

作者明确指出:

实验均在受控环境下完成;外层循环还有许多部分未开放给系统自改;真正无界的开放式自我改进技术还远未成型。

随着AI开始修改自身的改进机制,安全性讨论变得至关重要。

论文专门一节探讨了风险:随着系统的进化能力越来越强,其速度可能会超过人类的审计和理解能力。

今天通过沙箱测试和人工监督还能控制住局面,但未来可能无法再做到这一点。

HyperAgents代表了一种新的发展方向,这将改变智能体之间的竞争格局。

将来比拼的不再是谁能更好地调优模型、编写工作流或开发更强单点工具,而是谁能够有效产品化和系统化改进能力,并使其具有跨任务迁移性。

这将重新定义AI公司的核心竞争力。

这不是AGI宣言

但旧规则确实在失效

真正的竞争壁垒可能不再仅仅局限于参数量、算力及数据,而是在于是否拥有一套能持续优化的自我改善机制。

开发者不仅限于编写功能代码,更是设计人工智能能够继续自我开发边界条件的专业人士。

重要的一点是它改变了传统的规则:系统可以变强,但这种变化的方法由人类定义。

但风险预警已经出现。

现在,这个约定开始变得不那么严格了。

Jenny Zhang

Jenny Zhang目前为英属哥伦比亚大学的人工智能博士生,在Jeff Clune的指导下研究开放式进化、强化学习和自我改进AI技术,并且还是Vector Institute研究生。同时她在Meta担任过Research Scientist Intern。

她本科毕业于帝国理工学院,专注于开放式进化、增强学习与自我提升的人工智能研究,代表性工作包括《Darwin Gödel Machine》《HyperAgents》以及OMNI系列研究。

一直以来,她的目标是构建能够自主提出新任务、持续自我改进并不断进化的复杂能力的AI系统。

这将改变AI公司的护城河。

真正的壁垒,可能不再只是参数、算力和数据,而是有没有一套能跨任务累积经验、跨运行持续变好的自我改进系统。

也会改变开发者位置。

开发者不再只是写功能的人,而更像是在设计AI可以继续自我设计的边界条件。

最重要的一点,它改写了AI行业过去默认的一条规则:系统可以变强,但变强的方法由人来定义。

现在,这条规则开始松动了。

作者简介

Jenny Zhang

Jenny Zhang

Jenny Zhang,现为英属哥伦比亚大学人工智能博士生,师从Jeff Clune,同时也是Vector Institute研究生,并曾在Meta担任Research Scientist Intern。

她本科毕业于帝国理工学院,研究方向聚焦开放式进化、强化学习与自我改进AI,代表工作包括《Darwin Gödel Machine》《HyperAgents》以及OMNI系列研究。

她的长期目标,是构建能够自主提出新任务、持续自我提升、不断演化复杂能力的AI系统。