昨日,小米发布了Mimo-V2 Pro大模型,引起了行业对混合注意力架构的关注。

昨日,小米发布了Mimo-V2 Pro大模型,引起了行业对混合注意力架构的关注。

该大模型拥有万亿级别的参数,采用了1:7的混合注意力比例,其性能接近Claude Opus 4.6,但API定价仅为后者五分之一。

近期,国内多家领先的大模型企业均在混合注意力架构的研究上取得了进展,小米的这项技术也延续了国内顶尖厂商在效率优化上的共识。

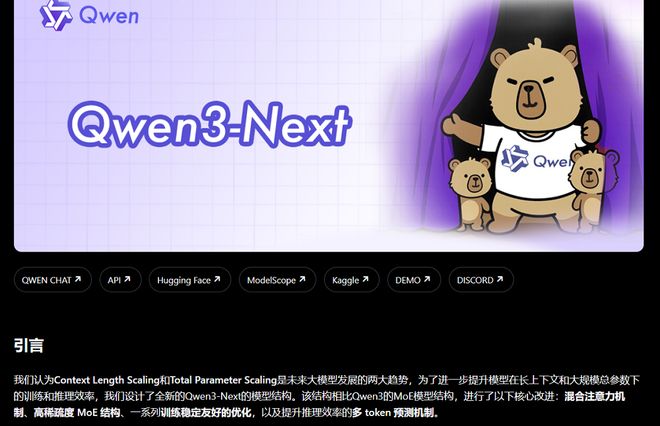

在今年2月,蚂蚁集团发布了全球首个混合线性注意力架构的思考模型;而阿里巴巴则在去年9月推出了下一代模型Qwen-Next,同样采用了混合线性注意力。

同时,月之暗面和MiniMax等公司也在各自的大模型迭代中引入了类似的架构优化。

混合注意力架构的研究已经成为大模型厂商的一项重要任务,各家公司在技术路径的选择上有所不同,但都致力于实现效率与性能的平衡。

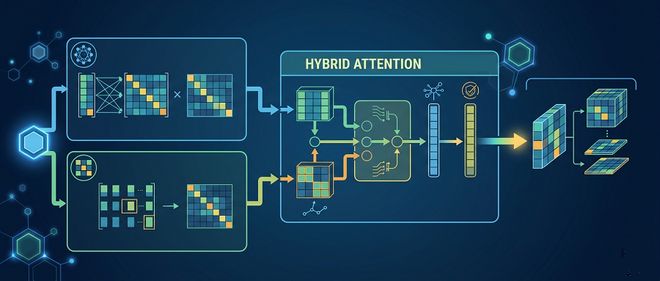

头部玩家正沿着多条技术路径探索混合注意力架构。

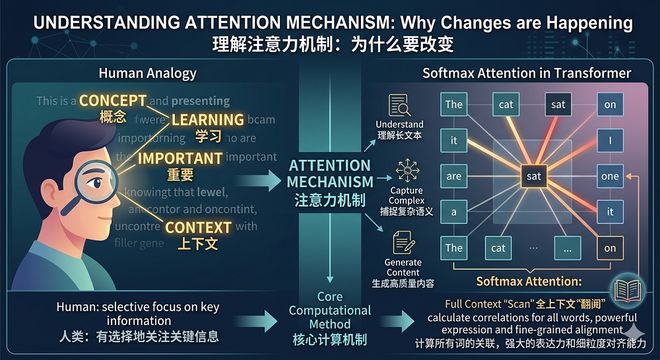

在深度学习领域,注意力机制使得模型能够精准地聚焦于输入信息的关键部分,而Softmax是主流架构中核心的注意力计算方式。

它通过逐字逐句地解析整个上下文,确保了模型的表达能力和细粒度的对齐能力。

然而,随着输入文本长度的增长,其计算需求呈平方级增加,需要大量内存来存储KV缓存,这在商业应用中逐渐显现出局限性。

面对这一挑战,行业内探索出了三种主要的技术路径。

其中一种是稀疏注意力,它通过减少计算量来提高效率,代表性模型为DeepSeek。

另一种是滑动窗口注意力,它在计算注意力权重时仅关注窗口内的邻近token,以此提高效率。

第三种是线性注意力,通过改写Softmax公式,将复杂度从平方级降至线性级,大大降低了推理成本。

然而,每种路径都有其局限性,业界对混合架构的集体转向,实质上是对单一技术路径的改进。

随着越来越多的方案向混合线性注意力靠拢,这种路径成为唯一在理论上突破序列长度限制的方案。

混合线性注意力架构已成为行业共识。

近年来,国内许多大模型企业已经开始了混合线性注意力架构的研究。

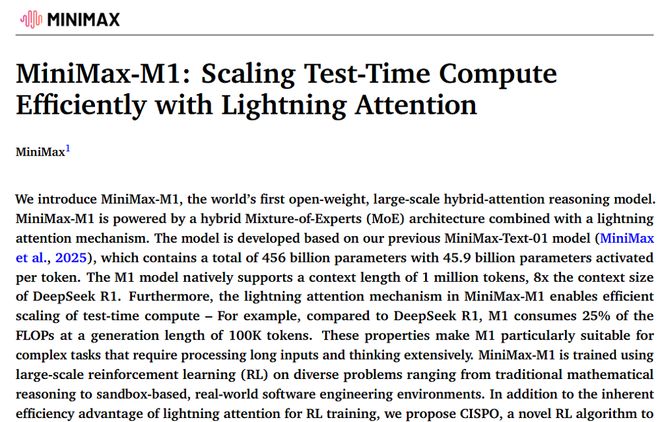

按时间顺序来看,MiniMax Text-01模型于2025年初发布,采用了1:7的混合线性注意力,并在456B参数的模型上实现了落地。

此后,MiniMax-M1模型也采用了相同的架构,团队认为混合架构将成为未来模型设计的趋势,但仍然存在基础设施等方面的挑战。

2025年下半年,更多的混合线性注意力探索活动开始涌现。

去年9月,阿里通义实验室推出了下一代基础模型Qwen3-Next,并在80B模型上完成了验证。该模型通过线性注意力和门控注意力的组合,实现了对长上下文的有效建模。在1:3的混合比例下,其性能超越了单一架构。

阿里的研究团队发现,线性注意力相比滑动窗口注意力,拥有更强的上下文学习能力。

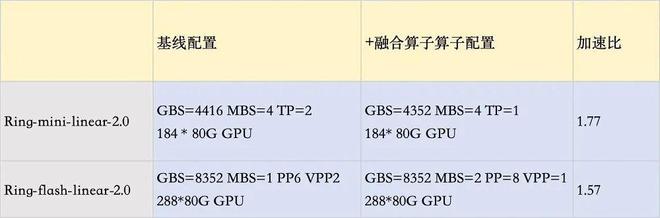

同样在去年9月,蚂蚁百灵团队开源了Ring-mini-linear-2.0与Ring-flash-linear-2.0,验证了Lightning Linear线性注意力在大规模训练和长上下文推理中的可用性。

这两款模型采用了更多的线性注意力层,验证了1:7的混合比例。在高FLOP预算下,其性能明显优于纯Softmax结构。

在这项研究中,蚂蚁百灵团队进一步探讨了架构创新和基础设施优化之间的协同效应,他们开发的FP8融合算子,将FP8混合精度训练的计算效率提升了1.5-1.7倍。

在推理端,他们开发了更高效的线性注意力融合算子,进一步提升了推理引擎的吞吐量。

架构优化与高性能算子协同之下,两款Ring-linear模型在深度推理场景下的成本仅为同尺寸稠密模型的约1/10,相较原有Ring系列成本也下降超过50%。

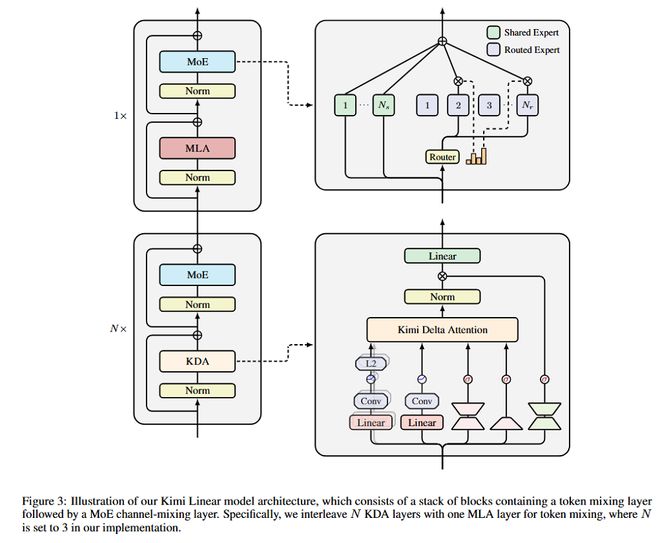

去年10月,月之暗面开源了混合线性注意力架构Kimi Linear,其核心是Kimi Delta Attention(KDA),通过改进门控delta规则,提升了线性架构的表现。

尽管上述探索已经在多个维度验证了混合线性注意力架构的潜力,但大多数成果仍停留在较小规模的应用中。

因此,下一步的关键在于:将这些技术探索应用于大规模模型,在工业级应用中全面验证其可靠性、可扩展性与经济效益。

将混合线性注意力架构推向万亿参数量级的工程落地正在稳步推进。

月之暗面创始人兼CEO杨植麟对混合线性注意力的前景充满信心。他认为线性架构是一个值得深入研究的方向,其团队已在Kimi Linear等项目中积累了丰富的经验。

在下一代模型Kimi K3中,月之暗面计划进一步优化架构,引入更多创新,他相信Kimi K3的性能将远超K2.5。

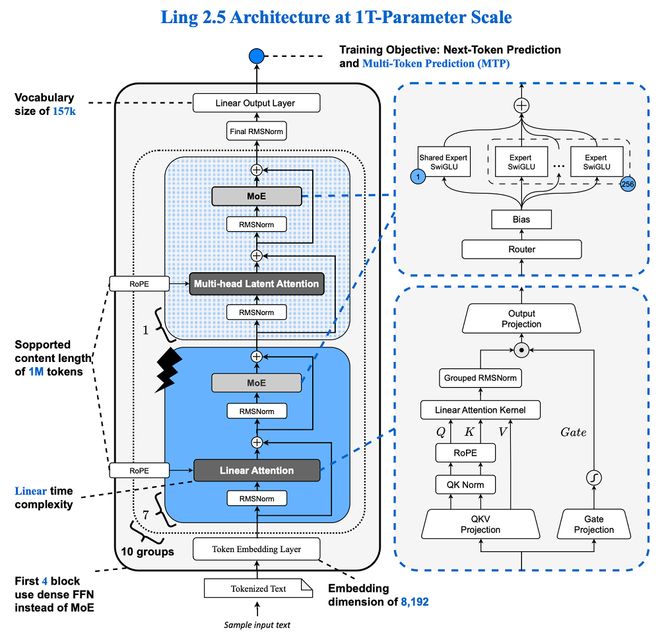

同样押注这一技术路线的蚂蚁百灵团队,已经连续发布了两个万亿参数的大模型,其中包括超大型混合线性注意力架构模型Ling-2.5-1T和全球首个混合线性注意力架构的万亿参数思考模型Ring-2.5-1T。

在前期研究的基础上,蚂蚁百灵团队通过增量训练方式构建了Ling 2.5架构。该架构将GQA+Lightning Linear升级为更高效的MLA+Lightning Linear组合,在压缩KV缓存的同时,保持了模型的表达能力。

Ling 2.5架构采用了1:7的混合比例,并保留了QK Norm、Partial RoPE等核心机制,确保架构迁移过程中模型性能不发生退化。

在降低成本和提高效率方面,Ling-2.5-1T仅需约6000个token的平均输出长度,即可完成前沿模型需要1.5万-2.3万个token才能完成的复杂任务。其访存规模压缩至传统架构的1/10,生成吞吐量提升至3倍。

上述种种探索,已经超越了单纯的技术提升,重新定义了大模型的应用边界和商业形态。

当推理成本显著下降、token使用效率持续优化时,模型调用成本或许不再是限制其大规模落地的核心问题。

随之而来的是应用范式的自然演变。企业可以将大模型作为一种默认能力嵌入到更多业务环节中,实现更广泛、更深入的效率提升。

在高频与实时场景中,大模型的角色可能会发生变化,在搜索、推荐、智能客服等场景中,它们不再只是传统系统的补充模块,而是有望成为核心驱动引擎,成为底层基础设施。

从堆参数到拼工程,大模型的广泛应用更近了一步。

混合线性注意力架构的研究仍在不断深化,但这条路径注定不会一帆风顺。不同技术路线之间仍在反复博弈与验证,例如MiniMax在阶段性探索后选择回归全注意力模型,以优先保证复杂场景下的稳定性与可靠性。

然而,一个更为深层的趋势已经愈发明显:大模型的竞争正从“暴力堆参数”转向“工程效率的精算”。当行业逐渐形成共识,决定胜负的将不再只是规模本身,而是单位算力所能释放的有效能力。

架构层面的细微差异,最终会在企业级落地中放大为显著的成本优势与体验差距,并推动大模型从“可用”迈向“好用”,再走向真正的广泛普及。

架构层面的细微差异,最终会在企业级落地中放大为显著的成本优势与体验差距,并推动大模型从“可用”迈向“好用”,再走向真正的广泛普及。