北大团队研发的新技术使DeepSeek的处理速度提升了四倍,同时几乎不牺牲精度。

即插即用无需重新训练

最近,在大家焦急等待DeepSeek-V4的时候,一篇新论文引起了广泛关注——

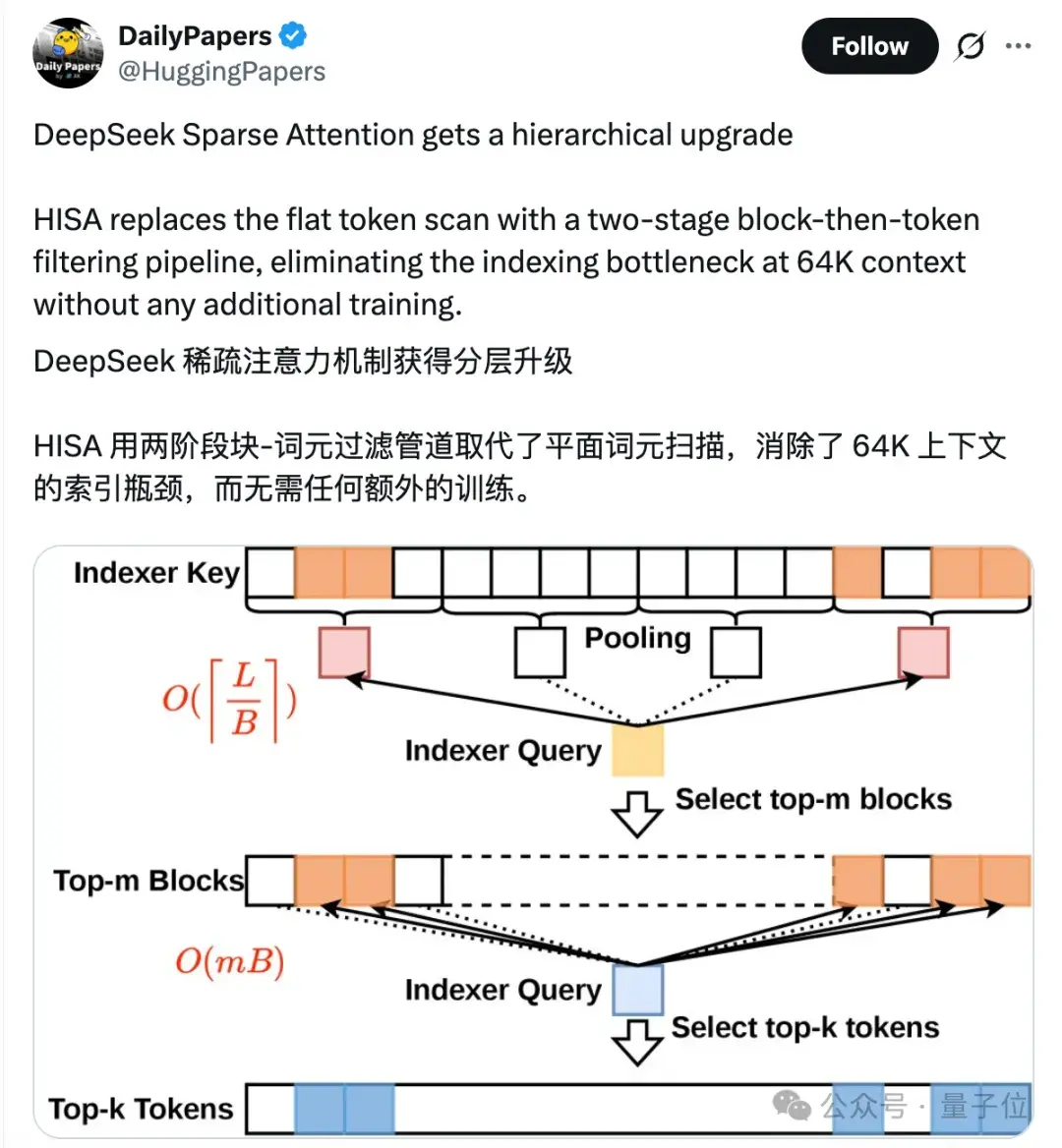

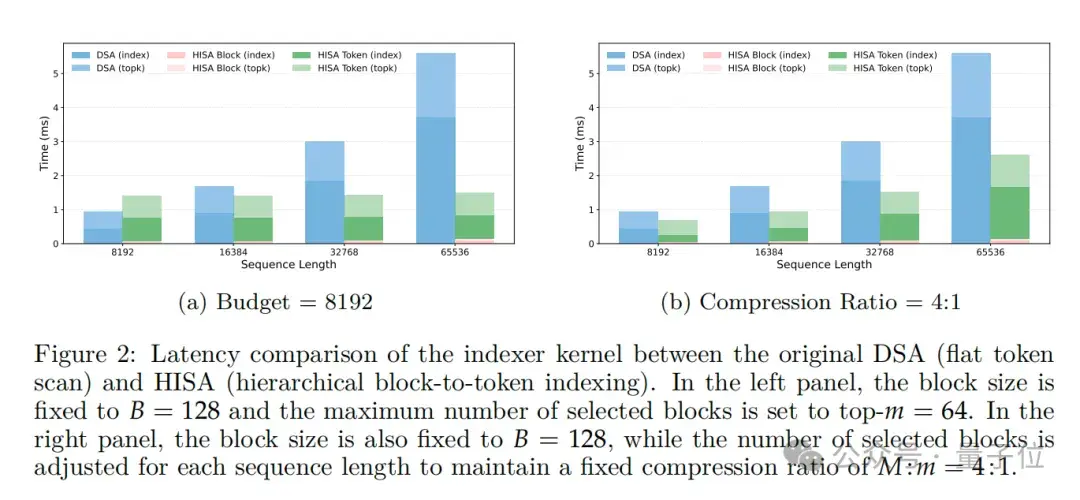

新研究提出了一种名为HISA(分层索引稀疏注意力)的新型稀疏注意机制,解决了64K上下文长度下的索引瓶颈问题,并将速度提高了2到4倍。

不仅显著提升了运行效率,还实现了即插即用的效果,在换掉原有索引器后无需重新训练模型。

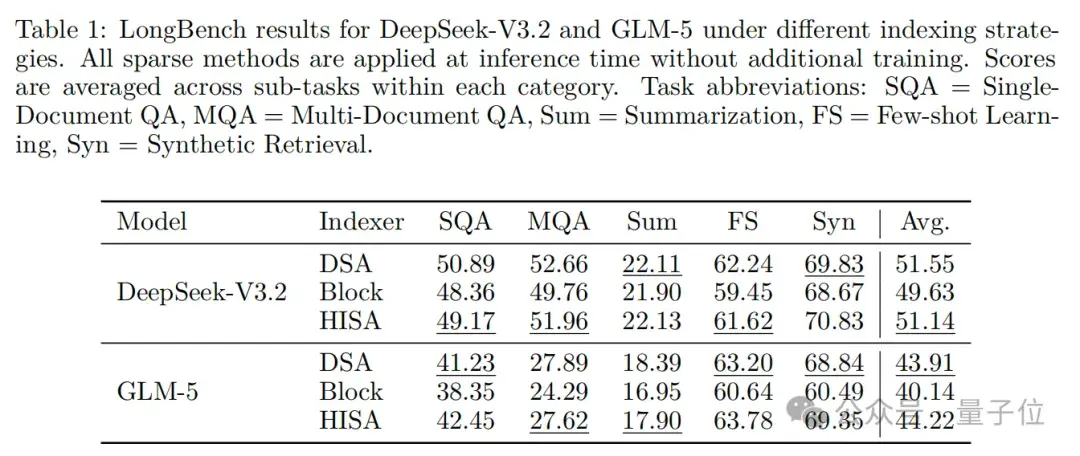

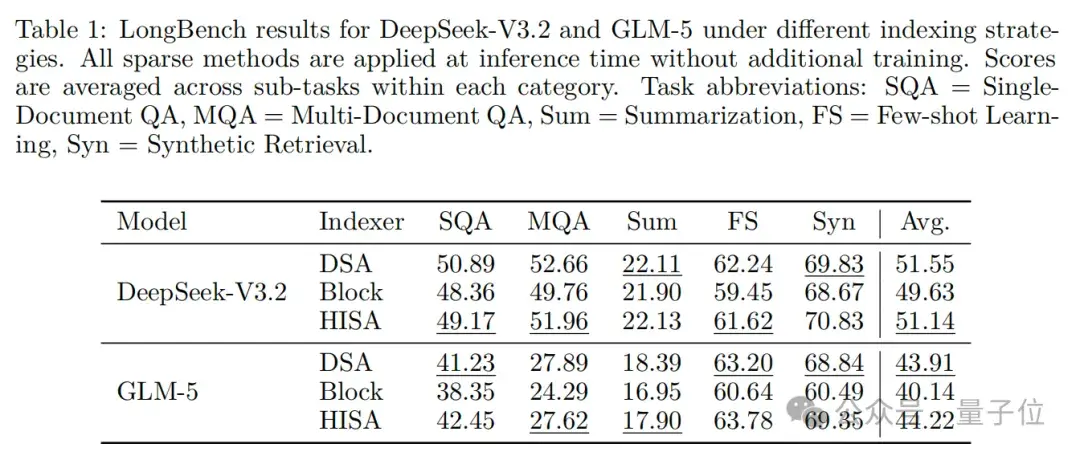

在DeepSeek-V3.2和GLM-5两个大型语言模型中直接替换原索引器,并未影响其精度水平。

HISA在处理长文本理解和提取关键信息等任务时,其效果几乎与传统方法一致。

该技术通过两步法来优化上下文的检索过程。

这项研究旨在改进大模型中稀疏注意力机制的索引器,使其更加高效。

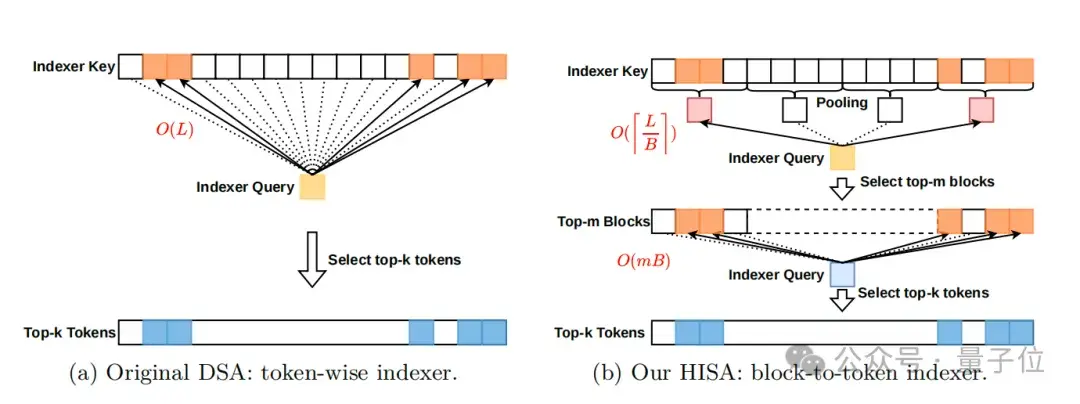

当前主流的DSA(DeepSeek Sparse Attention)等token级稀疏注意机制的核心思路是在计算时只关注关键token,从而降低算力消耗。

但是这种设计存在一个隐藏的问题:在检索相关字符时需要对每个待查字符与前面所有字符进行评分比较,工作量随着文本长度呈平方级别增加。

在处理极长的文档或数据集时,索引器的工作效率成为瓶颈,甚至会拖慢整个计算过程的速度。

鉴于此,研究团队开始探索一种在不改变最终稀疏注意力结果的前提下减少索引器工作量的方法。

为此,他们提出了HISA(Hierarchical Indexing Sparse Attention)机制,其核心在于分块处理和高效筛选:

将长文本划分为固定大小的“字符段”,计算每个段的整体特征向量;

只需对这些整体特征进行评分,挑选出分数最高的若干个段落并深入分析其中的内容。

这种方法不仅减少了大量不必要的计算工作,还能够保持原始索引器的功能不变。

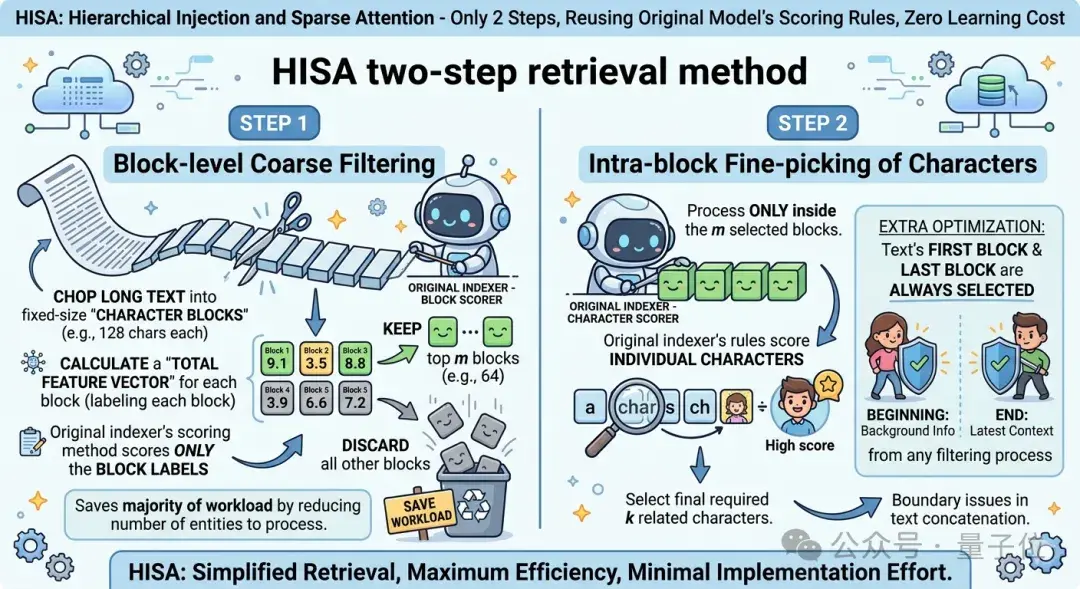

实际操作中只需要两步,且全程利用原有模型的评分规则:

首先将文本分割成固定大小的小段,并为每个小段生成一个特征向量;

第一步,块级粗过滤。

- 然后根据这些特征向量进行初步筛选,保留高分段落;

- 在后续步骤中仅对这些选定的段落内的字符进行详细分析。

- 这样的方法能大幅减少计算时间,并且保证了最终结果的质量。

同时为了防止关键信息丢失,确保文本开头和结尾的部分被包含在内。

HISA的优势在于其高效的复杂度降低以及良好的兼容性:

它将原索引器的O(L²)计算成本降到了O(L²/B + L×m×B),其中B是段落大小,而m则是筛选出的段落数量。

HISA在长文本处理中表现尤为突出,并且具有强大的工程应用潜力:

它可以直接替换原来的索引器而不需调整下游组件;

这种方法无需重新训练模型或修改KV缓存结构,使用起来非常方便。

测试表明HISA在速度和精度上均表现出色:

在DeepSeek-V3.2及GLM-5等大型语言模型上的测试显示,HISA比原DSA索引器快了多达3.75倍;

对于更长的上下文长度,如128K或1M字节的数据集,其加速效果更为明显。

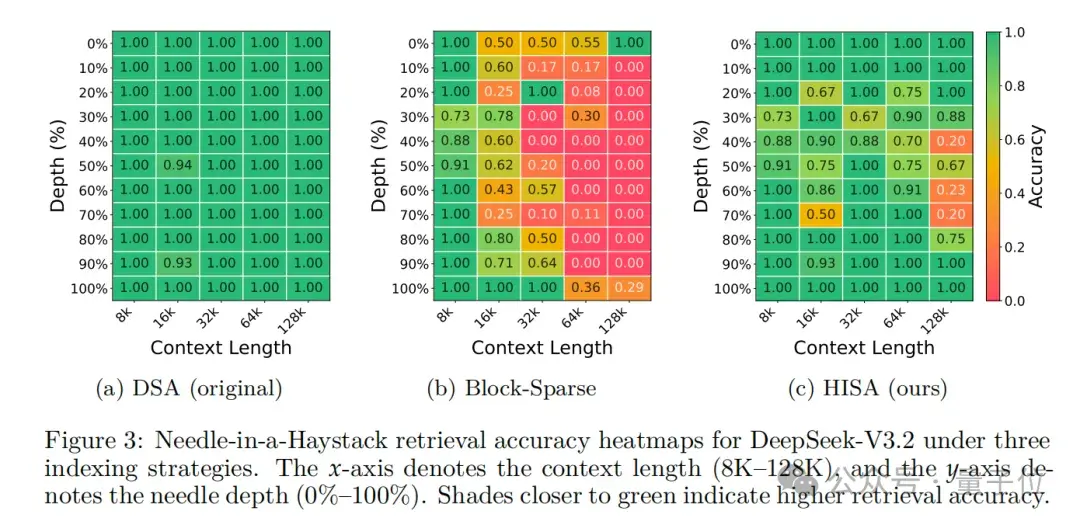

在精度方面,无论是在"大海捞针"测试中还是在LongBench基准上,HISA的表现均接近DSA水平;

特别是对于合成检索和少量样本学习等任务,在token筛选的准确性要求较高的场景下有所超越。

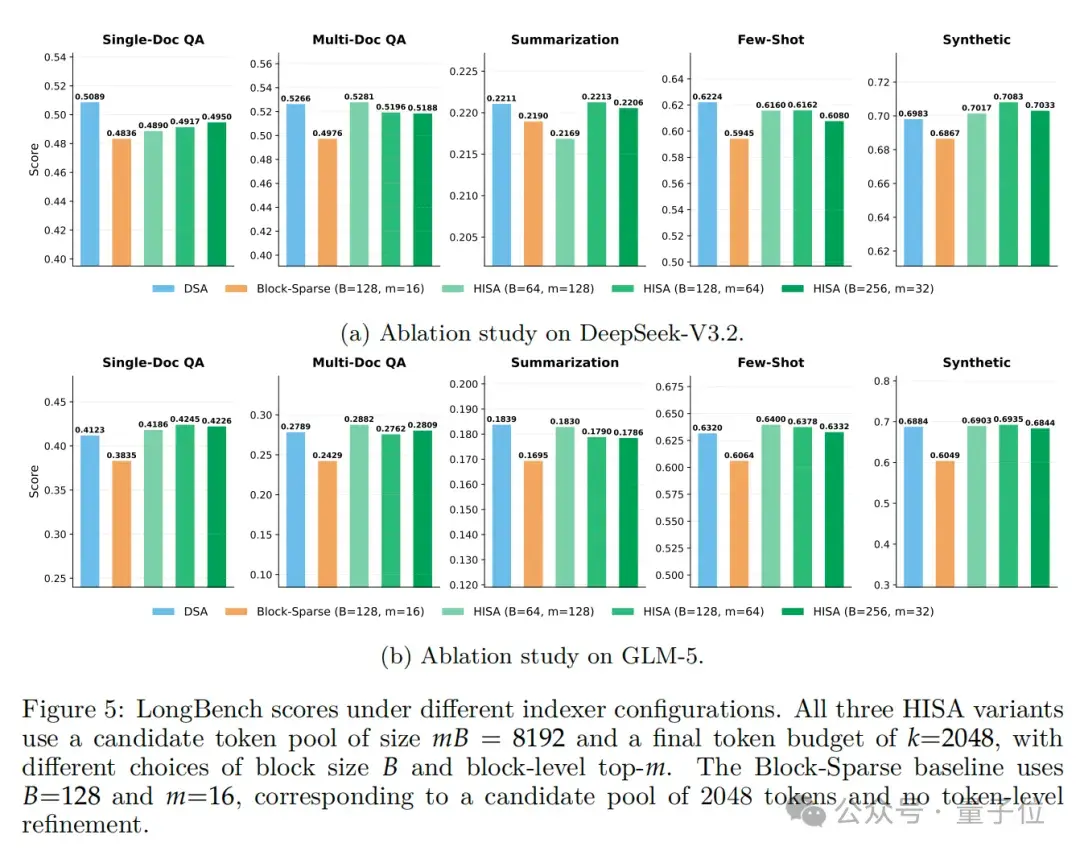

从超参数选择的角度来看,HISA具有很高的稳定性,无论是在不同的块大小还是选段数量上都表现良好。

这表明未来在工程实现过程中无需对细节进行过多调整。

目前该研究还存在一些小问题,但团队已经提出了改进方案:

比如可以考虑采用自适应分块或重叠分段等策略来提高准确性;

在未来的研究中可能会将筛选机制与模型训练相结合以进一步优化性能。

此外还有必要进行端到端的吞吐量和延迟测试,以便更全面地评估其效果。

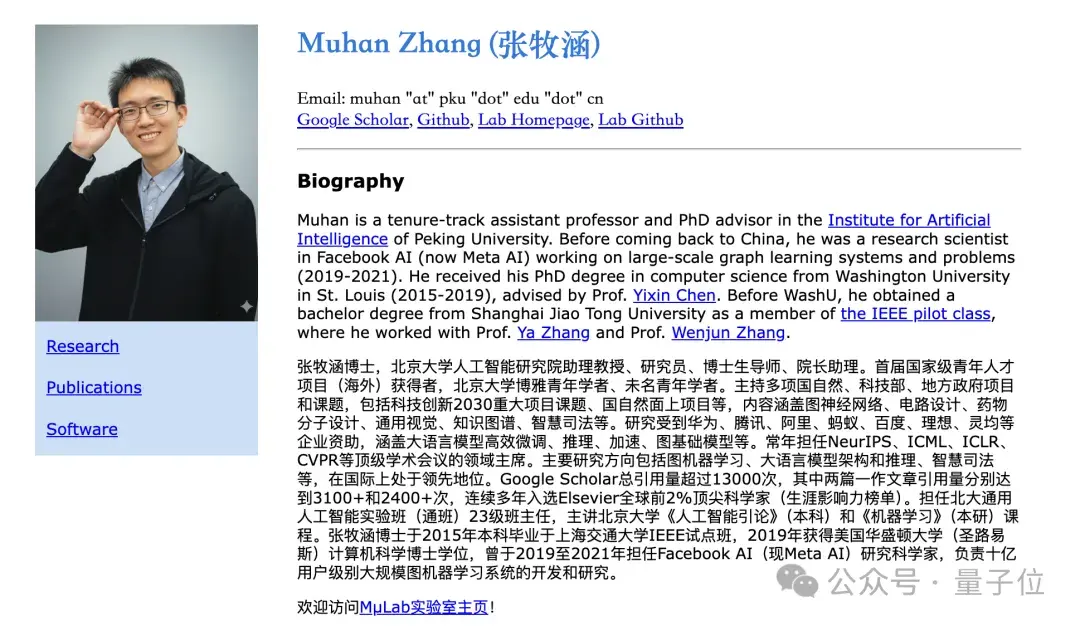

该论文由北京大学张牧涵教授团队撰写完成。

张牧涵目前是北大人工智能研究院的一位Tenure-track助理教授兼博士生导师。

在加入北大之前,他曾在Facebook AI(现为Meta AI)担任研究员;

其研究成果在Google Scholar上的引用量超过了一万三千次,并且连续多年入选Elsevier全球前2%顶尖科学家榜单。

该论文的第一作者包括Yufei Xu和Fanxu Meng。

不过目前HISA还有小瑕疵,作者也提出了后续改进思路:

第一,现在块是固定大小的,若一个块里混了无关和相关内容,块的 “整体标签” 会不准。

未来可以搞自适应块、重叠块,或换更好的块特征计算方式。

第二,目前只是推理时直接用,未来可以把块筛选和模型一起训练,让筛选更精准。

第三,现在只测了索引器的速度,未来整合到完整的大模型服务框架里,测端到端的吞吐量和延迟。

团队背景

这篇论文出自北京大学的张牧涵团队。

张牧涵,北京大学人工智能研究院的Tanure-track助理教授和博士生导师。

回国前曾在Facebook AI(现为 Meta AI)担任研究员,从事大规模图学习系统和问题的研究。

其Google Scholar总引用量超过13000次,其中两篇一作文章引用量分别达到3100+和2400+次,连续多年入选Elsevier全球前2%顶尖科学家(生涯影响力榜单)。

Yufei Xu(徐宇飞)和Fanxu Meng(孟繁续)为论文的共同一作。

参考链接:

[1]https://arxiv.org/abs/2603.28458

听雨

听雨