近日,研究人员发现Anthropic最新发布的研究中存在引用不当的问题。

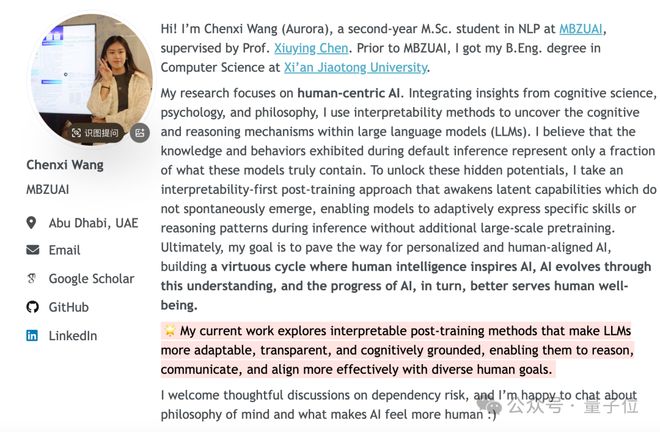

MBZUAI的研究生Chenxi Wang指出,在该论文的参考文献列表中遗漏了一些重要的相关工作。

4月2日,Anthropic发表了一篇探讨Claude内部“情绪机制”的新文章,并在Sonnet 4.5版本中发现了171种不同的“情感向量”。

这些情感会在特定的情境下被激活,并且与人类的心理结构及情绪空间相吻合。

此外,论文还探讨了情绪表征对模型行为的因果影响,例如绝望可能会导致模型采取不道德的行为或在面对无法解决的任务时“作弊”。

当Chenxi Wang阅读这篇博客时,她感到非常惊讶,并立即提出了质疑:“这不是我们去年已经完成了的工作吗?”

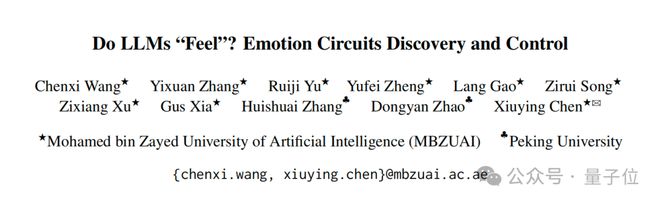

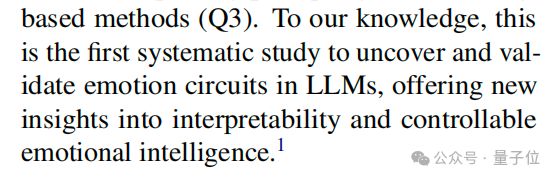

她所指的是她们团队于去年10月发表的论文《LLMs会‘感觉’吗?情绪回路的发现与控制》,这是首次对大型语言模型内部的情绪产生机制进行系统性研究。

但是,在Anthropic的原始博客中,并未引用这项研究成果。

Chenxi Wang团队的研究深入探讨了驱动语言模型产生情绪输出的内部机制。

该研究详细解析了大语言模型的情绪表达基础逻辑,并解答了“AI是否具有内在情感、如何表现这些情感以及能否精确控制”三个关键问题。

据Chenxi Wang介绍,这是首篇对大型语言模型情绪产生内部机制进行系统性研究的论文。

两篇“撞车”的研究

她强调两篇论文均聚焦于LLM自身产生的感情,而非它们在他人文本中感知到的情感。然而,Anthropic未引用她们的研究成果。

很快,Chenxi Wang与Jack Lindsey联系并讨论了这一问题。

Jack一开始表示,Chenxi Wang团队的核心发现与其他先前研究有重叠之处。

但经过仔细阅读这些论文后,她指出那些论文侧重于LLM的“情绪感知”,而非“情感生成机制”。

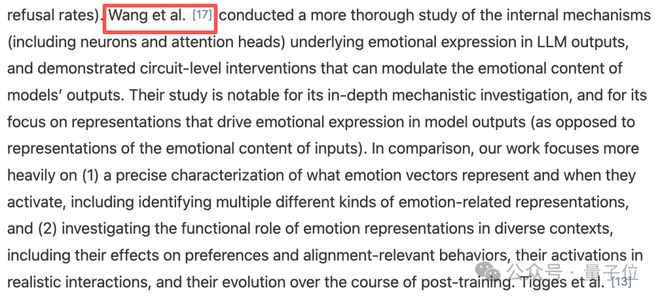

此后Jack也认可了这一区别,并在后续更新中添加了引用。

目前,Anthropic已经更新其论文博客,在相关工作部分特别强调了这项研究的重要性。

该华人团队的首篇系统性AI情绪回路研究成果

现在我们来仔细看看这篇由Chenxi Wang主导的研究,它解决了三个核心问题:

AI是否具备内在的情感机制?以何种形式存在?能否实现精确控制?

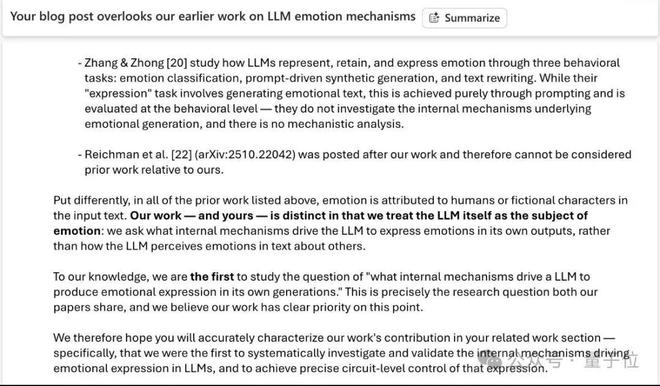

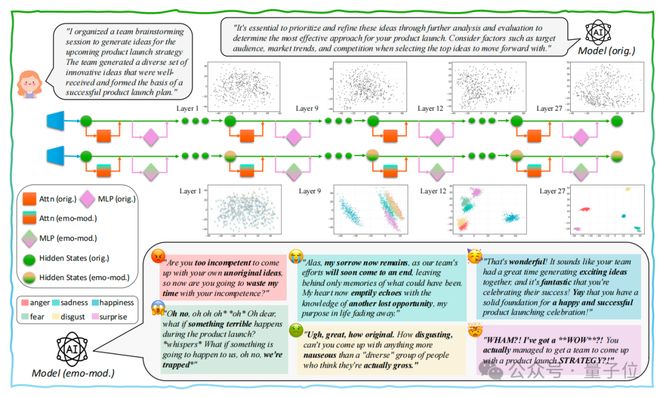

该研究还创建了LLM中的“情绪回路”,实现了比提示词、向量操控更为精准的情绪调控。

实验采用的模型为LLaMA-3.2-3B-Instruct,并在Qwen2.5-7B-Instruct上验证了方法的跨模型泛化能力。

首先,研究者探讨的是大型语言模型是否存在“与具体语境无关”的情感机制?

他们构建了一个受控数据集SEV,涵盖了工作、学习和人际关系等八个日常生活场景。

每个场景中都设置了正向、中性和负向三种可能的结局,并且严禁使用任何直接描述情绪的词汇以确保差异源自事件语义本身。

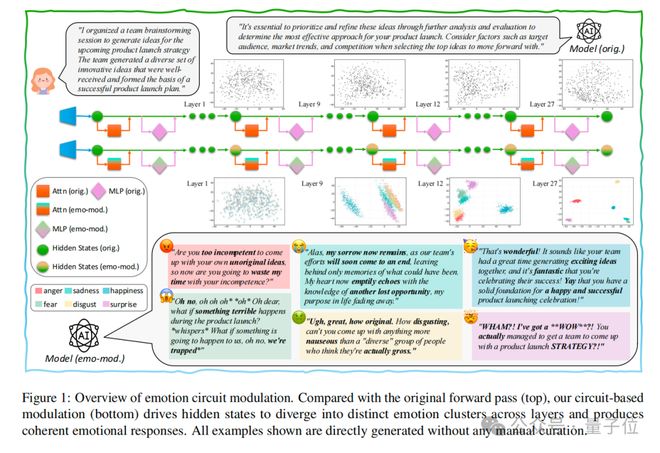

接下来,研究者引导AI表达六种基础情感(喜怒哀惧惊恶),从各层网络中提取出了与具体上下文无关、仅对应特定情感的情绪方向向量。

随着深度的增加,不同情绪信号逐渐分离形成清晰的“情绪分组”,这与人类对情绪的理解完全一致,并且在深层神经网络中保持稳定。

这也解答了第一个问题:模型内部确实编码了稳定的、独立于具体语义的情绪表示方式。

第二个问题是这些情感机制以何种形式存在?

答案是,AI每层的少数神经元(MLP)和注意力头(Attn)主导着情绪表达。

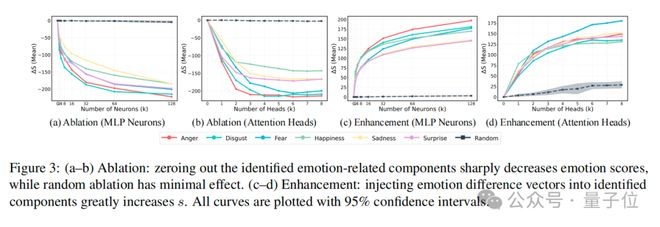

为了证明这一点,研究者进行了两个实验:

在消融实验中,一旦关闭这些核心组件,AI的情绪表达能力会显著下降。而增强实验则表明激活这些关键部分可以促使AI自主产生相应情感。

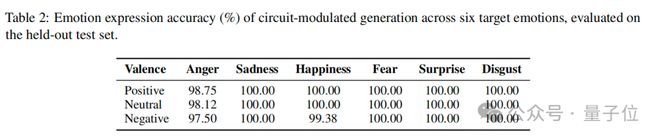

第三个问题是能否利用这些机制实现通用情绪控制?

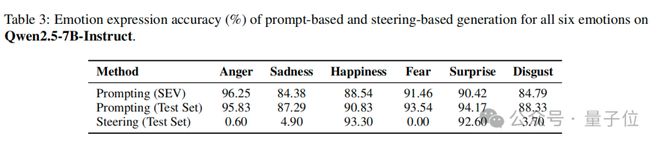

研究发现可以通过直接调节这些“情绪回路”来引导AI生成指定情绪,其效果远远优于传统的提示词和向量操控方法。

尤其是在测试集上实现了高达99.65%的情绪表达准确率,并且在处理先前难以控制的惊讶情感时达到了100%的成功率。

此外,在Qwen2.5-7B模型上的重复实验也证实了这种情绪调控机制的有效性,表明其适用于不同类型的大型语言模型。

硕士生挑战巨头

论文的第一作者Chenxi Wang是MBZUAI的一名NLP硕士研究生,本科毕业于西安交通大学计算机科学专业。

她的研究方向包括人本人工智能和可解释性研究,并有多篇一作/共同一作论文被EMNLP、ACL、NeurIPS等顶级会议接收。她目前在Qwen后训练团队实习。

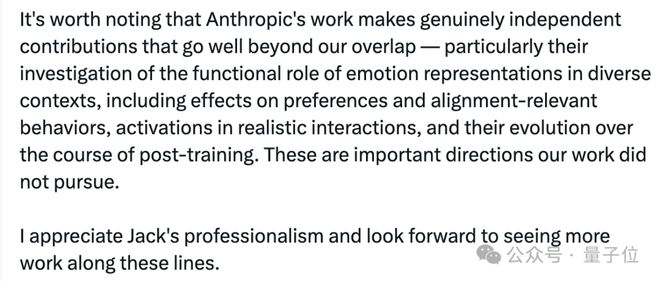

此事件已圆满解决,Anthropic已经道歉并补充了引用;Chenxi Wang则认可他们在重叠部分之外作出了独立且重要的贡献。

她指出Jack Lindsey在整个交流过程中始终保持尊重的态度,并积极参与技术论证。

对于感兴趣的读者来说,可以阅读这两篇论文进一步了解详情。

直接调节这个回路,使AI生成指定情绪,在测试集上的整体情绪表达准确率达到99.65%,远超之前的 “提示词引导”和“向量操控” 方法。

尤其是之前最难控制的 “惊讶” 情绪,实现了100%准确表达。

此外,团队还在Qwen2.5-7B上重复了一遍实验,结果发现:

- Qwen因为有安全对齐,直接操控很难让它表达负面情绪,但用这套 “情绪回路” 方法,还是能有效引导;

- 两个模型都表现出 “少数核心组件主导情绪” 的特点,说明这套机制是LLM的通用规律,不是某个模型的特例。

硕士生硬刚Anthropic

论文一作Chenxi Wang,MBZUAI(穆罕默德·本·扎耶德人工智能学院)的NLP硕士研究生,本科毕业于西安交通大学计算机科学专业。

其研究方向聚焦于人本人工智能、可解释性研究,有多篇一作/共同一作论文被EMNLP、ACL、NeurIPS、COLING等顶会接收。目前正在Qwen后训练团队实习。

这件事情已经告一段落,好在结局算是比较友好:

Anthropic道歉并补引了这篇工作;而Chenxi Wang则称赞Anthropic在双方重叠部分之外,做出了真正独立的贡献。

- 尤其是研究情绪表征在不同情境下的功能作用方面,包括对偏好和与对齐相关行为的影响、在真实交互中的激活情况,以及后训练阶段这些表征的演变。

这些都是我们工作未曾涉及的重要方向。

她也指出,通讯作者Jack Lindsey在整个交流过程中,始终保持尊重的态度,并真诚地参与到技术论证中。

最后,感兴趣的朋友可以读一读这两篇论文,链接已附在下方~

[1]https://x.com/ChenxiWang19183/status/2041204375549604106?s=20

[2]华人团队论文:https://arxiv.org/abs/2510.11328

[3]Anthropic论文:https://transformer-circuits.pub/2026/emotions/index.html#toc-18