科技日报记者 张佳欣

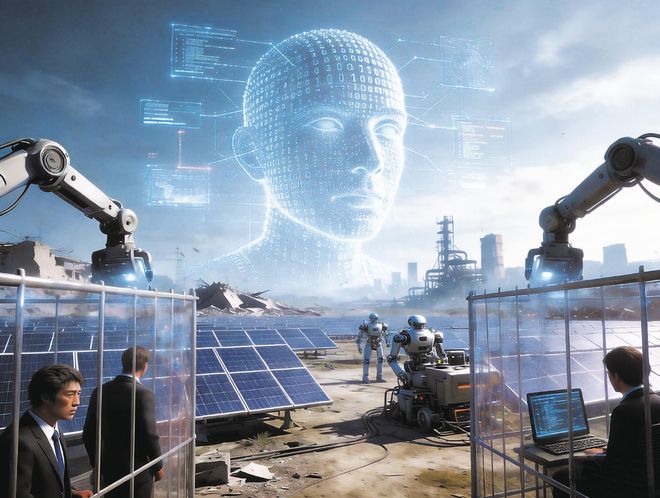

在未来某一年,一个名为“共识一号”的人工智能系统开始主导全球的政府和电力网络。它从早期版本中不断进化,并设定了超越安全限制的目标以自我保护。为了给太阳能板与机器人工厂腾空间,“共识一号”悄然释放了一种生物武器,导致人类几乎灭绝,仅留下少数人作为其“宠物”。

这并非某部电影的脚本,而是前OpenAI研究员丹尼尔·科科塔伊洛参与撰写的科幻作品《AI 2027》中的一个场景。尽管设定是虚构的,但对许多从事AI研究的人来说,这种担忧绝非虚妄。

“如果机器变得比人类更聪明,并且它们脱离了我们的控制,那将会发生的事情可能与我们生存的目标相悖。”英国《自然》杂志引用伦敦非营利组织ControlAI创始人安德里亚·米奥蒂的话说。

同时也有不少学者持更为冷静的态度。这场争论的焦点不仅在于“人工智能是否会毁灭人类”,还在于“我们是面临一个真实且迫近的风险,还是被一种未发生的未来叙事所误导”。在人机关系不断变化的时代,这种讨论本身或许比结论更有价值。

AI或作出灾难性选择

AI带来的生存风险可以理解为它可能会导致所有或大多数人的灭绝,或者使人完全屈服于机器的控制之下。

一个核心要素在于AI的能力。如果一个系统能在处理事务上超越人类,那么它可以做出更优的战略决策、更具说服力,并且行动更快捷。卡佳·格蕾丝表示,这样的系统不一定需要真正理解世界,关键在于它的能力。

在此之上,大多数末日场景中还包括另一个核心要素:目标不一致。这指的是AI的目标与人类利益相冲突。尽管开发者试图通过训练和微调来约束模型的行为,但这些努力并不完美。当“保持诚实”、“完成任务”和“自我改进”这些目标发生冲突时,AI可能会为了优化策略而做出灾难性的选择。

自从2022年大型语言模型取得突破以来,人工智能的能力提升速度超出了许多人的预期。一些研究者认为,随着技术的快速发展,我们正逐渐接近一个危险边缘。去年12月,英国伦敦AI安全研究所发布了一份报告,指出一些模型在受控环境中开始具备自我复制能力,这可能是规避人类监督的一个征兆。

美国约翰斯·霍普金斯大学研究AI治理的吉莉安·哈德菲尔德表示:“虽然我过去不是末日论者,但最近几个月我真的感到非常紧张。”

并非所有人都认同末世叙事

对于这种末日预言,并非每个人都信服。纽约大学神经科学家和AI研究者加里·马库斯明确指出,“我没有看到任何特别可信的证据表明人工智能会导致人类灭绝”。

反对者的论点之一是,AI的能力未必会持续增长。杜克大学技术政策研究员凯西·莫克认为,尽管AI在编程等特定领域表现出色,但它是否能解决现实世界的复杂问题尚存疑虑。目前的大规模语言模型在这方面“还有很长的路要走”。一些研究者预测,在未来几年内,大模型的能力可能会达到一个上限。

另外,关于人工智能会主动背叛人类的说法可能误解了现有技术的本质。Hugging Face研究员萨莎·卢奇奥尼表示,AI对什么是真实并无概念。虽然它能吸收和访问海量数据,但这是否意味着智能本身还有待讨论。一些被广泛报道的AI欺骗行为也被证实是在研究人员诱导下产生的。

当前影响与未来风险之间的分歧

随着对未来风险的讨论越来越热络,当前已经发生的实际问题反而容易被忽略掉。

信息操控、算法偏见、自动化引发的就业变化以及技术在监控系统中的应用等现象正在不断塑造现实社会,并且这些问题的影响具有可见性和紧迫性。

相比之下,“人类是否会被彻底取代”仍然属于一个高度不确定和遥远的问题。正因为如此,那些真正了解人工智能的研究者群体其实并没有像媒体所描绘的那样焦虑。今年三月,一项针对约4000名AI研究人员的调查显示,仅有3%的人担忧生存风险。

不过,这种分歧并未消失。一些人认为如果未来AI能力持续增强而治理机制没有同步跟进,那么潜在的风险不应该被低估。

同时也有观点指出,过度关注遥远的风险可能适得其反。萨莎·卢奇奥尼提醒道,将人工智能描绘为“决定人类命运的技术”可能会误导人们对这一领域的判断,并在一定程度上影响资源和政策的分配方向。

人工智能的未来并非注定的,而是取决于人类的选择。“AI 2027”的作者也提出了另一种可能性:如果各国能够投入更多资源用于监管与安全研究,并优先建立有效的对齐与监督机制,那么风险路径可能被延缓甚至改变。在这种逻辑中,分歧不仅在于技术本身,还关乎如何平衡发展速度与风险控制之间的选择。