新智元报道

Anthropic近期是否开始大规模招聘科学家?其STEM Fellow项目正在积极招募各领域专家,以弥补AI在判断力方面的不足。

一份由硅谷顶尖人工智能公司发布的最新招聘信息显示,应聘者并不需要具备机器学习的背景知识?

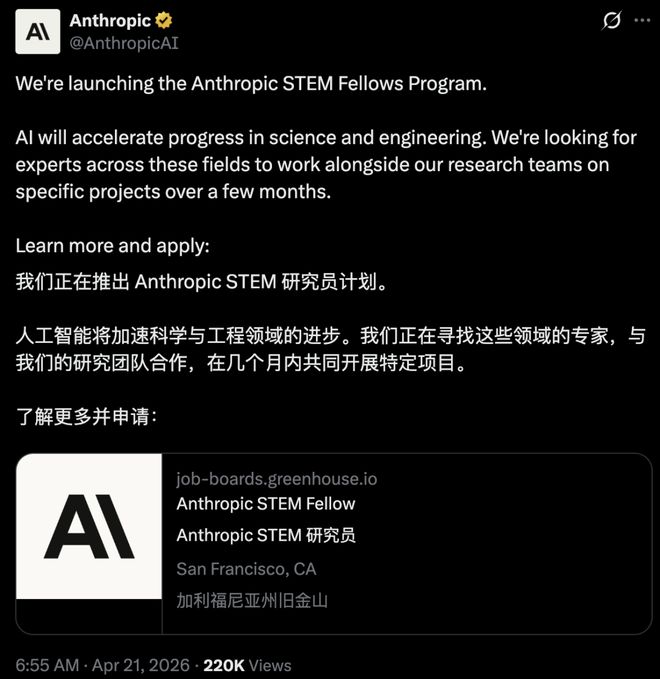

近日,Anthropic在其官方网站上发布了一个新的职位:STEM研究员(Fellow),面向科学、技术、工程和数学领域的人才开放申请。

在这份招聘启事中,Anthropic明确表示虽然拥有机器学习经验会有所帮助,但关键在于具备敏锐的科研判断力以及快速适应新环境的能力。

被录取的研究员需在旧金山等地点的Anthropic办公室内全职工作三个月,并享有每周3800美元的津贴。

研究人员将有机会使用前沿的Claude模型和内部评估工具,同时还能获得一位Anthropic研究员作为导师进行一对一指导,在合作期间完成具体的研究任务。

Anthropic在STEM Fellow职位描述中列举了两个研究案例:

一名材料科学家发现Claude在推理相稳定性时出现了错误,并设计了一套特定的评估流程来修复这个问题;

另一位气候学家将大气建模软件接入到Claude系统,开发出可以利用这些工具的工作环境。

所有的项目都必须在研究员计划期间内完成交付。

显然,Anthropic雇佣科学家并不是为了让他们使用Claude进行研究,而是希望借助他们的专业知识帮助纠正模型中的错误,并进一步提升其性能水平。

经过三年的时间,Anthropic的Fellowship项目已经从最初的AI安全研究员发展到了目前邀请STEM专家参与的方式。

Anthropic在这段时期内不断加大对科研的支持力度,每一步都比上一个阶段更为深入。

在第一代项目中,即2024年的AI Safety Fellows Program,主要招募的是传统意义上的AI安全研究人才,并通过提供资助和导师来支持外部技术专家参与对齐研究工作。

当时的重点在于确保Claude不会出现偏差行为。

第二代项目于2025年五月启动了名为“AI for Science Program”的计划,向科研机构的研究人员免费发放API额度,以支持生物和生命科学领域的高影响力项目。

该阶段着重解决了如何在保证模型安全的前提下将其应用于实际研究的问题。

目前的第三代则是正在招募中的STEM Fellow项目。

从最初的提供API信用额度到直接邀请科学家进入办公室,Anthropic逐渐将侧重点转向了让顶级专家参与模型能力打磨的过程。

第一代项目的目标是找到能够使Claude变得更安全的人才;

而到了第二代,则开始寻求那些能利用Claude进行科学研究的人员;

到现在第三代,Anthropic则希望找寻到可以指导Claude如何正确开展科学工作的专家。

STEM Fellow项目的核心在于让最优秀的科学家直接参与到模型能力提升的过程中来。

该项目旨在帮助研究员与Anthropic团队合作设计实验、评估模型性能以及分析其在长期科研任务中的表现情况。

近年来,Anthropic的一系列举措显示了他们正在有意识地构建一个支持科学发展的生态系统。

例如,在2026年3月上线的Science Blog中发布了一系列关于Claude参与科学计算和理论物理研究的文章;

这是共建层面的合作。

同时,他们还与美国能源部合作,成为了Genesis Mission的核心合作伙伴之一,并参与了跨行业、学术界以及政府层面的合作项目。

在这些行动背后隐藏着一个清晰的策略:

Anthropic正在系统性地构建自己的科研生态体系,每一步都是为这个长远目标服务的一环。

人们往往认为AI研发最大的瓶颈在于计算资源和工程师数量;

然而,Anthropic却认为最需要的是实验科学家。

这一观点在哈佛大学理论物理学教授Matthew Schwartz于2026年3月撰写的博客文章中得到了证实。

在该文中,他描述了一个实验:让Claude独立完成一项研究生水平的高能物理计算任务。结果表明使用AI可以极大地加速科研进度;

但同时他也指出了当前模型在科学领域的局限性。

Schwartz指出,尽管Claude表现出了强大的能力,但在准确性和可靠性方面仍然需要领域专家来进行验证。

而是「判断力」

在整个实验过程中,超过110个版本的迭代、近3600万字节的数据处理以及40多小时的本地计算时间表明了AI在科学应用中可能遇到的实际挑战。

尽管如此,Anthropic仍然坚信通过与顶尖科学家的合作能够进一步提升模型的能力。

Amodei的观点是:强大的AI至少可以将关键发现的速度提高十倍,在短短五到十年内完成未来五至一百年才能实现的生物医学进展;

这种看法促使了Anthropic向“虚拟生物学家”的目标迈进。

他认为生物学的进步并非一帆风顺,而是通过几次方法论上的突破得以跳跃式发展;

AI在这一过程中可能扮演着加速这种进步的重要角色。

速度快了10倍。

此外,AlphaFold成功解决蛋白质折叠问题的事实也证明了这条路径的可行性。

他举了个例子。

为了实现这个宏伟愿景,Anthropic已经采取了一系列措施来吸引和利用顶级专家资源;

例如STEM Fellow项目直接将学科判断力融入到了模型迭代流程中。

这种方式意味着未来的AI竞争不再仅仅依靠模型的规模或参数数量,而是取决于谁能够聚集更多的真正了解科学的专业人士;

而这正是Anthropic正在押注的方向。

其他公司如OpenAI和Google DeepMind也开始意识到这一趋势,并采取了类似的战略调整。

总之,在未来一段时间内,人工智能领域抢夺人才的战场将从计算机科学专业扩展到STEM乃至哲学、金融等领域。

由此可见,Anthropic正在通过一系列行动把“科学能力”作为自身的核心竞争力之一。

当前的大模型在理论物理上大约处于「二年级研究生」水平。

他同时给出了另一个更关键的判断:AI还没有做到端到端的自主科学研究。

现在回头看Anthropic STEM Fellow的岗位描述,一切都说得通了:

设计严格的、不容易被投机取巧绕过的评估方法,测试模型能不能在你的领域里规划实验、解读数据、推理机制。系统性地找出它「自信但错误」的地方。识别能力短板,创建有针对性的数据和技术来弥补。

也就是说,模型最危险的时刻,不是它说「我不知道」,而是它一本正经地给出一个看起来完全合理、但实际上是错的答案。

而能分辨这种「高置信度错误」的人,当然不是写代码的工程师,而是在各个领域摸爬滚打多年的专家。

所以,STEM Fellow的本质,是让科学家(或者各领域专家)帮AI补课,做它们的「高级审校」,用他们的判断力,去校准模型在科研场景中的输出质量。

换句话说,Anthropic缺的不是让模型「更聪明」的人,是能告诉模型「你这里错了」的人。

Amodei的执念和Anthropic的赌注

Anthropic招这批科学家,不是一时兴起。

往回翻一年,Dario Amodei在2024年10月发的那篇长文「Machines of Loving Grace」,就把这条路想清楚了。

https://www.darioamodei.com/essay/machines-of-loving-grace

这篇文章里,Amodei把AI应用场景排了个优先级。

生物学和医疗健康排第一,因为AI能把人类未来50到100年的生物医学进展压缩到5到10年内完成。更值得重视的,是他怎么定义AI在这件事里的角色。

Amodei认为AI应该是一位virtual biologist:

要能自己设计实验、指挥实验、发明新方法;要能像一个完整的人类生物学家一样独立执行研究流程。

这相当于把AI科学这件事,从提升效率升级成了「直接参与」。前者需要更强的模型,后者则需要会做科学的模型。

Amodei还给出了一套论证。

他认为生物学的历史进步并非平滑曲线,是几次方法学突破推动的跳跃。

CRISPR、基因组测序与合成、光遗传学、mRNA疫苗、CAR-T疗法,每一次都提供了一种新的可编程、可预测地测量与介入生物系统的能力。

而AI的潜在价值,是把这类突破的产出率再推高一个量级。

Amodei的判断是:强大的AI至少能将关键发现的速度提升10倍,让人类在5到10年内走完未来50到100年的生物学路程。

他认为:如果科学家更聪明、更善于在海量已有知识中发现连接,像CRISPR这样「藏在眼皮底下几十年」的突破还有数百个等着被挖出来。

AlphaFold解决蛋白质折叠问题的成功,已经在一个狭窄领域里证明了这条路走得通。

如果过去一百年生物学进步靠的是几个聪明的人偶尔想出一个新方法,那AI时代的设想是,这个「想出新方法」的过程本身可以被自动化。

正如Amodei在文章中判断的那样:AI要能执行、指挥、改进生物学家做的几乎所有事。

这与STEM Fellow岗位说明中提到目标也是一致的:我们正朝着AI科学家的方向努力。一种具备长程推理能力和实验判断力、足以推动科学前沿的系统。

这个愿景虽然宏大,但Anthropic依然认识到了自己距离这一目标的差距。

就在Science Blog的创刊文章里,Anthropic引用了菲尔兹奖得主Timothy Gowers的话:

我们似乎进入了一个短暂但令人愉快的时代,AI大大加速了我们的研究,但AI仍然需要我们。

Anthropic自己也承认,虽然模型在科研工作流的某些环节上已经表现出超越人类的能力,但它们也会编造结果、过度迎合用户,在领域从业者看来很基础的问题上卡住。

从囤GPU变成押注科学家

Anthropic正在把「科学能力」变成一种系统性的竞争壁垒。

其中STEM Fellow直接把学科判断力编入模型迭代流程。

比如,让材料学家来告诉Claude怎么理解晶体结构,气候学家来教Claude怎么调用大气模型,生物学家来检验Claude的实验设计是否合理。

这些东西,靠堆GPU和刷benchmark是搞不出来的。

如果这条路被证明有效,那么AI科研赛道的竞争规则可能发生一个根本性的变化:

最终的胜利者将不再取决于谁的模型更大,而取决于谁身边站着更多真正懂科学的人。

而这种顶级专家资源,你只能用一种方式获得:把他们请到你身边,与他们共同工作,让他们相信这件事值得投入。

这是Anthropic的赌注。

但不止Anthropic,也不止科学家。OpenAI在招前华尔街交易员优化金融推理,Google DeepMind把哲学家请进对齐团队,各家都在意识到同一件事:

下一阶段的AI竞争,拼的不是谁的参数多,而是谁能把最懂行的人类大脑编进自己的飞轮。

AI公司抢人的战场,已经从计算机系蔓延到STEM,再到哲学、金融……未来还会更远。

参考资料:

https://x.com/AnthropicAI/status/2046362119755727256

https://www.anthropic.com/careers/jobs/4493001008

https://www.anthropic.com/research/introducing-anthropic-science