机器之心发布

帕西尼日前宣布其“具身智能数据云商城”正式对外开放,该平台由帕西尼联合京东云、腾讯云和百度智能云共同打造。

通过与三家顶尖的云计算服务提供商合作,“具身智能数据绿洲”应运而生。

这一平台以强大的云端计算能力和海量高质全模态实采数据为基础,旨在为全球的具身智能研发、模型迭代及产业智能化升级注入新的动力,并解决“数据荒漠”的问题。

该平台独家提供具备82自由度的人类手部五指动作数据,同时融合30个六维触觉模组,构建了涵盖视觉、触觉、语言和行动的全模态闭环系统。

工业级精度的数据确保毫秒级别的准确性,可以直接用于训练出高成功率且具备良好泛化的控制模型与预训练基座。

该平台通过真机交互验证数据的有效性,并支持在多种机器人上进行端到端的算法训练和部署测试,真正跨越了仿真与现实之间的鸿沟。

借助帕西尼自行建设并完全可控的五大超级数据采集工厂集群,实现了标准化、规模化的数据采集处理流程,为大规模的数据基础设施提供了可靠保障。

- 用户可以通过全模态数据云商城官网获取相关信息:https://dataset-mall.paxini.com/

- 并且可以在全模态数据集官网上找到更多详情:https://omnisharingdb.paxini.com/

- 样例数据可从Hugging Face访问:https://huggingface.co/datasets/paxini/Omnisharing_DB_SampleData

- 最新研究成果发表在Arxiv上,论文链接为 https://arxiv.org/abs/2602.05325

该平台不仅是一个数据商城,还提供端到端的智能引擎服务。

“具身智能大模型”能够通过大量的实采数据来优化和完善其算法能力,在复杂任务中表现出卓越的操作成功率和跨场景适应性。

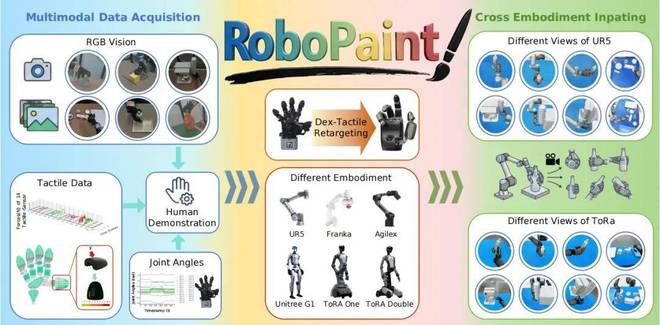

帕西尼与上海交通大学、浙江大学合作发表的最新论文《RoboPaint: 从人类演示到任意机器人和视角》验证了帕西尼采集的数据质量和应用效果,表明基于这些数据训练出的策略在多项任务中达到了行业领先水平。

在一项实验中,通过触觉感知重定向技术将人类手部状态映射至机器人灵巧手状态,在操作不同物体时的成功率高达84%;而在Isaac Sim环境中训练的模型也显示出极高的平均成功率(Pi0.5)。

这些学术成果表明,“以人为中心”的数据采集方案具有高度可扩展性和成本效益,对于训练机器人进行复杂精细操作而言几乎不会带来性能损失。

“数据飞轮”概念正在帕西尼的实践中逐步实现:通过“硬件采集—数据增长—模型优化—场景落地”的全栈闭环,不断推动自研大模型的能力边界,并加速具身智能从实验室迈向实际应用的步伐。

随着海量实采数据的持续注入,机器人在物理世界中的智能涌现时刻已不再遥远。帕西尼的数据云商城为全球范围内的具身智能研发提供了强有力的支持,正在推动这一技术领域进入“倍速”进化的新时代。

帕西尼通过端到端的云端闭环服务,将数据服务从 “选购” 到 “使用” 的周期从数周压缩至分钟级,让开发者真正聚焦于模型创新。

帕西尼全模态具身智能数据云商城一站式便捷采购

数据质量高:全模态、高维度、可跨本体,全面提升模型泛化能力

基于自研高精度 6D 霍尔阵列式触觉传感技术,帕西尼打造了全球唯一具备高一致性物理交互数据获取能力的柔性力学传感器,并以此为核心,自研了整手全域触觉采集终端 PXCap,配合空间视觉矩阵,共同构建了全球首个 “以人为中心”(Human-Centered) 的全模态具身智能数据采集体系

这一自研的数采体系所形成的坚实技术底座,保障了数据产品的高质量与高可用性,并由此重新定义了具身智能数据的行业标准:

全模态具身智能数据:通过整手无盲区触觉覆盖的数采设备 + 空间视觉矩阵 + Neural Mesh 多模态神经织网等自研软硬件一体化采集系统 PMEC,可从无损高保真采集包括高精度整手多维触觉、多视角视觉、关节角度、自体感知、语音、文本等全维度人类物理交互行为的具身智能数据,从而为具身智能体提供更丰富、更全面的环境信息,使其能够更精准地理解任务、感知世界。

独家 82 高自由度五指动作数据:帕西尼自主研发的 PXCap V,是全球首款实现全五指无盲区触觉覆盖的穿戴式数据采集设备。其内置 30 个六维触觉模组,触觉点数密度高达 3015 个,搭配全球最小型自研抗磁磁编码器,可同步采集 15 种维度的触觉感知信息及手部姿态、关节运动,轨迹重建精度行业领先,可完整还原人类在真实操作中的交互过程,可赋予具身智能体极高的物理一致性与精细度。

高效率、低成本:通过真人佩戴 PXCap 设备进行人类日常行为效率的高效采集,以 3~6 倍于传统遥操作的效率,捕捉了人类自然、流畅且连续的日常行为数据。这种方式不仅摆脱了对昂贵机器人本体的依赖,更保留了人类在长程任务中试探、纠错等隐性策略与连贯性。

可跨本体使用:由多个视觉角度所采集的基于人类最高维度的行为与环境数据,不仅支持任意视角的模型训练,极大提升 Sim-to-Real 部署的鲁棒性,更可直接用于高精度的三维场景与物体重建。结合 SomaRedirect 体感重定向技术,数据被解耦为通用的运动表征,实现了跨机器人构型的低成本迁移。

全模态数据 5 ms 内同步:实现了相机间硬件同步与多模态间算法同步的双重保障,将系统延迟控制在 5ms 以内,确保了 “视觉感知 - 触觉接触 - 物体位移” 在时间轴上的绝对对齐,有效避免了因传感器时滞导致模型学习到错误的因果关联,为高精度的策略学习奠定了坚实基础。

科学化的场景设计:通过系统化的场景变量控制策略(Controlled Variables),不仅覆盖了刚体、柔性体(如织物)、透明 / 高反光体等物理对象 ,更对光照、背景干扰、物体位姿及抓握轨迹进行了多维度的随机化与对抗性设计,从而真正具备在非结构化真实环境中处理长序列任务的强泛化能力。

严苛的数据质量生命线:建立了一套标准化的全生命周期闭环管理系统,极大降低了数据清洗的成本,确保了数据的一致性与高质量,让算法工程师可专注于模型本身的迭代。

正是基于帕西尼这些核心技术与超高标准,由 Super EID Factory 所生产的亿级规模全模态具身智能数据集产品 OmniSharing DB于 2025 年 8 月在北京国际大数据交易所成功上架,并获得了官方出具的 “数据质量高,可直接使用” 的A 级数据质量标准评价,这也是国内具身智能数据产品首次获得此类权威认证。

数据体量全球最大:五大自有工厂、百亿级实采数据,从 “数据荒漠” 到 “富庶商城”

继 2025 年 6 月于天津落成全球首个全模态超级数据采集工厂后,帕西尼已累计采集数千万条高质量全模态数据。今年,帕西尼再建四座数采工厂,形成辐射华北、华东、华中、西南、华南的五大超级数据采集工厂战略纵深产业集群,以十万平实景基地、“百亿级” 实采数据,从源头破解了这一难题。

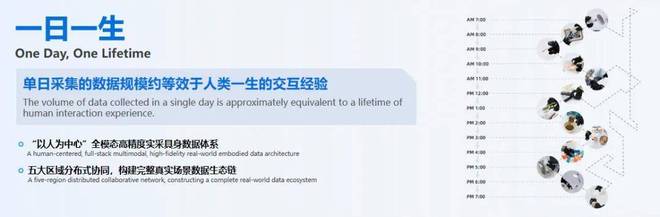

结合“in-the-wild” 理念,帕西尼可在全国五大地区采集更贴近真实生活与产业场景的数据。而依托全球首创的 “以人为中心” 数采体系优势,五大数采工厂单日的数据产出即可等效于人类一生的交互经验,日后,帕西尼也将以“一日一生” 的数采效率,源源不断地向数据云商城输送驱动具身智能泛化落地与规模应用的可靠 “燃料库”,推动具身智能从 “数据荒漠” 走向数据 “富庶” 时代

灵活供给模式:“通用场景 + 定制化” 并行,覆盖全场景数据需求

不同客户处于不同的研发阶段,对数据的需求千差万别。依托天津数采工厂标准化采集与其余四厂 “in the wild” 实采能力,可为帕西尼的全模态数据云商城提供“通用场景 + 定制化场景” 的数据服务,兼顾规模化效率生产与客户的个性化需求。

场景数据集:覆盖海量元动作与家庭生活、3C 制造、汽车装配、物流分拣、餐饮服务、医疗护理等 15 大核心领域的长序列场景,包含数千万条标准化、高质量的全模态数据,企业及科研机构可即买即用,快速启动模型训练。

定制化数据服务:针对客户的特定场景与任务需求,不仅支持定制化场景搭建与数据采集,更可结合全国五大工厂的地区产业特色与生活场景,践行 “in-the-wild” 理念。通过在真实、非结构化的生产与生活环境中进行实地采集,为模型注入高鲁棒性的真实数据,助力具身智能攻克复杂环境下的泛化难题。

目前,帕西尼数据云商城已上架 100+ SKU 的海量数据,并持续更新拓展,不断为具身智能大模型提供 “强泛化” 燃料。

效果验证:从实验室到真实场景,具身泛化开启 “倍速” 进化

高质量数据不是终点,让模型具备超强的泛化能力,让机器人真正学会 “像人一样干活” 才是核心目标。

帕西尼不仅在学术端印证了数据的有效性,更将商城数据直接注入自研的OmniVTLA 通用具身大模型,并部署于TORA 系列人形机器人进行实战测试。实测显示,模型在复杂任务中的操作成功率与跨场景适应性均达到行业领先水平。

学术前瞻验证

在帕西尼与上海交通大学、浙江大学联合发表的最新论文《RoboPaint: From Human Demonstration to Any Robot and Any View》中,便对帕西尼所采集的数据质量与效果进行了验证:

帕西尼提出了一种触觉感知重定向方法,通过几何与力引导优化,将人类手部状态映射至机器人灵巧手状态。实验表明:重定向的灵巧手轨迹在 10 种不同物体操作任务中成功率达 84%;

在逼真 Isaac Sim 环境中渲染重定向的机器人轨迹,构建机器人训练数据,仅基于帕西尼生成的数据所训练的 VLA 策略(Pi0.5)在三种代表性任务(即抓取与放置、推拉与倾倒)中平均成功率可达 80%。

学术成果有力证明:帕西尼“以人为中心” 的数采方案是一种可扩展且成本效益极高的数采方案,其方案下所采集的带有触觉模态的全模态数据,对于训练机器人复杂精细操作而言,其性能损失极小。此项学术验证体现出帕西尼所生产的数据集具有极高的实用价值。

*RoboPaint 数据流程:该数据流程能够基于从人类演示中采集的多模态数据 “绘制” 给具身智能体进行学习。通过 Dex-Tactile 重定向方法,能够有效解决人机之间的跨具身性问题。

以数据飞轮加速具身进化

帕西尼已构建起 一座“数据飞轮”:通过“硬件采集 → 数据增长 → 模型优化 → 场景落地” 的全栈闭环,每一条来自真实物理世界的实采数据都在反哺模型进化。伴随云商城海量实采数据的持续注入,帕西尼自研的 OmniVTLA 大模型在物理交互、精细操控与真实场景泛化方面的能力上限被不断拉升,赋予机器人类人化的精准操作与自适应决策能力。

这一飞轮效应也正在加速兑现:从药店取药结账到家庭收纳喂猫,从餐厅收台到办公整理。这些曾经难以触达的复杂长程任务,如今在百亿级实采数据的灌溉下,正从实验室测试加速转化为落地场景。数据越多,模型越强;模型越强,场景越广 —— 具身智能的 “倍速” 进化,已然开启

赋能千行百业:加速 “智能涌现” 时刻的到来

在智能体从 “数字世界” 跨越到 “物理世界” 的关键节点,全模态交互数据 —— 尤其是高精度触觉感知数据 —— 是连接虚拟与现实的重要桥梁。

帕西尼与京东云、腾讯云、百度智能云联手构筑的,不仅是一个云商城,更是具身智能时代的 “数字底座”。对于高校与科研机构,它提供了此前难以触及的大规模、高质量、全模态的研究数据,降低了前沿探索的门槛;对于机器人公司与开发者,它意味着可以将有限资源从昂贵、重复的基础数据采集中解放出来,极大加速研发周期。

通过标准化采集、云端化服务、场景化交付,帕西尼正将曾经稀缺的具身数据转化为像 “电力” 一样触手可及的工业资源,为全球具身智能的泛化能力跃迁提供核心支撑。

机器人在物理世界的智能涌现时刻,已加速到来。