近日,腾讯混元团队开源了一款名为Hy-MT1.5-1.8B-1.25bit的翻译模型。

近日,腾讯混元团队开源了一款名为Hy-MT1.5-1.8B-1.25bit的翻译模型。

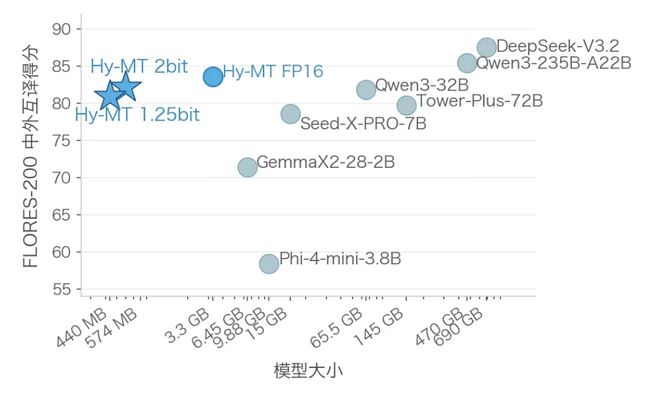

该模型体积仅0.4G,在手机上离线运行也能保证高质量的多语言互译功能,并且其性能超过了谷歌翻译。

原始版本拥有1.8B参数,腾讯混元团队通过量化压缩技术推出了两种不同方案以适应不同的设备:2-bit适用于中高端机型,而1.25-bit则面向所有手机用户。这两种方法使得模型体积分别缩小至574MB和440MB。

随着此次开源项目发布,腾讯混元团队还提供了一个名为Hy-MT的演示版软件,支持后台取词模式,即在不联网的情况下也能轻松完成翻译任务,保护用户隐私不受侵犯。目前该版本仅适用于安卓设备,后续将推出其他平台的支持。

▲开源项目主页

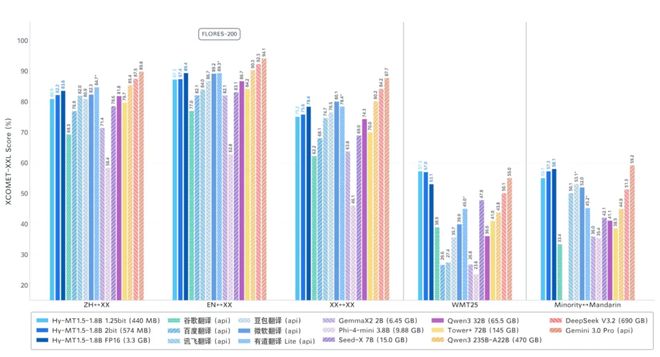

该模型在测试中展现了卓越的性能,其翻译质量可以与商业级API和大模型相媲美,并且在基准测试中超过了包括谷歌在内的众多主流系统的表现。

Hy-MT1.5原生支持33种语言及五种方言,共计超过一千个翻译方向。它涵盖了常见的中文、英文以及法语、日语等,还包括藏语和蒙古语等多种小众语言的互译服务。

为了适应手机内存限制,腾讯混元团队采用了量化压缩技术将模型参数从16-bit转换成更低位数表示形式,这就好比是把高清图片压缩成了缩略图大小,既保证了清晰度又大幅减少了存储空间需求。

实验表明,经过优化后的2-bit和1.25-bit模型不仅体积小且翻译效果出众,在支持Arm SME2技术的设备上,这些模型能够实现更快更高效的推理过程。

通过采用稀疏高效三值量化(Sherry)技术和为手机CPU设计的STQ内核,Hy-MT1.5实现了在后台长时间运行的能力。这项创新成果已经获得NLP顶级学术会议ACL的认可。

总结而言,腾讯混元团队此次开源轻量级翻译模型大大降低了离线翻译技术的应用门槛,为用户提供了更加便捷、安全的多语言互译体验。

其将模型里原本用16位数字(16-bit)表示的参数转用更低位数字储存。这就像把一幅高清照片压缩成缩略图,虽然文件小但还是能看清楚内容。

此外,针对不同的手机用户,腾讯还推出了2-bit与1.25-bit两种量化压缩方案。其实测显示,量化压缩后的两款模型表现效果远超同体积或更大体积大模型的翻译效果。

2-bit适用的中高端机型,模型体积压缩至574MB。

根据官方介绍,2-bit模型采用拉伸弹性量化(SEQ),将模型参数量化至{-1.5,-0.5,0.5,1.5},并结合量化感知蒸馏,在将模型体积压缩至574MB的同时,实现了几乎无损翻译质量,效果超越上百GB的大模型。在支持Arm SME2技术的移动设备上,2-bit模型能够实现更快速、更高效的推理。

1.25-bit模型适用全系机型,模型体积为440MB。

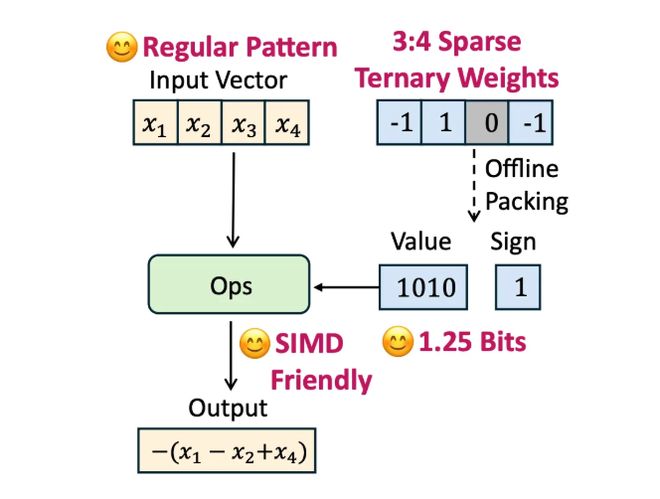

这一模型基于Sherry(稀疏高效三值量化)技术,其核心逻辑在于“细粒度稀疏”策略:每4个模型参数,3个最重要的用1-bit储存,1个用0储存,平均每个参数仅需1.25-bit。

此外,其还搭载了腾讯为手机CPU设计的STQ内核,适配SIMD指令集。这使得该模型能长时间在后台停留。Sherry技术方案已经被NLP顶级学术会议ACL 2026录用。

结语:腾讯混元拉低离线翻译普及门槛

AI翻译已成为手机、输入法、浏览器、会议、客服工具等各种工具的标配功能,但大多工具仍是联网调用云端API,离线能力弱、体验差、隐私风险高。

腾讯混元此次开源轻量化翻译模型,用几百MB级的体积实现了媲美云端大模型的翻译质量,或直接把高端离线翻译从云端特权拉到手机可普及的门槛。