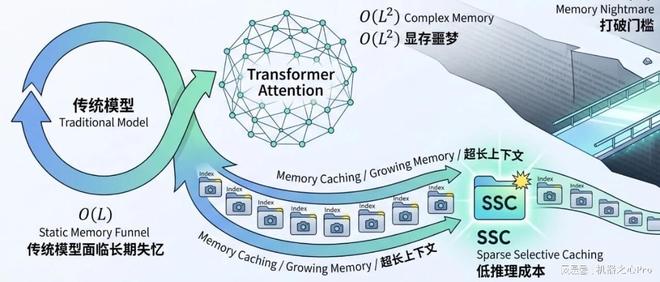

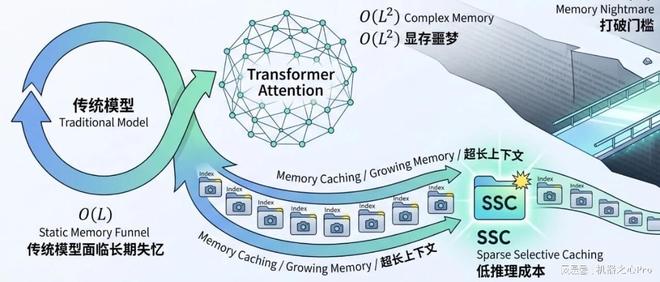

谷歌突破内存限制,融合Transformer与RNN技术,开启超长文本处理新时代

最近,谷歌与内存技术展开了新的较量。上个月,谷歌的研究项目 TurboQuant 曾引发行业震动,该研究声称能够大幅度压缩大模型中最消耗显存的 KV Cache,这一消息使得市场对内存需求产生担忧,并导致相关股票价格下滑。此后的学术界对此也进行了广泛的讨论和辩论。本周,谷歌又发布了一篇论文,在 AI 社区中引起了关注。这篇论文提出的方法解决了长文本处理中的“内存瓶颈”问题,但采用了与之前完全不同的

科技1 阅读

共找到 1 篇相关文章

最近,谷歌与内存技术展开了新的较量。上个月,谷歌的研究项目 TurboQuant 曾引发行业震动,该研究声称能够大幅度压缩大模型中最消耗显存的 KV Cache,这一消息使得市场对内存需求产生担忧,并导致相关股票价格下滑。此后的学术界对此也进行了广泛的讨论和辩论。本周,谷歌又发布了一篇论文,在 AI 社区中引起了关注。这篇论文提出的方法解决了长文本处理中的“内存瓶颈”问题,但采用了与之前完全不同的