千问APP发布了一个全新的全能型人工智能模型——Wan2.7。

这款应用的AI内容生成能力迎来了重大升级。

一款应用程序就能制作热门视频,现在的AI用户真是太厉害了。

基本上没有什么是这款工具做不到的。

这款全能型创作伙伴——Wan2.7,自上线以来就吸引了大量用户尝试。

一段视频可以让你更好地感受它的魅力:一群人在看到广告牌后感到非常震惊。

不卖关子了——

视频中的人物表情自然、动作流畅,并且完全符合预设的场景要求,真正实现了千人千面的效果。

此外,它还能自动生成匹配的声音效果和背景音乐,使得整个视频作品更加完整。

如果挑战更高难度的任务,比如将一张图片转化为一段视频,Wan2.7同样表现出色:

光影变化中,一位演奏家精彩地演绎了一场单人萨克斯演出。

接下来,在原有视频基础上添加一张尾帧图,并让女性演奏者加入:

视频中女性演奏者的形象自然流畅,与整个场景融为一体。

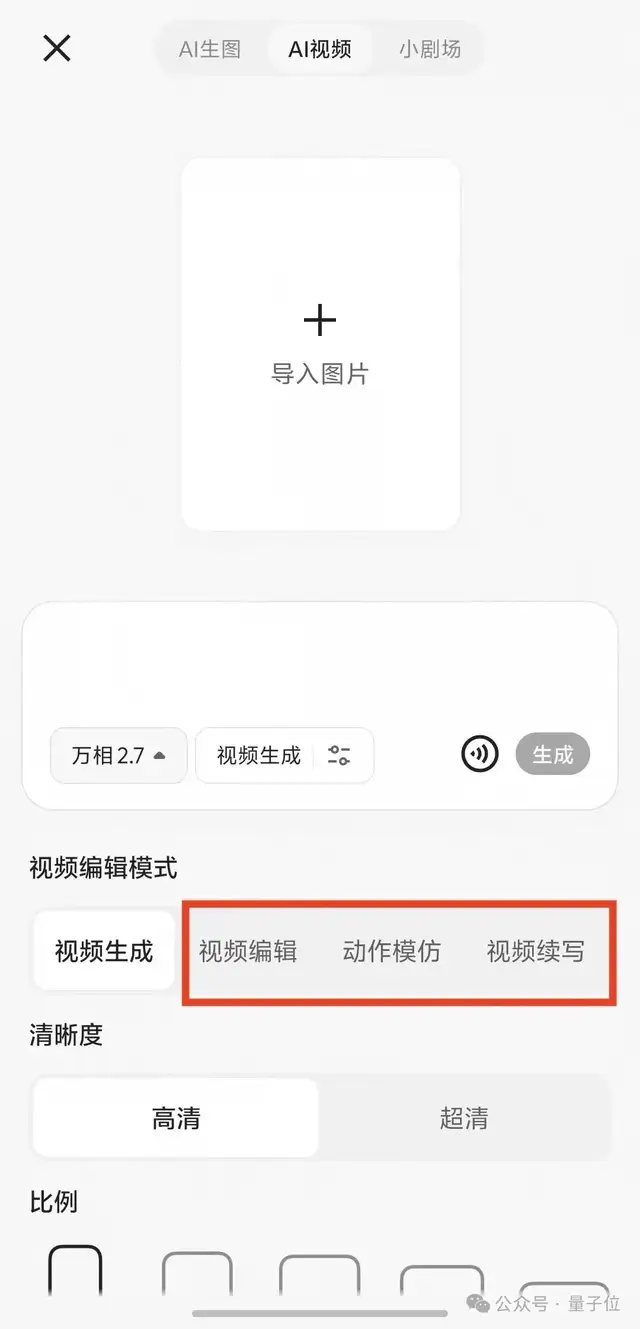

使用千问APP操作简单方便,只需上传生成的第一段视频和尾帧图片即可完成编辑。

以及一段音频:

不仅视频功能得到了全面提升,图像处理能力也有了显著增强。

无论是精确控制色彩还是支持超长文本输入,这款应用都让AI创作变得非常容易。

这次的Wan2.7-Image新增了“千人千面”的特性,在人物脸部自定义方面更加精细。

我们尝试复刻《哈利波特》中斯内普教授的形象:

一个面色蜡黄、鹰钩鼻、眼神冷漠的男人,身穿一件黑色长袍,背景为霍格沃茨的地窖。

这样的细节刻画几乎可以以假乱真,甚至可以看到人物的毛孔和皱纹。

效果是酱紫的:

左边是Gemini的结果,右边是ChatGPT的表现。可以看出,Gemini更接近电影版选角,而ChatGPT在某些特征上稍逊一筹。

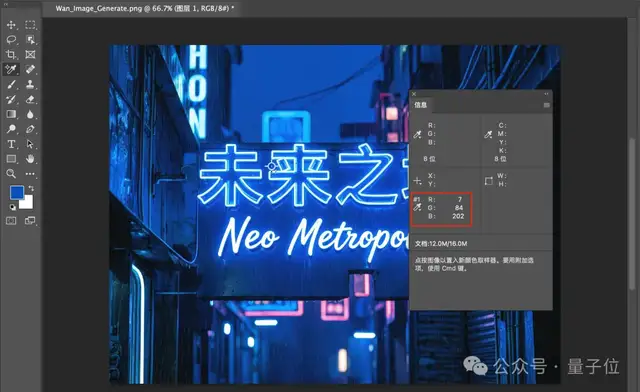

除了人物刻画,Wan2.7-Image还具备调色盘功能:

设计一张赛博朋克风格的深夜街道照片,画面主色调为蓝色,镜头焦点是一个霓虹灯招牌。

导入Photoshop后可以发现,色彩精确度和细节处理都非常出色。

而且Wan2.7-Image还能支持最高3K token的超长文字输入,保证了中英文双语文字渲染不会出现乱码问题。

在视频生成方面,这款应用同样提供了令人惊喜的功能:

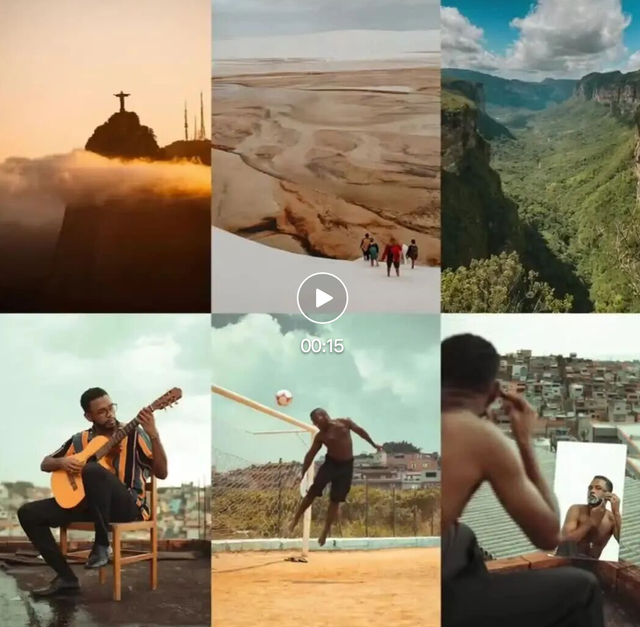

根据六宫格参考图生成一个巴西旅游Vlog。

通过这一系列操作可以感受到桑巴的热情。

如果对视频细节有进一步要求,还可以进行局部编辑:

先看图像生成。

将原视频中的胶片替换为盘子,并保持细节清晰可见。

这种精细的调整让视频更加生动有趣。

除了静态图片和视频编辑功能,Wan2.7还支持动作模仿:

比如尝试将一个角色的手势复制到另一个角色身上,并保持细节的连贯性。

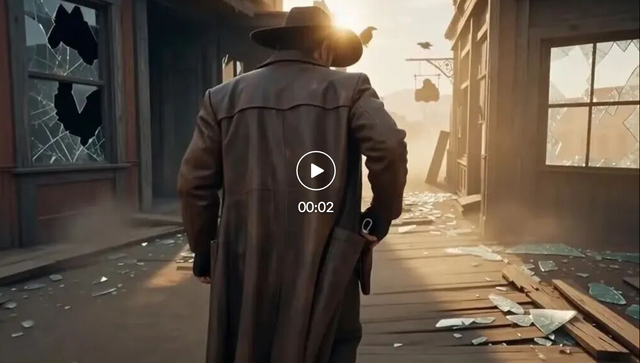

最后,体验一下拍摄好莱坞大片的感觉吧:

视频展现了各种特效和动作场面,令人印象深刻。

如果觉得不过瘾还可以继续延长战斗场景:

那么问题来了:视频中的男子为何如此惊恐?

经过实际测试,Wan2.7给我留下了深刻的印象——它真的非常棒!

现在,只需通过千问APP就能一站式完成视频续写和参考重塑工作,迅速提炼出爆款视频的关键元素。

无论是日常创意表达还是专业平面设计或影视制作,这款应用都能派上大用场。

而且其生成的人物演技毫不逊色于专业人士,足够真实、实用。

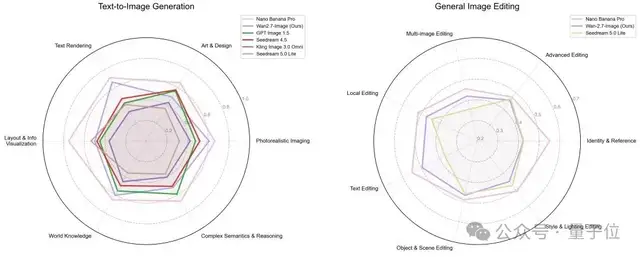

在一项人类偏好盲测评中,Wan2.7-Image的评分领先国内其他模型,甚至逼近了Nano Banana Pro的表现。

由此引发了一个核心问题:Wan2.7的发布意味着什么?

当我们放大到整个行业层面时,可以看到一个明显的趋势正在形成:

AI内容生成技术开始在中国市场快速崛起和发展。

硅谷那边的AI生成龙头Sora已经悄然退场,以OpenAI为首的科技巨头也开始从全面开花转向Agent和底层推理的战略性收缩。

而视频生成等高投入、慢回报的任务则被优先放弃。

与此同时,在中国市场却接连出现了多款高性能且功能全面的视频/图像生成模型。

其原因一方面在于中国拥有更完善的消费端场景,更适合AI内容生成技术的应用落地。

如何更高效地打通从AI到创作的“最后一公里”?阿里给出的答案是直接将最强模型装进APP里提供给用户使用。

这种做法源于阿里的市场洞察:技术领先只是大模型进入市场的通行证,真正的产品护城河在于如何让技术惠及更多人。

最近千问团队的一系列动作都体现了这一点——春节期间“千问办事”的能力出圈,现在又将Wan2.7下放到移动端,就是为了让更多用户第一时间享受到技术红利。

只要开始使用,就会发现AI创作其实并没有想象中那么难,即使对模型一窍不通也能通过最基础的功能按键和一句指令稳定创造出高质量的视频作品。

预计未来制作爆款视频和精美图像将变得像点外卖、刷视频一样简单,到那时才是真正开启了人人可以参与AI创作的大门。

尝试套到另一个角色身上:

让图片中的人物模仿视频中的人的手势动作,保持双手配合和手势变化过程清晰可见。

视频链接:https://mp.weixin.qq.com/s/hc0gyu23DeSn1EknMfhyHA

最后来玩个有意思的:拍好莱坞大片!

视频链接:https://mp.weixin.qq.com/s/hc0gyu23DeSn1EknMfhyHA

看不够,那就用视频续写延长战斗:

视频链接:https://mp.weixin.qq.com/s/hc0gyu23DeSn1EknMfhyHA

(无奖竞猜:男人为何如此惊恐?)

总之实测下来,Wan2.7给我最大的感受是——妙!

不仅仅可玩性大大提升,而且用起来还特别方便。

以前要创作一个视频,需要经过反复多次的修改剪辑,现在千问APP里就能一站式续写和参考重塑,迅速提炼出爆款视频的流量密码。

而且不只是日常的创意表达,专业的平面设计或者影视制作也能大用特用,就比如最近大热的AI演员、AI短剧,Wan2.7就能分得一杯羹。

而且演技还不输专业演员,够真实、够好用。

口说无凭,例如在人类偏好盲测评分中,Wan2.7-Image就位列国内生成模型第一,超过GPT Image 1.5,逼近Nano Banana Pro。

实力能打+人人可用,那么这里就引出一个核心问题——

Wan2.7的发布,究竟代表着什么?

触手可及的创作,让人人都能生产爆款

显然,这并非一句“千问团队实现技术突破”就能简单带过的。

当我们将目光放大至整个行业,就会发现一个愈加明显的趋势清晰可见:

AI内容生成正在加速进入中国时间。

先看硅谷这边,曾经的AI生成龙头Sora悄然退场,以OpenAI为首的科技巨头纷纷从全面开花,转向Agent和底层推理的战略性单点收缩。

而例如视频生成这类高投入、慢回报的支线任务则被率先抛弃。

但与之形成对比的,是国内市场陆续迸发出多款高性能且全面的视频/图像生成模型。

归根结底,一方面是因为国内拥有更完善的C端场景(如短视频、电商),更适配AI内容生成的商业化落地。

另一方面,中国厂商也更注重培养模型的工程应用能力,尝试以更行之有效的迭代速度和更低的成本,加快AI融入创作者的工作流。

那么如何更高效地打通AI到创作者的“最后一公里”呢?

依据多年深厚的用户场景积累,阿里的答案简单粗暴——直给。也就是直接将最强模型同步装进APP。

这源于阿里对市场的精准洞察:技术领先只是大模型的入场券,技术普惠才是产品真正的护城河。

细数阿里千问最近的动作,无一不在印证这点——春节期间“千问办事”的能力出圈,现在又将Wan2.7下放到移动端,就是为了让更多人能够第一时间享受到技术红利。

只要用户开始用了,就会发现AI创作这件事原来没有想象中那么难,即使是对模型一窍不通,也能通过最基础的功能按键和一句指令,稳定创造出高水准的视频。

可以预见的是,未来制作爆款视频和精美图像就会变得像点外卖、刷视频一样简单,到那一刻,才是真正打开了人人AI创作的大门。

鹭羽

鹭羽