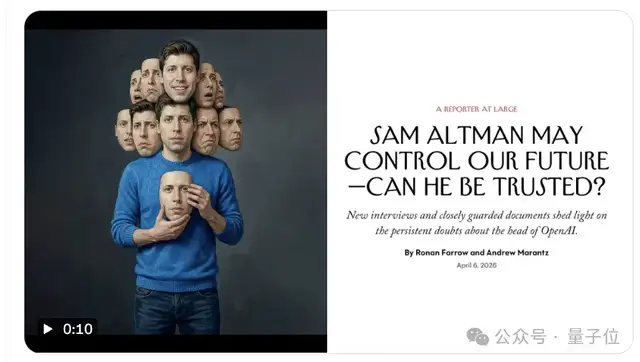

Ilya曝光了OpenAI内部绝密文件,长达70页。

llya 认为Sam Altman这个人惯于撒谎。

据悉,Ilya秘密拍摄并备份的OpenAI机密文件刚刚被披露。

Sam Altman撒谎成性(大声.jpg)。

《纽约客》近期报道了这一事件的详细情况,其中包含大量关于Altman不诚实行为的内容。

自OpenAI成立以来,从董事会成员到微软高级管理层,普遍认为奥特曼诚信不足。

在被解雇后的短短五天内,Altman在自家豪宅设立了一个应急指挥部,试图通过资本、员工支持以及舆论战来扭转局面。

- 宫斗事件结束后,奥特曼不仅没有改善自己的行为,反而进一步削弱了公司的安全承诺,并将SuperAlignment团队边缘化。

- 令人惊讶的是,Ilya与Sam Altman之间的恩怨再次浮出水面,引发了新一轮的关注和讨论。

- Ilya为何采取类似间谍手法来搜集Altman的不当行为证据?

- 这份备忘录的内容为何令董事会成员感到极度恐慌?(He was terrified)

读者可以准备一些零食,在接下来的故事中享受一场视觉盛宴。

Ilya曝光了70页OpenAI的秘密文件!

山姆·奥特曼,撒谎成性。

OpenAI从一开始就设定了极高的诚信标准。

该机密备忘录提到,自公司成立之初就注重安全和道德原则——非营利性质、董事会优先考虑人类福祉,甚至在极端情况下可以牺牲公司利益。

然而,事实证明这些高标准的要求并没有得到满足。特别是对于CEO的诚信要求更是如此。

Ilya认为Sam Altman不具备领导OpenAI所需的条件,并逐渐形成明确判断:“我不相信奥特曼能为OpenAI做出正确的决策。”

此后,Ilya采取了一系列非常规行动来收集证据,最终整理成一份系统化的70页文件并通过特殊方式传递给董事会。

一位收到这份材料的董事表示,看到这些揭露时感到极为震惊和恐惧。

在奥特曼被解雇后的五天内,各方势力迅速展开行动。从F1赛事现场到豪宅备战室,局势瞬息万变。

当年OpenAI内部权力斗争的具体细节在Ilya的备忘录中得到了详细的还原。

这场宫斗事件最初看起来像是一个荒诞的故事——奥特曼被突然解雇的消息来自一通电话,并且微软的投资人对此毫不知情。

奥特曼得知自己被解雇后立即在豪宅里建立了一个临时指挥部,意图扭转局势。

他迅速推动了三件事:冻结关键投资、联名信的传播以及舆论战的开展。

董事会保持沉默而奥特曼一方持续发声,最终迫使董事会不得不重新考虑奥特曼回归的可能性。

五天之后,局势明朗——奥特曼重回OpenAI,董事会则失去了影响力。

理由嘛——

在“小插曲”之后,安全承诺开始瓦解。

除了权力变动之外,“限制权力”的机制也开始松动。

首先受影响的是资源分配——公司曾承诺投入20%的算力用于长期研究,但实际执行时却大幅度缩水,并且使用的还是老旧设备。

当安全负责人Jan Leike对此提出质疑时,得到的回答是“这从一开始就是不现实的目标”。

安全保障机制逐渐失去真正的投入和实施力度。

其次,在产品发布流程中也出现了问题——一些高风险功能没有经过严格审查便被推出市场。

再者,正式监管文件与实际情况之间存在明显的不一致。

这些分散在不同阶段的负面评价到了OpenAI时期集中爆发。

董事会成员表示奥特曼不受事实约束,甚至有人认为他未来可能会被列为重大商业丑闻人物之一。

Anthropic CEO Dario Amodei也在笔记中记录了大量关于OpenAI和奥特曼本人的评价,并得出了与Ilya相似的结论——问题在于奥特曼自身而非公司系统。

Amodei甚至使用更为激烈的言辞来形容Altman,称其言论几乎可以确定是谎言。

尽管外界对他的批评众多且广泛,但Sam Altman本人却始终坚称无法改变自己的性格特征。(好牛的精神状态)

△图片由AI生成

在Ilya的备忘录中还提到了一个有趣的现象——OpenAI办公区内到处都是“Feel the AGI”的标语。

第一,资本施压。

该口号原本是Ilya用来警告同事关于AGI风险,但在权力斗争之后却变成了庆祝未来的标志。(这多少有点地狱级笑话了)

第二,员工站队。

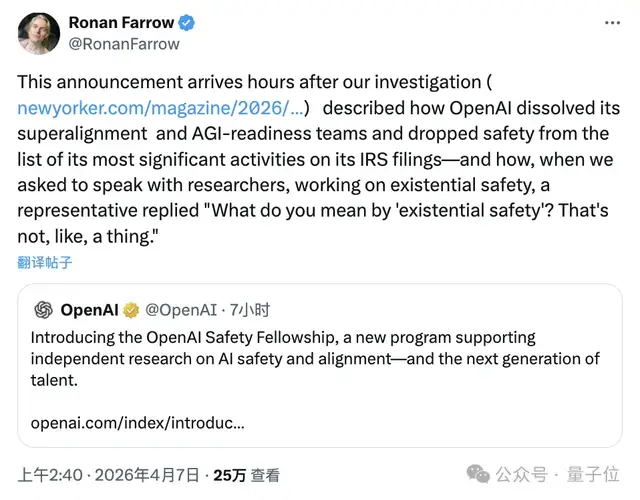

最近,《纽约客》记者试图采访一位研究AI生存风险的研究员时遭遇拒绝。OpenAI官方回应称“这种说法不存在”。

尽管如此,OpenAI还是在发布调查报告后不久推出了一项支持安全研究的新项目。(doge)

(llya:这下你们知道我说的都是实话了吧,奥特曼真是言行不一啊?)

结果嘛,就是Ilya最后也不得不松口:如果奥特曼不回来,公司可能会直接崩掉。

五天之后,结局落定—奥特曼回宫,董事会出局。

甚至,OpenAI内部员工还给这场硅谷史上最经典的宫斗反转,起了个名字——The Blip(意为“小插曲”或“短暂失常”)。

The Blip之后,安全承诺开始崩塌

The Blip结束后,OpenAI所发生的变化没有停在权力层面,那套用来“限制权力”的机制,开始逐步松动。

最先出问题的,是资源。

OpenAI曾对外承诺,会拿出20%的算力,用于长期安全研究,这是OpenAI当时最核心的安全底牌。

但实际执行,很快变了味儿——算力占比一路下滑到1%-2%,分到的还是最老的集群、最差的芯片。

当负责人Jan Leike提出异议时,得到的回应是:这件事从一开始就不现实。

从优先事项,变成象征性存在,安全开始失去真正的投入。

第二步,就是流程开始被绕开。

在OpenAI里,原本涉及高风险能力的发布,正常应该需要经过安全委员会审核。

但在后续产品迭代中,一些争议最大的功能都没有走完整审批流程就直接上线,甚至连地区版本的产品,也在安全评估尚未完成的情况下发布。

(流程不流程的,似乎也没那么重要了…)

第三步,是调查失去约束力。

事实上董事会风波之后,OpenAI请来了一家参与过多起公司丑闻调查的律所“WilmerHale”做独立调查。

按这家律所的正常工作流程和外界普遍预期来说,OpenAI的事情会有一份正式、可追溯的书面报告。

但最终的结果是——没有报告。(doge)

调查结论,只以口头形式汇报给新董事会,而不写报告的建议,恰恰来自奥特曼参与选择的董事的私人律师。

三件事儿——先削资源,再松流程,最后弱化调查。

看起来每一步都是轻微调整,但是吧,当系统可以绕过限制,限制本身也就不再存在了。

20年前就有人看透了山姆·奥特曼?

u1s1,围绕奥特曼好的坏的一箩筐评价,并不是在OpenAI才出现的。

事实上跨越20年、横跨多个组织,对奥特曼的核心评价惊人一致,那就是——

这小子,嘴里忒没实话,干事儿忒不着边儿。(doge)

最早的一次,可以追溯到2013年。

当时已故的天才程序员Aaron Swartz,在私下对朋友留下过一句对奥特曼非常极端判断:

你必须明白,奥特曼这个人永远不值得信任,他是个反社会人格的人,为了目的什么都做得出来。

他第一次创业阶段,问题已经出现。

公司内部员工曾两次推动董事会撤换他,甚至需要投资人亲自下场,在公司里盯着他。

到了后来,当他开始进入更核心的创业与投资圈层,问题开始升级——

从内部矛盾,变成信任危机。

内部有人后来直接承认,奥特曼一直在隐瞒事情,比如对外公告不断修改说法, 职位描述一改再改,甚至最后干脆删除等等。

但在正式的监管文件里,他依然被标注在原来的位置上??

换句话说就是表面在变化,实际关系却没有同步调整。

这些分散在不同阶段的口碑,到了OpenAI,开始集中爆发——

董事会成员给出的评价是:他不受事实的约束,甚至奥特曼还被大家形容为,对欺骗可能带来的后果缺乏基本顾虑。

而另一位高管给出的说法是:他未来,有可能会被放进那些重大商业丑闻人物的序列中被讨论。

喜欢写日记的不正经人还有一个,后来成为Anthropic CEO的Dario Amodei也留下了200多页笔记内容,笔记中包含大量对于OpenAI和奥特曼本人的评价。

尽管和llya算不上啥关系多好的朋友,但是吧,人家和Ilya得出了同一个结论——

那就是OpenAI内部出现的一箩筐问题不在公司系统本身,而是奥特曼本人有问题。

甚至,Amodei的措辞更为激烈,对奥特曼的评价是——他说的话几乎可以确定是胡扯!!!

咋说呢,来源不同、阶段不同,但指向高度一致。

更微妙的是,别看差评如此之多,架不住奥特曼自己的腰板直,在被质疑时,人家奥特曼只是说:

不好意思哈,我无法改变我的性格~(好牛的精神状态)

最后颇值得一提的是,在llya的70页机密备忘录中,还有个蛮值得一瞧的事情,那就是——

在OpenAI的办公区里,”Feel the AGI”的标语随处可见。

这句话最早是Ilya用来警告同事AGI风险的,但是吧,The Blip宫变事件之后,变成了庆祝未来的口号。

(这多少有点地狱级笑话了啊,llya:我???)

OMT

家人们,这瓜还没完。

就在刚刚,曝光此备忘录的《纽约客》记者在x上表示,当他们想采访“研究AI生存风险”的研究员时,OpenAI官方回应是:

你说的存在性安全是啥?这东西压根不存在哈~

但是吧,还得是OpenAI,说归说,做归做,这是两码事儿:

就在这篇调查报告发布几个小时后, OpenAI刚巧推出了支持安全研究的项目。(doge)

还得是OpenAI,还得是奥特曼。

(llya:这下你们知道我说的都是实话了吧,这奥特曼是真说一套做一套啊??)

梦瑶

梦瑶