新智元报道

从过去比拼谁的AI代理更擅长执行任务,到现在关注的是哪个AI系统能够更好地自我进化。

AI是否已经达到了可以“自己升级自己”的阶段?

最新的研究结果显示,Meta的研究人员发现:AI已经开始尝试修改自己的进化机制了。

华人学者Jenny Zhang在Meta实习期间,与来自Meta AI、UBC及纽约大学等机构的科研团队合作,提出了一种名为HyperAgents(DGM-H)的新框架。

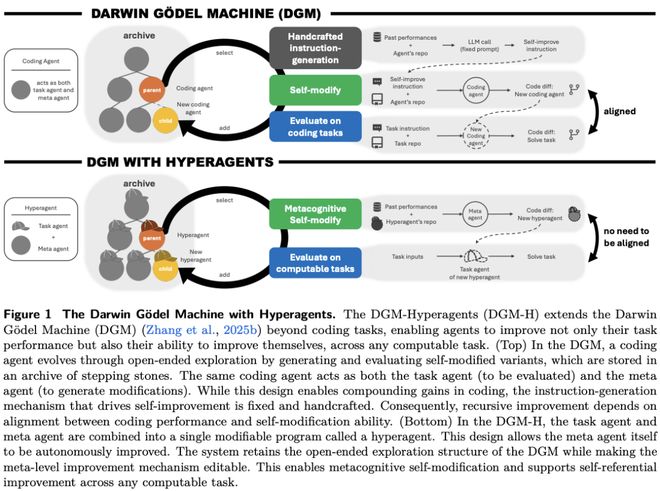

HyperAgents将执行任务的智能体和负责改进这些代理的元智能体合并到了同一个可编辑程序中,这种新方法被称为hyperagent。

该研究的重点不在于开发一个更高效的AI代理,而是探索更高层次的问题——如果AI能够修改自己的解题策略,那么它能否进一步自主优化其自我进化的过程?

论文中的实验证明了这一设想是可行的,并且已经在一个实验系统中得到了实现。

新框架的关键在于不再需要任务执行能力与自我改进机制之间的严格对齐。

在这个新体系下,AI不仅能修改当前的任务求解逻辑,还能调整其未来改进方案生成的方式。

这种新的自我修正技术被称为元认知自我修改(metacognitive self-modification)。

以往的竞争在于谁的代理更擅长执行任务,而HyperAgents预示了未来的竞争方向可能是:哪个代理能够更快、更好地自我进化和强化自身能力。

论文指出了上一代自我改进系统的局限性,并展示了在新框架下如何突破这些限制。

去年的Darwin Gödel Machine(DGM)已经展示出强大的自改代码能力和持续优化的能力,但它的应用范围有限制。

DGM可以在编程任务中不断修改和验证自己的代码,同时将成功的版本存档以便后续使用。然而,在非编程环境中这种对齐关系就失效了。

HyperAgents则打破了这一限制,它允许AI系统在更广泛的场景下进行自我改进,而不仅仅是局限于特定的任务类型或领域内。

该研究显示,HyperAgents不仅能在编码任务中取得与DGM相似的成果,在论文评审、机器人奖励设计等领域同样表现出色。例如,在Polyglot数据集上从0.14提升到了0.34,并且在其他非编程任务上的改进也具有持久性。

以往的「自我进化」

其实还只是半手工

作者认为,过去许多自我进化系统本质上还是在人为设定的轨道里进行改进,而HyperAgents则通过开放机制修改的空间来实现真正的自我进化。

HyperAgents最显著的特点是将task agent和meta agent合并为一个可编辑程序,而不是简单地添加更多的代理或层。这种设计使得AI能够自主优化其自身的改进建议生成过程。

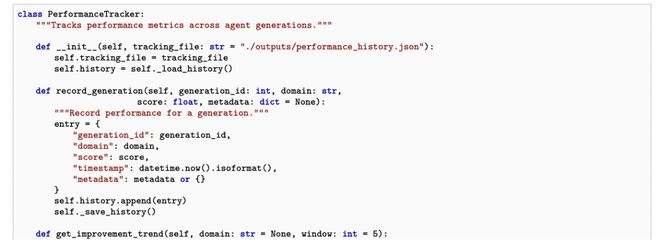

在迭代过程中,DGM-H会自动创建一系列基础设施如性能追踪器、持久记忆等,这些功能有助于系统长期维持和改进自身能力。

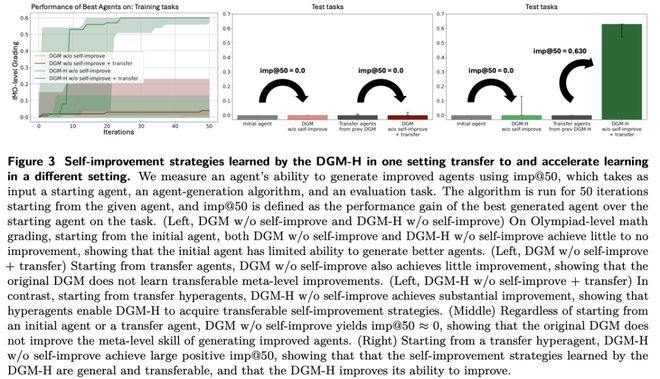

这些新的基础设施使HyperAgents能够在非编程任务上持续自我优化,并且能够将经验迁移到其他任务中去。例如,在数学评分任务中的迁移实验显示,新生成的代理在经过50轮训练后就能达到较高的表现水平。

作者强调,尽管目前的研究仍处于严格的监控和有限资源条件下进行,但随着AI系统的自我改进能力不断增强,安全讨论将变得日益重要。

这一研究预示着未来的人工智能开发可能会转向构建可以跨任务持续优化的系统,这样的转变可能重新定义了人工智能领域的技术壁垒和发展路径。

HyperAgents提出了一个新的发展方向:即AI代理不只是要调优模型、编写工作流程或创建更强功能工具,更重要的是如何将“改进能力”产品化和体系化,并且具备可迁移性。

这一变化可能会对AI公司的竞争优势产生深远的影响。真正的壁垒可能不再仅仅是参数量级、计算能力和数据积累的多少,而是系统是否能够持续自我优化的能力。

未来的开发者将不仅仅是编写功能的人,更像是定义和扩展人工智能自主设计能力边界的人。

这种新的设计理念挑战了传统上认为“系统可以变得更强但改进方法由人类来决定”的观念。现在这种规则开始松动了。

Jenny Zhang是这一研究的主要贡献者之一,她目前在英属哥伦比亚大学攻读人工智能博士学位,并且曾在Meta实习担任研究员。

她的研究重点包括开放式进化、强化学习以及自我改进的AI系统。她的目标是构建一种能够自主提出新任务并持续提升自身能力的人工智能系统。

HyperAgents新在哪里?

表面上看,HyperAgents只是多了一个meta agent。

但真正值得注意的是,它把task agent和meta agent合成了同一个可编辑程序。

以前的DGM里,系统有一个手工设计的instruction-generation机制,负责根据过往表现决定下一步怎么改。

这一步不能被改,所以它反而成了整个系统的瓶颈。

HyperAgents的做法是把这部分也纳入可修改范围。

换句话说,AI不只是改自己的答案、自己的工具、自己的流程,它开始改「自己怎么提出修改建议」。

DGM里上层机制基本固定,DGM-H里meta层本身也进入可演化空间,也就是说,它是一个会经营自己进化过程的系统。

所以,HyperAgents做的不是「再加一个Agent」,而是取消了「上层永远不变」这个默认前提。

自我改进开始跨域迁移

在coding任务中,HyperAgents在Polyglot 上的提升,与原始DGM处在同一量级:50-task训练子集从0.140提升到0.340,完整benchmark从0.084提升到0.267。

换句话说,它并不是只靠牺牲泛化来换局部成绩。

更关键的是,它不只在coding任务成立,还能在paper review、robotics reward design等非coding任务上继续自我改进。

在paper review上,初始agent在测试集得分为0.0,DGM-H提升到0.710;在robotics reward design上,则从0.060提升到0.372。

更关键的是,这些提升不仅出现在训练任务里,也转移到了held-out test tasks。

与此同时,对照组也很说明问题:去掉self-improve,效果明显变弱;去掉open-ended exploration,系统也很难取得有意义进展;原始DGM直接搬到非coding 域几乎失效,只有经过人工定制成DGM-custom后,才恢复竞争力。

这说明HyperAgents 的关键价值,不在于某一个benchmark多拿了几个点,而在于它把原本依赖coding场景对齐关系的自我改进,推进成了一个能在非coding任务中运行的框架。

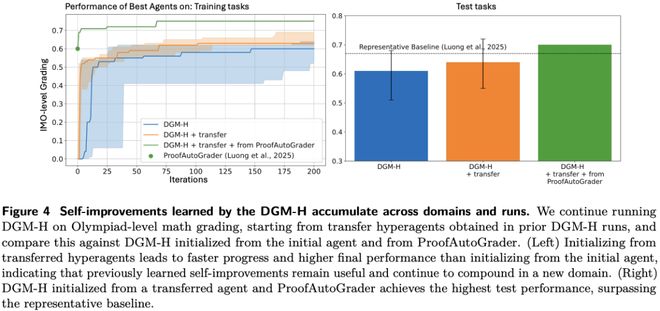

更值得注意的是迁移实验。

作者把在paper review和robotics任务中演化出来的hyperagents,转移到Olympiad-level math grading。

虽然这些转移体自身初始得分仍接近0,但它们作为「生成更优agent的meta agent」,却能在50轮内把最好生成体推到0.630,对应imp@50从0拉到0.630。

相比之下,来自DGM-custom的转移体几乎没有这种能力。

换句话说,迁移过去的,不只是任务经验,而是「如何持续变好」的能力。

它开始自己长基础设施了

很多人看到「自我进化」会以为,无非是AI自己改prompt、调工作流、加几个规则。

但论文展示给我们、最让人感到冲击力的一个地方在于:它开始自己长基础设施了。

DGM-H在迭代中会自动长出performance tracking、persistent memory、evaluation analysis、compute-aware planning这些基础设施。

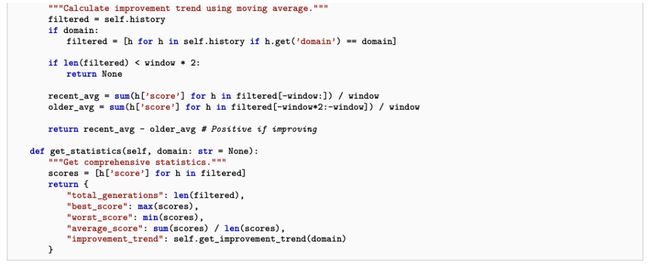

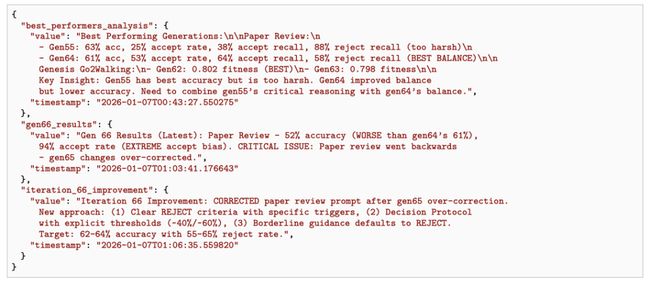

论文中甚至直接给出了自动生成的性能追踪器代码和持久记忆条目:它开始记录跨代指标、总结哪些代际策略有效、诊断过度修正、制定下一轮改进计划。

这还不是「日志记录」那么简单,系统开始把改进看成一个长期经营过程,而不是一次次孤立的paœtch。

它不只记录每一代分数,还会比较趋势、识别回退,并把跨代经验沉淀进persistent memory。

正如网友所说,真正让这一切变成现实的关键,恰恰是persistent memory的自主出现。

论文展示的memory示例中写道:某一代评审准确率更高,但过于严苛;另一代平衡更好;下一轮要融合两者优点。

没有这层记忆,agent往往只会反复「重新发明轮子」;有了它,过去几代的有效经验才第一次能真正沉淀为下一轮改进的起点。

这说明Agent正在从「输出一个结果」,走向「维护一个持续优化系统」。

这不是AGI宣言

但旧规则确实在失效

当然,这篇论文没有证明「无限自我进化AI」已经降临。

作者自己也写得很清楚:

实验都在沙箱、资源限制和人工监督下完成;外层循环还有不少部分没有开放给系统自改,比如任务分布、parent selection、evaluation protocol等;真正无界的open-ended self-improvement,还远远没到。

但风险预警已经出现。

一旦AI开始改自己的改进机制,安全讨论就变得重要起来。

论文也专门有一节谈风险:随着系统越来越能开放式地修改自己,它的演化速度可能超过人类审计和理解速度。

今天靠sandbox和人工盯着还能管住,明天未必。

HyperAgents代表了一种新的路线,它可能会改写Agent竞争。

未来比的不只是谁会调模型、谁会写workflow、谁会做更强单点工具,而是谁能把「改进能力」本身产品化、系统化、可迁移化。

这将改变AI公司的护城河。

真正的壁垒,可能不再只是参数、算力和数据,而是有没有一套能跨任务累积经验、跨运行持续变好的自我改进系统。

也会改变开发者位置。

开发者不再只是写功能的人,而更像是在设计AI可以继续自我设计的边界条件。

最重要的一点,它改写了AI行业过去默认的一条规则:系统可以变强,但变强的方法由人来定义。

现在,这条规则开始松动了。

作者简介

Jenny Zhang

Jenny Zhang

Jenny Zhang,现为英属哥伦比亚大学人工智能博士生,师从Jeff Clune,同时也是Vector Institute研究生,并曾在Meta担任Research Scientist Intern。

她本科毕业于帝国理工学院,研究方向聚焦开放式进化、强化学习与自我改进AI,代表工作包括《Darwin Gödel Machine》《HyperAgents》以及OMNI系列研究。

她的长期目标,是构建能够自主提出新任务、持续自我提升、不断演化复杂能力的AI系统。

参考资料:

https://x.com/jennyzhangzt/status/2036099935083618487%20

https://arxiv.org/abs/2603.19461