聪明的人知道何时应当休息。

作者|汤一涛

Anthropic 在 2026 年 3 月 31 日因一次打包错误,导致 Claude Code 的源代码被意外发布到了公共 npm 存储库中。仅几个小时后,这段代码就被复制到 GitHub 上,并且再也无法撤回。

泄露的内容广泛而丰富,既吸引了安全研究人员的关注也引起了竞争对手的兴趣。其中有一个功能名称引发了业界的广泛关注——autoDream(自动梦境)。

autoDream 是一个名为 KAIROS 的后台持续运行系统的组件之一,KAIROS 在古希腊语中意为“恰当时刻”。

当用户工作时,KAIROS 会持续观察并记录相关数据。到了晚上,当用户关闭电脑后,autoDream 就启动了,它会对白天积累的信息进行整理、优化,并清除矛盾之处。

KAIROS 和 autoDream 构成了一套完整的运行周期,彼此之间互为补充——Anthropic 的工程师们似乎在为 AI 设定一种类似于人类的“睡眠-觉醒”模式。

近两年来,人工智能领域最热门的话题之一是关于自主代理(Agent),它们被认为可以无休止地工作,并被视为优于人类的核心优势。

然而,即使是最深入研究自主代理技术的公司,也为其 AI 设置了休息时间。

为什么?

01

永不停机的代价

不间断运行的人工智能最终会遇到瓶颈。

每个大型语言模型都有一个“上下文窗口”,即同一时间内能够处理的信息量存在物理限制。当代理持续运行时,项目历史、用户偏好和对话记录不断累积,超过临界点后,模型可能会开始遗忘早期指令并出现前后矛盾的情况。

这种现象被技术社区称为“上下文退化”。

许多解决方案尝试将所有历史数据塞入上下文窗口中,然而实际效果却常常适得其反——信息越多,表现越差。

人类大脑同样面临着类似的挑战。

在白天经历的一切会迅速被写入“海马体”,这是一个容量有限的临时存储区域。长期记忆则存放在“新皮层”中,这是一块容量更大的地方,但信息写入速度较慢。

人类睡眠的主要任务是清空满载的临时存储区,并将有用的信息转移到更持久的记忆库中。

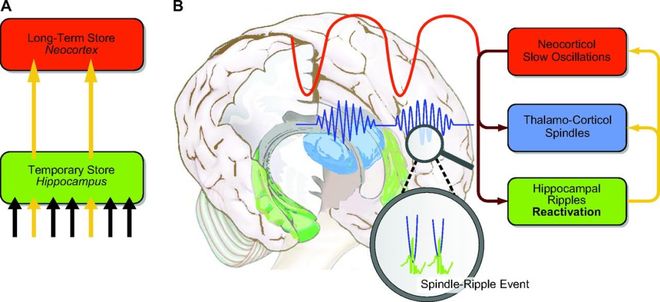

瑞士苏黎世大学神经科学中心的研究团队认为这个过程叫做“主动系统巩固”。

持续剥夺睡眠会导致大脑效率降低,记忆力受损,注意力分散,最终导致基本判断力的崩溃。

自然选择对低效行为极其严苛,然而睡眠并未被淘汰。从果蝇到鲸鱼,几乎所有有神经系统的生物都会睡觉。海豚甚至进化出了左右脑轮流休息的独特方式——宁愿发明一种全新的睡法也不放弃睡眠本身。

在池底休息的虎鲸、白鲸和宽吻海豚 | 图片

生物系统面对的是同样的限制:即时处理能力有限,但历史经验却在不断增长。

02

两份答卷

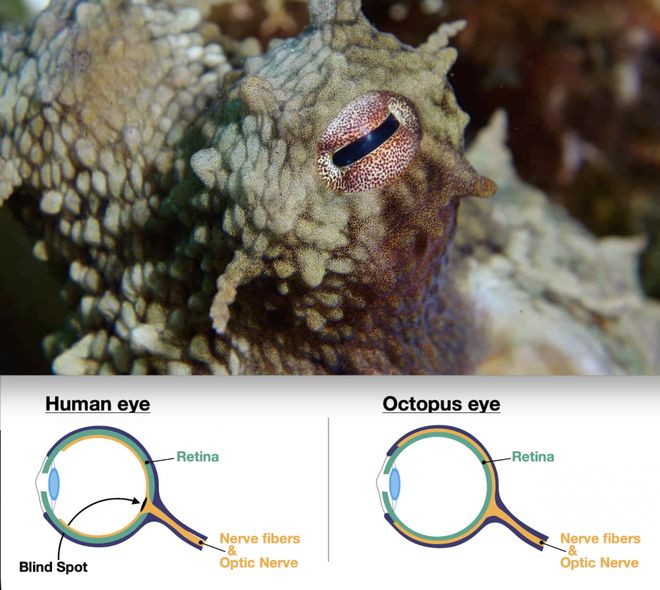

生物学中存在一种叫做趋同进化的现象,即不同的物种由于面临相似的压力环境而独立演化出相似的解决方案。最典型的例子是眼睛的形成。

无论是章鱼还是人类都拥有相机式的视觉器官,包括调焦晶状体、控制光线量的眼瞳以及视网膜上的感光细胞等关键部分,这些结构几乎相同。

章鱼和人类眼球构造对比 | 图片

尽管章鱼是软体动物而人类属于脊椎动物,并且它们的共同祖先生活在五亿多年前没有复杂视觉器官的时代,但两者依然独立演化出了相同的视觉系统。这是因为将光线转化为图像的有效方式几乎只有相机式这一种。

autoDream 与人脑睡眠之间的关系可能也遵循类似的模式——在相同约束条件下,不同类型的系统可能会收敛到相似的结构上。

必须离线运行是两者的一个共同特点。

当用户工作时,autoDream 不会启动。它作为一个独立进程,在主线程完全隔离的状态下运作,并受到严格的工具权限限制。

人脑同样面临类似的问题,不过解决方案更为彻底:记忆从海马体(临时存储区)转移到新皮层(长期存储库),需要一组仅在睡眠期间才会出现的神经节律来完成这一过程。

最重要的是海马体中的尖波涟漪,它将当天编码的记忆片段打包并逐步发送到大脑皮层;而大脑皮层的慢振荡和丘脑的纺锤波则为整个过程提供精准的时间协调机制。

这套节律在清醒状态下无法形成。外部刺激会破坏这一过程,因此你不是因为疲劳才睡觉,而是大脑必须关闭前门才能打开后门进行整理工作。

或者说,在同一时间窗口内,信息摄取和结构化处理之间是竞争资源关系而非互补关系。

睡眠期间会通过主动系统巩固模型来完成数据迁移。在深度睡眠阶段(慢波睡眠),刚写入“海马体”的记忆会被反复回放并逐步转移并固化到长期存储区中;而这一过程依赖于大脑皮层和海马体之间的高度同步对话,确保信息被精确地上传至长期存储库。

另一个方法是不做全量记录,而是进行编辑。

autoDream 启动后不会保留所有日志。它会先读取现有记忆确认已知信息,并扫描 KAIROS 的每日日志以处理与先前认知有偏差的部分。

整理完的记忆被存储在一个三层索引系统中:轻量级指针层始终加载,主题文件按需调入,而完整历史则永远不直接加载。同时,那些可以直接从项目代码查询到的事实(例如某个函数定义所在的文件)不会写入记忆。

人脑在睡眠期间做的几乎是同样的事情。

哈佛医学院讲师艾琳·J·瓦姆斯利的一项研究表明,在睡眠中优先巩固的是那些不寻常的信息,比如让你感到意外的、引发情绪波动的或者与未解决的问题有关的记忆;而大量的重复和无特征日常细节则会被丢弃,只留下抽象规律——你可能记不清昨天上班路上的具体情况,但清楚记得路线如何。

有趣的是,在这方面两个系统做出了不同的选择。autoDream 生产出的记忆在代码中明确标注为“提示”而非“真相”,代理每次使用前都需要重新验证是否仍然成立;因为它知道整理出来的东西可能不准确。

而人脑并没有这一套机制,这就是为什么法庭上的目击证人在作证时常常会给出错误证词的原因——他们并非故意说谎,而是记忆是从大脑的零散碎片中临时拼凑出来的,出错是常态现象。

在原始环境中需要身体迅速反应的情况下,相信自己的记忆可以立刻行动而怀疑则会导致犹豫。而在现代环境下反复做出知识型决策时,验证的成本较低且盲目自信反而危险。

两种情境下得出的答案不同。

趋同进化意味着两条独立的发展路线在没有直接信息交换的情况下走向了相同的终点,大自然里不存在抄袭行为,但工程师可以参考论文学习。

03

更聪明的懒惰

Anthropic 在设计睡眠机制时,是否是由于撞上了与人脑一样的物理限制而不得不采取这种方式还是说他们从一开始就参考了脑科学?

从泄露的代码中并没有发现任何神经科学研究文献引用,autoDream 这个名字更像是程序员的一个玩笑。更可能的驱动因素应该是工程约束本身——上下文有硬性上限、长时间运行会导致噪音累积,并且在线整理会干扰主线程推理过程。他们在解决一个纯粹的技术问题,而不是模仿生物学。

决定方案形状的是限制条件所施加的压力大小。

过去两年间,人工智能行业的定义几乎总是指向更大的模型、更长的上下文窗口和更快的推断速度,并且7*24小时无休止运行。方向永远是“更多”。

autoDream 的存在暗示了一个不同的命题:聪明的人工智能可能是懒惰的。

一个从不停下来整理自己的人工智能不会变得更聪明,只会变得越来越混乱。

经过几亿年的演化后,人类大脑得出了一个看似笨拙但实际有效的结论——智能必须有节奏。清醒时用于感知世界,睡眠时则用来理解它。当一家人工智能公司通过解决技术问题独立得出同样的结论时,这或许在暗示:

智能有一些不可避免的基本开销。

或许一个从不睡觉的人工智能并不是更强的智能体,而只是尚未意识到自己需要休息的智能体而已。

或许,一个从不睡觉的 AI,不是更强的 AI。它只是一个还没意识到自己需要睡觉的 AI。

*头图

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

极客一问

如果你的 AI 助手和你说它要睡觉了,

你会怎么办?